Clear Sky Science · de

Adaptive Multi‑Objective‑Optimierung des Energiemanagements in Mikronetzen mittels Deep Reinforcement Learning unter Berücksichtigung von Batteriedegradation und Unsicherheit bei erneuerbaren Energien

Intelligentere lokale Stromversorgung für den Alltag

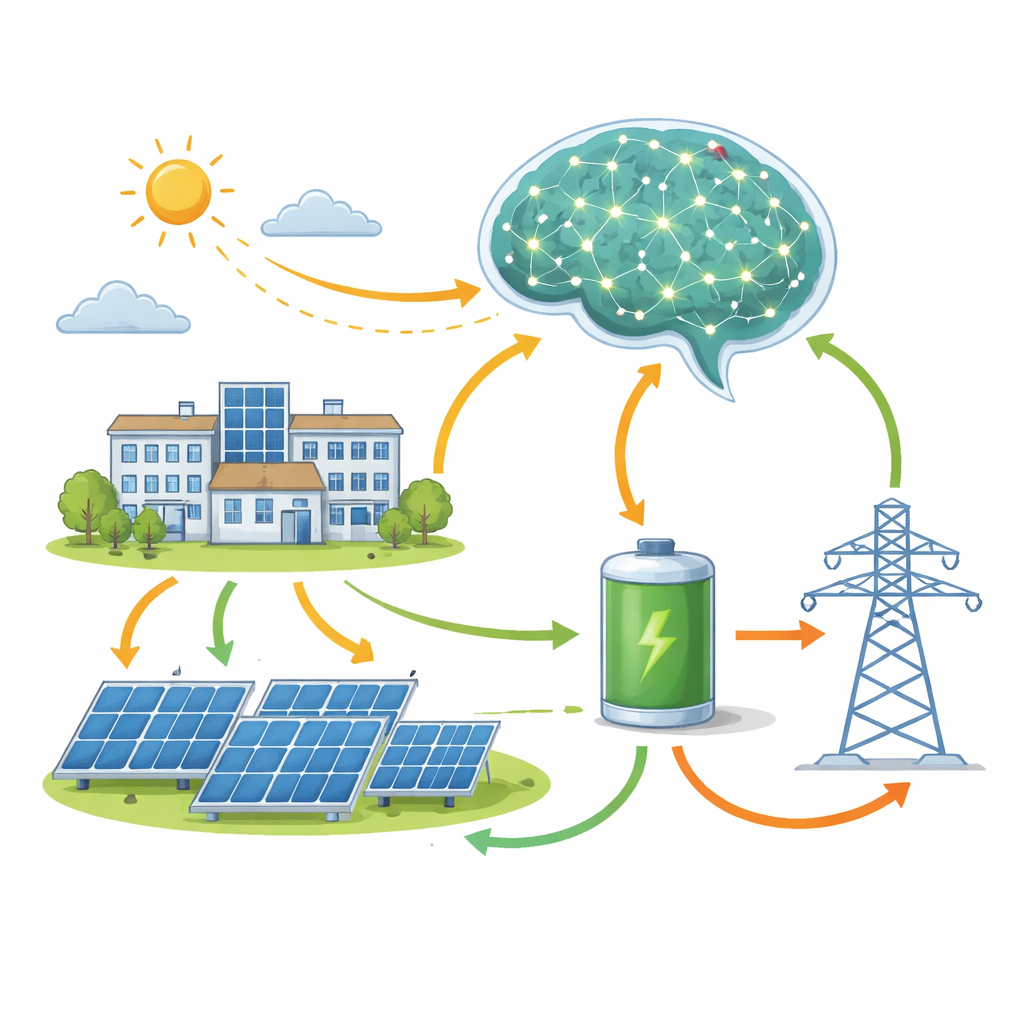

Da immer mehr Haushalte, Campusgelände und Unternehmen Solarmodule und Batterien installieren, wird die Frage, wann Strom gekauft, gespeichert oder verbraucht werden soll, zu einem riskanten Balanceakt. Gut gesteuert spart das Kosten und verringert die Umweltbelastung; schlecht gesteuert verschwendet sauberen Strom und verschleißt teure Batterien. Diese Studie untersucht, wie eine Form künstlicher Intelligenz—Deep Reinforcement Learning—als „digitaler Betreiber“ eines Solar‑und‑Batterie‑Mikronetzes fungieren kann und Tag für Tag dazulernt, um Kosten zu senken, mehr erneuerbare Energie zu nutzen und die Batterie vor vorzeitigem Alterungsschaden zu schützen—selbst wenn die Wettervorhersage falsch liegt.

Warum kleine Stromnetze wichtig sind

Mikronetze sind kompakte Energiesysteme, die Solarmodule, Batteriespeicher, steuerbare Verbraucher und einen Anschluss an das übergeordnete Netz verbinden. Sie können einen Campus oder ein Wohnviertel versorgen und kritische Lasten aufrechterhalten, wenn das Hauptnetz belastet ist. Sie sind jedoch schwer zu betreiben: Sonneneinstrahlung und Nachfrage ändern sich minütlich, Strompreise schwanken im Tagesverlauf und jeder Lade‑/Entladezyklus baut die Batterie langsam ab. Traditionelle Regelungsansätze stützen sich auf mathematische Optimierung und genaue Vorhersagen, die oft versagen, wenn die Bedingungen von den Erwartungen abweichen oder das System zu komplex wird.

Ein lernender Regler, der aus Erfahrung trainiert

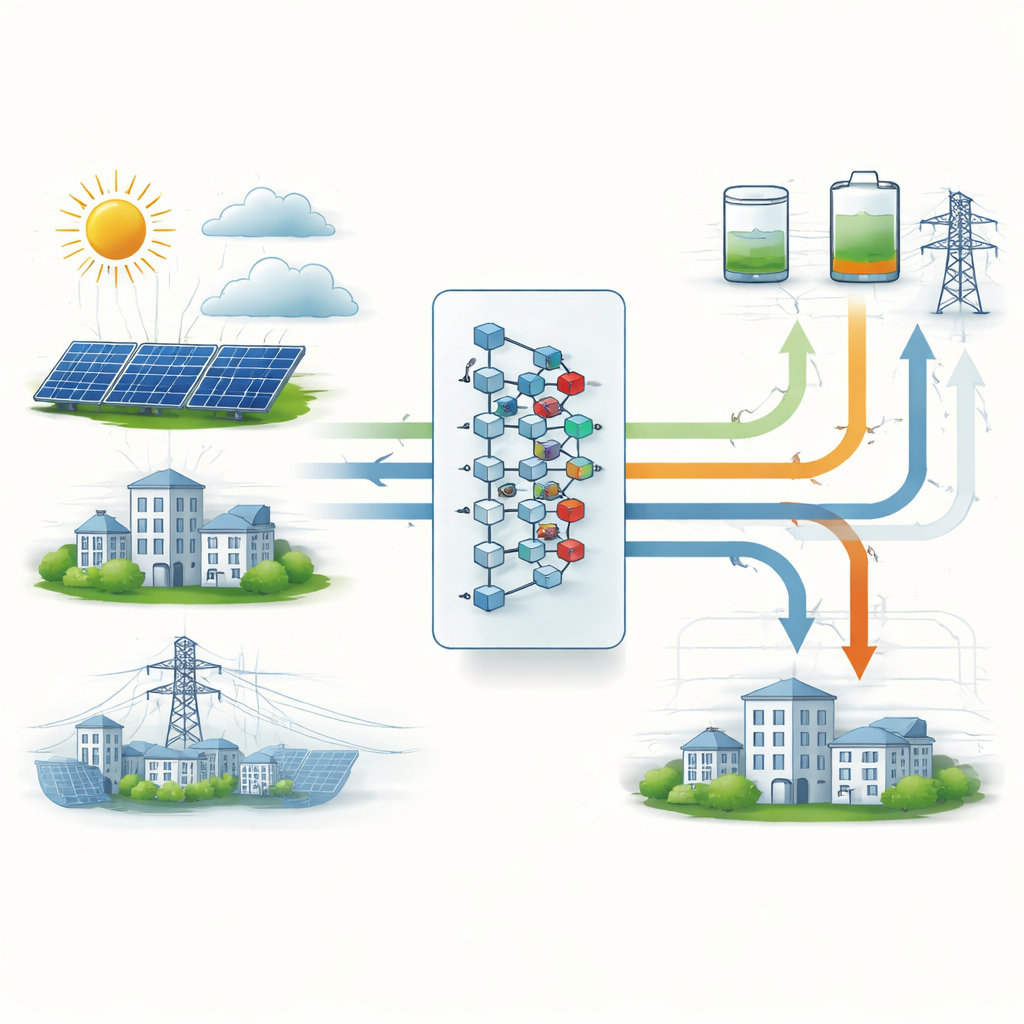

Die Forscher bauten einen detaillierten digitalen Zwilling eines campusgroßen Mikronetzes im Westen Saudi‑Arabiens, inklusive 300 kW Solarleistung, einer großen Lithium‑Ion‑Batterie, flexiblen und unflexiblen Lasten sowie einer bidirektionalen Anbindung ans Hauptnetz. Anschließend trainierten sie einen Deep Reinforcement Learning‑Agenten—konkret ein fortgeschrittenes Deep Q‑Network—zur Steuerung dieses virtuellen Systems in 15‑Minuten‑Schritten über viele simulierte Jahre. Der Agent beobachtete den Ladezustand der Batterie, kurzfristige Prognosen für Solarstrom und Last, Strompreise und Temperatur und wählte Aktionen wie die Ladungs‑/Entladeintensität der Batterie und das Ausführen verschiebbarer Lasten. Nach jedem Schritt erhielt er eine Belohnung, die drei Ziele vereinte: geringere Stromkosten, langsamere Batteriealterung und geringere Abhängigkeit vom fossilen Netzstrom.

Abwägung von Kosten, Batterielebensdauer und sauberer Energie

Um reale Zielkonflikte abzubilden, integrierte das Team ein physikbasiertes Batteriealterungsmodell direkt in das Lernsignal. Die Rewardfunktion bestrafte sowohl kurzfristige Kosten als auch langfristigen Kapazitätsverlust und verhängte strenge Abschläge bei Verletzungen von Sicherheitsgrenzen wie Überladung oder Tiefentladung der Batterie. Nach etwa 10.000 simulierten Tagen des Trainings entdeckte der Agent Strategien, die Menschen häufig empfehlen—ohne dass sie ihm explizit beigebracht wurden. Er lernte, viele mitteltiefe Zyklen gegenüber wenigen tiefen Zyklen zu bevorzugen, die Batterie in einem mittleren Ladezustand zu halten, in dem die Alterung langsamer voranschreitet, und vor sonnigen Perioden ausreichend Platz in der Batterie freizuhalten, damit Solarenergie gespeichert statt verschwendet wird.

Schlag eines konventionellen smarten Reglers

Der neue lernbasierte Regler wurde direkt gegen eine starke Referenz geprüft: Model Predictive Control, die in der Industrie weit verbreitet ist und von guten Vorhersagen ausgeht. Über ein komplettes Jahr mit realen Wetter‑ und Lastdaten senkte die gelernte Richtlinie die Betriebskosten um etwa 12 Prozent, verringerte den Kapazitätsverlust der Batterie um etwas mehr als 8 Prozent und steigerte die Nutzung lokal erzeugten Solarstroms um rund 10 Prozent. Sie reduzierte zudem die Spitzenleistung, die aus dem Netz gezogen wurde, und senkte die damit verbundenen CO2‑Emissionen um fast 14 Prozent. Besonders bemerkenswert: Einmal trainiert, traf der KI‑Regler Entscheidungen in wenigen Tausendstelsekunden—viel schneller als die mehrere Sekunden dauernde Optimierung der klassischen Methode—und eignet sich damit für kostengünstige lokale Hardware.

Robust bleiben, wenn das Wetter falsch liegt

Reale Mikronetze müssen mit plötzlichen Bewölkungen und ungenauen Prognosen zurechtkommen. Die Forscher belasteten beide Regler mit zunehmend fehlerhaften Solarprognosen. Bei stark wachsenden Vorhersagefehlern stiegen die Kosten des traditionellen Reglers um mehr als ein Fünftel, während die Kosten des lernbasierten Reglers um weniger als ein Zehntel anstiegen. Der KI‑Agent meisterte auch schnelle Schwankungen der Sonneneinstrahlung besser und glättete Leistungsflüsse mithilfe der Batterie, ohne auf schädliche Tiefentladungen zurückzugreifen. Er legte flexible Lasten so fest, dass sie mit Solarproduktion und Niedrigpreiszeiten zusammenfielen, was die Belastung des Netzes weiter minderte.

Was das für zukünftige Energiesysteme bedeutet

Einfach gesagt zeigt die Studie, dass eine trainierte KI ein Solar‑und‑Batterie‑System wie ein erfahrener Betreiber steuern kann, der sowohl die heutige Rechnung, die zukünftige Batteriereserve als auch die Klimawirkung jeder Kilowattstunde berücksichtigt. Indem der Regler direkt aus Daten lernt statt sich auf perfekte Prognosen und vereinfachte Formeln zu verlassen, liefert er günstigeren, saubereren Strom und verlängert die Lebensdauer teurer Batterien. Obwohl die Arbeit in Simulationen für ein Campus‑Mikronetz in Saudi‑Arabien durchgeführt wurde, könnte der Ansatz auf andere Standorte angepasst und auf Netzwerke von Mikronetzen ausgeweitet werden und bietet damit einen vielversprechenden Weg zu resilienteren, effizienteren und nachhaltigeren lokalen Energiesystemen.

Zitation: Altimania, M.R.M., Basem, A., Saydullaev, B. et al. Adaptive multi-objective optimization of microgrid energy management using deep reinforcement learning considering battery degradation and renewable uncertainty. Sci Rep 16, 14296 (2026). https://doi.org/10.1038/s41598-026-44179-z

Schlüsselwörter: Mikronetze, Deep Reinforcement Learning, Batteriezustand, erneuerbare Energien, Energiemanagement