Clear Sky Science · fr

Optimisation multi‑objectif adaptative de la gestion énergétique d’une micro‑grille par apprentissage par renforcement profond en tenant compte de la dégradation des batteries et de l’incertitude des renouvelables

Une gestion locale de l’énergie plus intelligente au quotidien

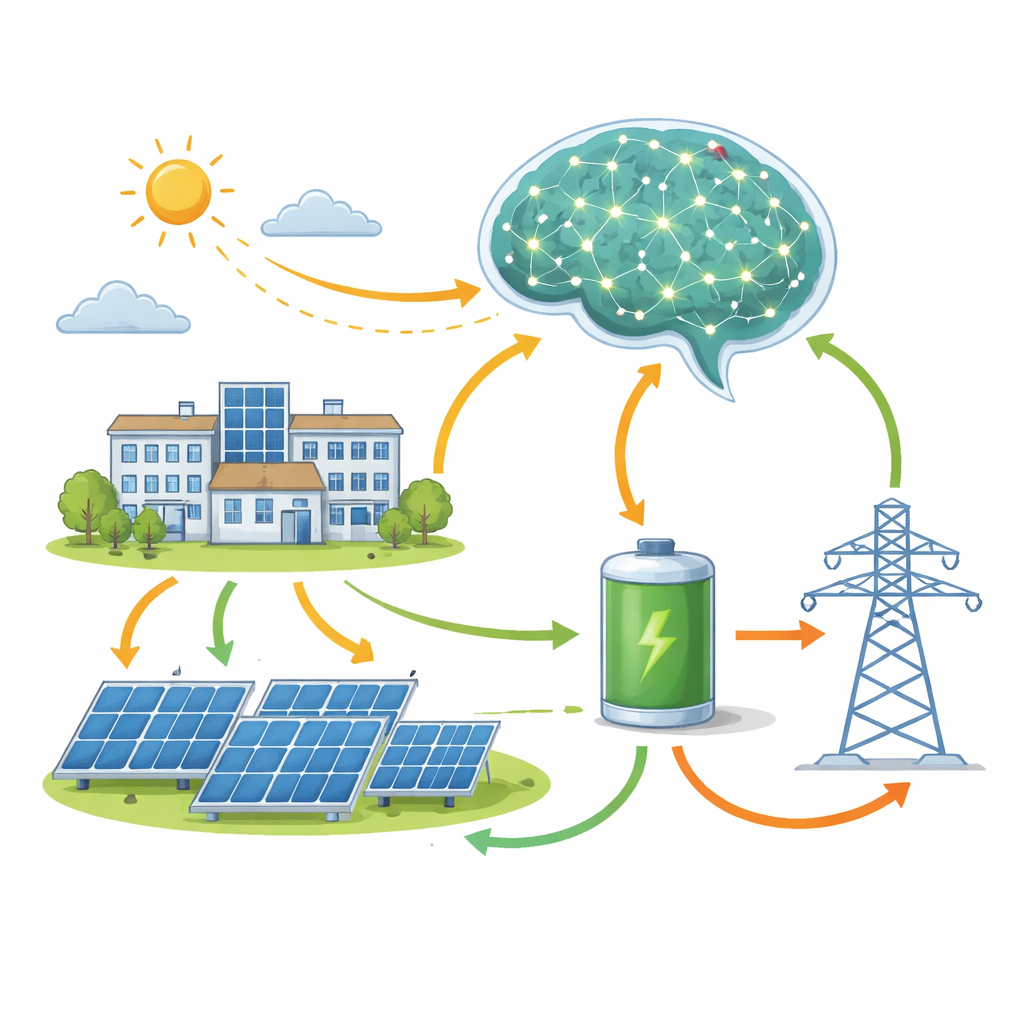

À mesure que davantage de foyers, campus et entreprises installent des panneaux solaires et des batteries, décider quand acheter, stocker ou consommer de l’électricité devient un véritable numéro d’équilibriste. Bien fait, cela réduit les factures et la pollution ; mal fait, cela gaspille de l’énergie propre et détériore des batteries coûteuses. Cette étude examine comment une forme d’intelligence artificielle appelée apprentissage par renforcement profond peut jouer le rôle d’« opérateur numérique » pour une micro‑grille solaire‑batterie, apprenant jour après jour à maintenir des coûts bas, à utiliser davantage d’énergie renouvelable et à protéger la batterie contre un vieillissement prématuré — même lorsque les prévisions météorologiques sont erronées.

Pourquoi les petits réseaux électriques comptent

Les micro‑grilles sont des systèmes électriques compacts qui relient panneaux solaires, stockage par batteries, appareils pilotables et une connexion au réseau principal. Elles peuvent alimenter un campus ou un quartier, et maintenir les charges critiques lorsque le réseau principal est sollicité. Mais elles sont difficiles à exploiter : l’ensoleillement et la demande varient à la minute, les prix de l’électricité fluctuent au fil de la journée, et chaque cycle charge‑décharge dégrade progressivement la batterie. Les schémas de contrôle traditionnels reposent sur l’optimisation mathématique et des prévisions précises, qui échouent souvent quand les conditions s’écartent des attentes ou que le système devient trop complexe.

Un contrôleur apprenant qui s’entraîne par l’expérience

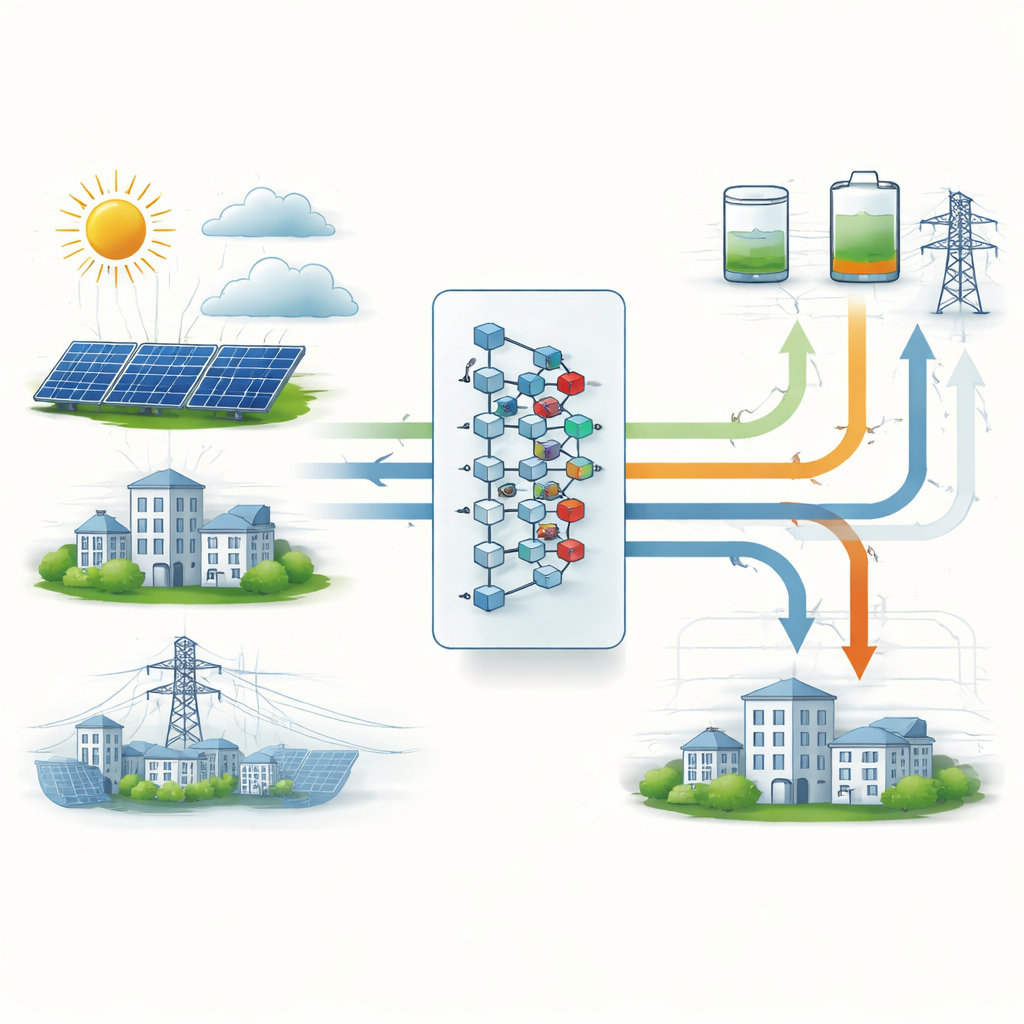

Les chercheurs ont construit un jumeau numérique détaillé d’une micro‑grille de campus dans l’ouest de l’Arabie saoudite, incluant 300 kW de panneaux solaires, une grande batterie lithium‑ion, des charges flexibles et inflexibles, et une liaison bidirectionnelle au réseau principal. Ils ont ensuite entraîné un agent d’apprentissage par renforcement profond — plus précisément un Deep Q‑Network avancé — pour faire fonctionner ce système virtuel par pas de 15 minutes sur de nombreuses années simulées. L’agent observait le niveau de charge de la batterie, les prévisions à court terme du solaire et de la demande, les prix de l’électricité et la température, et choisissait des actions comme l’intensité de charge ou de décharge de la batterie et l’exécution de charges déplaçables. Après chaque pas, il recevait une récompense intégrant trois objectifs : payer moins l’électricité, ralentir l’usure de la batterie et dépendre moins de l’électricité produite par des sources fossiles du réseau.

Concilier coût, santé de la batterie et énergie propre

Pour traduire les compromis réels, l’équipe a intégré un modèle physique de vieillissement des batteries directement dans le signal d’apprentissage. La fonction de récompense pénalisait à la fois les coûts à court terme et la perte de capacité à long terme, et elle dissuadait fermement les violations des limites de sécurité comme la surcharge ou la décharge excessive. Après environ 10 000 jours simulés de pratique, l’agent a découvert des stratégies que les humains recommandent souvent — sans les lui avoir explicitement enseignées. Il a appris à privilégier de nombreux cycles de profondeur modérée plutôt que quelques cycles profonds, à maintenir la batterie dans un état de charge moyen où le vieillissement est plus lent, et à laisser suffisamment de marge dans la batterie avant les périodes ensoleillées pour stocker l’énergie solaire à venir au lieu de la perdre.

Surpasser un contrôleur intelligent conventionnel

Le nouveau contrôleur basé sur l’apprentissage a été confronté en duel à un solide référentiel connu sous le nom de contrôle prédictif par modèle, largement utilisé dans l’industrie et qui suppose des prévisions fiables. Sur une année complète de données météo et de demande, la politique apprise a réduit les coûts d’exploitation globaux d’environ 12 %, diminué la perte de capacité de la batterie de un peu plus de 8 % et augmenté l’utilisation de l’électricité solaire locale d’environ 10 %. Elle a aussi réduit la puissance de pointe prélevée sur le réseau et diminué les émissions de carbone associées de près de 14 %. Fait peut‑être le plus remarquable, une fois entraîné, le contrôleur IA prenait ses décisions en quelques millièmes de seconde — beaucoup plus rapide que les secondes nécessaires à l’optimisation classique — ce qui le rend adapté au matériel peu coûteux installé sur site.

Rester robuste lorsque la météo se trompe

Les micro‑grilles réelles doivent composer avec des surprises nuageuses et des prévisions imparfaites. Les chercheurs ont soumis les deux contrôleurs à des prévisions solaires de moins en moins précises. À mesure que les erreurs de prévision devenaient sévères, les coûts du contrôleur traditionnel ont augmenté de plus d’un cinquième, tandis que ceux du contrôleur basé sur l’apprentissage ont augmenté de moins d’un dixième. L’agent IA a également géré plus élégamment les variations rapides d’ensoleillement, utilisant la batterie pour lisser les flux d’énergie sans recourir à des décharges profondes dommageables. Il a programmé les charges flexibles pour qu’elles coïncident avec la production solaire et les heures de prix faibles, allégeant encore la charge sur le réseau.

Ce que cela implique pour les systèmes électriques à venir

Concrètement, l’étude montre qu’une IA entraînée peut exploiter un système solaire‑batterie comme un opérateur avisé qui se soucie de la facture d’aujourd’hui, de la santé de la batterie de demain et de l’impact climatique de chaque kilowatt‑heure. En apprenant directement à partir des données, plutôt que de s’appuyer sur des prévisions parfaites et des formules simplifiées, le contrôleur délivre une énergie moins chère et plus propre tout en prolongeant la durée de vie des batteries coûteuses. Bien que le travail ait été réalisé en simulation pour une micro‑grille de campus en Arabie saoudite, la même approche pourrait être adaptée à d’autres sites et étendue à des réseaux de micro‑grilles, offrant une voie prometteuse vers des systèmes énergétiques locaux plus résilients, efficaces et durables.

Citation: Altimania, M.R.M., Basem, A., Saydullaev, B. et al. Adaptive multi-objective optimization of microgrid energy management using deep reinforcement learning considering battery degradation and renewable uncertainty. Sci Rep 16, 14296 (2026). https://doi.org/10.1038/s41598-026-44179-z

Mots-clés: microgrids, deep reinforcement learning, battery health, renewable energy, energy management