Clear Sky Science · sv

Att lära multimodala LLM:er att tolka 12-avlednings-elektrokardiografibilder

Varför det är viktigt att lära datorer att läsa hjärtspår

Varje dag registreras miljoner människors hjärtaktivitet med ett elektrokardiogram, eller EKG. Läkare ser vanligtvis dessa inspelningar som tryckta eller digitala diagram fulla av vågiga linjer. På många platser, särskilt kliniker med begränsade resurser, finns endast dessa bilder tillgängliga—inga råa digitala signaler, ingen avancerad mjukvara. Denna studie visar hur en ny typ av artificiell intelligens (AI) kan lära sig att ”läsa” EKG-bilder direkt och därigenom erbjuda mer tillförlitligt stöd till vårdgivare världen över.

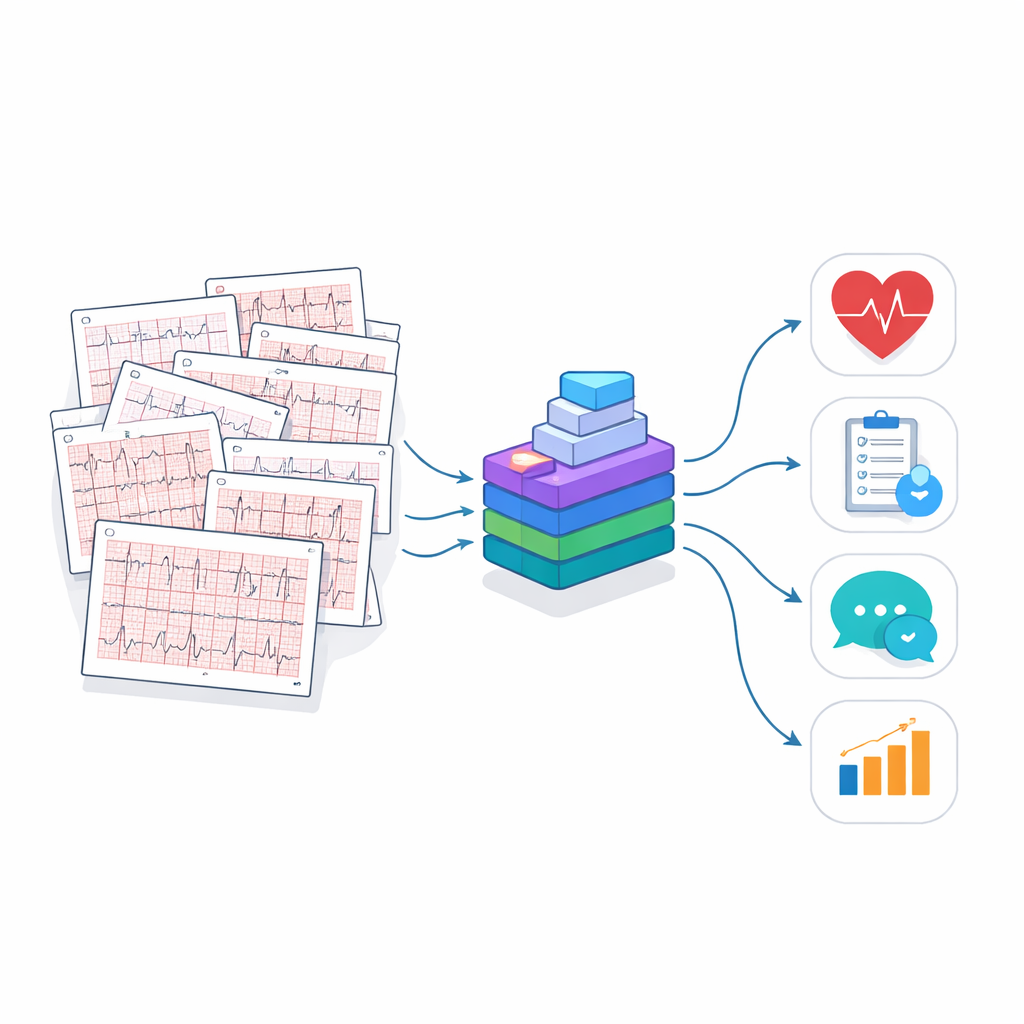

Bygga ett omfattande bibliotek av hjärtbilder

För att lära ett AI-system att förstå EKG-bilder behövde forskarna först skapa ett stort, realistiskt träningsbibliotek. De flesta befintliga EKG-databaser lagrar råa elektriska signaler i stället för de välkända papperslika bilder som läkare använder. Teamet konverterade dessa signaler till levande 12-avlednings-EKG-bilder, kompletta med rutnät och standardlayout. De lade också till realistiska imperfektioner—veck, rotationer, svaga linjer, färgskiftningar och till och med simulerade kamerabilder—för att efterlikna vad som händer när EKG skrivs ut, skannas eller fotograferas i verkliga kliniker. Dessa bilder kom från flera stora patientgrupper i Europa, Nordamerika och Sydamerika, vilket hjälpte systemet lära sig mönster som uppträder i olika populationer och sjukhusmiljöer.

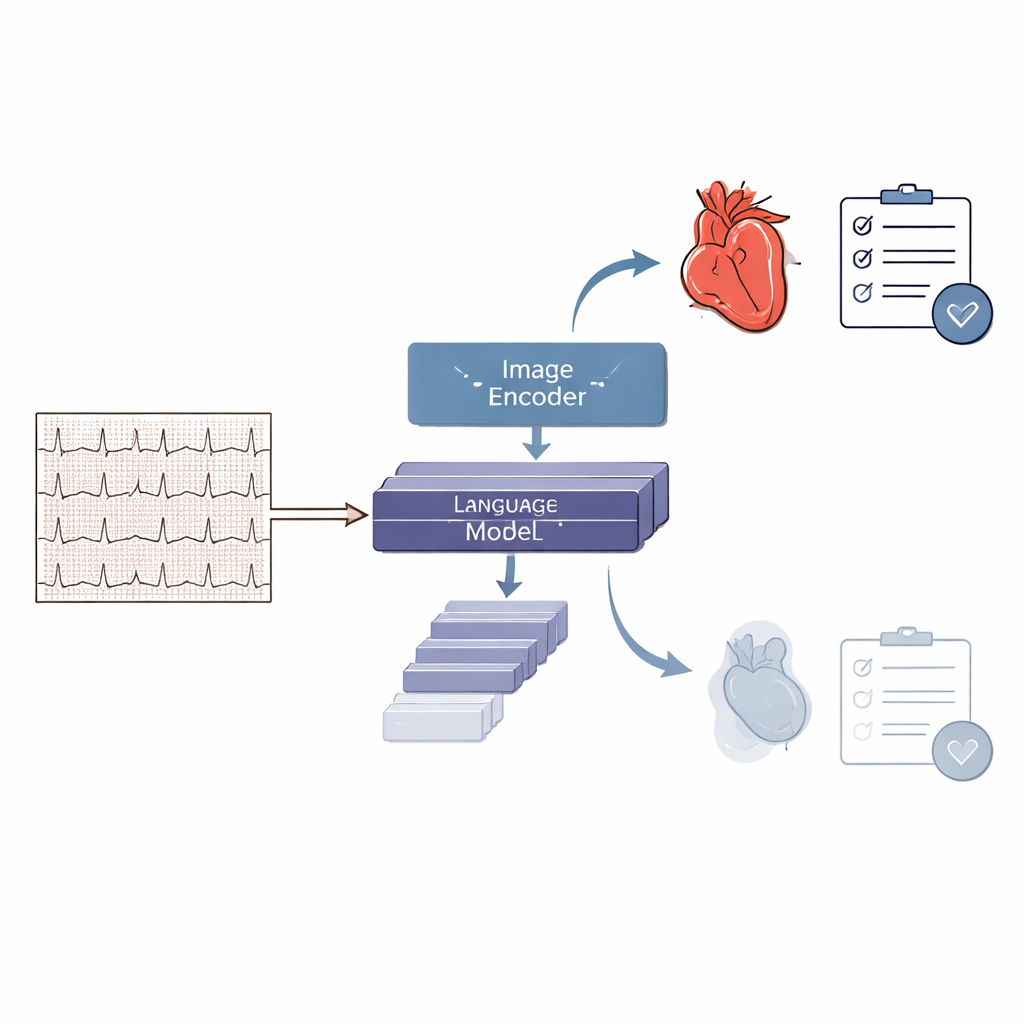

Lära en AI att förstå vad den ser

Att bara visa AI:n miljontals EKG-bilder är inte nog; den måste också lära sig hur den ska svara på meningsfulla frågor. Teamet skapade ECGInstruct, en samling på mer än en miljon bild- och textpar. Varje par länkar en EKG-bild till en uppgift: att upptäcka grundläggande hjärtfunktioner, känna igen onormala rytmer, identifiera tecken på sjukdom eller skriva en kort kliniskt formulerad rapport. För att skala upp detta använde forskarna en kraftfull språkmodell för att hjälpa till att utforma frågor och svar, och filtrerade och förfinade sedan innehållet med automatiska kontroller och expertgranskning. Det gav AI:n inte bara råa bilder utan också ett rikt set exempel på hur kliniker tänker och uttrycker sig om EKG.

Introduktion av PULSE, en specialiserad hjärtläsarmodell

Med denna stora och omsorgsfullt förberedda datamängd tränade teamet PULSE, en multimodal AI-modell som kan granska en EKG-bild och producera textbaserade tolkningar. PULSE kombinerar en bildbehandlingsmodul med en språkmodul så att den kan koppla visuella mönster till skriftliga förklaringar och beslut. Till skillnad från tidigare system som begränsades till ett fåtal fasta diagnoser eller krävde rena numeriska signaler är PULSE utformad för att hantera många typer av frågor, från ”Är detta EKG normalt eller onormalt?” till ”Beskriv rytmen och huvudfynden.” Den kan också föra flerstegs samtal om ett enskilt EKG, vilket speglar hur en kliniker kan resonera genom ett svårt fall.

Sätta systemet på prov

För att se hur väl PULSE fungerar byggde forskarna ECGBench, en bred testsvit för förståelse av EKG-bilder. ECGBench inkluderar standardiserade diagnosuppgifter, rapportgenerering, flervalsfrågor om fall från verkligheten och flerrundiga fråge–svar-sessioner som känns som en dialog med en specialist. Både på välbekanta dataset och helt nya presterade PULSE bättre än allmänna AI-modeller såsom vitt använda kommersiella system med 21–33 procentenheter högre noggrannhet. Den slog också tidigare EKG-verktyg inriktade på råa signaler, särskilt i uppgifter som krävde öppet slutna resonemang eller arbete från utskriftslika bilder enbart. I jämförande exempel producerade PULSE vanligtvis rapporter som låg närmare experttolkningar än de från ledande generella AI-modeller.

Vad detta kan innebära för vardagsvården

Studien tyder på att en omsorgsfullt tränad, öppen AI som PULSE skulle kunna bli en mångsidig assistent där EKG-bilder används. Eftersom den arbetar direkt på bilder kan den stödja kliniker som endast har skannade eller fotograferade utskrifter, och den kan gå bortom enkla ja-eller-nej-etiketter för att ge rikare förklaringar och flerstegsresonemang. Samtidigt betonar författarna att systemet ännu inte är en ersättning för kardiologer. Det når fortfarande inte expertprestanda och måste testas noggrant i verkliga sjukhusmiljöer med hänsyn till säkerhet, bias och korrekt tillsyn. Trots detta markerar arbetet ett viktigt steg mot AI-verktyg som kan hjälpa kliniker att bättre förstå de vågiga linjerna som avslöjar människohjärtats hälsa.

Citering: Liu, R., Bai, Y., Yue, X. et al. Teaching multimodal LLMs to comprehend 12-lead electrocardiographic images. npj Digit. Med. 9, 349 (2026). https://doi.org/10.1038/s41746-026-02551-3

Nyckelord: elektrokardiogram, medicinsk AI, multimodala modeller, hjärtdiagnostik, kliniskt beslutsstöd