Clear Sky Science · fr

Apprendre aux LLM multimodaux à comprendre des images électrocardiographiques à 12 dérivations

Pourquoi il est important d’apprendre aux ordinateurs à lire les tracés cardiaques

Chaque jour, des millions de personnes subissent l’enregistrement de l’activité cardiaque par électrocardiogramme (ECG). Les médecins voient généralement ces enregistrements sous forme de graphiques imprimés ou numériques remplis d’ondulations. Dans de nombreux lieux, notamment les cliniques aux ressources limitées, seules ces images sont disponibles — pas de signaux numériques bruts, pas de logiciels avancés. Cette étude montre comment un nouveau type d’intelligence artificielle (IA) peut apprendre à « lire » directement les images d’ECG, offrant une aide plus fiable aux cliniciens du monde entier.

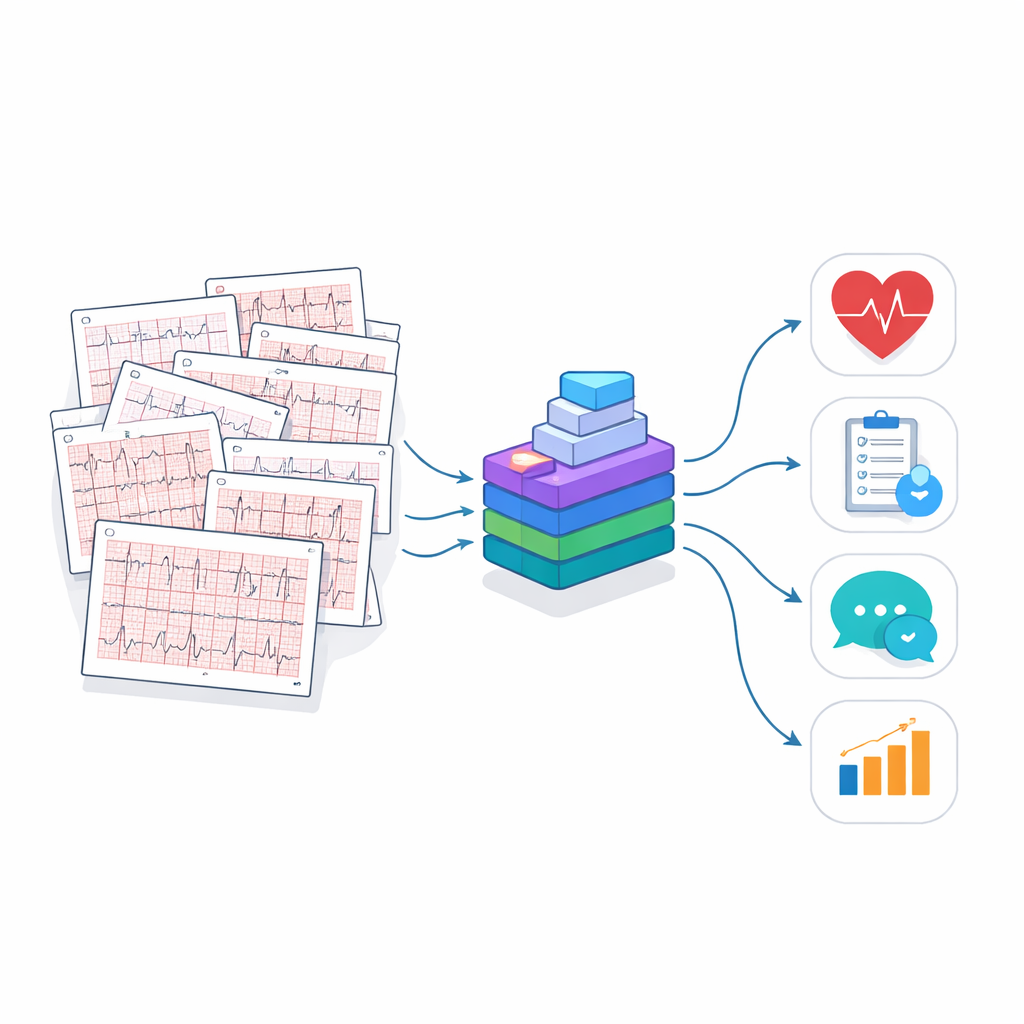

Construire une vaste bibliothèque d’images cardiaques

Pour enseigner à un système d’IA à comprendre les images d’ECG, les chercheurs ont d’abord dû créer une énorme bibliothèque d’entraînement réaliste. La plupart des bases de données ECG existantes conservent des signaux électriques bruts plutôt que les images familières en format papier utilisées par les médecins. L’équipe a converti ces signaux en images réalistes d’ECG à 12 dérivations, avec quadrillage et mises en page standard. Ils ont aussi ajouté des imperfections réalistes — plis, rotations, lignes faibles, variations de couleur et même des photos simulées au smartphone — pour reproduire ce qui se passe quand les ECG sont imprimés, numérisés ou photographiés dans des cliniques réelles. Ces images proviennent de plusieurs grands cohortes de patients en Europe, en Amérique du Nord et en Amérique du Sud, aidant le système à apprendre des motifs présents dans différentes populations et organisations hospitalières.

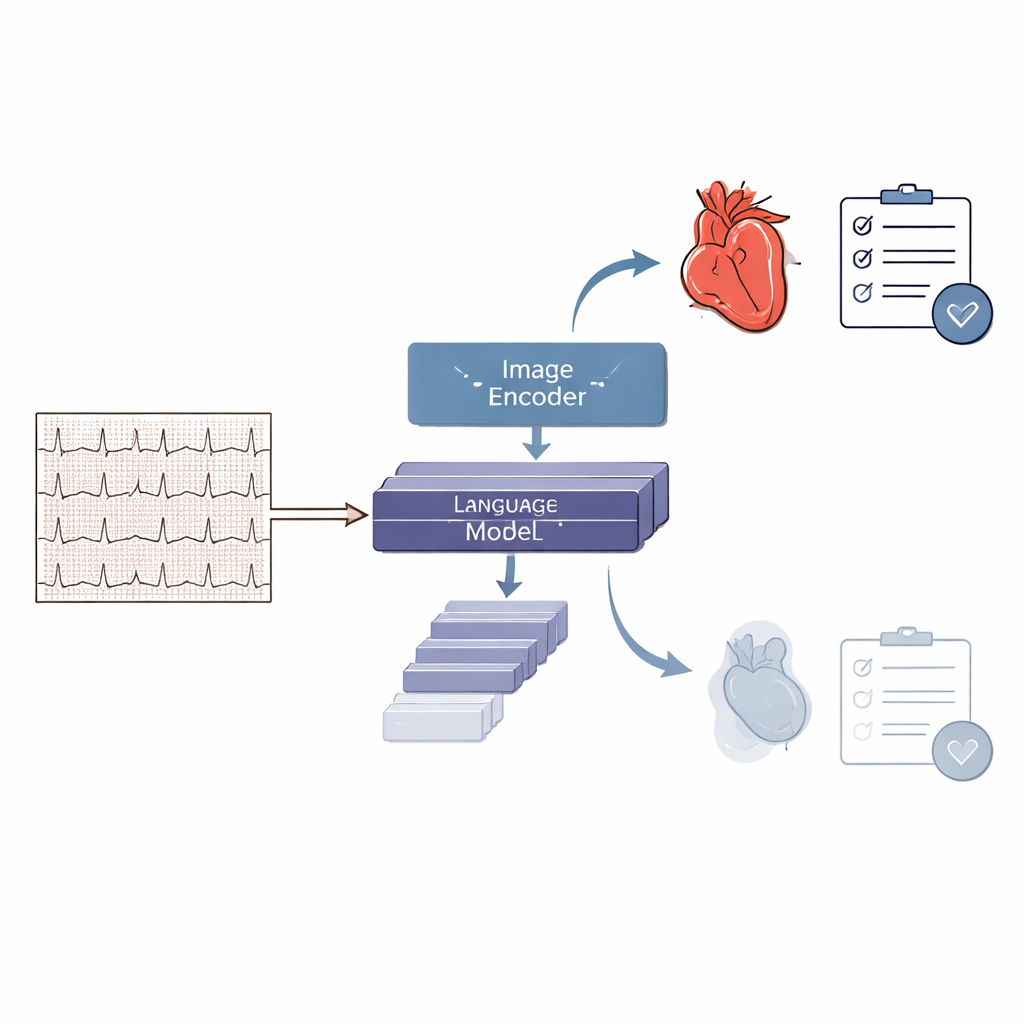

Apprendre à l’IA à comprendre ce qu’elle voit

Montrer simplement des millions d’images d’ECG à l’IA ne suffit pas ; elle doit aussi apprendre à répondre à des questions pertinentes. L’équipe a créé ECGInstruct, une collection de plus d’un million de paires image-texte. Chaque paire relie une image d’ECG à une tâche : repérer des caractéristiques de base du battement, reconnaître des rythmes anormaux, identifier des signes de maladie ou rédiger un court rapport de type clinique. Pour passer à grande échelle, les chercheurs ont utilisé un puissant modèle de langage pour aider à rédiger les questions et réponses, puis ont filtré et affiné ces contenus avec des contrôles automatiques et des relectures d’experts. Cela a fourni à l’IA non seulement des images brutes, mais aussi un riche ensemble d’exemples montrant comment les cliniciens pensent et parlent des ECG.

Présentation de PULSE, un modèle spécialisé dans la lecture du cœur

À partir de ce jeu de données volumineux et soigneusement préparé, l’équipe a entraîné PULSE, un modèle d’IA multimodal capable d’analyser une image d’ECG et de produire des interprétations textuelles. PULSE combine un module de traitement d’image et un module de langage pour relier les motifs visuels à des explications écrites et des décisions cliniques. Contrairement aux systèmes antérieurs limités à quelques diagnostics fixes ou nécessitant des signaux numériques propres, PULSE est conçu pour traiter de nombreux types de questions, de « Cet ECG est-il normal ou anormal ? » à « Décrivez le rythme et les principaux constats. » Il peut aussi mener des échanges en plusieurs étapes sur un même ECG, reflétant la manière dont un clinicien peut raisonner sur un cas difficile.

Mettre le système à l’épreuve

Pour évaluer les performances de PULSE, les chercheurs ont construit ECGBench, une large suite de tests pour la compréhension d’images d’ECG. ECGBench comprend des tâches de diagnostic standard, la génération de rapports, des questions à choix multiple sur des cas réels et des sessions de questions-réponses en plusieurs tours qui ressemblent à un dialogue avec un spécialiste. Sur des jeux de données connus comme sur des jeux entièrement nouveaux, PULSE a surpassé des modèles d’IA généralistes, y compris des systèmes commerciaux largement utilisés, de 21 à 33 points de pourcentage en précision. Il a également devancé des outils antérieurs centrés sur l’ECG et reposant sur des signaux bruts, en particulier pour les tâches nécessitant un raisonnement ouvert ou la lecture à partir d’images de type imprimé. Dans des exemples comparatifs côte à côte, PULSE produisait généralement des rapports plus proches des interprétations d’experts que ceux des grands modèles d’IA généralistes.

Ce que cela pourrait signifier pour les soins quotidiens

Cette étude suggère qu’une IA open source soigneusement entraînée comme PULSE pourrait devenir un assistant polyvalent chaque fois que des images d’ECG sont utilisées. Parce qu’il travaille directement sur des images, il peut aider des cliniques qui ne disposent que d’impressions numérisées ou de photos, et il peut aller au-delà d’étiquettes oui/non pour fournir des explications plus riches et un raisonnement en plusieurs étapes. Les auteurs soulignent toutefois que le système ne remplace pas encore les cardiologues. Il reste inférieur aux performances d’experts et doit être testé rigoureusement en milieu hospitalier réel, avec une attention portée à la sécurité, aux biais et à une supervision appropriée. Même ainsi, ce travail représente une étape importante vers des outils d’IA pouvant aider les cliniciens à mieux interpréter les lignes ondulées qui révèlent la santé du cœur humain.

Citation: Liu, R., Bai, Y., Yue, X. et al. Teaching multimodal LLMs to comprehend 12-lead electrocardiographic images. npj Digit. Med. 9, 349 (2026). https://doi.org/10.1038/s41746-026-02551-3

Mots-clés: électrocardiogramme, IA médicale, modèles multimodaux, diagnostic cardiaque, assistance à la décision clinique