Clear Sky Science · pt

Ensinando LLMs multimodais a compreender imagens eletrocardiográficas de 12 derivações

Por que ensinar computadores a ler traçados cardíacos importa

Todos os dias, milhões de pessoas têm a atividade cardíaca registrada por meio de um eletrocardiograma, ou ECG. Os médicos costumam ver esses registros como gráficos impressos ou digitais cheios de linhas onduladas. Em muitos lugares, especialmente em clínicas com recursos limitados, apenas essas imagens estão disponíveis — não há sinais digitais brutos nem software avançado. Este estudo mostra como um novo tipo de inteligência artificial (IA) pode aprender a “ler” imagens de ECG diretamente, oferecendo ajuda mais confiável a clínicos ao redor do mundo.

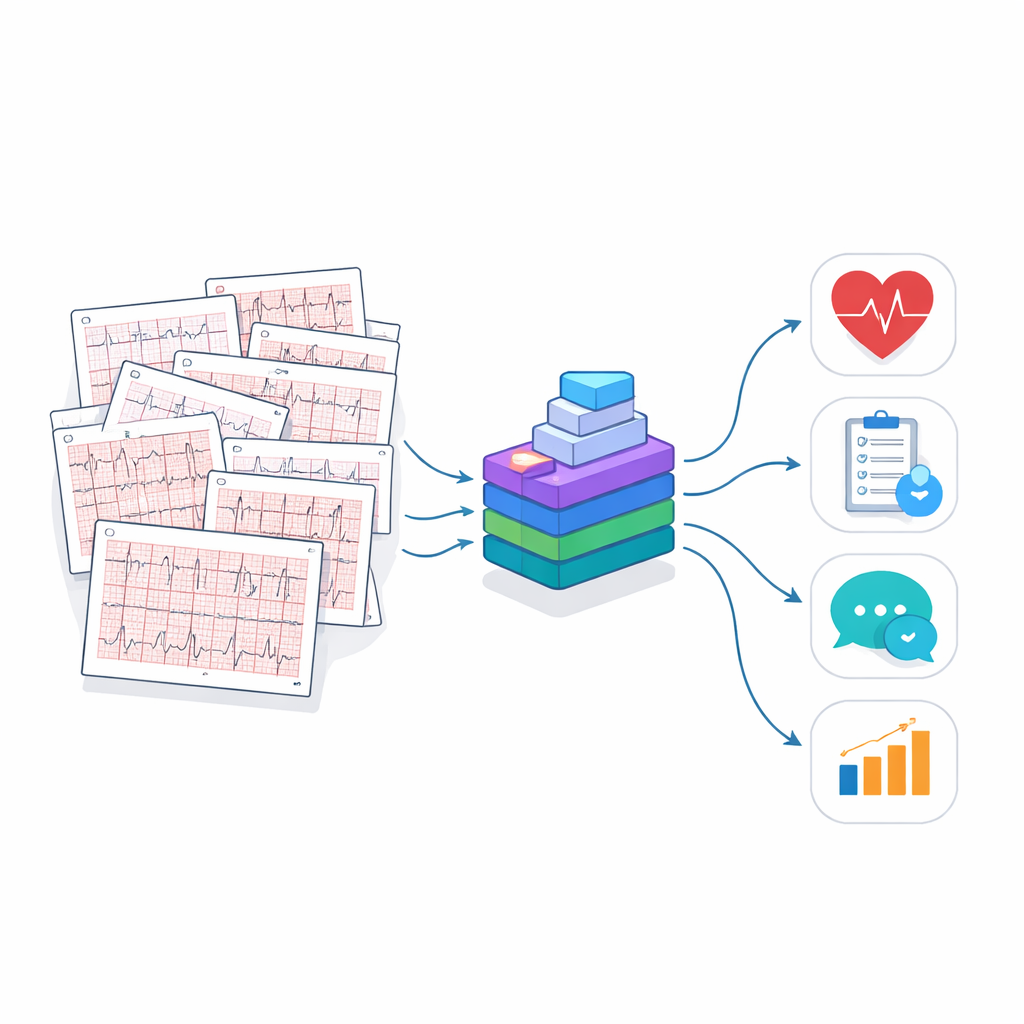

Construindo uma biblioteca massiva de imagens cardíacas

Para ensinar um sistema de IA a entender imagens de ECG, os pesquisadores primeiro tiveram de criar uma enorme biblioteca de treinamento realista. A maioria dos bancos de dados de ECG existentes armazena sinais elétricos brutos em vez das imagens tipo papel familiares aos médicos. A equipe converteu esses sinais em imagens realistas de ECG de 12 derivações, completas com linhas de grade e layouts padrão. Também adicionaram imperfeições realistas — vincos, rotações, linhas tênues, variações de cor e até fotos simuladas por câmera — para imitar o que acontece quando ECGs são impressos, escaneados ou fotografados em clínicas reais. Essas imagens vieram de vários grandes grupos de pacientes na Europa, América do Norte e América do Sul, ajudando o sistema a aprender padrões que aparecem em diferentes populações e configurações hospitalares.

Ensinando uma IA a entender o que vê

Simplesmente mostrar milhões de imagens de ECG à IA não basta; ela também precisa aprender a responder a perguntas significativas. A equipe criou o ECGInstruct, uma coleção com mais de um milhão de pares imagem-texto. Cada par vincula uma imagem de ECG a uma tarefa: detectar características básicas do batimento, reconhecer ritmos anormais, identificar sinais de doença ou redigir um breve relatório em estilo clínico. Para ampliar isso, os pesquisadores usaram um poderoso modelo de linguagem para ajudar a rascunhar perguntas e respostas, depois filtraram e refinaram com checagens automáticas e revisão de especialistas. Isso deu à IA não apenas imagens brutas, mas um conjunto rico de exemplos de como os clínicos pensam e falam sobre ECGs.

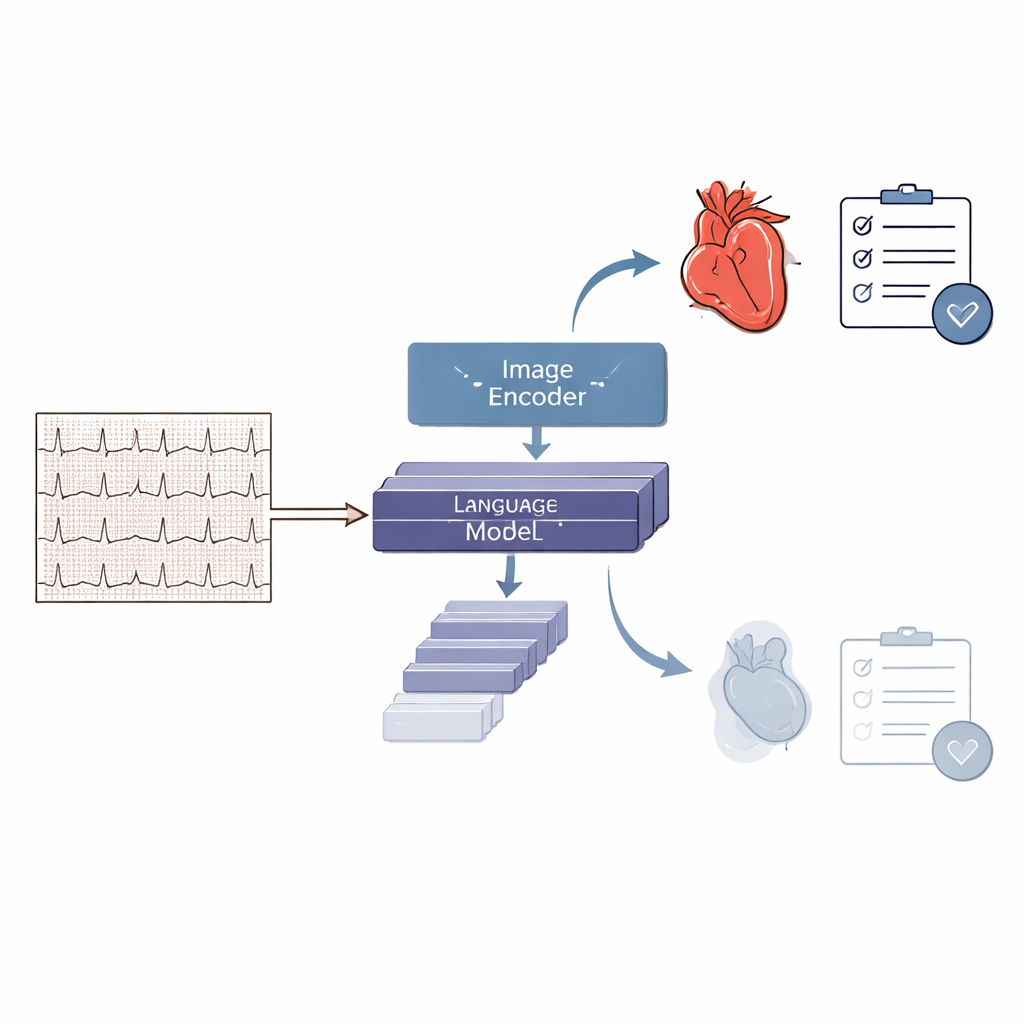

Apresentando PULSE, um modelo especializado em leitura cardíaca

Usando esse grande e cuidadosamente preparado conjunto de dados, a equipe treinou o PULSE, um modelo de IA multimodal que pode olhar uma imagem de ECG e produzir interpretações em texto. O PULSE combina um módulo de processamento de imagens com um módulo de linguagem para conectar padrões visuais a explicações escritas e decisões. Ao contrário de sistemas anteriores que eram restritos a alguns diagnósticos fixos ou que exigiam sinais numéricos limpos, o PULSE foi projetado para lidar com muitos tipos de perguntas, desde “Este ECG é normal ou anormal?” até “Descreva o ritmo e os achados principais.” Ele também pode participar de conversas em múltiplas etapas sobre um único ECG, espelhando como um clínico pode raciocinar sobre um caso difícil.

Colocando o sistema à prova

Para avaliar o desempenho do PULSE, os pesquisadores construíram o ECGBench, um amplo conjunto de testes para compreensão de imagens de ECG. O ECGBench inclui tarefas padrão de diagnóstico, geração de relatórios, questões de múltipla escolha em casos do mundo real e sessões de pergunta–resposta em várias rodadas que se assemelham a um diálogo com um especialista. Em conjuntos de dados tanto familiares quanto totalmente novos, o PULSE superou modelos de IA de uso geral, incluindo sistemas comerciais amplamente usados, por 21–33 pontos percentuais em acurácia. Ele também superou ferramentas anteriores focadas em ECG que dependem de sinais brutos, especialmente em tarefas que exigem raciocínio aberto ou trabalho a partir apenas de imagens no estilo de impressão. Em exemplos comparativos, o PULSE tipicamente produziu relatórios mais próximos das interpretações de especialistas do que os de modelos gerais líderes.

O que isso pode significar para o atendimento cotidiano

O estudo sugere que uma IA open-source cuidadosamente treinada, como o PULSE, poderia se tornar um assistente versátil onde quer que imagens de ECG sejam usadas. Por funcionar diretamente em fotos, ele pode dar suporte a clínicas que só dispõem de cópias escaneadas ou fotografadas, e pode ir além de rótulos simples de sim/não para fornecer explicações mais ricas e raciocínio em várias etapas. Ao mesmo tempo, os autores enfatizam que o sistema ainda não substitui cardiologistas. Ele ainda fica aquém do desempenho de especialistas e precisa ser testado cuidadosamente em ambientes hospitalares reais, com atenção à segurança, vieses e supervisão adequada. Ainda assim, este trabalho representa um passo importante rumo a ferramentas de IA que podem ajudar clínicos a interpretar melhor as linhas onduladas que revelam a saúde do coração humano.

Citação: Liu, R., Bai, Y., Yue, X. et al. Teaching multimodal LLMs to comprehend 12-lead electrocardiographic images. npj Digit. Med. 9, 349 (2026). https://doi.org/10.1038/s41746-026-02551-3

Palavras-chave: eletrocardiograma, IA médica, modelos multimodais, diagnóstico cardíaco, apoio à decisão clínica