Clear Sky Science · es

Enseñar a los LLM multimodales a comprender imágenes electrocardiográficas de 12 derivaciones

Por qué importa enseñar a los ordenadores a leer trazados cardíacos

Todas las días, millones de personas registran la actividad de su corazón con un electrocardiograma, u ECG. Los médicos suelen ver esos registros como gráficos impresos o digitales llenos de líneas onduladas. En muchos lugares, especialmente en clínicas con recursos limitados, solo están disponibles esas imágenes: no hay señales digitales crudas ni software avanzado. Este estudio muestra cómo un nuevo tipo de inteligencia artificial (IA) puede aprender a “leer” imágenes de ECG directamente, ofreciendo ayuda más fiable a clínicos de todo el mundo.

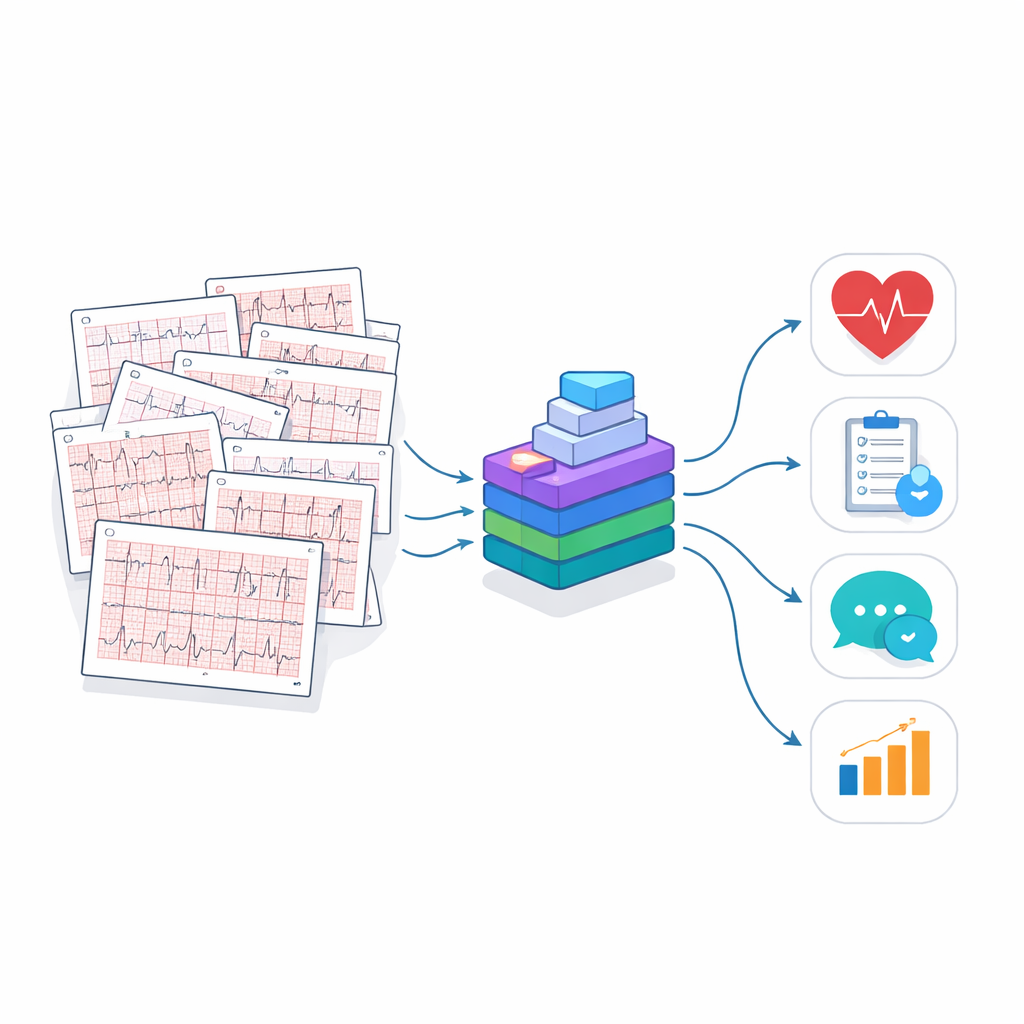

Construir una enorme biblioteca de imágenes cardíacas

Para enseñar a un sistema de IA a entender imágenes de ECG, los investigadores primero tuvieron que crear una gran biblioteca de entrenamiento realista. La mayoría de las bases de datos de ECG existentes almacenan señales eléctricas crudas en lugar de las imágenes tipo papel que usan los médicos. El equipo convirtió esas señales en imágenes fidedignas de ECG de 12 derivaciones, con cuadrículas y disposiciones estándar. También añadieron imperfecciones realistas—arrugas, rotaciones, líneas tenues, cambios de color e incluso simulaciones de fotos tomadas con cámara—para imitar lo que ocurre cuando los ECG se imprimen, escanean o fotografían en clínicas reales. Estas imágenes provenían de varios grandes grupos de pacientes en Europa, Norteamérica y Sudamérica, ayudando al sistema a aprender patrones que aparecen en distintas poblaciones y entornos hospitalarios.

Enseñar a una IA a comprender lo que ve

Mostrarle a la IA millones de imágenes de ECG no basta; también tiene que aprender a responder preguntas con sentido. El equipo creó ECGInstruct, una colección de más de un millón de pares imagen-texto. Cada par vincula una imagen de ECG con una tarea: detectar rasgos básicos del latido, reconocer ritmos anormales, identificar signos de enfermedad o redactar un breve informe de estilo clínico. Para escalar esto, los investigadores usaron un modelo de lenguaje potente para ayudar a redactar preguntas y respuestas, que luego filtraron y refinaron con comprobaciones automáticas y revisión experta. Esto dio a la IA no solo imágenes crudas, sino un conjunto rico de ejemplos de cómo los clínicos piensan y hablan sobre los ECG.

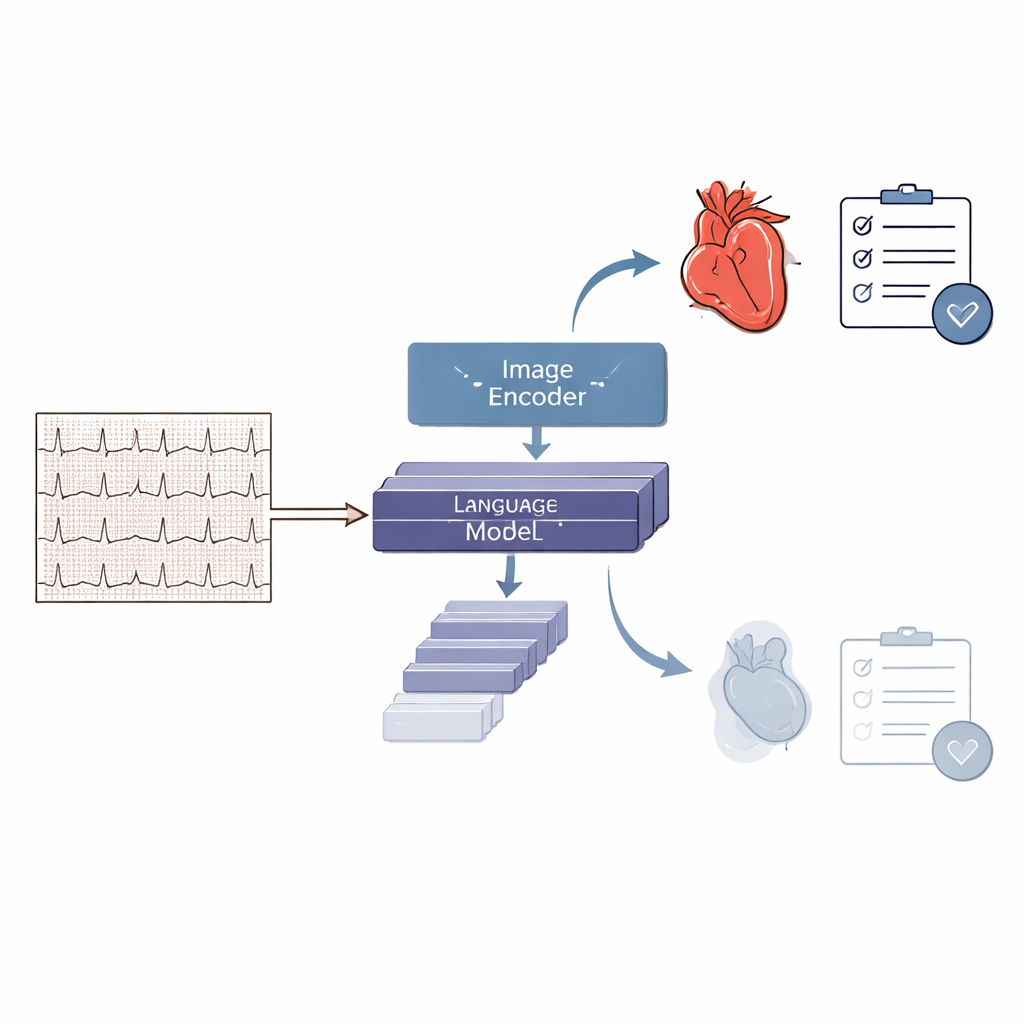

Presentamos PULSE, un modelo especializado en leer corazones

Usando este conjunto de datos amplio y cuidadosamente preparado, el equipo entrenó a PULSE, un modelo de IA multimodal capaz de mirar una imagen de ECG y generar interpretaciones en texto. PULSE combina un módulo de procesamiento de imágenes con un módulo de lenguaje para conectar patrones visuales con explicaciones y decisiones escritas. A diferencia de sistemas anteriores que estaban restringidos a unos pocos diagnósticos fijos o necesitaban señales numéricas limpias, PULSE está diseñado para manejar muchos tipos de preguntas, desde “¿Este ECG es normal o anormal?” hasta “Describa el ritmo y los hallazgos clave.” También puede participar en conversaciones multinivel sobre un mismo ECG, reflejando cómo un clínico podría razonar en un caso complejo.

Poner el sistema a prueba

Para evaluar el rendimiento de PULSE, los investigadores construyeron ECGBench, un extenso conjunto de pruebas para la comprensión de imágenes de ECG. ECGBench incluye tareas diagnósticas estándar, generación de informes, preguntas de opción múltiple sobre casos del mundo real y sesiones de preguntas y respuestas de varios turnos que simulan un diálogo con un especialista. Tanto en conjuntos de datos conocidos como en otros totalmente nuevos, PULSE superó a modelos de IA de propósito general, como sistemas comerciales ampliamente usados, por 21–33 puntos porcentuales en precisión. También venció a herramientas previas centradas en ECG que dependen de señales crudas, especialmente en tareas que requieren razonamiento abierto o trabajar solo con imágenes tipo impresión. En comparaciones directas, PULSE suele producir informes más cercanos a las interpretaciones de expertos que los generados por los principales modelos de IA general.

Qué podría significar esto para la atención cotidiana

El estudio sugiere que una IA de código abierto y bien entrenada como PULSE podría convertirse en un asistente versátil dondequiera que se usen imágenes de ECG. Al trabajar directamente sobre fotografías, puede dar soporte a clínicas que solo disponen de copias escaneadas o fotografiadas, y puede ir más allá de etiquetas de sí/no para ofrecer explicaciones más ricas y razonamiento en varios pasos. Al mismo tiempo, los autores subrayan que el sistema aún no reemplaza a los cardiólogos. Todavía no alcanza el nivel de expertos y debe probarse con cuidado en entornos hospitalarios reales, prestando atención a la seguridad, los sesgos y la supervisión adecuada. Aun así, este trabajo representa un paso importante hacia herramientas de IA que ayuden a los clínicos a interpretar mejor las líneas onduladas que revelan la salud del corazón humano.

Cita: Liu, R., Bai, Y., Yue, X. et al. Teaching multimodal LLMs to comprehend 12-lead electrocardiographic images. npj Digit. Med. 9, 349 (2026). https://doi.org/10.1038/s41746-026-02551-3

Palabras clave: electrocardiograma, IA médica, modelos multimodales, diagnóstico cardíaco, apoyo a la decisión clínica