Clear Sky Science · nl

Multimodale LLM's leren 12‑afleidings elektrocardiografische beelden te begrijpen

Waarom het belangrijk is computers hartfilmpjes te leren lezen

Elke dag worden bij miljoenen mensen de hartactiviteiten vastgelegd met een elektrocardiogram, of ECG. Artsen zien deze opnames meestal als afgedrukte of digitale grafieken vol kronkelende lijnen. Op veel plekken, vooral in klinieken met beperkte middelen, zijn alleen deze afbeeldingen beschikbaar — geen ruwe digitale signalen, geen geavanceerde software. Deze studie laat zien hoe een nieuw soort kunstmatige intelligentie (AI) rechtstreeks ECG‑afbeeldingen kan leren “lezen”, en daarmee betrouwbaardere hulp kan bieden aan zorgverleners wereldwijd.

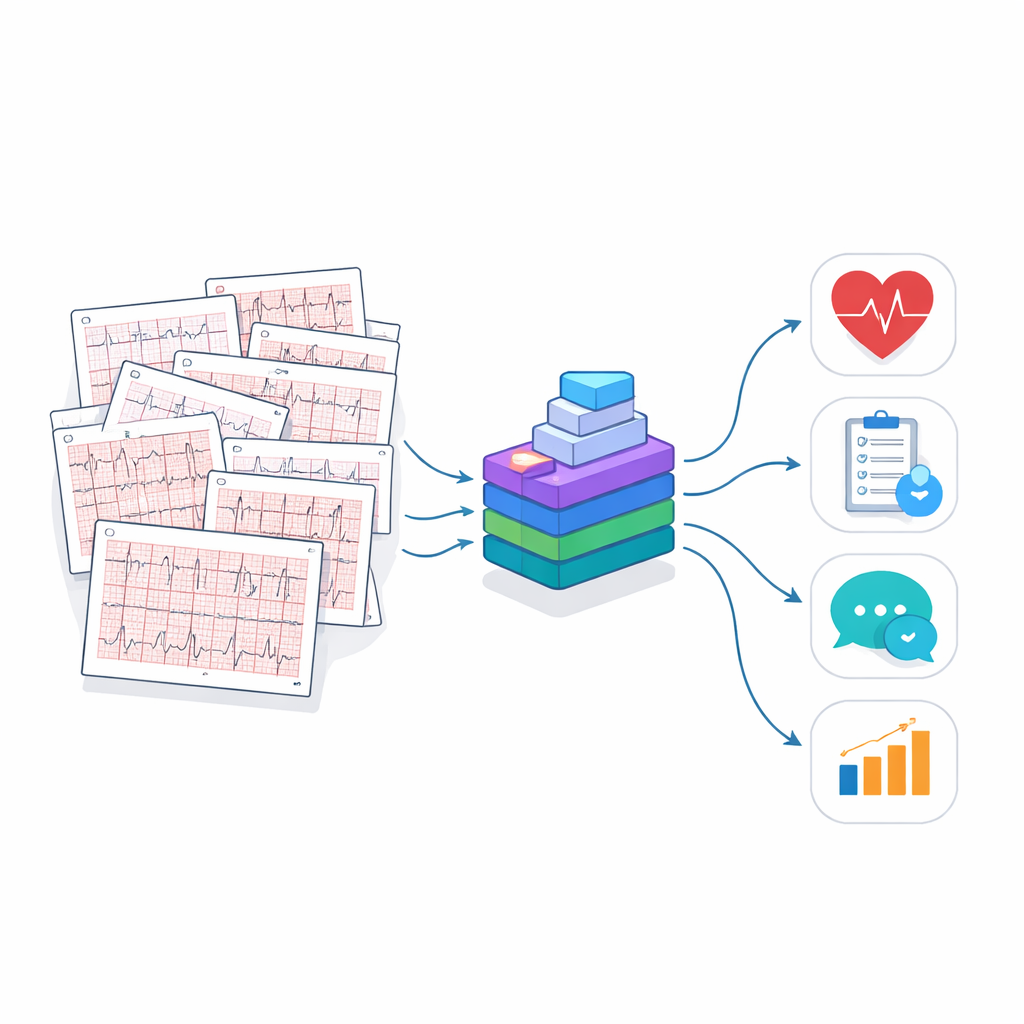

Het opbouwen van een enorme bibliotheek met hartplaatjes

Om een AI‑systeem te leren ECG‑afbeeldingen te begrijpen, moesten de onderzoekers eerst een grote, realistische trainingsbibliotheek samenstellen. De meeste bestaande ECG‑databases slaan ruwe elektrische signalen op in plaats van de vertrouwde papieren‑achtige afbeeldingen die artsen gebruiken. Het team zette deze signalen om in levensechte 12‑afleidings ECG‑afbeeldingen, compleet met rasterlijnen en standaardschikking. Ze voegden ook realistische imperfecties toe — kreukels, rotaties, vage lijnen, kleurverschillen en zelfs gesimuleerde camerafoto’s — om na te bootsen wat er gebeurt wanneer ECG’s worden afgedrukt, gescand of gefotografeerd in echte klinieken. Deze afbeeldingen kwamen uit meerdere grote patiëntengroepen in Europa, Noord‑ en Zuid‑Amerika, waardoor het systeem patronen kon leren die in verschillende bevolkingen en ziekenhuisomgevingen voorkomen.

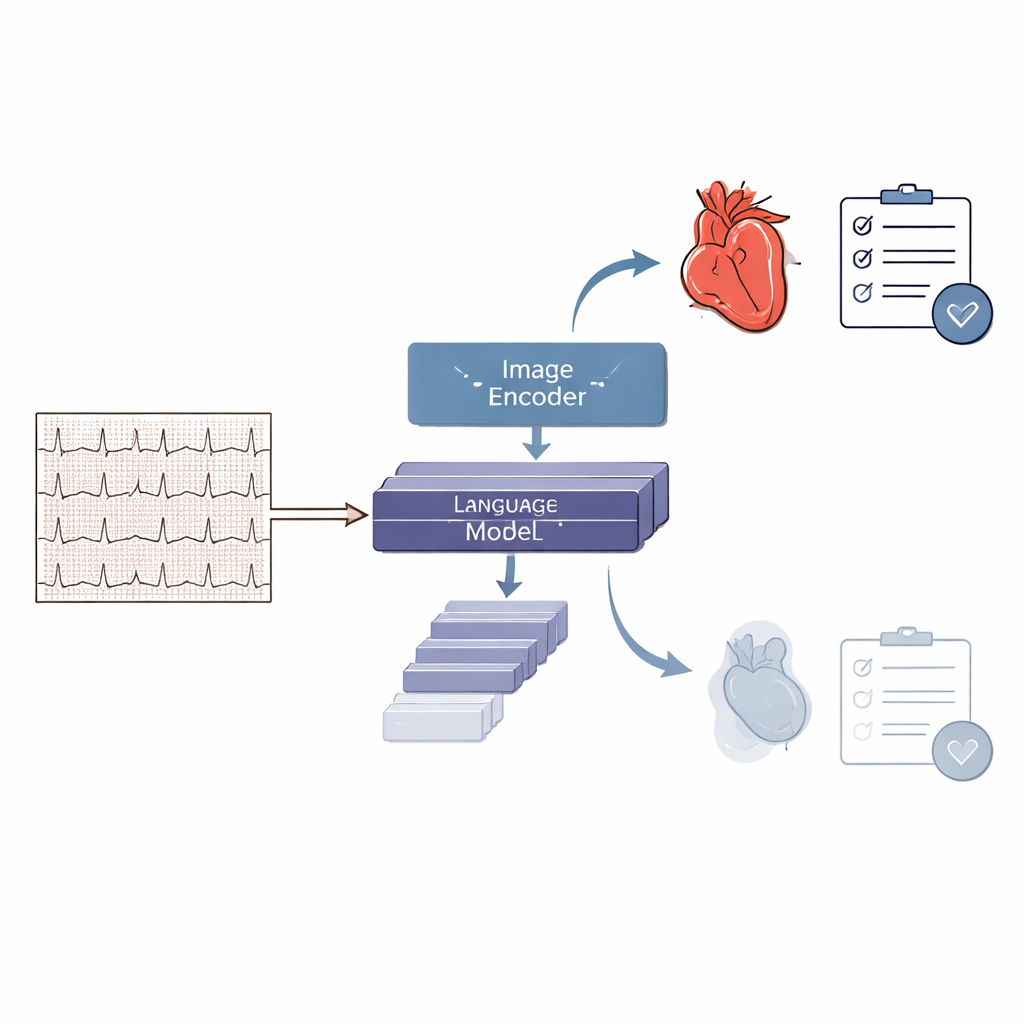

Een AI leren begrijpen wat het ziet

Alleen miljoenen ECG‑afbeeldingen aan de AI tonen is niet voldoende; het moet ook leren reageren op zinvolle vragen. Het team maakte ECGInstruct, een verzameling van meer dan een miljoen beeld‑en‑tekstparen. Elk paar koppelt een ECG‑afbeelding aan een taak: basiskenmerken van het hartritme herkennen, abnormale ritmes opsporen, ziekteverschijnselen identificeren of een korte klinische rapportage schrijven. Om dit op grote schaal te doen gebruikte de groep een krachtig taalmodel om vragen en antwoorden op te stellen, en filterde en verfijnde die vervolgens met automatische controles en deskundige toetsing. Daardoor kreeg de AI niet alleen ruwe afbeeldingen, maar ook een rijke set voorbeelden van hoe clinici denken en spreken over ECG’s.

Introductie van PULSE, een gespecialiseerd hartleesmodel

Met deze grote en zorgvuldig voorbereide dataset trainden de onderzoekers PULSE, een multimodaal AI‑model dat naar een ECG‑afbeelding kan kijken en tekstuele interpretaties kan produceren. PULSE combineert een beeldverwerkingsmodule met een taalmodule zodat het visuele patronen kan koppelen aan geschreven verklaringen en beslissingen. In tegenstelling tot eerdere systemen die beperkt waren tot een paar vaste diagnoses of schone numerieke signalen nodig hadden, is PULSE ontworpen om veel soorten vragen aan te kunnen, van “Is dit ECG normaal of abnormaal?” tot “Beschrijf het ritme en de belangrijkste bevindingen.” Het kan ook meervoudige stappen doorlopen in een gesprek over één ECG, vergelijkbaar met hoe een clinicus zich door een complex geval zou redeneren.

Het systeem op de proef stellen

Om te onderzoeken hoe goed PULSE presteert, bouwden de onderzoekers ECGBench, een brede testsuite voor begrip van ECG‑afbeeldingen. ECGBench bevat standaard diagnostische taken, rapportgeneratie, meerkeuzevragen over casussen uit de praktijk en meerlaags vraag‑en‑antwoordsessies die aanvoelen als een dialoog met een specialist. Zowel op bekende datasets als op volledig nieuwe gegevens presteerde PULSE beter dan algemene AI‑modellen, zoals veelgebruikte commerciële systemen, met 21–33 procentpunten hoger in nauwkeurigheid. Het versloeg ook eerdere ECG‑gerichte tools die afhankelijk zijn van ruwe signalen, vooral bij taken die open redeneren vereisen of werken vanaf print‑achtige afbeeldingen alleen. In zij‑aan‑zij voorbeelden produceerde PULSE doorgaans rapporten die dichter bij de interpretaties van experts lagen dan die van toonaangevende algemene AI‑modellen.

Wat dit kan betekenen voor de dagelijkse zorg

De studie suggereert dat een zorgvuldig getrainde, open‑source AI zoals PULSE een veelzijdige assistent kan worden op plekken waar ECG‑afbeeldingen worden gebruikt. Omdat het direct op foto’s werkt, kan het klinieken ondersteunen die alleen gescande of gefotografeerde afdrukken hebben, en het kan verder gaan dan eenvoudige ja‑of‑nee labels door rijkere verklaringen en meerstappig redeneren te bieden. Tegelijk benadrukken de auteurs dat het systeem nog geen vervanging is voor cardiologen. Het blijft achter bij expertprestaties en moet zorgvuldig worden getest in echte ziekenhuisomgevingen, met aandacht voor veiligheid, bias en juiste toezicht. Desondanks markeert dit werk een belangrijke stap richting AI‑hulpmiddelen die clinici kunnen helpen de kronkelende lijnen die de gezondheid van het menselijk hart onthullen beter te begrijpen.

Bronvermelding: Liu, R., Bai, Y., Yue, X. et al. Teaching multimodal LLMs to comprehend 12-lead electrocardiographic images. npj Digit. Med. 9, 349 (2026). https://doi.org/10.1038/s41746-026-02551-3

Trefwoorden: elektrocardiogram, medische AI, multimodale modellen, cardiale diagnostiek, klinische beslissingsondersteuning