Clear Sky Science · it

Insegnare ai LLM multimodali a comprendere immagini elettrocardiografiche a 12 derivazioni

Perché insegnare ai computer a leggere i tracciati cardiaci è importante

Ogni giorno milioni di persone si sottopongono alla registrazione dell’attività cardiaca tramite un elettrocardiogramma, o ECG. I medici di solito vedono queste registrazioni come grafici stampati o digitali pieni di linee ondulate. In molte realtà, soprattutto in ambito clinico con risorse limitate, sono disponibili solo queste immagini—non i segnali digitali grezzi, non software avanzati. Questo studio mostra come un nuovo tipo di intelligenza artificiale (IA) possa imparare a “leggere” direttamente le immagini degli ECG, offrendo un supporto più affidabile ai clinici in tutto il mondo.

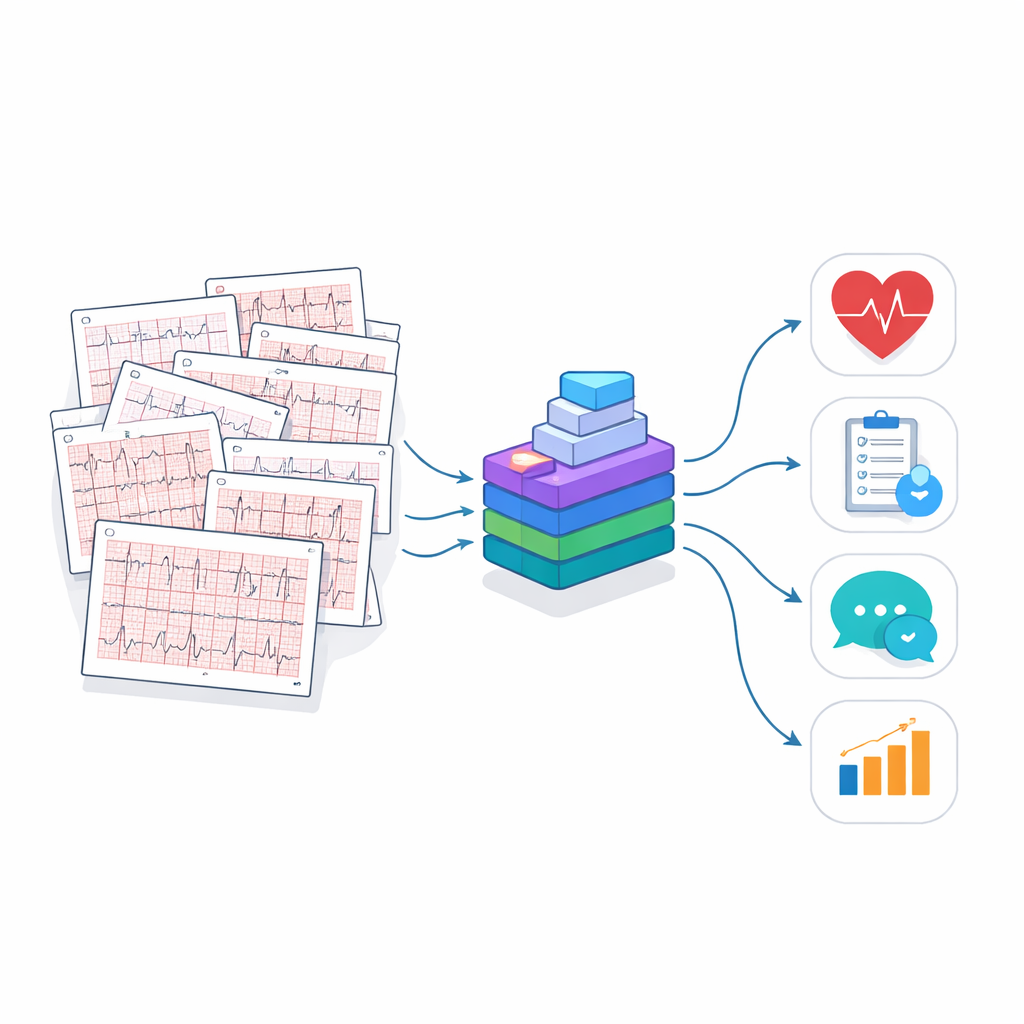

Costruire un’enorme libreria di immagini cardiache

Per insegnare a un sistema di IA a comprendere le immagini ECG, i ricercatori hanno prima dovuto creare un enorme archivio di addestramento realistico. La maggior parte dei database ECG esistenti conserva i segnali elettrici grezzi anziché le familiari immagini tipo foglio che i medici usano. Il team ha convertito questi segnali in immagini realistiche di ECG a 12 derivazioni, complete di griglie e impaginazioni standard. Hanno inoltre aggiunto imperfezioni realistiche—piega della carta, rotazioni, linee sfumate, variazioni di colore e persino fotografie simulate—per emulare ciò che accade quando gli ECG vengono stampati, scannerizzati o fotografati nelle cliniche reali. Queste immagini provenivano da diversi ampi gruppi di pazienti in Europa, Nord America e Sud America, aiutando il sistema a imparare pattern che compaiono in diverse popolazioni e strutture ospedaliere.

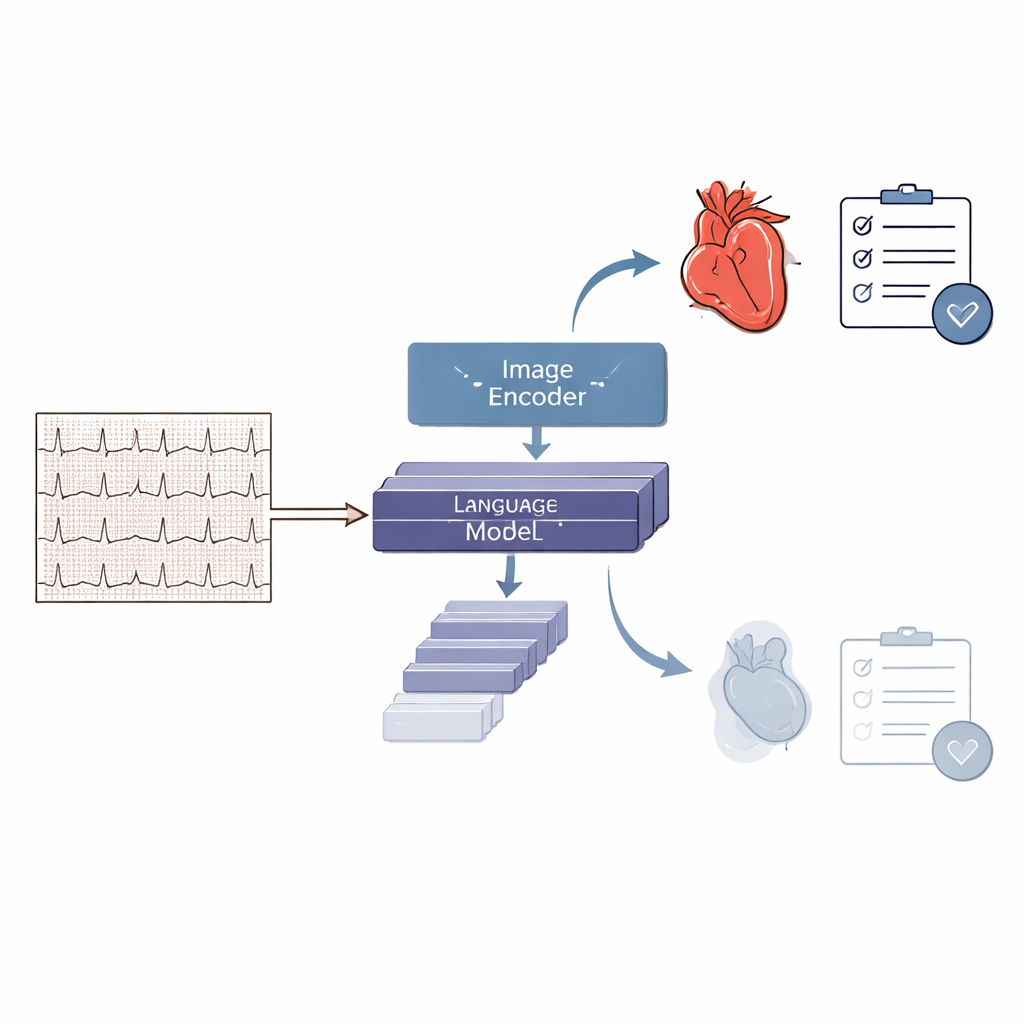

Insegnare a un’IA a comprendere ciò che vede

Mostrare all’IA milioni di immagini di ECG non è sufficiente; deve anche imparare a rispondere a domande significative. Il team ha creato ECGInstruct, una raccolta di oltre un milione di coppie immagine-testo. Ogni coppia collega un’immagine ECG a un compito: individuare caratteristiche di base del battito, riconoscere ritmi anomali, identificare segni di malattia o redigere un breve referto in stile clinico. Per scalare il progetto, i ricercatori hanno impiegato un potente modello di linguaggio per aiutare a redigere domande e risposte, poi le hanno filtrate e perfezionate con controlli automatici e revisione di esperti. Questo ha fornito all’IA non solo immagini grezze, ma un ricco insieme di esempi su come i clinici pensano e parlano degli ECG.

Presentazione di PULSE, un modello specializzato nella lettura cardiaca

Usando questo ampio e accuratamente preparato dataset, il team ha addestrato PULSE, un modello di IA multimodale capace di osservare un’immagine ECG e produrre interpretazioni testuali. PULSE combina un modulo di elaborazione delle immagini con un modulo linguistico in modo da collegare pattern visivi a spiegazioni scritte e decisioni. Diversamente dai sistemi precedenti, limitati a poche diagnosi fisse o che richiedevano segnali numerici puliti, PULSE è progettato per gestire molti tipi di domande, da “Questo ECG è normale o anormale?” a “Descrivi il ritmo e i principali reperti.” Può anche sostenere conversazioni in più passaggi su un singolo ECG, rispecchiando il modo in cui un clinico potrebbe ragionare su un caso complesso.

Mettere il sistema alla prova

Per valutare le prestazioni di PULSE, i ricercatori hanno costruito ECGBench, una vasta suite di test per la comprensione delle immagini ECG. ECGBench include compiti diagnostici standard, generazione di referti, domande a scelta multipla su casi reali e sessioni di domanda–risposta multi-turno che assomigliano a un dialogo con uno specialista. Sia su dataset noti sia su dataset completamente nuovi, PULSE ha superato modelli IA di uso generale, come i sistemi commerciali largamente diffusi, con un margine di accuratezza di 21–33 punti percentuali. Ha inoltre battuto strumenti precedenti focalizzati sugli ECG che si basano sui segnali grezzi, specialmente in compiti che richiedono ragionamento aperto o il lavoro esclusivo su immagini in stile stampa. In esempi fianco a fianco, PULSE ha tipicamente prodotto referti più vicini alle interpretazioni degli esperti rispetto ai principali modelli di IA generali.

Cosa potrebbe significare per la cura quotidiana

Lo studio suggerisce che un’IA open source attentamente addestrata come PULSE potrebbe diventare un assistente versatile ovunque si usino immagini ECG. Poiché lavora direttamente sulle fotografie o sulle scansioni, può supportare cliniche che dispongono solo di estratti stampati o fotografati, e può andare oltre etichette semplici sì/no fornendo spiegazioni più ricche e ragionamenti in più passaggi. Allo stesso tempo, gli autori sottolineano che il sistema non è ancora un sostituto dei cardiologi. È ancora lontano dalle prestazioni esperte e deve essere testato con attenzione in contesti ospedalieri reali, prestando attenzione alla sicurezza, ai bias e alla supervisione adeguata. Nonostante ciò, questo lavoro segna un passo importante verso strumenti di IA che possano aiutare i clinici a comprendere meglio le linee ondulate che rivelano la salute del cuore umano.

Citazione: Liu, R., Bai, Y., Yue, X. et al. Teaching multimodal LLMs to comprehend 12-lead electrocardiographic images. npj Digit. Med. 9, 349 (2026). https://doi.org/10.1038/s41746-026-02551-3

Parole chiave: elettrocardiogramma, IA medica, modelli multimodali, diagnosi cardiaca, supporto alle decisioni cliniche