Clear Sky Science · sv

Automatiserad segmentering av njurstenar i videor från flexibel ureteroskopi med en U‑Net‑modell: En preliminär genomförbarhetsstudie

Hjälper kirurger att se dolda njurstenar

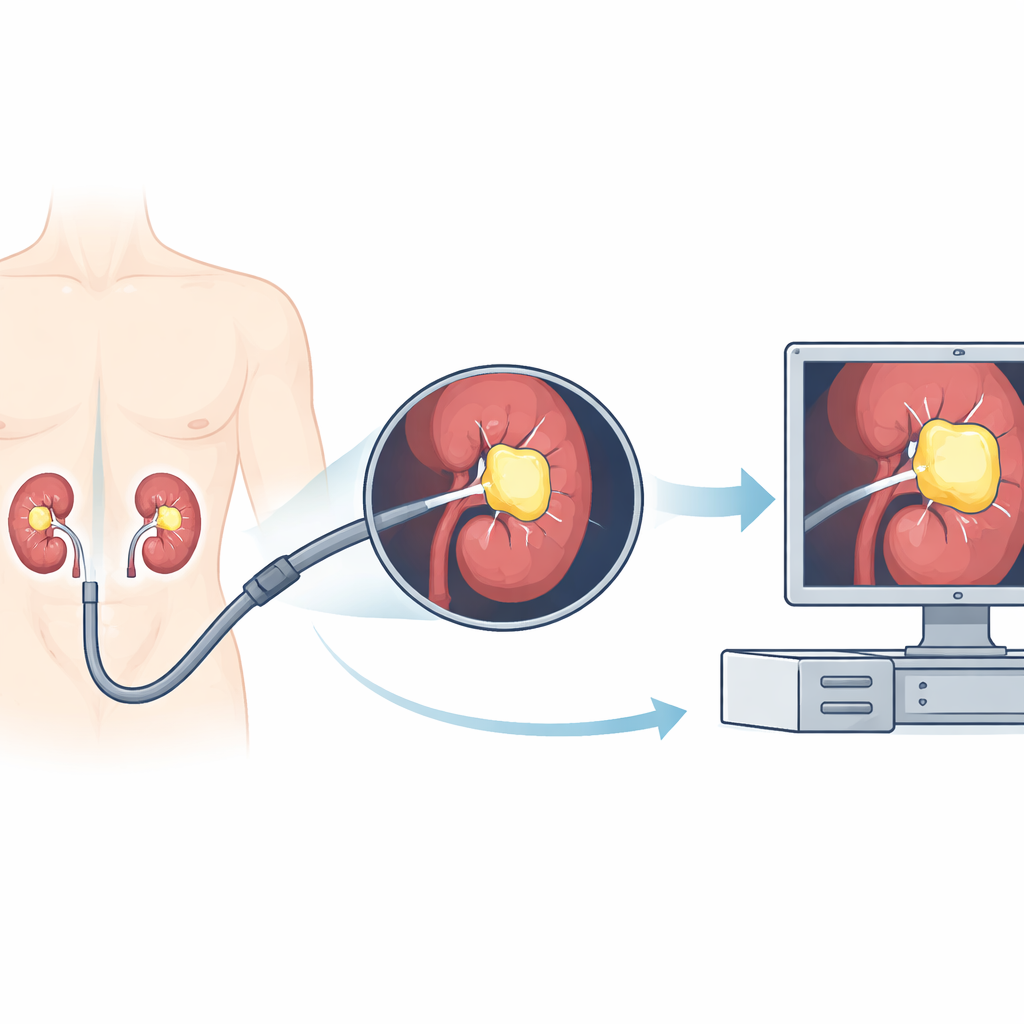

Njursten är smärtsamt och blir allt vanligare, och ett av huvudsätten att behandla dem är att föra in en liten kamera i njuren och krossa stenarna med en laser. Men inne i kroppen kan sikten vara rörig: blod, damm från sönderslagna stenar och rörelser från andning gör det svårt för kirurgerna att tydligt se vad de gör. Denna studie undersöker om artificiell intelligens (AI) kan fungera som en realtids‑markerare för njurstenar under operation, så att de framträder tydligare på skärmen och potentiellt gör behandlingen snabbare och säkrare.

Varför njursten är svåra att behandla

Njursten drabbar en stor andel vuxna globalt och kan orsaka svår smärta, infektioner och till och med njursvikt. Modern behandling använder ofta flexibel ureteroskopi, där läkare för en böjlig endoskop med kamera genom urinvägarna in i njuren. Väl där använder de en laser för att krossa stenarna till mindre fragment. Kamerabilden är dock långt ifrån perfekt. Plötsliga blödningar, virvlande damm från lasern, ljusförändringar och snabba rörelser kan sudda ut sikten. Kirurger måste ständigt avgöra var stenen slutar och kringliggande vävnad börjar. Om fragment missas kan patienten behöva nya ingrepp; om fältet bedöms felaktigt ökar risken för komplikationer.

Att lära en dator att hitta stenar

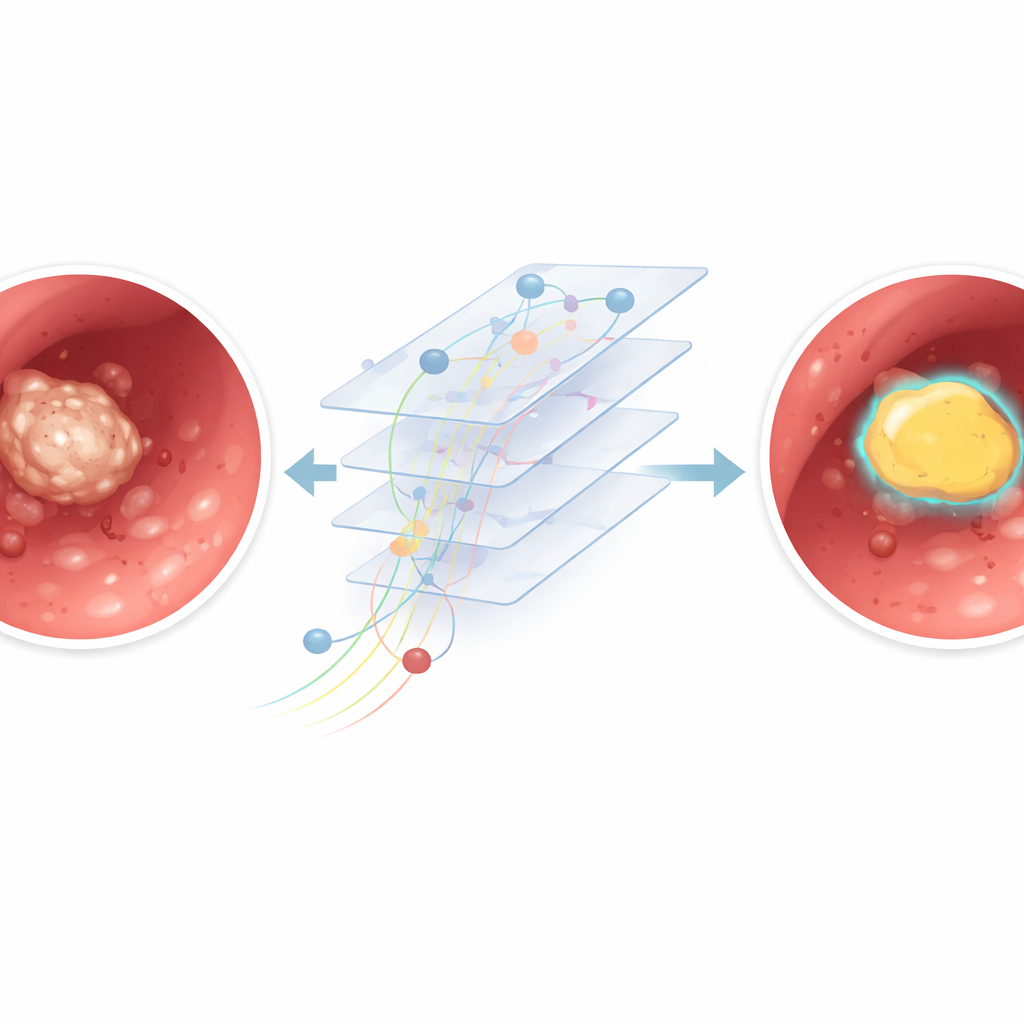

För att ta itu med denna utmaning tränade forskarna ett datorprogram att automatiskt omringa njurstenar i videoströmmen från endoskopet. De samlade in 12 fullständiga operationsinspelningar från olika patienter, totalt cirka 11 timmars verklighetsmaterial. Från dessa videor extraherade de tusentals enskilda bildrutor och byggde ett semi‑automatiskt system för att märka var stenarna fanns. Först ritade mänskliga granskare enkla rutor runt synliga stenar. Därefter genererade ett separat verktyg mer precisa former inom dessa rutor, och medicinska experter kontrollerade att de överensstämde med de verkliga stenområdena. Dessa parade bilder och konturer användes för att träna en djuplärande modell baserad på en U‑Net‑arkitektur, en välkänd nätverkstyp för bildsegmentering som kan färglägga exakt vilka pixlar som tillhör stenen.

Hur bra AI‑modellen presterade

Teamet delade noggrant upp sina data så att vissa operationer användes för att lära modellen, några för att finjustera den och några hölls helt åtskilda för att testa hur väl den fungerade på nya, osedda ingrepp. På dessa hållna videor klassificerade AI:n korrekt de flesta pixlar i varje bildruta och visade en stark överlappning mellan sina stenmasker och experternas markeringar. Enkelt uttryckt: när stenen var tydligt synlig och kamerabilden skarp ritade systemet en snäv, noggrann gräns runt den. Modellen var också snabb: på ett standardgrafikkort bearbetade den omkring 30 bildrutor per sekund, i nivå med hastigheten hos en livevideoström, vilket tyder på att realtidsanvändning i operationssalen är tekniskt möjlig.

När sikten blir rörig

Prestandan sjönk när videon såg mer ut som ett snöoväder än en klar bild. I bildrutor med kraftig blödning, täta dammoln från lasern eller stark rörelseoskärpa förväxlade modellen ibland ljusa partiklar med faktisk sten eller missade delar av stenen helt. En närmare analys jämförde "klara" rutor med minimal störning med "suddiga" rutor fyllda av artefakter. AI:n klarade sig märkbart bättre i den klara gruppen, vilket bekräftar att dålig sikt gör precis avgränsning svårare även för en tränad algoritm. Eftersom modellen analyserar varje ruta separat kan den ännu inte använda rörelse över tid för att skilja en stabil sten från flyktigt damm eller blodstrimmor.

Vad detta kan betyda för framtida operationer

Detta arbete är ett tidigt steg snarare än ett färdigt sjukhusverktyg. Studien använde ett begränsat antal videor från ett enda center, med en snäv uppsättning kameratyper, och annoteringsprocessen kan fortfarande innehålla mänskliga och algoritmiska brister. Systemet har ännu inte integrerats i ett fullständigt kirurgiskt arbetsflöde där tillförlitlighet, säkerhetskontroller och hårdvarubegränsningar är avgörande. Trots det visar resultaten att en AI‑modell kan lära sig att hitta och avgränsa njurstenar direkt från verkliga operationsvideor och hålla jämna steg med livehastigheter. Med större och mer mångsidiga dataset, smartare utnyttjande av information över på varandra följande bildrutor och noggranna tester i verkliga operationssalar skulle liknande system så småningom kunna assistera kirurger genom att göra dolda stenar tydligare, minska antalet missade fragment och förbättra patientvården.

Citering: El Hajj, A., Bou Mrad, A., Malik, E. et al. Automated kidney stone segmentation from flexible ureteroscopy videos using a U-net model: A preliminary feasibility study. Sci Rep 16, 14542 (2026). https://doi.org/10.1038/s41598-026-45143-7

Nyckelord: njurstenar, kirurgisk AI, endoskopivideo, medicinsk bildbehandling, djuplärande