Clear Sky Science · fr

Segmentation automatisée des calculs rénaux à partir de vidéos d’urétéroscopie flexibles utilisant un modèle U‑net : étude préliminaire de faisabilité

Aider les chirurgiens à repérer les calculs rénaux cachés

Les calculs rénaux sont une source de douleur et un problème de plus en plus fréquent. L’une des principales méthodes de traitement consiste à introduire une toute petite caméra dans le rein et à fragmenter les calculs au laser. Mais à l’intérieur du corps, la vue peut être brouillée : sang, poussière provenant des fragments et mouvements dus à la respiration rendent difficile la vision claire pour le chirurgien. Cette étude examine si l’intelligence artificielle (IA) peut jouer le rôle d’un surligneur en temps réel pour les calculs rénaux pendant l’intervention, les faisant ressortir davantage à l’écran et potentiellement rendant le traitement plus rapide et plus sûr.

Pourquoi les calculs rénaux sont difficiles à traiter

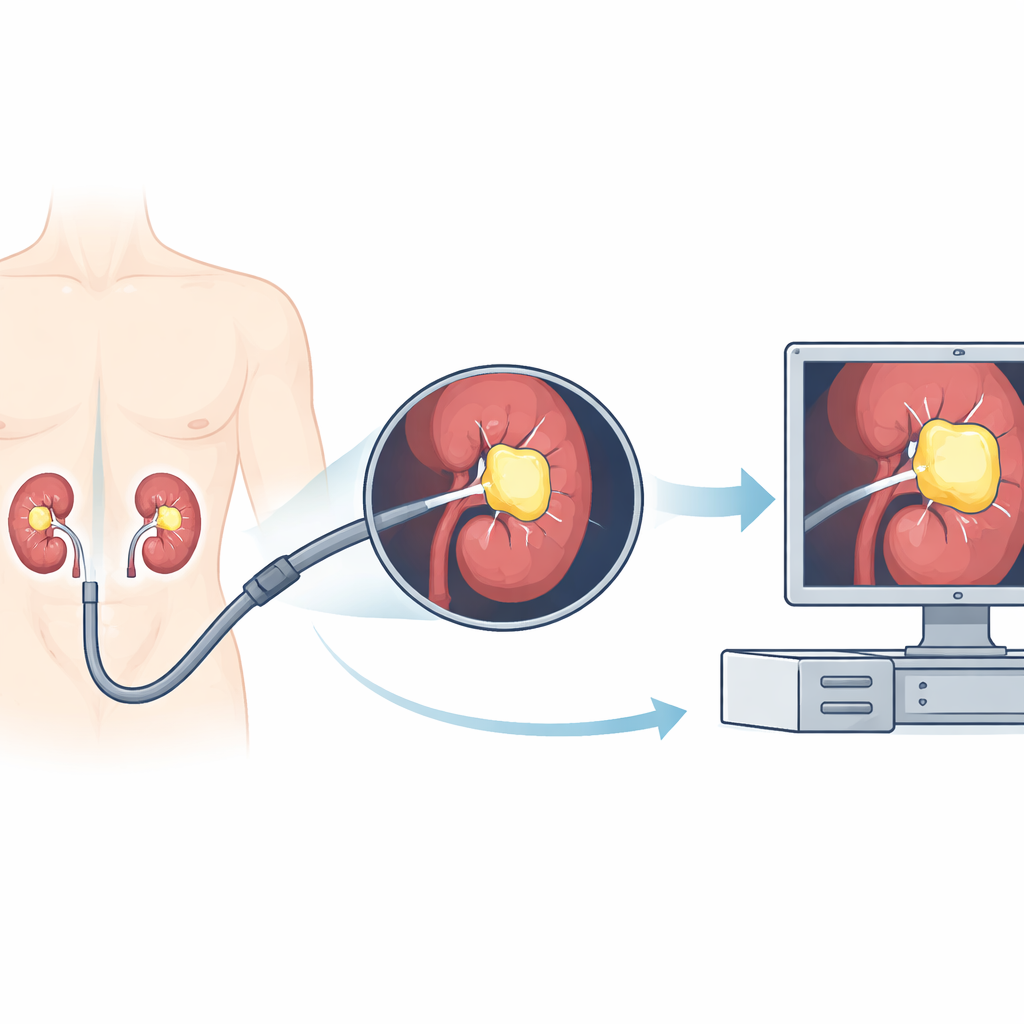

Les calculs rénaux touchent une large part de la population adulte dans le monde et peuvent provoquer des douleurs intenses, des infections et même une insuffisance rénale. Le traitement moderne utilise souvent l’urétéroscopie flexible, où le médecin guide un endoscope flexible muni d’une caméra par les voies urinaires jusqu’au rein. Une fois sur place, il utilise un laser pour fragmenter les calculs. Cependant, l’image de la caméra est loin d’être parfaite. Les saignements soudains, les nuages de poussière générés par le laser, les variations d’éclairage et les mouvements rapides peuvent tout brouiller. Les chirurgiens doivent constamment décider où s’arrête le calcul et où commence le tissu environnant. S’ils laissent des fragments, le patient peut nécessiter une nouvelle intervention ; s’ils estiment mal le champ opératoire, le risque de complications augmente.

Apprendre à un ordinateur à repérer les calculs

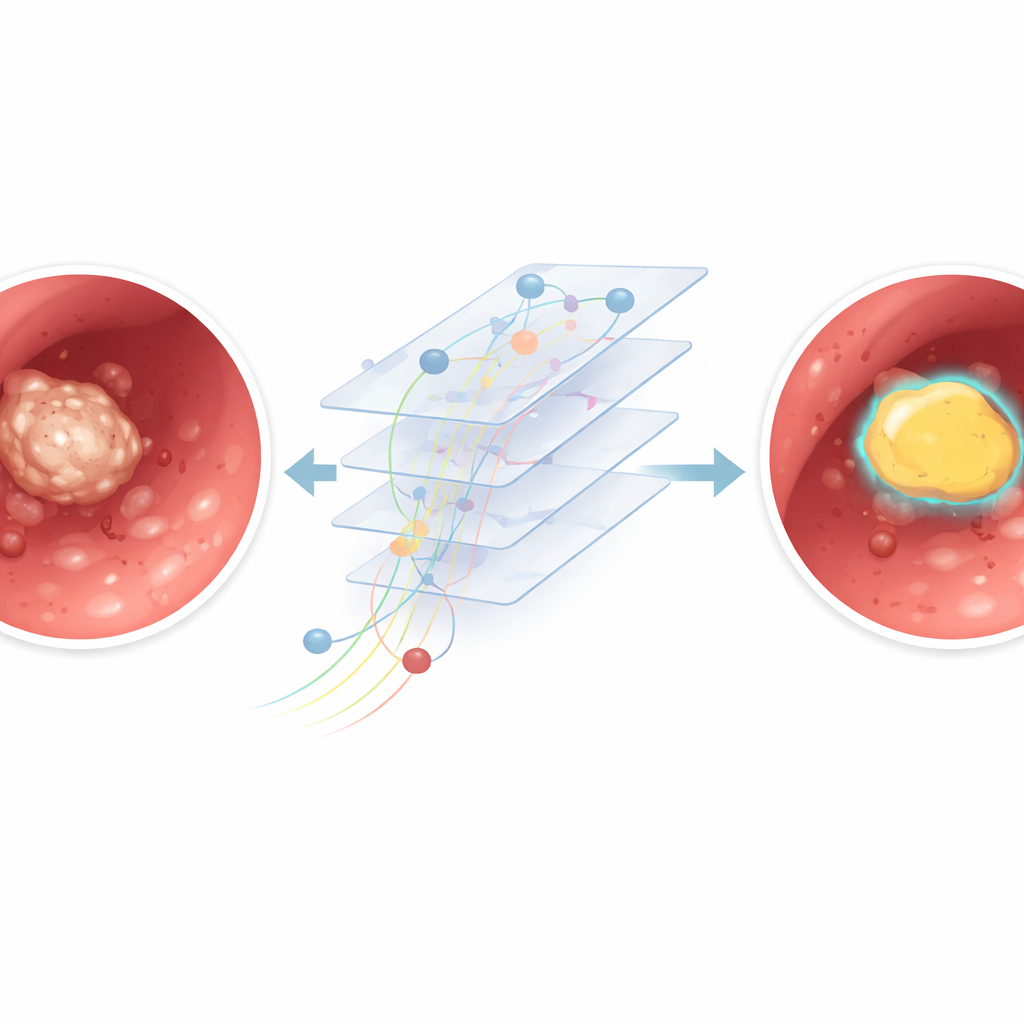

Pour relever ce défi, les chercheurs ont entraîné un programme à délimiter automatiquement les calculs rénaux dans le flux vidéo de l’endoscope. Ils ont collecté 12 enregistrements chirurgicaux complets provenant de différents patients, totalisant environ 11 heures de séquences réelles. À partir de ces vidéos, ils ont extrait des milliers d’images individuelles et mis en place un système semi‑automatique pour annoter les zones de calcul. D’abord, des relecteurs humains ont tracé des encadrés simples autour des calculs visibles. Ensuite, un outil distinct a généré des formes plus précises à l’intérieur de ces cadres, et des experts médicaux ont vérifié que ces contours correspondaient aux véritables zones de calcul. Ces images appariées et leurs contours ont servi à entraîner un modèle d’apprentissage profond basé sur une architecture U‑Net, un type de réseau couramment utilisé pour la segmentation d’images qui permet d’indiquer précisément quels pixels appartiennent au calcul.

Performances du modèle d’IA

L’équipe a soigneusement réparti ses données de sorte que certaines interventions servent à entraîner le modèle, d’autres à l’ajuster, et d’autres encore soient conservées complètement séparées pour tester sa capacité à fonctionner sur des opérations nouvelles et inédites. Sur ces vidéos de test, l’IA a correctement classé la majorité des pixels de chaque image et a montré un fort recouvrement entre ses contours de calcul et les annotations d’experts. En termes simples, lorsque le calcul était clairement visible et que l’image de la caméra était nette, le système traçait une limite serrée et précise autour de celui‑ci. Le modèle était également rapide : sur une carte graphique standard, il a traité environ 30 images par seconde, proche de la vitesse d’un flux vidéo en direct, ce qui suggère que l’utilisation en temps réel au bloc opératoire est techniquement envisageable.

Quand la vue devient chaotique

Les performances ont chuté lorsque la vidéo ressemblait davantage à une tempête de neige qu’à une image claire. Dans les images présentant des saignements abondants, de denses nuages de poussière issus du laser ou un flou de mouvement prononcé, le modèle a parfois confondu des débris brillants avec le calcul réel ou a manqué des parties du calcul. Une analyse plus fine a comparé les images « claires », avec un encombrement minimal, aux images « floues » remplies d’artéfacts. L’IA a nettement mieux performé dans le groupe clair, confirmant que la mauvaise visibilité rend le contour précis plus difficile même pour un algorithme entraîné. Comme le modèle analyse chaque image indépendamment, il ne peut pas encore exploiter le mouvement dans le temps pour distinguer un calcul stable de poussières ou de traînées de sang fugitives.

Ce que cela pourrait signifier pour les interventions futures

Ce travail constitue une étape préliminaire plutôt qu’un outil prêt à être déployé à l’hôpital. L’étude s’appuie sur un nombre modeste de vidéos provenant d’un seul centre, avec un éventail limité de types de caméras, et le processus d’annotation peut encore contenir des imprécisions humaines et algorithmiques. Le système n’a pas encore été intégré dans un flux opératoire complet, où la fiabilité, les vérifications de sécurité et les contraintes matérielles sont essentielles. Néanmoins, les résultats montrent qu’un modèle d’IA peut apprendre à détecter et délimiter des calculs rénaux directement à partir de vidéos chirurgicales réelles et suivre le rythme d’un flux en direct. Avec des jeux de données plus larges et diversifiés, une exploitation plus intelligente des informations entre images consécutives et des tests rigoureux en salle d’opération, des systèmes similaires pourraient un jour aider les chirurgiens en faisant mieux ressortir les calculs cachés, réduisant les fragments manqués et améliorant la prise en charge des patients.

Citation: El Hajj, A., Bou Mrad, A., Malik, E. et al. Automated kidney stone segmentation from flexible ureteroscopy videos using a U-net model: A preliminary feasibility study. Sci Rep 16, 14542 (2026). https://doi.org/10.1038/s41598-026-45143-7

Mots-clés: calculs rénaux, IA chirurgicale, vidéo endoscopique, imagerie médicale, apprentissage profond