Clear Sky Science · de

Automatisierte Segmentierung von Nierensteinen in Videos der flexiblen Ureteroskopie mit einem U‑Net‑Modell: Eine vorläufige Machbarkeitsstudie

Chirurgen helfen, verborgene Nierensteine zu sehen

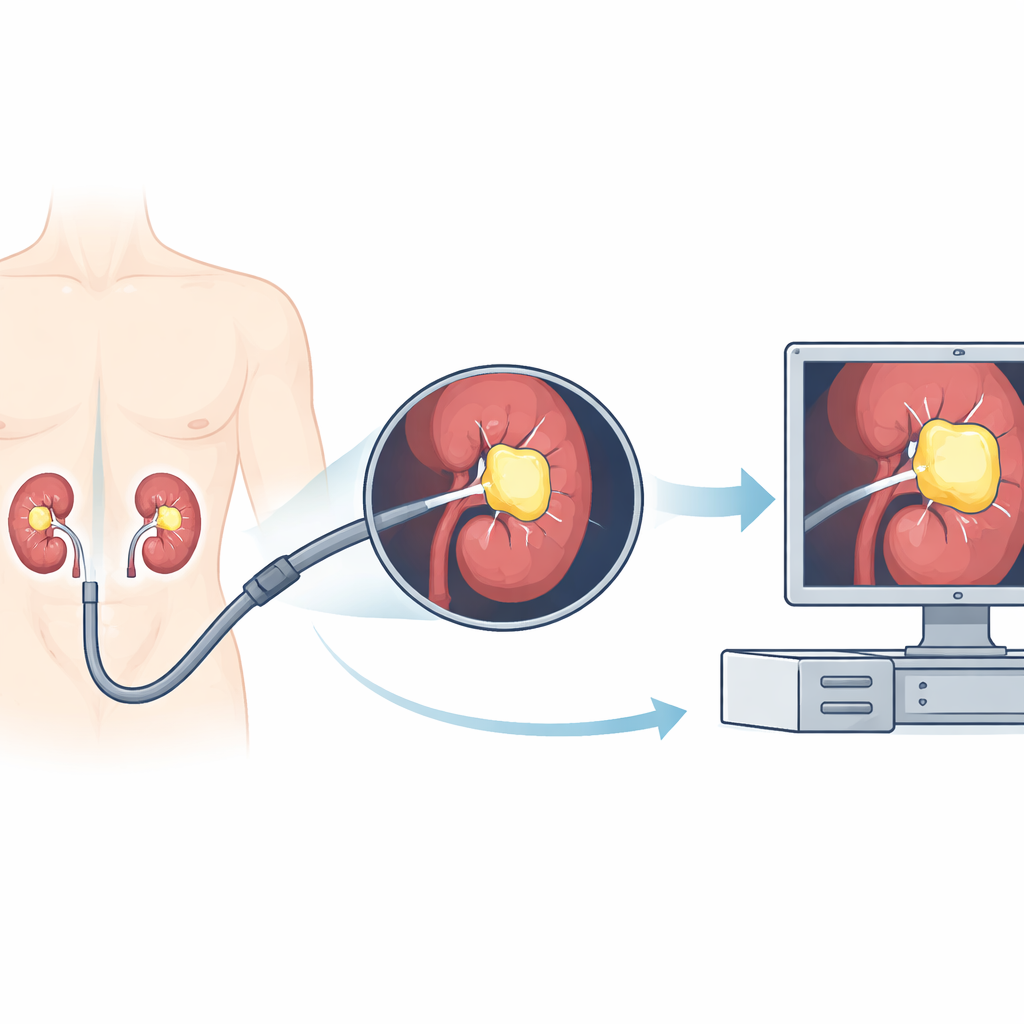

Nierensteine sind schmerzhaft und zunehmend verbreitet. Eine der Hauptbehandlungsformen besteht darin, eine winzige Kamera in die Niere zu führen und die Steine mit einem Laser zu zertrümmern. Innerhalb des Körpers ist das Sichtfeld jedoch oft unübersichtlich: Blut, Staub von zertrümmerten Steinen und Bewegungen durch die Atmung erschweren es den Chirurgen, klar zu erkennen, was sie tun. Diese Studie untersucht, ob künstliche Intelligenz (KI) während der Operation wie ein Echtzeit‑Marker für Nierensteine wirken kann, sodass diese auf dem Bildschirm deutlicher hervortreten und die Behandlung möglicherweise schneller und sicherer wird.

Warum Nierensteine schwer zu behandeln sind

Nierensteine betreffen weltweit einen großen Teil der erwachsenen Bevölkerung und können starke Schmerzen, Infektionen und sogar Nierenversagen verursachen. Die moderne Behandlung nutzt häufig die flexible Ureteroskopie, bei der Ärztinnen und Ärzte einen biegsamen Endoskop mit Kamera durch die Harnwege in die Niere führen. Dort zertrümmern sie die Steine mit einem Laser in kleinere Stücke. Das Kamerabild ist jedoch alles andere als perfekt. Plötzliche Blutungen, wirbelnder Staub durch den Laser, Lichtwechsel und schnelle Bewegungen können die Sicht verwischen. Chirurgen müssen ständig entscheiden, wo der Stein endet und das umgebende Gewebe beginnt. Werden Fragmente übersehen, sind Folgeeingriffe möglich; wird das Feld falsch eingeschätzt, steigt das Komplikationsrisiko.

Einem Computer beibringen, Steine zu erkennen

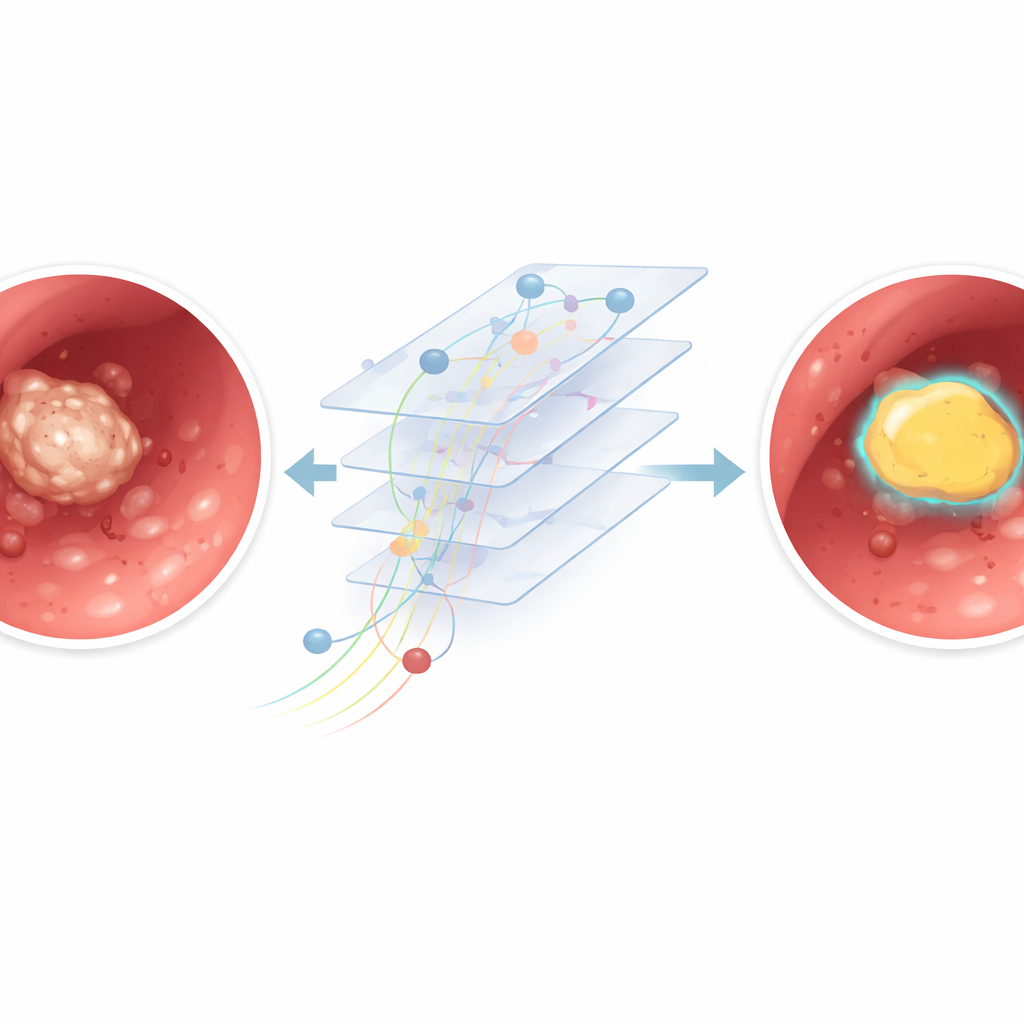

Um diese Herausforderung anzugehen, trainierten die Forschenden ein Computerprogramm, das Nierensteine im Videostream des Endoskops automatisch umreißt. Sie sammelten 12 komplette Operationsaufzeichnungen von verschiedenen Patientinnen und Patienten mit insgesamt etwa 11 Stunden Real‑Welt‑Material. Aus diesen Videos extrahierten sie tausende Einzelbilder und bauten ein halbautomatisches System zum Markieren der Steinbereiche auf. Zuerst zeichneten menschliche Gutachter einfache Kästen um sichtbare Steine. Anschließend generierte ein separates Werkzeug innerhalb dieser Kästen präzisere Formen, die von medizinischen Expertinnen und Experten überprüft wurden, ob sie den tatsächlichen Steinbereichen entsprachen. Diese gepaarten Bilder und Konturen dienten zum Training eines Deep‑Learning‑Modells auf Basis einer U‑Net‑Architektur, einem beliebten Netzwerktyp für Bildsegmentierung, der genau pixelweise angibt, welche Bereiche zum Stein gehören.

Wie gut das KI‑Modell abschnitt

Das Team teilte die Daten sorgfältig auf: Einige Operationen dienten dem Training des Modells, andere der Feineinstellung, und wieder andere blieben vollständig getrennt, um zu testen, wie gut das Modell bei neuen, ungesehenen Eingriffen arbeitet. In diesen zurückgehaltenen Videos klassifizierte die KI die meisten Pixel in jedem Bild korrekt und zeigte eine starke Überlappung zwischen ihren Steinumrissen und den Expertenmarkierungen. Einfach gesagt: Wenn der Stein klar sichtbar war und das Kamerabild scharf, zog das System eine enge, akkurate Begrenzung darum. Das Modell war zudem schnell: Auf einer Standard‑Grafikkarte verarbeitete es etwa 30 Bilder pro Sekunde, ähnlich der Geschwindigkeit eines Live‑Videostreams, was darauf hindeutet, dass ein Echtzeit‑Einsatz im OP technisch machbar ist.

Wenn die Sicht unübersichtlich wird

Die Leistung nahm ab, wenn das Video eher wie ein Schneesturm als wie ein klares Bild aussah. In Frames mit starken Blutungen, dichten Staubwolken durch den Laser oder ausgeprägtem Bewegungsunschärfe verwechselte das Modell manchmal helle Partikel mit echtem Stein oder übersah Teile des Steins ganz. Eine genauere Analyse verglich „klare“ Bilder mit minimalen Störeinflüssen mit „verschwommenen“ Bildern voller Artefakte. Die KI schnitt in der klaren Gruppe deutlich besser ab, was bestätigt, dass schlechte Sicht selbst für ein trainiertes Algorithmus präzises Umreißen erschwert. Da das Modell jeden Frame einzeln analysiert, kann es bislang nicht die Bewegung über die Zeit nutzen, um einen stabilen Stein von flüchtigem Staub oder Blutstreifen zu unterscheiden.

Was das für zukünftige Operationen bedeuten könnte

Diese Arbeit ist ein früher Schritt und kein sofort einsatzbereites Krankenhauswerkzeug. Die Studie verwendete eine bescheidene Anzahl von Videos aus einem einzigen Zentrum, mit einer begrenzten Auswahl an Kameratypen, und der Annotierungsprozess kann noch menschliche und algorithmische Unvollkommenheiten enthalten. Das System wurde noch nicht in einen vollständigen chirurgischen Ablauf integriert, in dem Zuverlässigkeit, Sicherheitsprüfungen und Hardware‑Grenzen eine große Rolle spielen. Dennoch zeigen die Ergebnisse, dass ein KI‑Modell lernen kann, Nierensteine direkt aus realen Operationsvideos zu finden und zu umreißen und mit Live‑Geschwindigkeiten Schritt zu halten. Mit größeren und vielfältigeren Datensätzen, einer intelligenteren Nutzung von Informationen über aufeinanderfolgende Frames und sorgfältigen Tests in realen OP‑Umgebungen könnten ähnliche Systeme Chirurgen schließlich unterstützen, indem sie verborgene Steine besser hervorheben, verfehlte Fragmente reduzieren und die Patientenversorgung verbessern.

Zitation: El Hajj, A., Bou Mrad, A., Malik, E. et al. Automated kidney stone segmentation from flexible ureteroscopy videos using a U-net model: A preliminary feasibility study. Sci Rep 16, 14542 (2026). https://doi.org/10.1038/s41598-026-45143-7

Schlüsselwörter: Nierensteine, chirurgische KI, Endoskopie‑Video, medizinische Bildgebung, Deep Learning