Clear Sky Science · it

Segmentazione automatica dei calcoli renali da video di ureteroscopia flessibile usando un modello U‑net: uno studio preliminare di fattibilità

Aiutare i chirurghi a vedere i calcoli renali nascosti

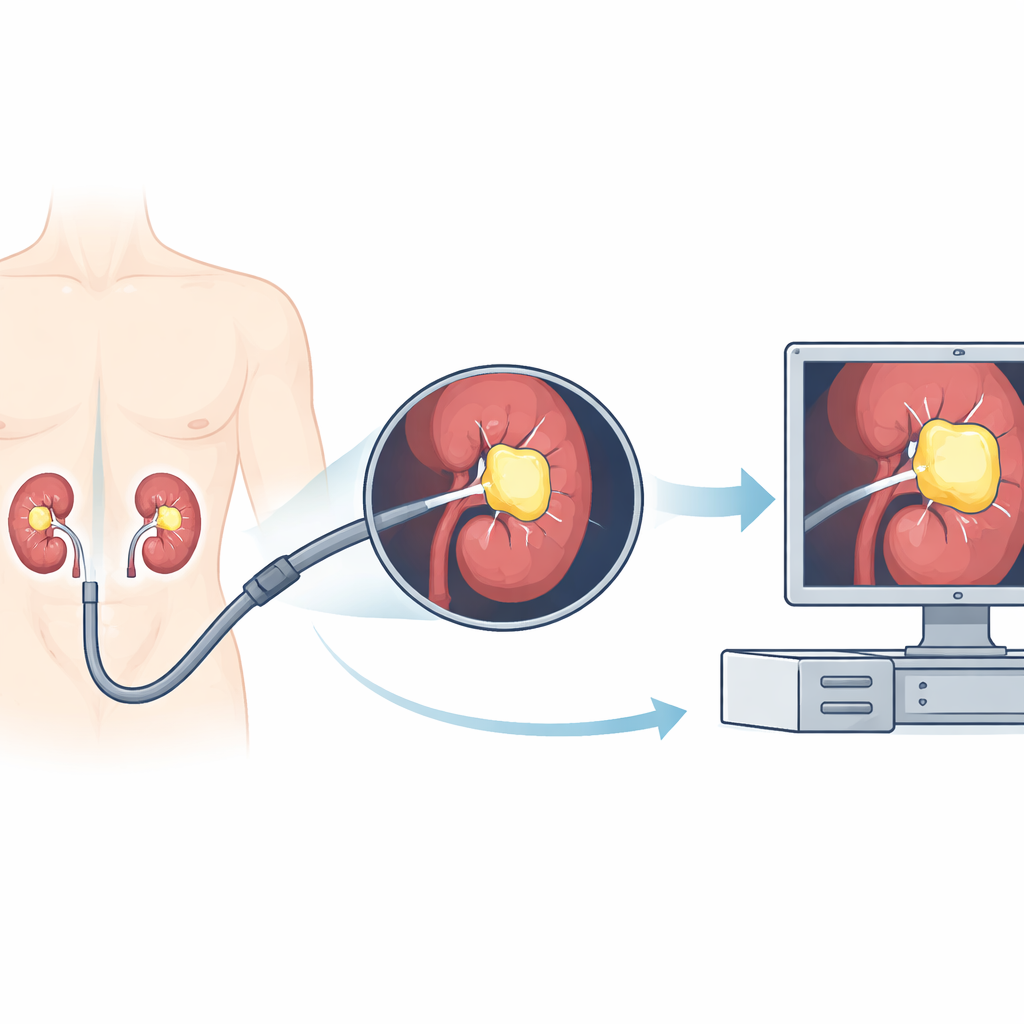

I calcoli renali sono un problema doloroso e sempre più diffuso; una delle principali terapie consiste nell’introdurre una micro‑telecamera nel rene e frammentare i calcoli con un laser. Ma all’interno del corpo la visuale può essere confusa: sangue, polvere derivata dalla frammentazione e il movimento dovuto alla respirazione rendono difficile per il chirurgo vedere chiaramente. Questo studio esplora se l’intelligenza artificiale (IA) possa funzionare come un evidenziatore in tempo reale per i calcoli durante l’intervento, facendoli risaltare sullo schermo e potenzialmente rendendo il trattamento più rapido e sicuro.

Perché i calcoli renali sono difficili da trattare

I calcoli renali colpiscono una larga fetta di adulti nel mondo e possono provocare dolori intensi, infezioni e persino insufficienza renale. Il trattamento moderno spesso impiega l’ureteroscopia flessibile, in cui i medici guidano uno strumento pieghevole con una telecamera lungo le vie urinarie fino al rene. Una volta raggiunto il calice renale, si utilizza un laser per frammentare i calcoli in pezzi più piccoli. Tuttavia, l’immagine dalla telecamera è tutt’altro che perfetta. Sanguinamento improvviso, nuvole di polvere generate dal laser, variazioni di illuminazione e movimenti rapidi possono offuscare la vista. I chirurghi devono decidere continuamente dove finisce il calcolo e dove comincia il tessuto circostante. Se vengono trascurati frammenti, il paziente potrebbe necessitare di interventi ripetuti; se il campo viene valutato male, aumenta il rischio di complicazioni.

Insegnare a un computer a riconoscere i calcoli

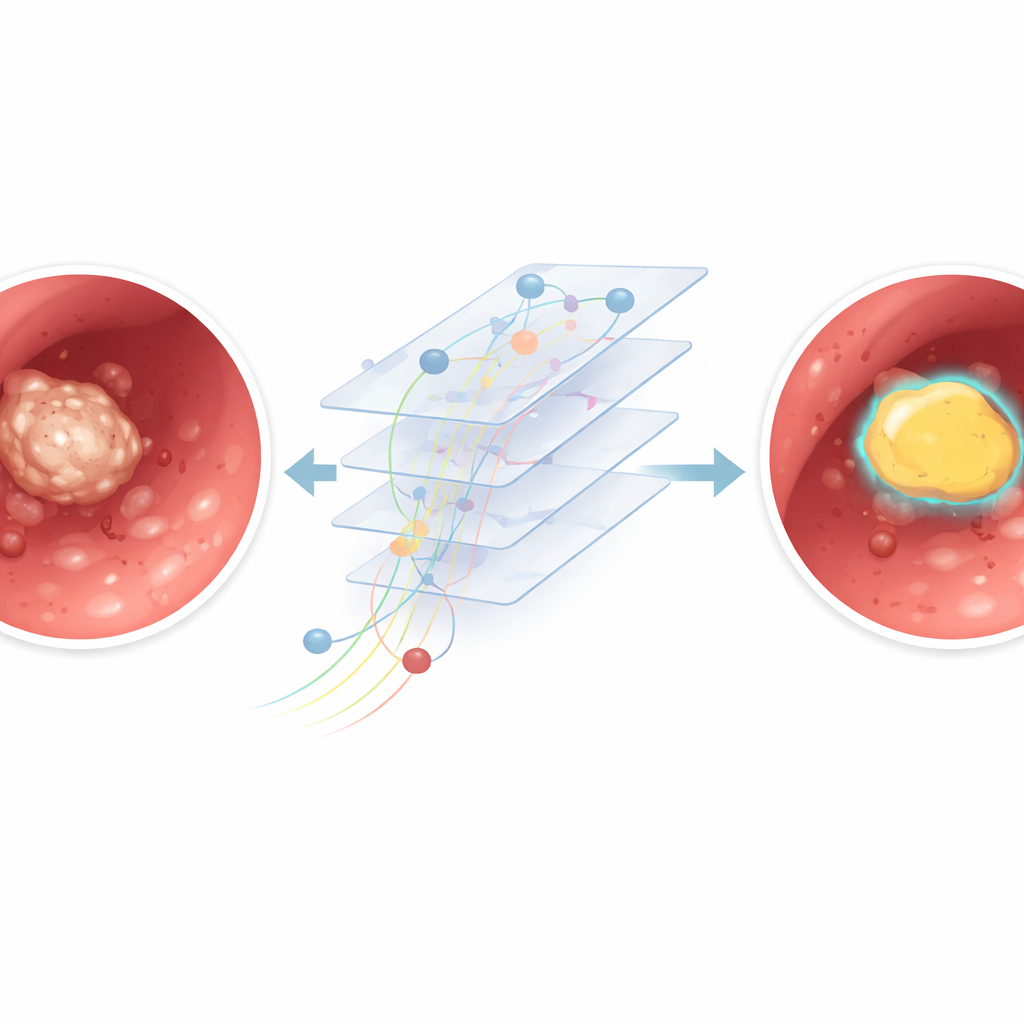

Per affrontare questa sfida, i ricercatori hanno addestrato un programma a tracciare automaticamente i contorni dei calcoli nel flusso video dell’endoscopio. Hanno raccolto 12 registrazioni chirurgiche complete di diversi pazienti, per un totale di circa 11 ore di filmati reali. Dai video hanno estratto migliaia di singoli fotogrammi e costruito un sistema semi‑automatico per annotare la posizione dei calcoli. Inizialmente, revisori umani hanno disegnato semplici riquadri attorno ai calcoli visibili. Poi uno strumento separato ha generato forme più precise all’interno di quei riquadri e gli esperti clinici hanno verificato che corrispondessero alle reali aree di calcolo. Queste immagini abbinate alle corrispondenti maschere sono state usate per addestrare un modello di deep learning basato su un’architettura U‑Net, un tipo di rete molto diffuso per la segmentazione che può individuare precisamente quali pixel appartengono al calcolo.

Quanto bene ha funzionato il modello di IA

Il team ha suddiviso attentamente i dati in modo che alcune operazioni servissero per addestrare il modello, altre per la messa a punto e altre ancora fossero tenute completamente separate per testarne l’efficacia su interventi nuovi e non visti. Su questi video tenuti fuori, l’IA ha classificato correttamente la maggior parte dei pixel in ogni fotogramma e ha mostrato una forte sovrapposizione tra i contorni dei calcoli prodotti dal modello e le annotazioni degli esperti. In termini semplici, quando il calcolo era chiaramente visibile e l’immagine della telecamera nitida, il sistema tracciava un bordo stretto e accurato attorno ad esso. Il modello è risultato anche veloce: su una scheda grafica standard ha elaborato circa 30 fotogrammi al secondo, simile alla velocità di un feed video dal vivo, suggerendo che l’uso in tempo reale in sala operatoria è tecnicamente fattibile.

Quando la visuale diventa confusa

Le prestazioni calavano quando il video somigliava più a una tormenta di neve che a un’immagine nitida. In fotogrammi con sanguinamento intenso, dense nubi di polvere generate dal laser o marcato motion blur, il modello a volte confondeva detriti chiari con il calcolo vero e proprio o non rilevava parti del calcolo. Un’analisi più dettagliata ha confrontato fotogrammi “chiari”, con poco disturbo, con fotogrammi “sfocati” pieni di artefatti. L’IA ha reso sensibilmente meglio nel gruppo chiaro, confermando che la scarsa visibilità rende più difficile ottenere contorni precisi anche per un algoritmo addestrato. Poiché il modello analizza ogni fotogramma in modo indipendente, non può ancora sfruttare il movimento nel tempo per distinguere un calcolo stabile da polvere o striature di sangue transitorie.

Cosa potrebbe significare per le operazioni future

Questo lavoro rappresenta un passo iniziale più che uno strumento pronto per l’uso ospedaliero. Lo studio ha impiegato un numero modesto di video provenienti da un singolo centro, con una gamma limitata di tipi di telecamera, e il processo di annotazione può ancora contenere imprecisioni umane e algoritmiche. Il sistema non è stato ancora integrato in un flusso chirurgico completo, dove affidabilità, controlli di sicurezza e limiti hardware sono aspetti cruciali. Tuttavia, i risultati mostrano che un modello di IA può apprendere a trovare e circoscrivere i calcoli renali direttamente da video chirurgici reali e tenere il passo con velocità da live. Con dataset più ampi e diversificati, un uso più intelligente delle informazioni tra fotogrammi consecutivi e test accurati nelle sale operatorie, sistemi simili potrebbero in futuro assistere i chirurghi rendendo i calcoli nascosti più visibili, riducendo i frammenti mancati e migliorando la cura del paziente.

Citazione: El Hajj, A., Bou Mrad, A., Malik, E. et al. Automated kidney stone segmentation from flexible ureteroscopy videos using a U-net model: A preliminary feasibility study. Sci Rep 16, 14542 (2026). https://doi.org/10.1038/s41598-026-45143-7

Parole chiave: calcoli renali, IA chirurgica, video endoscopico, imaging medico, deep learning