Clear Sky Science · nl

Geautomatiseerde segmentatie van nierstenen uit flexibele ureteroscopievideo's met een U-netmodel: Een voorlopige haalbaarheidsstudie

Chirurgen helpen verborgen nierstenen te zien

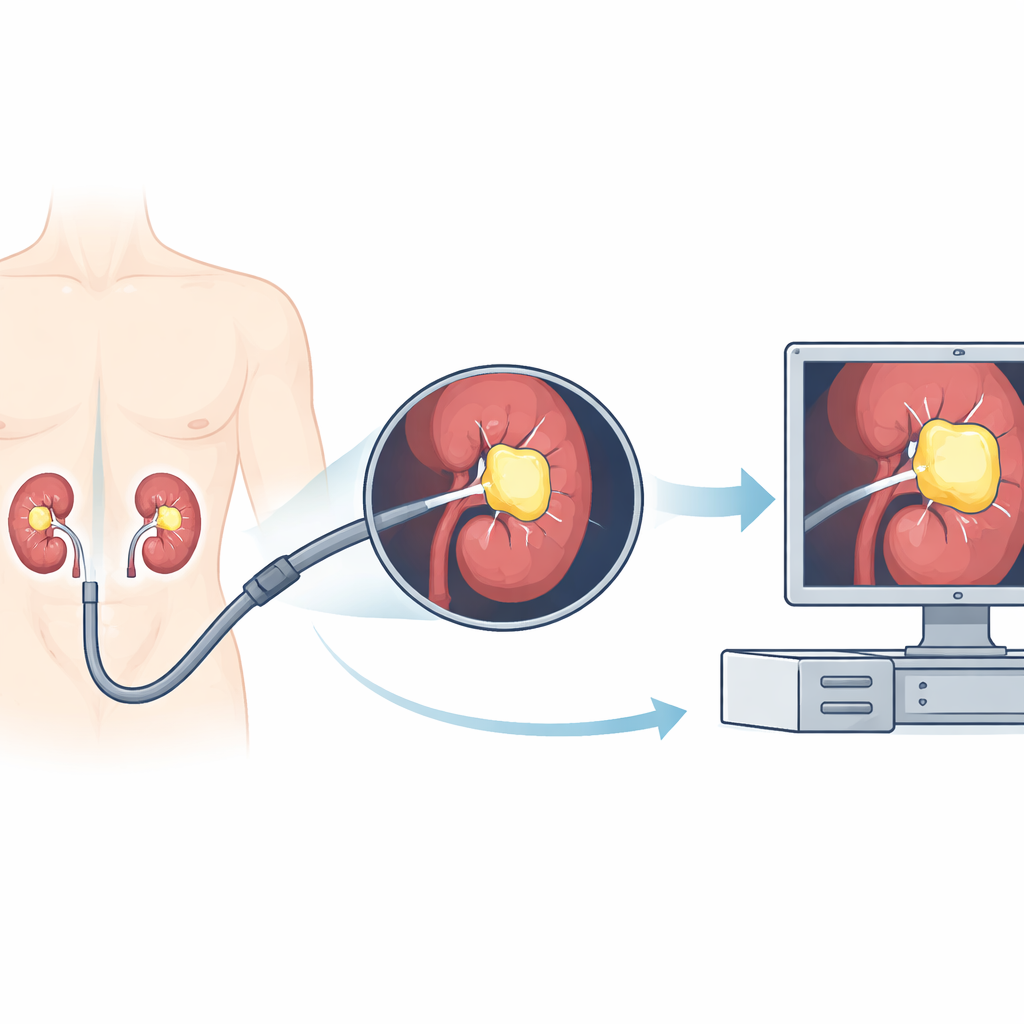

Nierstenen veroorzaken pijn en komen steeds vaker voor. Een van de belangrijkste behandelingen bestaat uit het inbrengen van een piepkleine camera in de nier en het vergruizen van de stenen met een laser. Binnen in het lichaam is het beeld echter vaak rommelig: bloed, stof van verbrijzelde stenen en beweging door ademhaling maken het moeilijk voor chirurgen om precies te zien wat ze doen. Deze studie onderzoekt of kunstmatige intelligentie (AI) tijdens de operatie als een realtime markeerder voor nierstenen kan fungeren, zodat ze op het scherm beter opvallen en de behandeling mogelijk sneller en veiliger wordt.

Waarom nierstenen moeilijk te behandelen zijn

Nierstenen treffen wereldwijd een groot deel van volwassenen en kunnen hevige pijn, infecties en zelfs nierfalen veroorzaken. Moderne behandeling gebruikt vaak flexibele ureteroscopie: artsen leiden een buigzame scoop met camera via de urinewegen naar de nier en gebruiken daar een laser om stenen in kleinere stukken te breken. De cameraweergave is echter verre van perfect. Plotselinge bloedingen, opwaaiend stof door de laser, lichtveranderingen en snelle bewegingen kunnen het beeld vervagen. Chirurgen moeten continu bepalen waar de steen eindigt en het omliggende weefsel begint. Als ze fragmenten missen, zijn herhaalde procedures nodig; als ze het zicht verkeerd inschatten, neemt het risico op complicaties toe.

Een computer leren stenen te herkennen

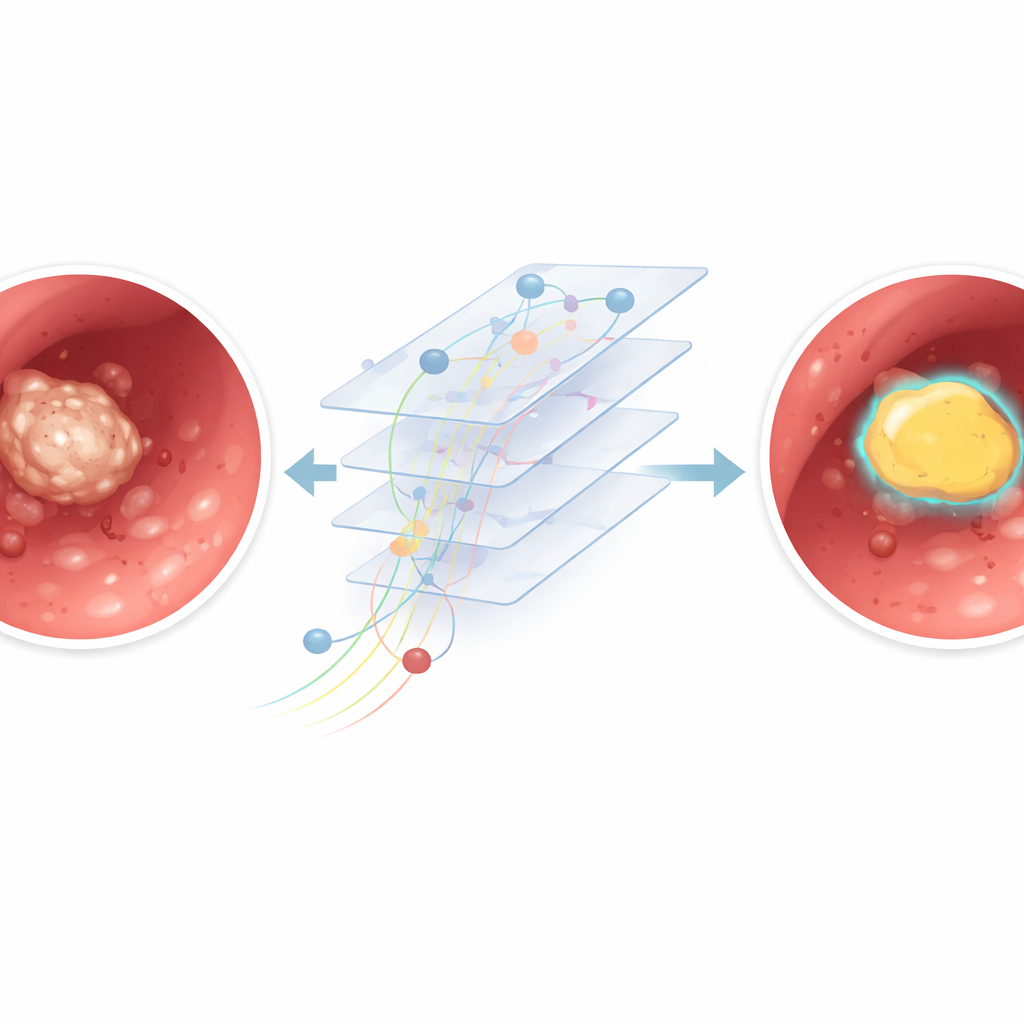

Om deze uitdaging aan te pakken, trainden de onderzoekers een computerprogramma om automatisch nierstenen af te bakenen in de videostream van de endoscoop. Ze verzamelden 12 volledige operatieopnames van verschillende patiënten, goed voor ongeveer 11 uur realistische beeldopnames. Uit deze video’s haalden ze duizenden individuele frames en bouwden ze een semi‑automatisch systeem om de stenen te annoteren. Eerst trokken menselijke beoordelaars eenvoudige kaders rond zichtbare stenen. Vervolgens genereerde een apart hulpmiddel preciezere vormen binnen die kaders, en medische experts controleerden of die overeenkwamen met de echte steengebieden. Deze gekoppelde beelden en contouren werden gebruikt om een deep learning‑model te trainen gebaseerd op een U‑Net‑architectuur, een veelgebruikt netwerk voor beeldsegmentatie dat precies kan aangeven welke pixels bij de steen horen.

Hoe goed het AI-model presteerde

Het team splitste de data zorgvuldig: sommige operaties werden gebruikt om het model te trainen, sommige om het bij te stellen, en sommige werden volledig apart gehouden om te testen hoe het model presteert op nieuwe, niet eerder geziene ingrepen. Op deze apart gehouden video’s classificeerde de AI de meeste pixels in elk frame correct en liet het een sterke overlap zien tussen zijn stone‑contouren en de expertannotaties. Eenvoudig gezegd: wanneer de steen duidelijk zichtbaar was en het camerabeeld scherp, trok het systeem een nauwe en nauwkeurige grens eromheen. Het model was ook snel: op een standaard grafische kaart verwerkte het ongeveer 30 frames per seconde, vergelijkbaar met de snelheid van een live videofeed, wat suggereert dat realtime gebruik in de operatiekamer technisch haalbaar is.

Wanneer het beeld rommelig wordt

De prestaties namen af wanneer het beeld meer op een sneeuwstorm leek dan op een heldere foto. In frames met hevige bloedingen, dikke stofwolken door de laser of sterke bewegingsonscherpte verwarde het model soms helder puin met echte steen of miste delen van de steen helemaal. Een nadere analyse vergeleek "heldere" frames met minimale rommel met "vage" frames vol artefacten. De AI presteerde merkbaar beter in de heldere groep, wat bevestigt dat slechte zichtbaarheid het nauwkeurig afbakenen moeilijker maakt, zelfs voor een getraind algoritme. Omdat het model elk frame op zichzelf analyseert, kan het nog geen beweging over tijd gebruiken om een stabiele steen te onderscheiden van voorbijgaand stof of bloedstrepen.

Wat dit kan betekenen voor toekomstige operaties

Dit werk is een vroege stap en geen kant‑en‑klaar ziekenhuisinstrument. De studie gebruikte een beperkt aantal video’s van één centrum, met een beperkte set camera‑types, en het annotatieproces kan nog menselijke en algoritmische onnauwkeurigheden bevatten. Het systeem is nog niet ingebed in een volledige chirurgische workflow, waarin betrouwbaarheid, veiligheidscontroles en hardwarelimieten zwaar wegen. Toch tonen de resultaten aan dat een AI‑model kan leren nierstenen direct uit echte operatievideo’s te vinden en af te bakenen en dat het de snelheid van live video kan bijhouden. Met grotere en meer diverse datasets, slimmer gebruik van informatie over opeenvolgende frames en zorgvuldige tests in echte operatiekamers, zouden soortgelijke systemen chirurgen uiteindelijk kunnen ondersteunen door verborgen stenen duidelijker te maken, gemiste fragmenten te verminderen en de patiëntenzorg te verbeteren.

Bronvermelding: El Hajj, A., Bou Mrad, A., Malik, E. et al. Automated kidney stone segmentation from flexible ureteroscopy videos using a U-net model: A preliminary feasibility study. Sci Rep 16, 14542 (2026). https://doi.org/10.1038/s41598-026-45143-7

Trefwoorden: nierstenen, chirurgische AI, endoscopievideo, medische beeldvorming, deep learning