Clear Sky Science · sv

ROI-styrd relationell YOLO–SegNet-transformer för lättviktssegmentering och klassificering av ben tumörer från röntgenbilder

Skarpare röntgenbilder för tidigare svar

Bentumörer är ovanliga men allvarliga, och i många kliniker är det första och ibland enda bildtestet en enkel röntgenundersökning. Tyvärr kan tumörer vara svagt synliga, oregelbundna och lätt bli förbisedda, särskilt på upptagna eller resurssnåla sjukhus. Denna artikel presenterar ett strömlinjeformat artificiellt intelligens (AI)-system som rengör brusiga röntgenbilder, zoomar in på misstänkta områden och avgränsar möjliga tumörer med hög precision, med målet att stödja radiologer snarare än att ersätta dem.

Varför bentumörer är svåra att upptäcka

På en röntgen framträder en bentumör inte alltid som en prydlig, rund fläck. Dess kanter kan suddas ut i normalt ben, dess ljusstyrka kan likna frisk vävnad och andra strukturer kan överlappa på förvirrande sätt. Dessa hinder är särskilt uttalade på standardröntgen, som har mindre kontrast än CT- eller MR-undersökningar. Många befintliga AI-verktyg fokuserar antingen endast på att avgöra “tumör” kontra “ingen tumör” för en hel bild, eller kräver tung beräkningskraft som mindre sjukhus kanske inte har. Noggrann avgränsning av tumören, vilket är avgörande för planering av kirurgi och uppföljning över tid, har förblivit svårt att automatisera effektivt.

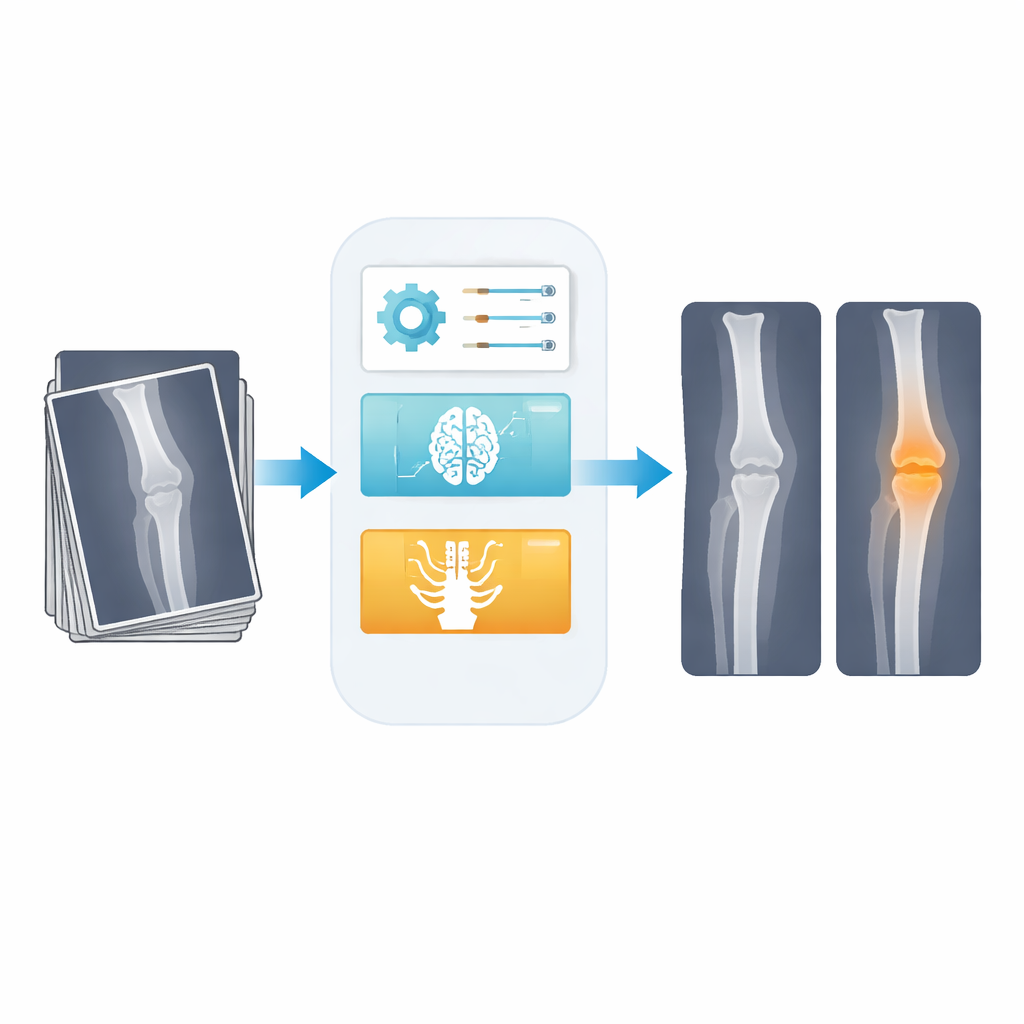

En AI-hjälpare i tre steg för röntgenbilder

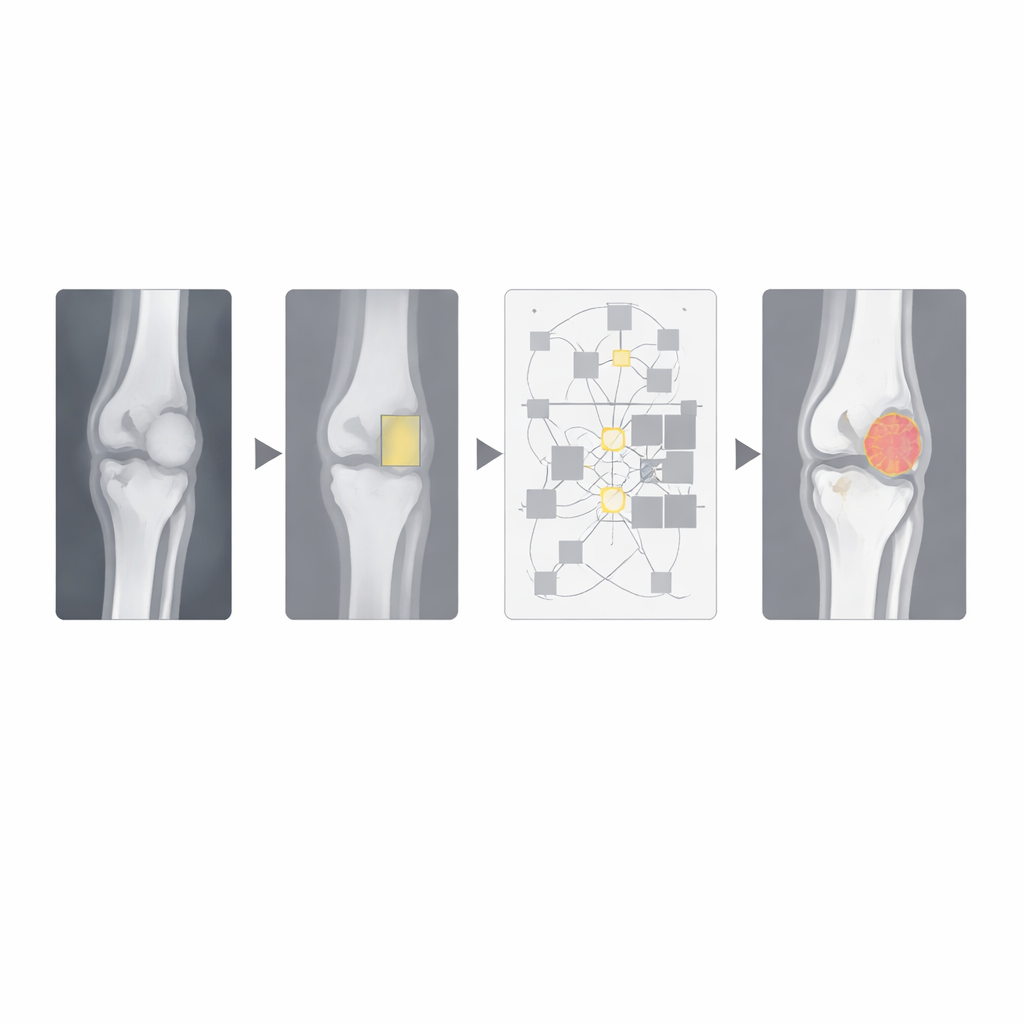

Författarna utformar en trestegs pipeline anpassad till denna utmaning. Först rengör ett smart filter den råa röntgenbilden. Istället för att använda en fast oskärpa som kan tvätta ut detaljer använder de ett adaptivt digitalt filter vars inställningar automatiskt väljs av en optimeringsrutin. Detta höjer signal‑till‑brusförhållandet från cirka 21 till nästan 30 decibel, vilket innebär att bilden blir märkbart mindre brusig samtidigt som kanterna på ben och tumörer förblir skarpa. För det andra ritar ett kompakt detektionsnätverk, härlett från de populära YOLO-modellerna, en grov ruta runt varje region som sannolikt innehåller en tumör. För det tredje skickas endast detta inskränkta område till ett lättviktssegmenteringsnätverk som spårar tumörens gränser på pixelnivå, och det slutliga beslutet om “normalt” kontra “tumör” fattas med information från det segmenterade området.

Fokusera AI:ns uppmärksamhet där det spelar roll

En central innovation är hur systemet använder “relationell” uppmärksamhet. Många moderna visionsmodeller förlitar sig på transformer-block som försöker jämföra varje del av en bild med varje annan del. Fastän kraftfullt blir detta dyrt för stora medicinska bilder och kan sakta ner användning i realtid. Här appliceras transformern endast inuti tumörrutan som hittats av detektorn, plus närliggande ben. Inom detta mindre område lär sig modellen hur olika punkter relaterar till varandra, vilket hjälper den att skilja suddig tumörvävnad från normalt ben. Eftersom den ignorerar resten av bilden minskar tillvägagångssättet beräkningskostnaden drastiskt samtidigt som den fångar långväga kontext inom den kliniskt relevanta regionen.

Låta naturinspirerade sökmetoder ställa in knapparna

Pipelinen använder också två naturinspirerade sökmetoder för att automatiskt välja viktiga inställningar. En algoritm justerar hur starkt filtret jämnar ut röntgenbilden, i en avvägning mellan brusborttagning och kantklarhet. En annan hybridoptimerare kallad “fire hawk election” söker efter bra träningsinställningar såsom inlärningshastighet, batchstorlek och dropout. Dessa metaheuristiker minskar manuell trial-and-error och hjälper modellen att konvergera snabbt utan att överanpassa den relativt lilla dataseten om 809 expertmärkta röntgenbilder, som inkluderar både friska och tumörfall.

Snabbt, noggrant, men ännu inte ett klinikfärdigt verktyg

Testat med femfaldig korsvalidering skiljer systemet korrekt mellan normala och tumörbärande röntgenbilder cirka 98,5 % av gångerna och uppnår ett Dice‑mått på 97 %, vilket indikerar nära överensstämmelse mellan AI:ns tumöravgränsningar och experters ritningar. Det använder ungefär en tredjedel av parametrarna hos vanliga segmenteringsnätverk som UNet och körs på cirka 48 millisekunder per bild på ett modernt grafikkort, vilket stödjer nästintill realtidsanvändning. Författarna betonar dock att deras resultat kommer från en enda offentlig datamängd och ännu inte speglar den fulla variationen av maskiner, sjukhus och patienter i verklig klinisk praxis. De positionerar sitt ramverk som ett lovande forskningsstödsverktyg som så småningom kan hjälpa radiologer att upptäcka och mäta bentumörer mer konsekvent, när det validerats tvärs över flera center och kliniska förhållanden.

Citering: Natarajan, C., Rajendran, S., Vinmathi, M.S. et al. ROI-guided relational YOLO–SegNet transformer for lightweight bone tumor segmentation and classification from X-ray images. Sci Rep 16, 14603 (2026). https://doi.org/10.1038/s41598-026-44297-8

Nyckelord: bentumörer, medicinska röntgenbilder, djupt lärande, tumörsegmentering, datorstödd diagnostik