Clear Sky Science · pl

Transformator ROI-guided relational YOLO–SegNet do lekkiej segmentacji i klasyfikacji guzów kości na zdjęciach rentgenowskich

Ostroższe rentgeny, wcześniejsze odpowiedzi

Guzy kości są rzadkie, ale poważne, a w wielu placówkach pierwszym, a czasem jedynym badaniem obrazowym jest zwykły rentgen. Niestety zmiany mogą być słabo widoczne, nieregularne i łatwe do przeoczenia, zwłaszcza w zatłoczonych lub słabo wyposażonych szpitalach. W artykule przedstawiono uproszczony system sztucznej inteligencji (AI), który oczyszcza zaszumione zdjęcia rentgenowskie, przybliża podejrzane obszary i z dużą precyzją obrysowuje potencjalne guzy, dążąc do wspierania radiologów, a nie ich zastępowania.

Dlaczego guzy kości trudno dostrzec

Na rentgenie guz kości nie zawsze wyróżnia się jako gładka, okrągła plamka. Jego brzegi mogą przechodzić w prawidłową tkankę kostną, jasność może przypominać zdrowe struktury, a inne elementy anatomiczne mogą nakładać się w sposób mylący. Te trudności są szczególnie dotkliwe w standardowych zdjęciach rentgenowskich, które mają mniejszy kontrast niż tomografia komputerowa czy rezonans magnetyczny. Wiele istniejących narzędzi AI skupia się albo tylko na decyzji „guz” kontra „brak guza” dla całego obrazu, albo wymaga dużej mocy obliczeniowej, której mniejsze szpitale mogą nie mieć. Dokładne obrysowanie guza, kluczowe do planowania operacji i śledzenia choroby w czasie, pozostaje trudne do zautomatyzowania w sposób wydajny.

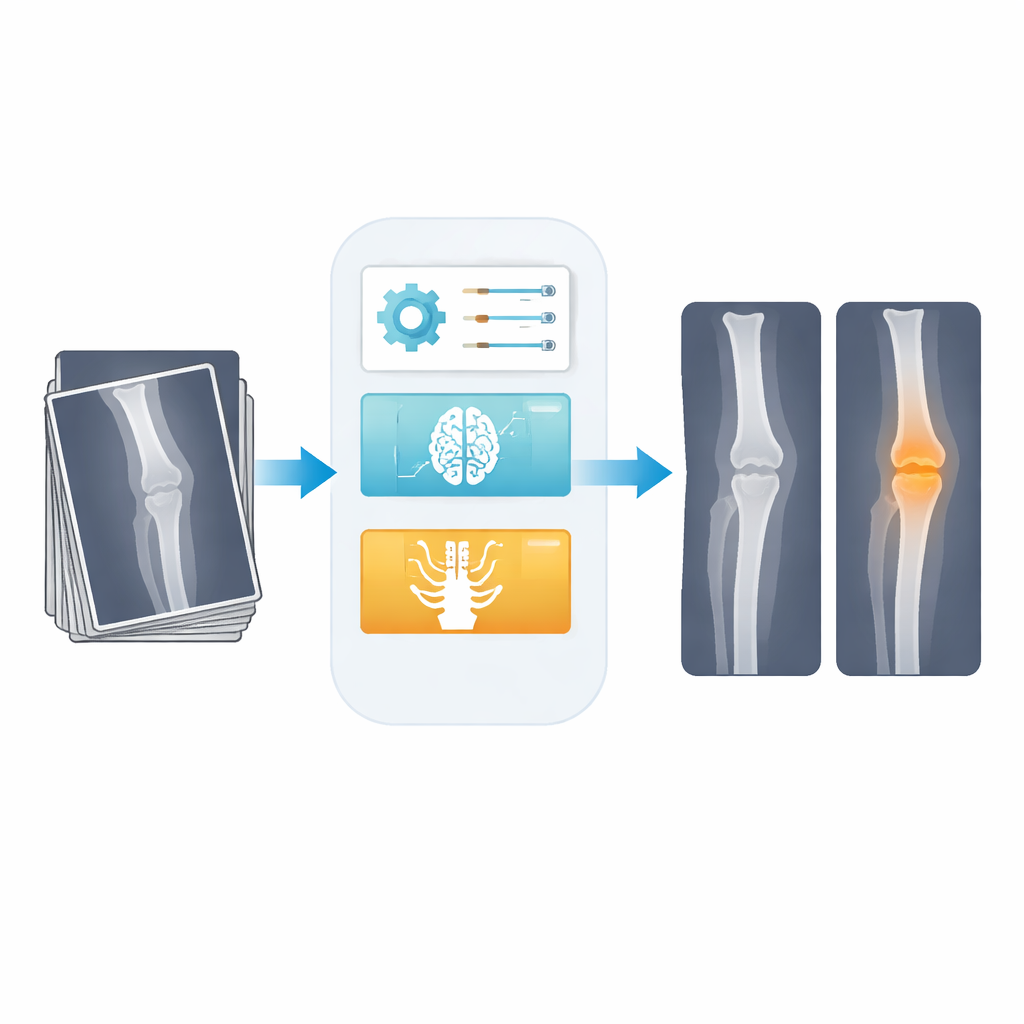

Trzystopniowy pomocnik AI dla rentgenów

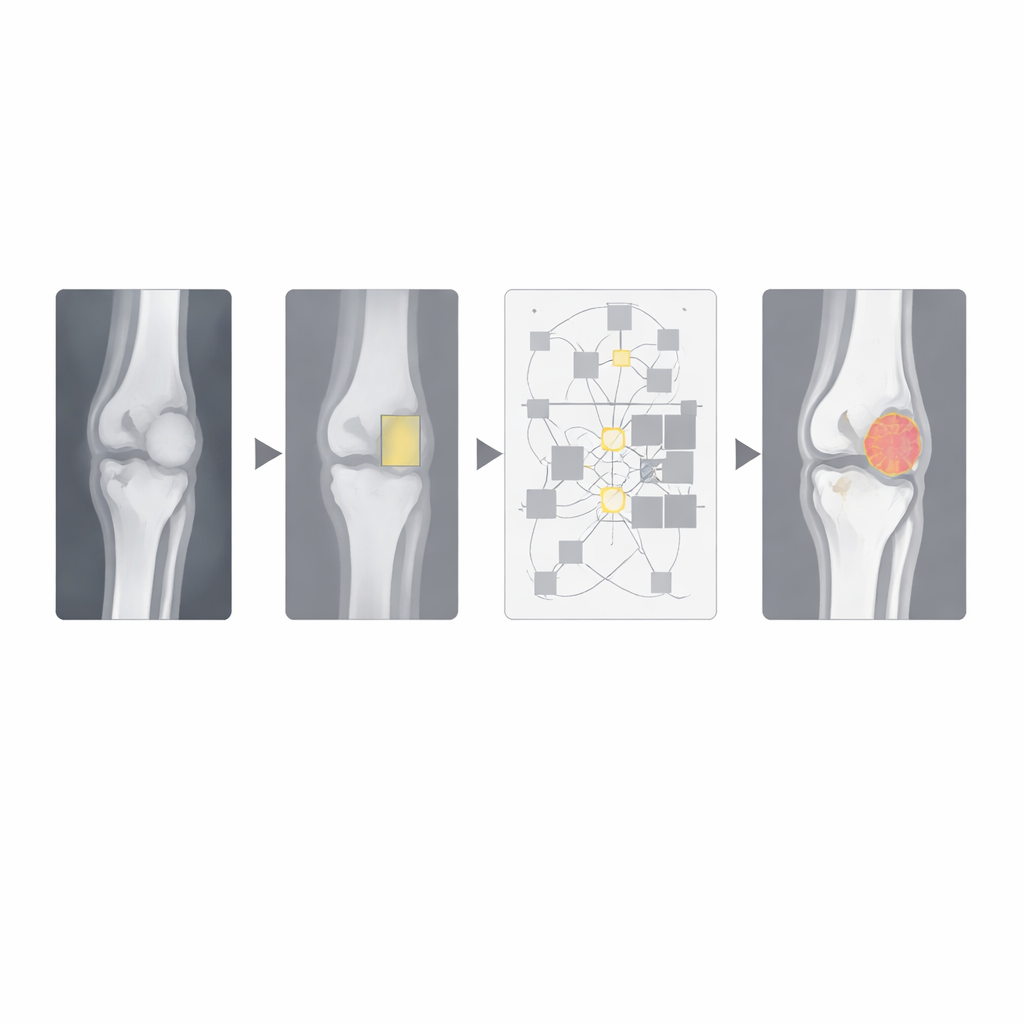

Autorzy zaprojektowali trzyetapowy pipeline dostosowany do tego wyzwania. Najpierw inteligentne oczyszczanie surowego rentgena. Zamiast stosować stałe rozmycie, które może zmywać detale, używają adaptacyjnego filtra cyfrowego, którego parametry są automatycznie dobierane przez procedurę optymalizacyjną. Podnosi to stosunek sygnału do szumu z około 21 do niemal 30 decybeli — obraz jest wyraźnie mniej zaszumiony, podczas gdy krawędzie kości i guzów pozostają ostre. Po drugie, kompaktowa sieć detekcyjna, wywodząca się z popularnej rodziny modeli YOLO, rysuje w przybliżeniu ramkę wokół regionu, który może zawierać guz. Po trzecie, tylko ten zawężony obszar trafia do lekkiej sieci segmentacyjnej, która śledzi granice guza na poziomie pikseli, a ostateczna decyzja „normalny” kontra „guz” jest podejmowana na podstawie informacji z wysegmentowanego regionu.

Skupienie uwagi AI tam, gdzie ma to znaczenie

Kluczową innowacją jest sposób wykorzystania uwagi „relacyjnej”. Wiele nowoczesnych modeli wizji opiera się na blokach transformera, które porównują każdą część obrazu z każdą inną. Choć potężne, staje się to kosztowne przy dużych obrazach medycznych i może spowolnić użycie w czasie rzeczywistym. W tym podejściu transformer jest stosowany tylko wewnątrz ramki guza znalezionej przez detektor oraz w przyległej tkance kostnej. W tym mniejszym obszarze model uczy się, jak różne punkty odnoszą się do siebie, co pomaga odróżnić nieostre tkanki guza od normalnej kości. Ignorując resztę obrazu, metoda znacznie redukuje nakład obliczeniowy, jednocześnie zachowując kontekst rozległych zależności w klinicznie istotnym regionie.

Pozwalanie przyrodniczo inspirowanym poszukiwaniom wybrać ustawienia

Pipeline korzysta także z dwóch przyrodniczo inspirowanych metod poszukiwania, by automatycznie dobrać ważne parametry. Jeden algorytm reguluje, jak silnie filtr wygładza rentgen, balansując usuwanie szumu z zachowaniem ostrości krawędzi. Inny, hybrydowy optymalizator „fire hawk election” poszukuje dobrych ustawień treningowych, takich jak współczynnik uczenia, rozmiar partii i dropout. Te metaheurystyki zmniejszają konieczność ręcznego próbowania i pomagają modelowi szybko zbiegać bez przeuczenia na stosunkowo małym zbiorze 809 rentgenów opisanych przez ekspertów, obejmującym przypadki zdrowe i z guzami.

Szybki, dokładny, ale jeszcze nie gotowy do kliniki

Testowany przy użyciu walidacji krzyżowej pięciokrotnej system poprawnie rozróżnia rentgeny zdrowe od z guzem w około 98,5% przypadków i osiąga wynik Dice na poziomie 97%, co wskazuje na ścisłą zgodność między obrysami guza wykonanymi przez AI a rysunkami ekspertów. Wykorzystuje mniej więcej jedną trzecią parametrów popularnych sieci segmentacyjnych, takich jak UNet, i działa w około 48 milisekund na obraz na nowoczesnej karcie graficznej, wspierając zastosowanie w niemal czasie rzeczywistym. Autorzy jednak podkreślają, że wyniki pochodzą z jednego publicznego zbioru danych i nie odzwierciedlają jeszcze pełnej różnorodności aparatów, placówek i pacjentów w praktyce klinicznej. Prezentują swoje rozwiązanie jako obiecujące narzędzie wspierające badania, które mogłoby ostatecznie pomóc radiologom w bardziej spójnym wykrywaniu i pomiarze guzów kości, po walidacji w wielu ośrodkach i warunkach klinicznych.

Cytowanie: Natarajan, C., Rajendran, S., Vinmathi, M.S. et al. ROI-guided relational YOLO–SegNet transformer for lightweight bone tumor segmentation and classification from X-ray images. Sci Rep 16, 14603 (2026). https://doi.org/10.1038/s41598-026-44297-8

Słowa kluczowe: guzy kości, rentgeny medyczne, uczenie głębokie, segmentacja guzów, komputerowe wspomaganie diagnostyki