Clear Sky Science · es

Transformador ROI-guidado relational YOLO–SegNet para segmentación y clasificación ligera de tumores óseos en radiografías

Radiografías más nítidas para respuestas más tempranas

Los tumores óseos son poco frecuentes pero graves, y en muchas clínicas la primera y, a veces, la única prueba de imagen es una radiografía simple. Desafortunadamente, los tumores pueden ser tenues, irregulares y fácilmente pasados por alto, especialmente en hospitales con mucha carga o con pocos recursos. Este artículo presenta un sistema de inteligencia artificial (IA) simplificado que limpia radiografías ruidosas, amplía regiones sospechosas y traza posibles tumores con alta precisión, con el objetivo de apoyar a los radiólogos en lugar de reemplazarlos.

Por qué los tumores óseos son difíciles de detectar

En una radiografía, un tumor óseo no siempre destaca como una mancha redondeada y definida. Sus bordes pueden fundirse con el hueso normal, su brillo puede asemejarse al tejido sano y otras estructuras pueden superponerse de forma confusa. Estos obstáculos son especialmente graves en radiografías estándar, que tienen menos contraste que las tomografías computarizadas o las resonancias magnéticas. Muchas herramientas de IA existentes se limitan a decidir “tumor” frente a “sin tumor” para toda la imagen, o requieren gran potencia de cálculo que los hospitales pequeños pueden no tener. El trazado preciso del tumor, crucial para planificar la cirugía y seguir la enfermedad con el tiempo, sigue siendo difícil de automatizar de forma eficiente.

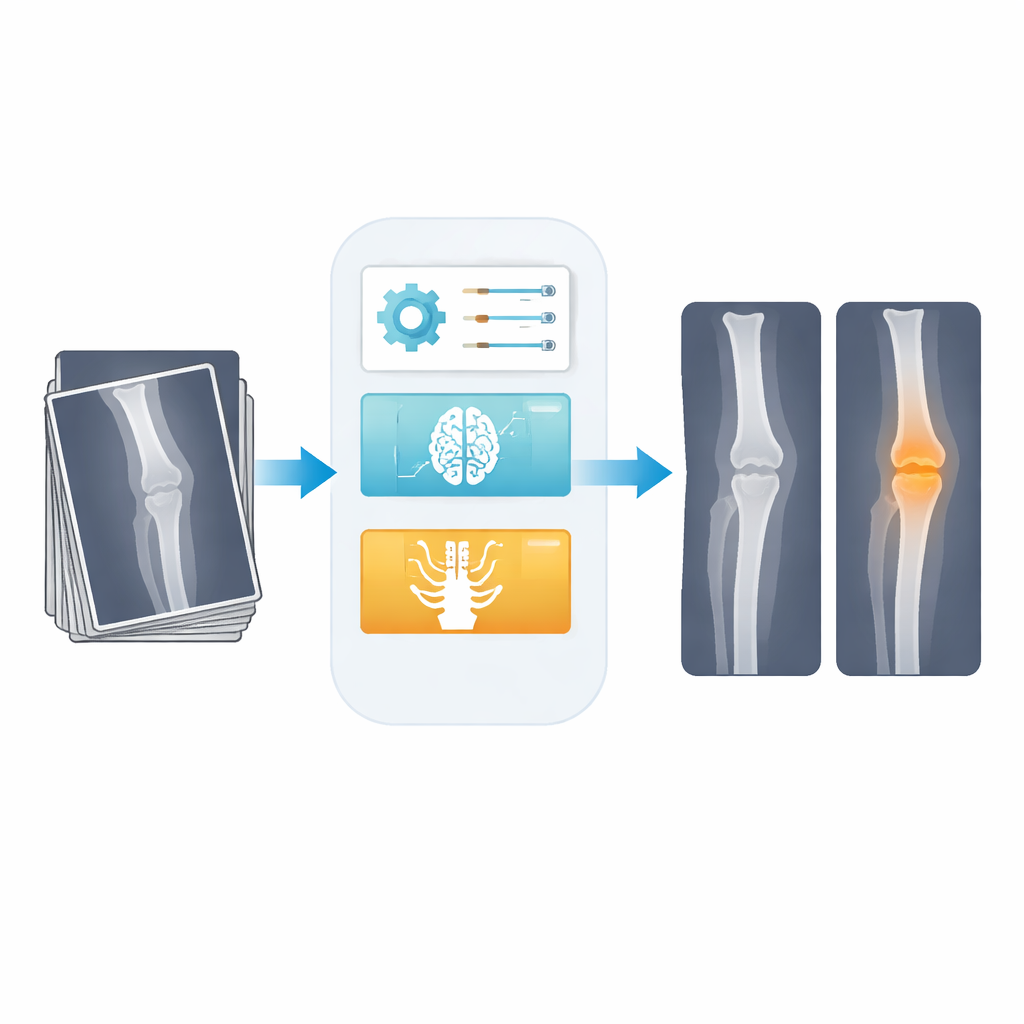

Un asistente de IA en tres pasos para radiografías

Los autores diseñan una canalización en tres etapas adaptada a este desafío. Primero, un paso de filtrado inteligente limpia la radiografía sin procesar. En lugar de usar un desenfoque fijo que puede borrar detalles, emplean un filtro digital adaptativo cuyas configuraciones se eligen automáticamente mediante una rutina de optimización. Esto eleva la relación señal-ruido de alrededor de 21 a casi 30 decibelios, lo que significa que la imagen tiene notablemente menos ruido mientras los bordes de huesos y tumores permanecen nítidos. Segundo, una red de detección compacta, derivada de la popular familia de modelos YOLO, dibuja un cuadro aproximado alrededor de cualquier región que probablemente contenga un tumor. Tercero, solo esta región acotada se envía a una red de segmentación ligera que traza los límites del tumor a nivel de píxel, y la decisión final de “normal” frente a “tumor” se toma usando la información de la región segmentada.

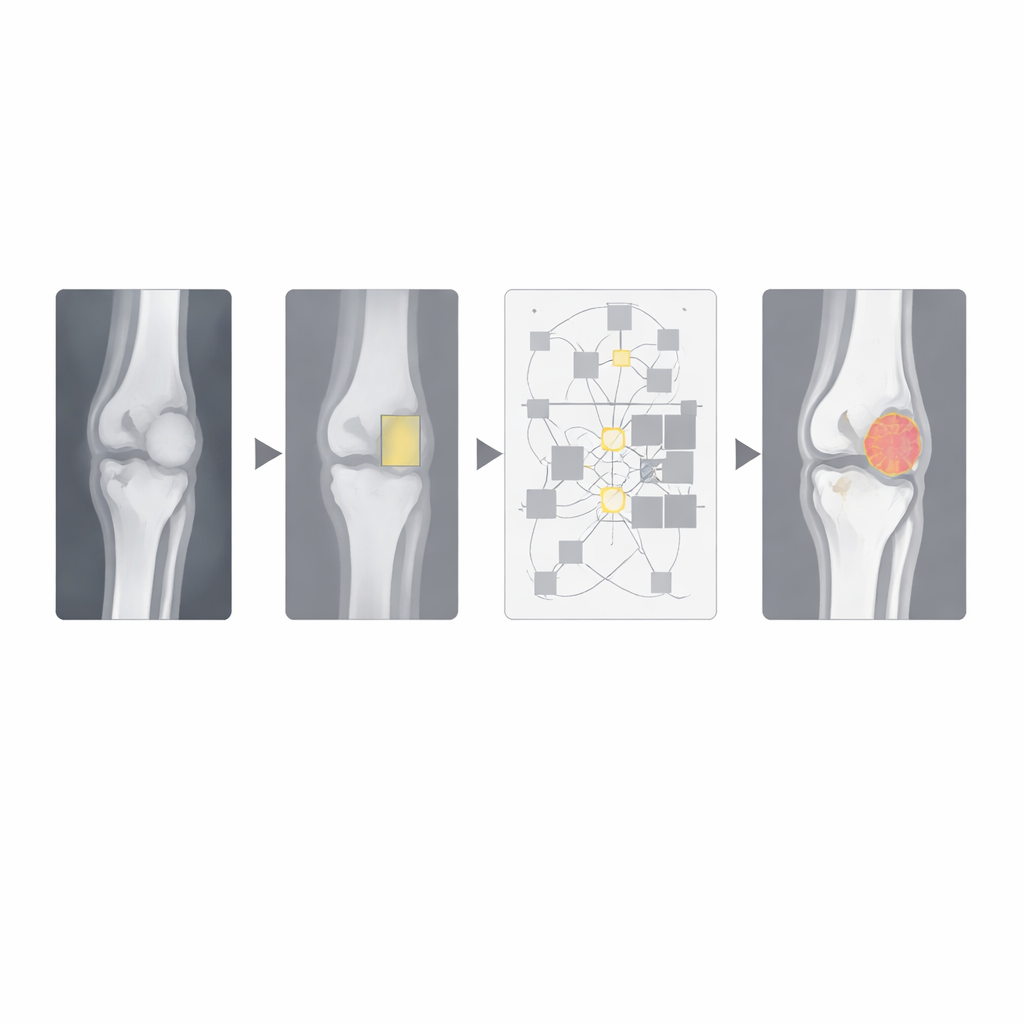

Concentrar la atención de la IA donde importa

Una innovación clave es cómo el sistema utiliza la atención “relacional”. Muchos modelos de visión modernos se basan en bloques transformadores que intentan comparar cada parte de una imagen con todas las demás. Aunque potentes, esto se vuelve costoso en imágenes médicas grandes y puede ralentizar el uso en tiempo real. Aquí, el transformador se aplica solo dentro del cuadro del tumor encontrado por el detector, además del hueso cercano. Dentro de esta área más pequeña, el modelo aprende cómo se relacionan distintos puntos entre sí, lo que le ayuda a distinguir tejido tumoral difuso del hueso normal. Al ignorar el resto de la imagen, el enfoque reduce drásticamente la cantidad de cálculo manteniendo la captura de contexto a larga distancia dentro de la región clínicamente relevante.

Dejar que búsquedas inspiradas en la naturaleza ajusten los parámetros

La canalización también emplea dos métodos de búsqueda inspirados en la naturaleza para elegir configuraciones importantes de forma automática. Un algoritmo ajusta la intensidad con la que el filtro suaviza la radiografía, equilibrando la eliminación de ruido con la claridad de los bordes. Otro optimizador híbrido llamado “fire hawk election” busca buenos ajustes de entrenamiento como la tasa de aprendizaje, el tamaño de lote y el dropout. Estas metaheurísticas reducen la prueba y error manual y ayudan al modelo a converger rápidamente sin sobreajustarse al conjunto de datos relativamente pequeño de 809 radiografías etiquetadas por expertos, que incluye casos sanos y con tumor.

Rápido, preciso, pero aún no una herramienta lista para clínica

Probado con validación cruzada de cinco particiones, el sistema distingue correctamente radiografías normales de las que contienen tumor en aproximadamente el 98,5% de los casos y alcanza una puntuación Dice del 97%, lo que indica una gran coincidencia entre los contornos de tumor del sistema y los trazados de expertos. Utiliza aproximadamente un tercio de los parámetros de redes de segmentación comunes como UNet y se ejecuta en cerca de 48 milisegundos por imagen en una tarjeta gráfica moderna, lo que permite un uso casi en tiempo real. Sin embargo, los autores subrayan que sus resultados provienen de un único conjunto de datos público y aún no reflejan la variedad completa de máquinas, hospitales y pacientes en la práctica real. Presentan su marco como una prometedora herramienta de apoyo a la investigación que podría, tras validación multicéntrica y en diversas condiciones clínicas, ayudar a los radiólogos a detectar y medir tumores óseos de forma más consistente.

Cita: Natarajan, C., Rajendran, S., Vinmathi, M.S. et al. ROI-guided relational YOLO–SegNet transformer for lightweight bone tumor segmentation and classification from X-ray images. Sci Rep 16, 14603 (2026). https://doi.org/10.1038/s41598-026-44297-8

Palabras clave: tumores óseos, radiografías médicas, aprendizaje profundo, segmentación de tumores, diagnóstico asistido por ordenador