Clear Sky Science · de

ROI-geführter relationaler YOLO–SegNet-Transformer für leichte Segmentierung und Klassifizierung von Knochentumoren in Röntgenaufnahmen

Scharfere Röntgenaufnahmen für frühere Antworten

Knochentumoren sind selten, aber ernsthaft, und in vielen Kliniken ist die erste und manchmal einzige bildgebende Untersuchung ein einfaches Röntgenbild. Leider können Tumoren schwach, unregelmäßig und leicht zu übersehen sein, insbesondere in überlasteten oder ressourcenarmen Krankenhäusern. Dieses Papier stellt ein gestrafftes System der künstlichen Intelligenz (KI) vor, das verrauschte Röntgenaufnahmen bereinigt, verdächtige Bereiche vergrößert und mögliche Tumoren mit hoher Präzision umreißt, wobei es darauf abzielt, Radiolog:innen zu unterstützen statt zu ersetzen.

Warum Knochentumoren schwer zu erkennen sind

Auf einem Röntgenbild sticht ein Knochentumor nicht immer als saubere, runde Stelle hervor. Seine Ränder können in normaler Knochenstruktur verlaufen, seine Helligkeit kann gesundem Gewebe ähneln, und andere Strukturen können sich auf verwirrende Weise überlagern. Diese Hindernisse sind bei Standardröntgenaufnahmen besonders ausgeprägt, die weniger Kontrast bieten als CT- oder MRT-Scans. Viele bisherige KI-Werkzeuge konzentrieren sich entweder nur darauf, für ein gesamtes Bild „Tumor“ versus „kein Tumor“ zu entscheiden, oder sie verlangen hohe Rechenleistung, die kleinere Krankenhäuser möglicherweise nicht haben. Die präzise Abgrenzung des Tumors, die für OP-Planung und Verlaufskontrolle entscheidend ist, ließ sich bislang nur schwer effizient automatisieren.

Ein dreistufiger KI-Helfer für Röntgenaufnahmen

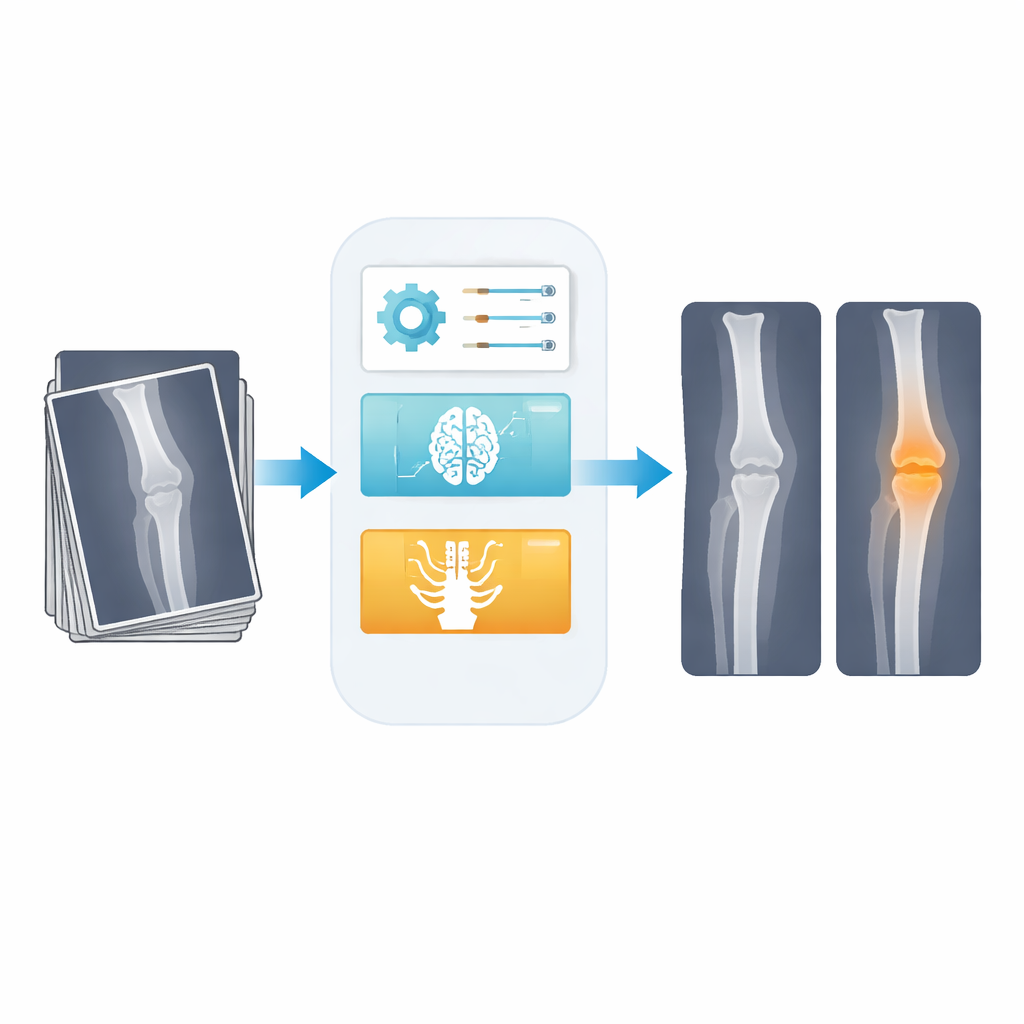

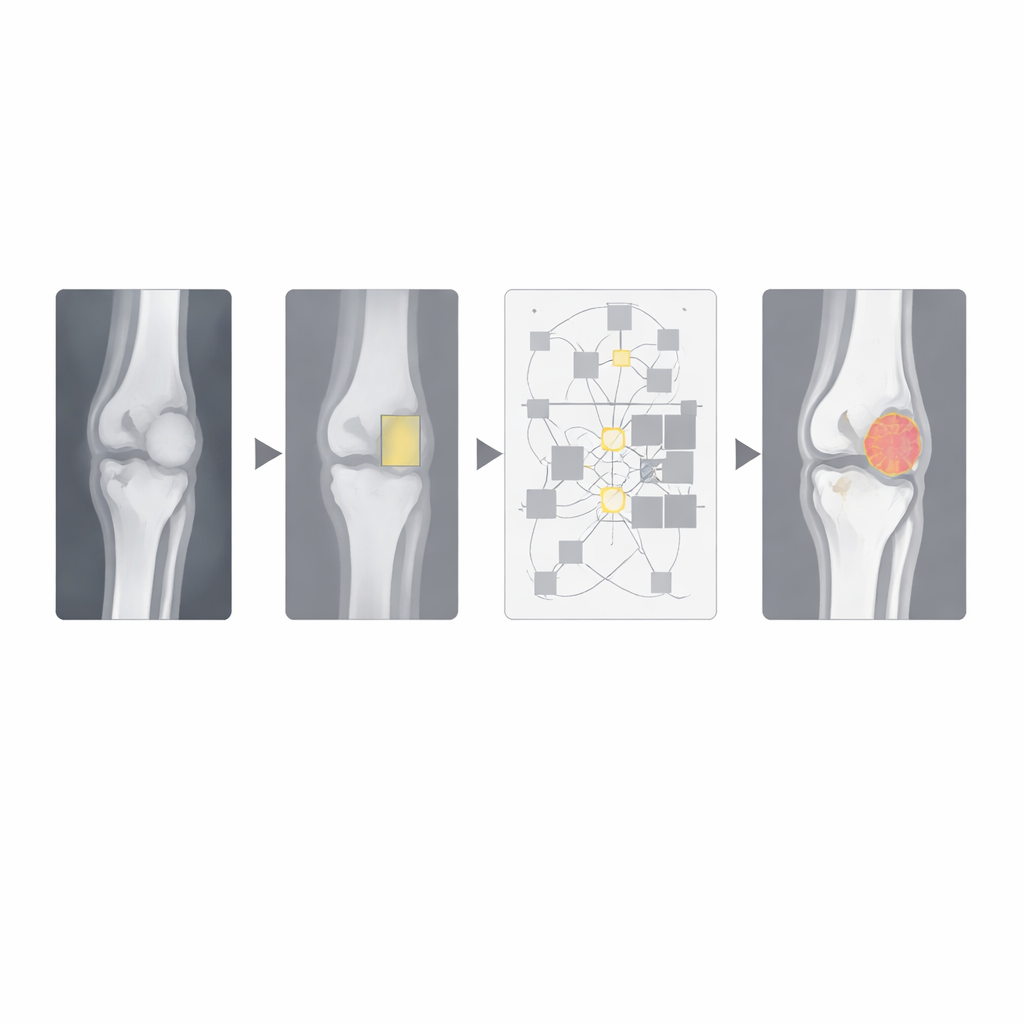

Die Autoren entwerfen eine dreistufige Pipeline, die auf diese Herausforderung zugeschnitten ist. Zuerst bereinigt ein intelligenter Filter die Rohaufnahme. Anstatt einen festen Weichzeichner zu verwenden, der Details auswaschen kann, nutzen sie einen adaptiven digitalen Filter, dessen Parameter automatisch durch eine Optimierungsroutine gewählt werden. Das erhöht das Signal-Rausch-Verhältnis von etwa 21 auf nahezu 30 Dezibel, was bedeutet, dass das Bild spürbar weniger Rauschen aufweist, während Kanten von Knochen und Tumoren scharf bleiben. Zweitens zeichnet ein kompakter Detektionsnetzwerk, abgeleitet von der populären YOLO-Familie, eine grobe Box um jeden Bereich, der wahrscheinlich einen Tumor enthält. Drittens wird nur dieser eingeschränkte Bereich an ein leichtgewichtiges Segmentierungsnetzwerk gesendet, das die Tumorgrenzen auf Pixelebene nachzeichnet; die abschließende Entscheidung „normal“ versus „Tumor“ wird mithilfe der Informationen aus der segmentierten Region getroffen.

Die KI-Aufmerksamkeit auf das Wesentliche lenken

Eine zentrale Neuerung ist, wie das System „relationale“ Aufmerksamkeit nutzt. Viele moderne Vision-Modelle beruhen auf Transformer-Blöcken, die versuchen, jeden Bildteil mit jedem anderen zu vergleichen. Das ist zwar leistungsstark, wird bei großen medizinischen Bildern aber schnell rechenintensiv und kann die Echtzeitanwendung verlangsamen. Hier wird der Transformer nur innerhalb der vom Detektor gefundenen Tumorbox sowie im benachbarten Knochenbereich angewendet. Innerhalb dieses kleineren Bereichs lernt das Modell, wie verschiedene Stellen zueinander in Beziehung stehen, was ihm hilft, unscharfes Tumorgewebe von normalem Knochen zu unterscheiden. Da der Rest des Bildes ignoriert wird, reduziert der Ansatz den Rechenaufwand drastisch, erfasst jedoch weiterhin den langfristigen Kontext in der klinisch relevanten Region.

Naturinspirierte Suche zur Feinabstimmung

Die Pipeline verwendet außerdem zwei naturinspirierte Suchverfahren, um wichtige Einstellungen automatisch zu wählen. Ein Algorithmus passt an, wie stark der Filter das Röntgenbild glättet, und balanciert Rauschreduktion gegen Kantenschärfe. Ein weiterer hybrider „Fire Hawk Election“-Optimierer sucht nach guten Trainingsparametern wie Lernrate, Batch-Größe und Dropout. Diese Metaheuristiken reduzieren manuelle Trial-and-Error-Versuche und helfen dem Modell, schnell zu konvergieren, ohne das vergleichsweise kleine Dataset von 809 fachkundig annotierten Röntgenaufnahmen, das sowohl gesunde als auch Tumorfälle umfasst, zu überanpassen.

Schnell, genau, aber noch kein klinikreifes Werkzeug

Getestet mit Fünffach-Crossvalidierung unterscheidet das System normale von tumortragenden Röntgenaufnahmen in etwa 98,5 % der Fälle korrekt und erreicht einen Dice-Wert von 97 %, was auf eine enge Übereinstimmung zwischen den KI-Tumorumrissen und den Expertenzeichnungen hinweist. Es verwendet ungefähr ein Drittel der Parameter gängiger Segmentierungsnetzwerke wie UNet und läuft in etwa 48 Millisekunden pro Bild auf einer modernen Grafikkarte, was eine nahezu Echtzeitnutzung unterstützt. Die Autoren betonen jedoch, dass ihre Ergebnisse aus einem einzigen öffentlichen Datensatz stammen und noch nicht die volle Vielfalt an Geräten, Kliniken und Patient:innen in der Praxis widerspiegeln. Sie positionieren ihr Framework als vielversprechendes Forschungsunterstützungswerkzeug, das Radiolog:innen schließlich helfen könnte, Knochentumoren konsistenter zu erkennen und zu vermessen, sobald es über mehrere Zentren und klinische Bedingungen hinweg validiert ist.

Zitation: Natarajan, C., Rajendran, S., Vinmathi, M.S. et al. ROI-guided relational YOLO–SegNet transformer for lightweight bone tumor segmentation and classification from X-ray images. Sci Rep 16, 14603 (2026). https://doi.org/10.1038/s41598-026-44297-8

Schlüsselwörter: Knochentumoren, medizinische Röntgenaufnahmen, Deep Learning, Tumorsegmentierung, computerunterstützte Diagnose