Clear Sky Science · it

Trasformatore YOLO–SegNet relazionale guidato da ROI per la segmentazione e classificazione leggera dei tumori ossei dalle radiografie

Radiografie più nitide per risposte più precoci

I tumori ossei sono rari ma gravi e, in molte strutture, il primo e talvolta l’unico esame diagnostico è una semplice radiografia. Purtroppo i tumori possono essere deboli, irregolari e facilmente trascurati, soprattutto in ospedali affollati o con risorse limitate. Questo articolo presenta un sistema di intelligenza artificiale snello che pulisce radiografie rumorose, ingrandisce le aree sospette e delimita possibili tumori con alta precisione, con l’obiettivo di supportare i radiologi piuttosto che sostituirli.

Perché i tumori ossei sono difficili da individuare

Su una radiografia, un tumore osseo non sempre emerge come un’area rotonda e netta. I suoi contorni possono confondersi con l’osso normale, la sua luminescenza può assomigliare al tessuto sano e altre strutture possono sovrapporsi in modo fuorviante. Queste difficoltà sono particolarmente pronunciate nelle radiografie standard, che hanno meno contrasto rispetto a TC o risonanze magnetiche. Molti strumenti di AI esistenti si limitano a decidere “tumore” versus “assenza di tumore” per l’intera immagine, oppure richiedono potenza di calcolo elevata, non sempre disponibile in ospedali più piccoli. La delineazione precisa del tumore, cruciale per pianificare l’intervento chirurgico e monitorare la malattia nel tempo, è rimasta difficile da automatizzare in modo efficiente.

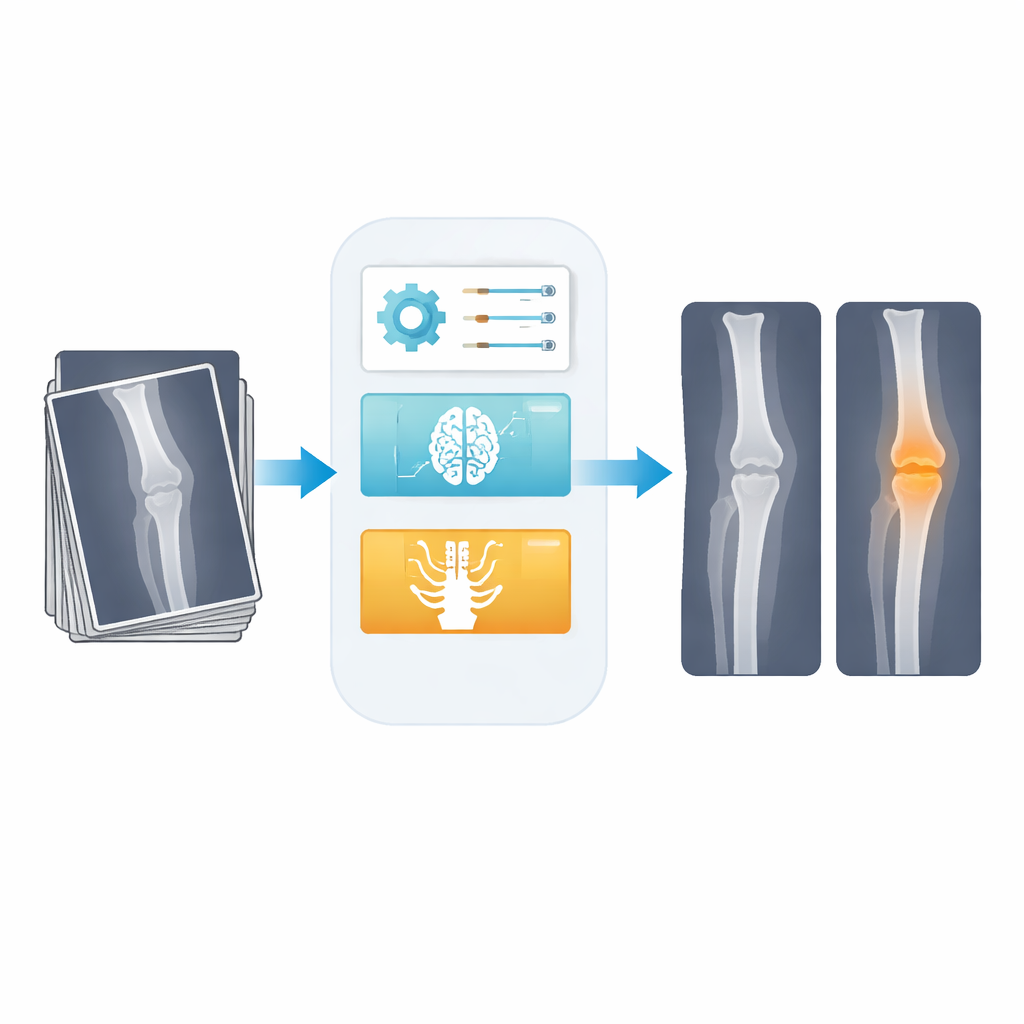

Un assistente AI in tre fasi per le radiografie

Gli autori progettano una pipeline in tre stadi pensata per questa sfida. Primo, un passaggio di filtraggio intelligente pulisce la radiografia grezza. Invece di usare una sfocatura fissa che può cancellare dettagli, impiegano un filtro digitale adattivo i cui parametri sono scelti automaticamente da una routine di ottimizzazione. Questo aumenta il rapporto segnale/rumore da circa 21 a quasi 30 decibel, rendendo l’immagine visibilmente meno rumorosa mantenendo netti i bordi di ossa e tumori. Secondo, una rete di rilevamento compatta, derivata dalla famiglia di modelli YOLO, traccia una casella approssimativa intorno a qualsiasi area che potrebbe contenere un tumore. Terzo, solo questa regione ristretta viene inviata a una rete di segmentazione leggera che delimita i contorni del tumore a livello di pixel, e la decisione finale “normale” versus “tumore” viene presa usando le informazioni provenienti dalla regione segmentata.

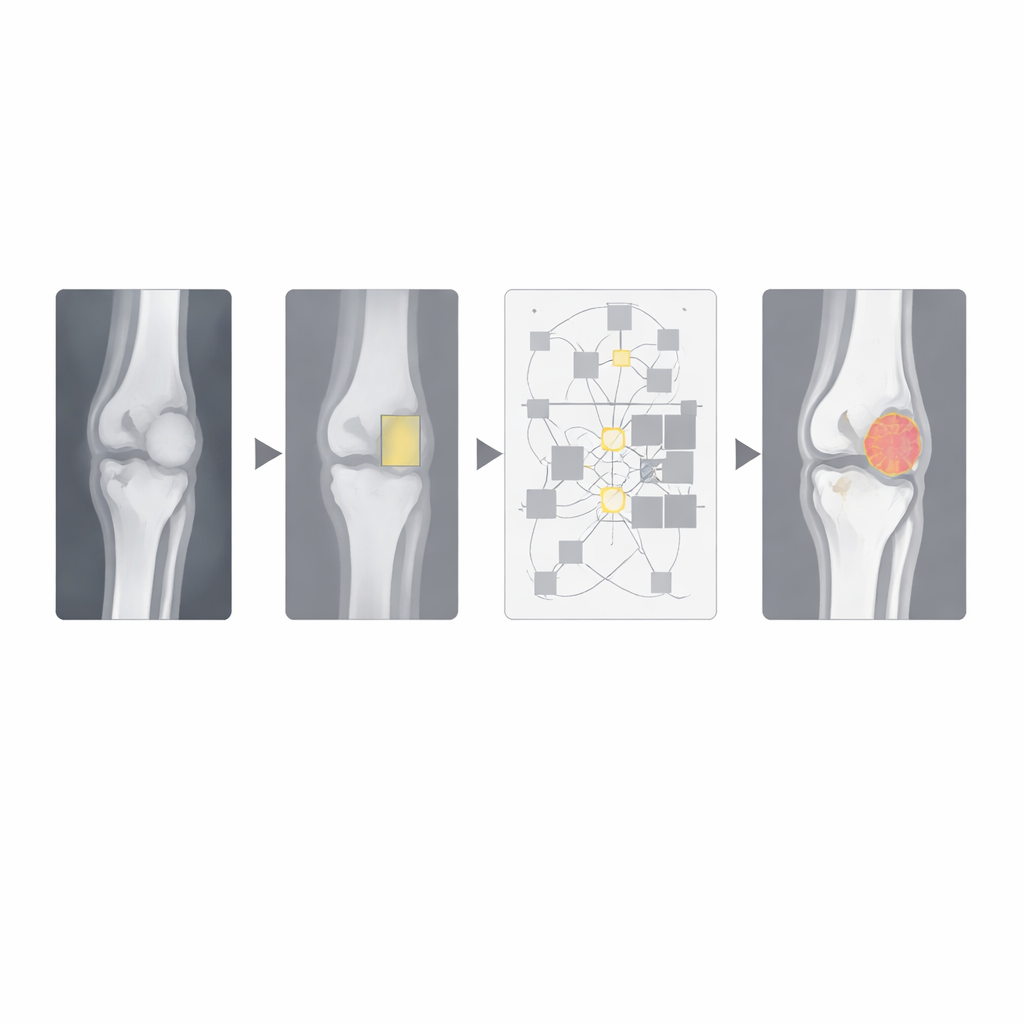

Concentrare l’attenzione dell’AI dove conta

Un’innovazione chiave è il modo in cui il sistema utilizza l’attenzione “relazionale”. Molti modelli visivi moderni si basano su blocchi transformer che confrontano ogni parte dell’immagine con ogni altra parte. Pur essendo potenti, questo diventa costoso su immagini mediche di grandi dimensioni e può rallentare l’uso in tempo reale. Qui, il transformer è applicato solo all’interno della casella tumorale trovata dal rilevatore, più l’osso circostante. All’interno di quest’area più piccola, il modello apprende come diverse regioni si relazionano tra loro, aiutando a distinguere il tessuto tumorale sfumato dall’osso normale. Ignorando il resto dell’immagine, l’approccio riduce drasticamente il carico computazionale pur catturando il contesto a lungo raggio nella regione di rilevanza clinica.

Lasciare che ricerche ispirate alla natura regolino i parametri

La pipeline usa inoltre due metodi di ricerca ispirati alla natura per scegliere automaticamente impostazioni importanti. Un algoritmo regola quanto il filtro leviga la radiografia, bilanciando la rimozione del rumore con la nitidezza dei bordi. Un altro ottimizzatore ibrido, chiamato “fire hawk election”, esplora buone impostazioni di addestramento come tasso di apprendimento, dimensione del batch e dropout. Queste meta-euristiche riducono prove ed errori manuali e aiutano il modello a convergere rapidamente senza sovradattarsi al dataset relativamente piccolo di 809 radiografie annotate da esperti, che include casi sia sani sia con tumore.

Veloce, accurato, ma non ancora pronto per la clinica

Testato con convalida incrociata a cinque fold, il sistema distingue correttamente radiografie normali da quelle con tumore circa il 98,5% delle volte e raggiunge uno score Dice del 97%, indicando una forte concordanza tra i contorni del tumore delineati dall’AI e quelli degli esperti. Usa circa un terzo dei parametri rispetto a reti di segmentazione comuni come UNet e richiede circa 48 millisecondi per immagine su una moderna GPU, permettendo un uso quasi in tempo reale. Tuttavia, gli autori sottolineano che i risultati derivano da un unico dataset pubblico e non riflettono ancora la piena varietà di macchine, ospedali e pazienti nella pratica reale. Presentano il loro framework come uno strumento di supporto alla ricerca promettente che potrebbe infine aiutare i radiologi a individuare e misurare i tumori ossei in modo più coerente, una volta validato in più centri e condizioni cliniche.

Citazione: Natarajan, C., Rajendran, S., Vinmathi, M.S. et al. ROI-guided relational YOLO–SegNet transformer for lightweight bone tumor segmentation and classification from X-ray images. Sci Rep 16, 14603 (2026). https://doi.org/10.1038/s41598-026-44297-8

Parole chiave: tumori ossei, radiografie mediche, deep learning, segmentazione dei tumori, diagnosi assistita dal computer