Clear Sky Science · fr

Transformeur YOLO–SegNet relationnel guidé par ROI pour une segmentation et une classification allégées des tumeurs osseuses à partir de radiographies

Des radiographies plus nettes pour des diagnostics plus précoces

Les tumeurs osseuses sont rares mais graves, et dans de nombreux établissements la première — et parfois la seule — imagerie réalisée est une simple radiographie. Malheureusement, les tumeurs peuvent être peu contrastées, aux contours irréguliers et facilement manquées, en particulier dans les services surchargés ou à ressources limitées. Cet article présente un système d’intelligence artificielle (IA) épuré qui nettoie les radiographies bruitées, zoome sur les régions suspectes et délimite les tumeurs potentielles avec une grande précision, dans l’objectif d’assister les radiologues plutôt que de les remplacer.

Pourquoi les tumeurs osseuses sont difficiles à repérer

Sur une radiographie, une tumeur osseuse ne se présente pas toujours comme une tache nette et circulaire. Ses bords peuvent se fondre dans l’os sain, son intensité peut ressembler à celle des tissus normaux, et d’autres structures peuvent se superposer de façon trompeuse. Ces difficultés sont particulièrement marquées sur les radiographies standards, qui offrent moins de contraste que le scanner ou l’IRM. Beaucoup d’outils d’IA existants se contentent soit de décider « tumeur » versus « pas de tumeur » pour l’image entière, soit exigent une puissance de calcul importante que les petits hôpitaux n’ont pas. La délimitation précise de la tumeur, cruciale pour planifier une chirurgie et suivre l’évolution de la maladie, reste difficile à automatiser efficacement.

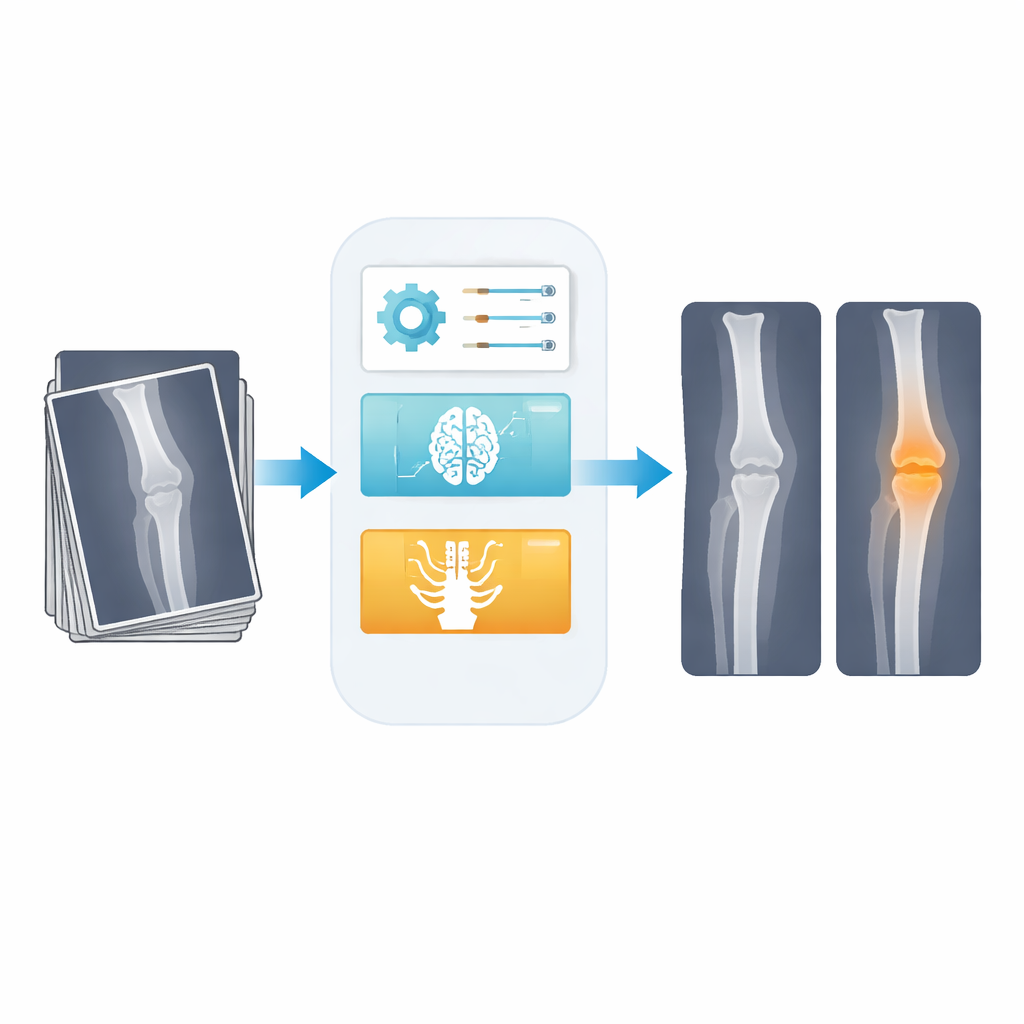

Un assistant IA en trois étapes pour les radiographies

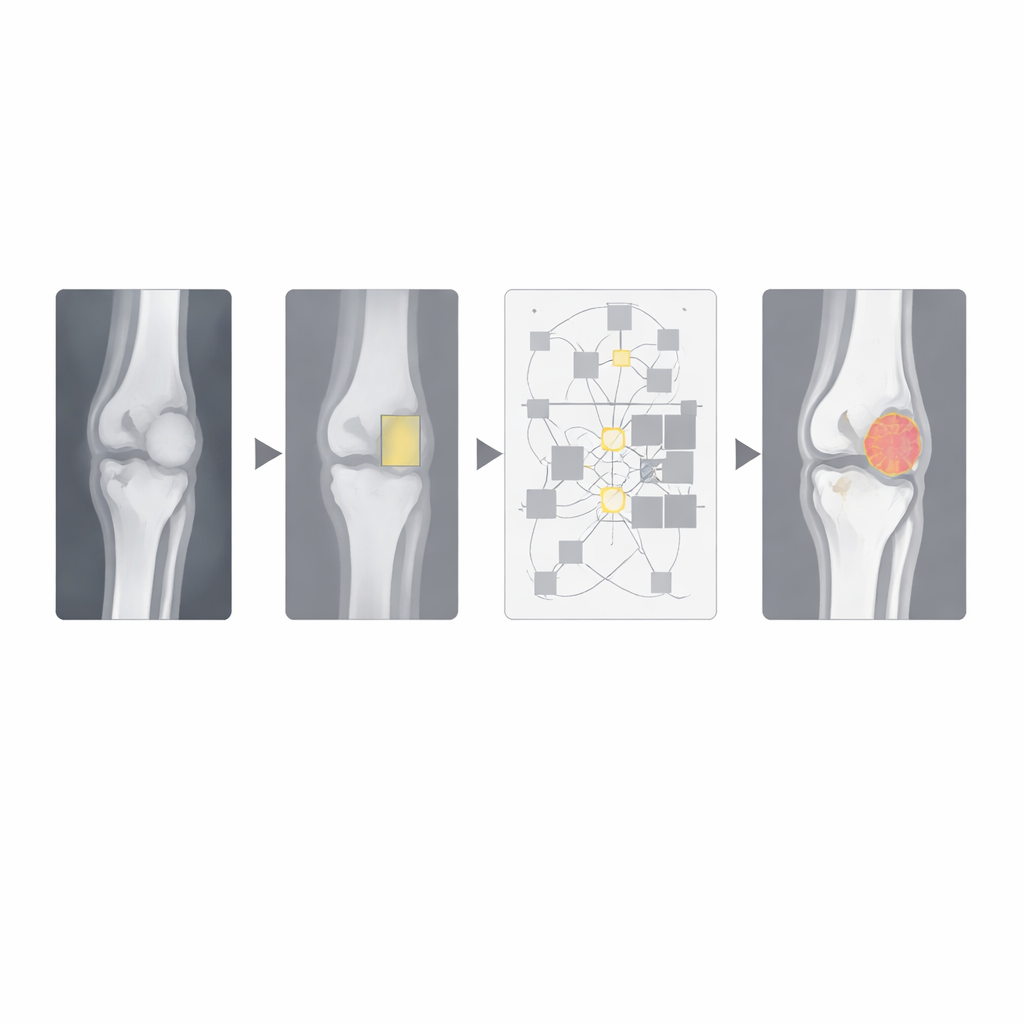

Les auteurs conçoivent une chaîne en trois étapes adaptée à ce défi. D’abord, une étape de filtrage intelligente nettoie la radiographie brute. Plutôt que d’utiliser un flou fixe qui peut effacer les détails, ils emploient un filtre numérique adaptatif dont les paramètres sont choisis automatiquement par une routine d’optimisation. Cela élève le rapport signal/bruit d’environ 21 à près de 30 décibels, ce qui rend l’image sensiblement moins bruitée tout en préservant la netteté des contours des os et des tumeurs. Ensuite, un réseau de détection compact, dérivé de la populaire famille de modèles YOLO, trace une boîte approximative autour de toute région susceptible de contenir une tumeur. Troisièmement, seule cette région restreinte est envoyée à un réseau de segmentation léger qui suit les contours de la tumeur au niveau pixel, et la décision finale « normale » versus « tumeur » est prise en s’appuyant sur les informations extraites de la région segmentée.

Centrer l’attention de l’IA là où cela compte

Une innovation clé réside dans l’usage de l’attention « relationnelle ». Beaucoup de modèles visuels modernes reposent sur des blocs de type transformeur qui comparent chaque partie d’une image à toutes les autres. Bien que puissants, ces mécanismes deviennent coûteux sur de grandes images médicales et peuvent ralentir l’utilisation en temps réel. Ici, le transformeur est appliqué uniquement à l’intérieur de la boîte tumorale trouvée par le détecteur, ainsi qu’aux os voisins. Dans cette zone réduite, le modèle apprend comment différentes zones se relient entre elles, l’aidant à distinguer le tissu tumoral flou de l’os normal. En ignorant le reste de l’image, l’approche réduit fortement la charge de calcul tout en capturant le contexte à longue portée pertinent sur le plan clinique.

Laisser des recherches inspirées de la nature régler les paramètres

La chaîne utilise également deux méthodes de recherche inspirées de la nature pour choisir automatiquement des réglages importants. Un algorithme ajuste la force du lissage appliqué à la radiographie, équilibrant suppression du bruit et netteté des bords. Un autre optimiseur hybride « fire hawk election » recherche de bons hyperparamètres d’entraînement tels que le taux d’apprentissage, la taille de lot et le dropout. Ces métaheuristiques réduisent les essais-erreurs manuels et aident le modèle à converger rapidement sans surapprendre l’ensemble de données relativement restreint de 809 radiographies annotées par des experts, qui comprend des cas sains et des cas tumoraux.

Rapide, précis, mais pas encore prêt pour la clinique

Évalué par validation croisée en cinq plis, le système distingue correctement radiographies normales et radiographies porteuses de tumeur dans environ 98,5 % des cas et atteint un score Dice de 97 %, ce qui indique une forte concordance entre les contours de tumeur produits par l’IA et les tracés experts. Il utilise environ un tiers des paramètres des réseaux de segmentation courants comme UNet et s’exécute en près de 48 millisecondes par image sur une carte graphique moderne, permettant une utilisation quasi temps réel. Cependant, les auteurs soulignent que leurs résultats proviennent d’un jeu de données public unique et ne reflètent pas encore la pleine variété de machines, d’hôpitaux et de patients en pratique réelle. Ils présentent leur cadre comme un outil de recherche prometteur qui pourrait, une fois validé sur plusieurs centres et situations cliniques, aider les radiologues à repérer et mesurer les tumeurs osseuses de manière plus cohérente.

Citation: Natarajan, C., Rajendran, S., Vinmathi, M.S. et al. ROI-guided relational YOLO–SegNet transformer for lightweight bone tumor segmentation and classification from X-ray images. Sci Rep 16, 14603 (2026). https://doi.org/10.1038/s41598-026-44297-8

Mots-clés: tumeurs osseuses, radiographies médicales, apprentissage profond, segmentation de tumeur, diagnostic assisté par ordinateur