Clear Sky Science · sv

AI-modell för bildtexter vid digital patologi av adenokarcinom i endoskopisk histopatologi med multi-instans uppmärksamhetsmekanismer

Varför det spelar roll att göra om preparat till ord

När läkare misstänker magcancer tas små vävnadsprov från magslemhinnan som undersöks i mikroskop. Att tolka dessa preparat är en skicklig och tidskrävande uppgift för patologer, och den skriftliga rapport de tar fram styr alla efterföljande behandlingsbeslut. Denna studie presenterar ett artificiellt intelligenssystem (AI) som gör något förvånansvärt mänskligt: det tittar på digitala bilder av magsbiopsier och skriver automatiskt korta, strukturerade beskrivningar liknande en patologs rapport.

Från glaspreparat till digitalt hjälpmedel

Gastriskt adenocarcinom, en vanlig och allvarlig form av magsäckscancer, diagnostiseras och graderas idag av patologer som visuellt studerar biopsiprov. Under det senaste decenniet har många sjukhus börjat skanna in glasskivor till mycket stora digitala bilder, vilket öppnar möjligheter för AI-verktyg som kan hjälpa vid diagnos. Tidigare system fokuserade mest på ja-eller-nej-frågor, till exempel om cancer förekommer, eller på att tilldela en kategori. Verkliga patologirapporter är dock narrativa: de beskriver cellformer, vävnadsmönster och hur aggressiv tumören verkar. Endast ett fåtal forskningsinsatser har försökt generera dessa beskrivande bildtexter direkt från hela skivbilder, och många av dem är beroende av extra etiketter som anger fördefinierade undertyper — etiketter som är kostsamma och inte alltid tillgängliga.

Ett nytt sätt för AI att läsa många små delar

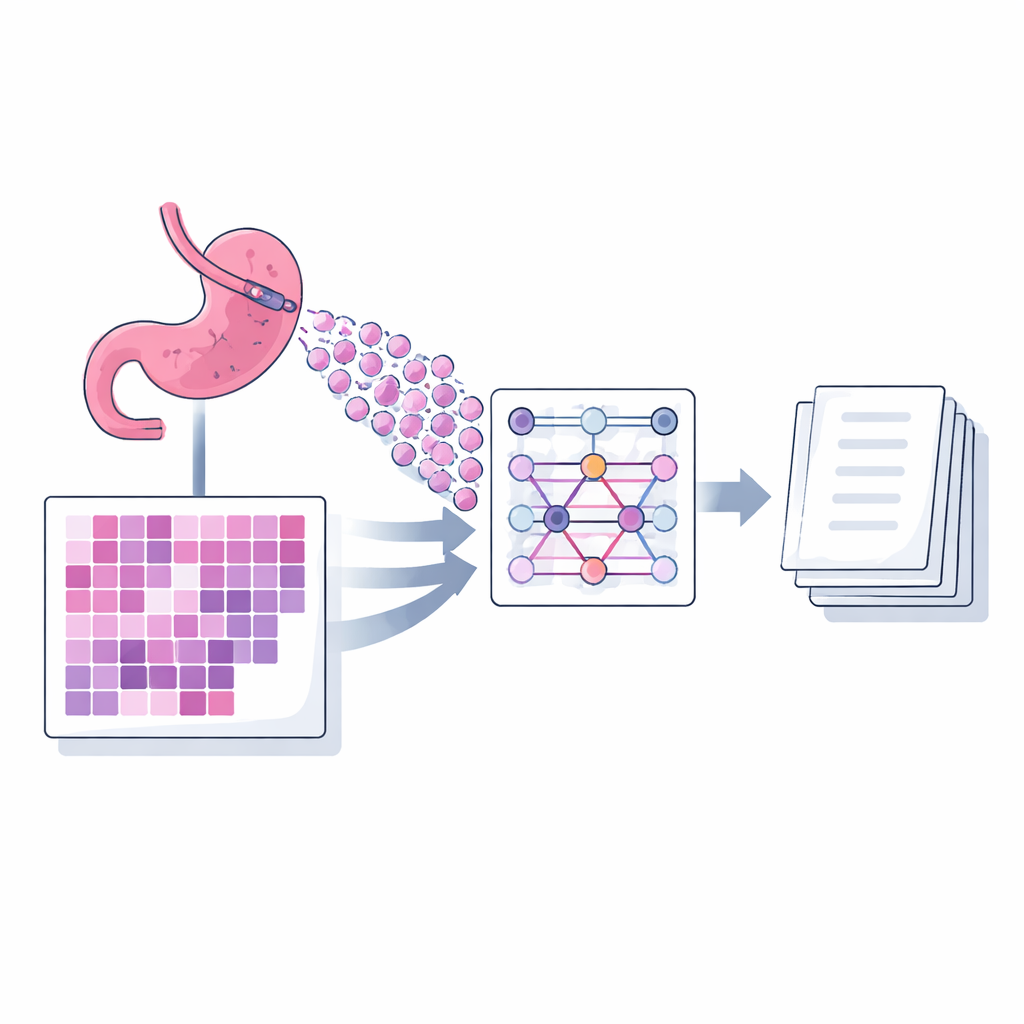

Författarna presenterar en bildtextmodell kallad MIAC (Multi-instance Attention Captioning) som är speciellt utformad för biopsipreparat av gastriskt adenocarcinom. En enskild digital skiva är alldeles för stor för att matas in i en modell på en gång, så den delas upp i många små fyrkantiga bilder, eller patchar. MIAC använder en ansats känd som multi-instansinlärning: i stället för att behandla patcharna som en ordnad sekvens ser modellen dem som en mängd, vilket tillåter att antal och arrangemang av patchar kan variera från skiva till skiva som i rutinpraxis. Ett kraftfullt bildnätverk extraherar först visuella egenskaper från varje patch. Därefter lär en självuppmärksamhetsmekanism, byggd utan positionsinformation, hur starkt varje patch bör påverka den slutliga sammanfattningen. Modellen kombinerar dessa signaler till en enda kompakt representation av hela skivan, som sedan matar en språkmodul som genererar en diagnostisk mening, ett ord i taget.

Träning på riktiga rapporter, test på ett annat sjukhus

För att lära MIAC använde forskarna en publik dataset kallad PatchGastricADC22, som innehåller nästan tusen skannade biopsiskivor från ett japanskt sjukhus. Varje skiva är kopplad till en kort diagnostisk mening hämtad från den ursprungliga patologirapporten och omvandlad till standardiserad terminologi. Skivorna delades upp i hundratals patchar, och modellen tränades att producera den ursprungliga bildtexten när den gavs en delmängd av dessa patchar. Prestanda mättes med standardiserade språkjämförelsescore som utvärderar hur nära AI-genererade beskrivningar ligger experttexten. MIAC överträffade en tidigare toppmetod över alla mått, särskilt när den tilläts se fler patchar per skiva under träning, vilket tyder på att den bättre fångade skive-nivåbilden från spridda lokala vyer.

Hantering av skillnader mellan sjukhus

En avgörande fråga för alla medicinska AI-system är om de fortfarande fungerar när data kommer från en ny plats. Teamet testade därför MIAC på en oberoende uppsättning magsbiopsier insamlade vid ett annat sjukhus, med bildtexter skrivna av en annan patolog. Dessa bilder skilde sig i färg på grund av lokala färgningar och skanningsrutiner, ett vanligt problem som kan ställa till det för bildbaserade modeller. Forskarna använde en vanligt använd färgnormaliseringsteknik som justerar färgtonerna för att närma sig träningsskivornas. Även utan ytterligare finjustering producerade MIAC kliniskt meningsfulla bildtexter på denna externa dataset, och dess prestanda förbättrades när färgnormalisering tillämpades och när fler patchar provtogs från varje skiva.

Vad detta kan innebära för patientvård

MIAC är inte avsett att ersätta patologer; istället syftar det till att utarbeta kortfattade, standardiserade beskrivningar som experter snabbt kan granska och redigera. I stressade kliniker eller regioner med begränsad specialisttillgång kan ett sådant verktyg förkorta rapporteringstiden, minska variation i formuleringar och flagga fall med komplexa mönster för närmare granskning. Studien lyfter också fram nuvarande begränsningar: prestanda sjunker fortfarande när modellen ställs inför skivor från nya institutioner eller ovanliga vävnadsmönster, och automatiska språkscore fångar inte fullständigt klinisk användbarhet. Författarna argumenterar för att rikare, multicentriska dataset, smartare sätt att välja vilka patchar som ska inspekteras och direkt återkoppling från patologer kommer att behövas innan sådana bildtextgenererande system kan införlivas säkert i vardagliga diagnostiska arbetsflöden.

Citering: Lee, Y., Bai, K., Kim, Y. et al. AI caption generation model for digital pathology of adenocarcinoma in endoscopic histopathology using multi-instance attention mechanisms. Sci Rep 16, 13244 (2026). https://doi.org/10.1038/s41598-026-37455-5

Nyckelord: magcancer, digital patologi, medicinsk AI, bildtextgenerering, histopatologi