Clear Sky Science · it

Modello di generazione di didascalie AI per la patologia digitale dell’adenocarcinoma in istopatologia endoscopica usando meccanismi di attenzione multi‑istanza

Perché trasformare i vetrini in parole è importante

Quando i medici sospettano un cancro allo stomaco, vengono prelevati piccoli campioni di tessuto dalla mucosa gastrica e esaminati al microscopio. Interpretare questi vetrini è un compito qualificato e dispendioso in termini di tempo per i patologi, e il referto scritto che ne deriva guida ogni decisione terapeutica successiva. Questo studio presenta un sistema di intelligenza artificiale (IA) che fa qualcosa di sorprendentemente umano: guarda immagini digitali di vetrini di biopsia gastrica e scrive automaticamente brevi descrizioni strutturate simili a un referto di patologo.

Dal vetrino di vetro all’aiuto digitale

L’adenocarcinoma gastrico, una forma comune e letale di cancro dello stomaco, viene oggi diagnosticato e classificato dai patologi che studiano visivamente i campioni bioptici. Nell’ultimo decennio molti ospedali hanno iniziato a scannerizzare i vetrini in grandi immagini digitali, aprendo la strada a strumenti di IA che possono supportare la diagnosi. I sistemi precedenti si concentravano principalmente su domande binarie, come la presenza o meno di tumore, o sull’assegnazione di una categoria. Tuttavia, i referti patologici reali sono di tipo narrativo: descrivono la morfologia cellulare, i pattern tissutali e quanto il tumore appaia aggressivo. Solo pochi lavori di ricerca hanno provato a generare direttamente queste didascalie descrittive a partire da immagini di interi vetrini, e molti di essi dipendono da etichette aggiuntive che indicano sottotipi predefiniti, etichette costose e non sempre disponibili.

Un nuovo modo per l’IA di leggere molti piccoli frammenti

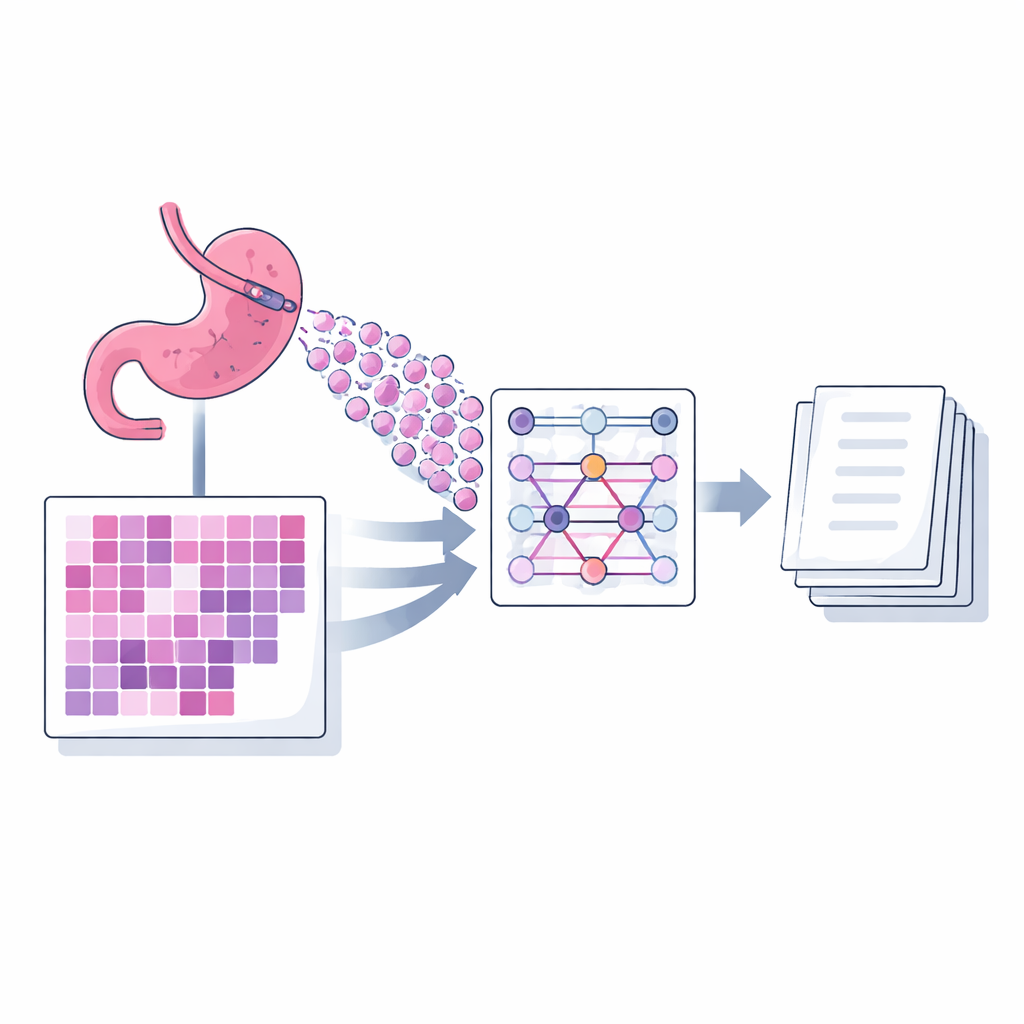

Gli autori presentano un modello di captioning chiamato MIAC (Multi‑instance Attention Captioning) progettato specificamente per i vetrini bioptici di adenocarcinoma gastrico. Un singolo vetrino digitale è troppo grande per essere inserito nel modello tutto in una volta, quindi viene suddiviso in molte piccole immagini quadrate, o patch. MIAC usa un approccio noto come apprendimento multi‑istanza: invece di trattare queste patch come una sequenza ordinata, le considera come un insieme, permettendo che il numero e la disposizione delle patch varino da vetrino a vetrino come avviene nella pratica routinaria. Una potente rete per immagini estrae prima caratteristiche visive da ogni patch. Poi un meccanismo di self‑attention, costruito senza informazioni di posizione, apprende quanto ogni patch debba influenzare il sommario finale. Il modello combina questi segnali in una singola rappresentazione compatta dell’intero vetrino, che alimenta quindi un modulo linguistico che genera una didascalia diagnostica di lunghezza frase, una parola alla volta.

Addestramento su referti reali, test in un ospedale diverso

Per insegnare a MIAC, i ricercatori hanno usato un dataset pubblico chiamato PatchGastricADC22, che contiene quasi mille vetrini bioptici scansionati provenienti da un ospedale giapponese. Ciascun vetrino è associato a una breve frase diagnostica estratta dal referto patologico originale e convertita in terminologia standardizzata. I vetrini sono stati suddivisi in centinaia di patch e il modello è stato addestrato a produrre la didascalia originale quando gli veniva fornito un sottoinsieme di queste patch. Le prestazioni sono state misurate con punteggi standard di confronto linguistico che valutano quanto le descrizioni generate dall’IA si avvicinino al testo degli esperti. MIAC ha superato un metodo precedente allo stato dell’arte su tutti i metrici, specialmente quando durante l’addestramento gli è stato consentito di vedere più patch per vetrino, suggerendo che catturava meglio l’immagine a livello di vetrino a partire da viste locali disperse.

Gestire le differenze tra ospedali

Una domanda cruciale per qualsiasi sistema di IA medica è se mantiene le prestazioni quando i dati provengono da un ambiente nuovo. Il team ha quindi testato MIAC su un set indipendente di vetrini di biopsia gastrica raccolti in un altro ospedale, con didascalie redatte da un diverso patologo. Queste immagini differivano nei colori a causa delle pratiche locali di colorazione e scansione, un problema comune che può ostacolare i modelli basati su immagini. I ricercatori hanno applicato una tecnica di normalizzazione del colore ampiamente usata, che adegua le tonalità di colorazione per assomigliare maggiormente a quelle dei vetrini di addestramento. Anche senza alcun fine‑tuning aggiuntivo, MIAC ha prodotto didascalie clinicamente significative su questo dataset esterno, e le sue prestazioni sono migliorate quando è stata applicata la normalizzazione del colore e quando sono state campionate più patch per vetrino.

Cosa potrebbe significare per la cura del paziente

MIAC non è pensato per sostituire i patologi; mira invece a redigere descrizioni concise e standardizzate che gli esperti possano rapidamente rivedere e modificare. In cliniche affollate o in aree con accesso limitato a specialisti, uno strumento del genere potrebbe accorciare i tempi di refertazione, ridurre la variabilità nella formulazione e segnalare i casi con pattern complessi per un’attenzione più accurata. Lo studio evidenzia anche i limiti attuali: le prestazioni calano ancora quando il modello si confronta con vetrini provenienti da nuove istituzioni o con pattern tissutali insoliti, e i punteggi linguistici automatici non catturano pienamente l’utilità clinica. Gli autori sostengono che saranno necessari dataset più ricchi e multicentrici, modi più intelligenti di scegliere quali patch ispezionare e un feedback diretto dai patologi prima che sistemi di generazione di didascalie possano essere integrati in modo sicuro nei flussi diagnostici quotidiani.

Citazione: Lee, Y., Bai, K., Kim, Y. et al. AI caption generation model for digital pathology of adenocarcinoma in endoscopic histopathology using multi-instance attention mechanisms. Sci Rep 16, 13244 (2026). https://doi.org/10.1038/s41598-026-37455-5

Parole chiave: cancro gastrico, patologia digitale, IA medica, didascalia di immagini, istopatologia