Clear Sky Science · pl

Model generowania podpisów AI dla cyfrowej patologii gruczolakoraka w histopatologii endoskopowej z wykorzystaniem mechanizmów uwagi wieloprzykładowej

Dlaczego przekształcanie preparatów w słowa ma znaczenie

Kiedy lekarze podejrzewają raka żołądka, pobierane są drobne próbki tkanki z błony śluzowej żołądka i badane pod mikroskopem. Interpretacja tych preparatów to zadanie wymagające umiejętności i czasu dla patologów, a sporządzony przez nich pisemny opis kieruje wszystkimi późniejszymi decyzjami terapeutycznymi. W tym badaniu przedstawiono system sztucznej inteligencji (AI), który robi coś zaskakująco ludzkiego: ogląda cyfrowe obrazy wycinków z żołądka i automatycznie tworzy krótkie, ustrukturyzowane opisy podobne do raportu patologicznego.

Od szkiełka do cyfrowego asystenta

Gruczolakorak żołądka, powszechna i groźna postać raka tego narządu, jest obecnie rozpoznawany i stopniowany przez patologów, którzy wizualnie analizują próbki biopsji. W ciągu ostatniej dekady wiele szpitali zaczęło skanować szkiełka do bardzo dużych obrazów cyfrowych, co otworzyło drogę dla narzędzi AI wspomagających diagnostykę. Wcześniejsze systemy koncentrowały się głównie na pytaniach „tak‑lub‑nie”, na przykład czy obecny jest nowotwór, albo na przypisywaniu kategorii. Tymczasem prawdziwe raporty patologiczne są narracyjne: opisują kształt komórek, wzorce tkankowe i agresywność guza. Tylko nieliczne prace badawcze próbowały generować takie opisowe podpisy bezpośrednio z obrazów całych preparatów, a wiele z nich opiera się na dodatkowych etykietach wskazujących z góry określone podtypy, które są kosztowne i nie zawsze dostępne.

Nowy sposób, w jaki AI czyta wiele małych fragmentów

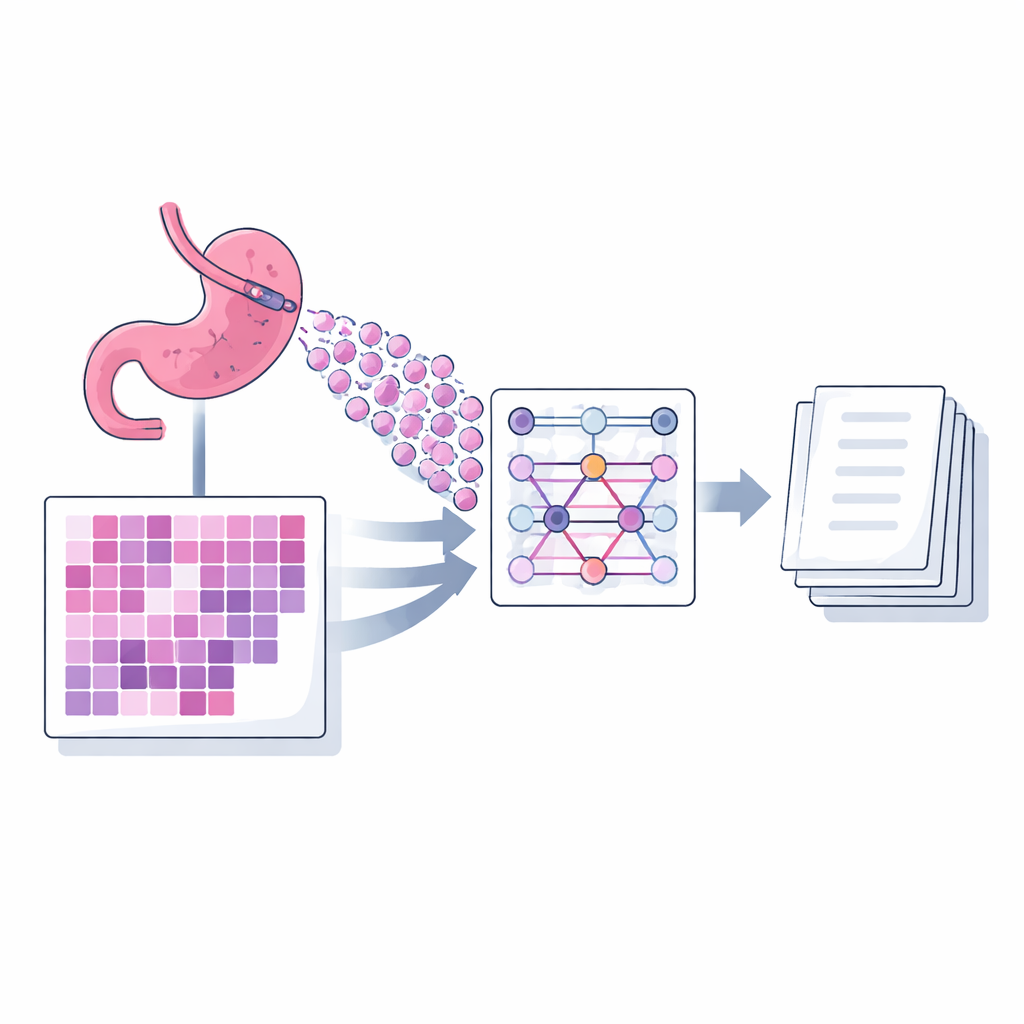

Autorzy przedstawiają model podpisujący o nazwie MIAC (Multi‑instance Attention Captioning) zaprojektowany specjalnie dla wycinków biopsji gruczolakoraka żołądka. Pojedynczy obraz cyfrowy preparatu jest zbyt duży, by wprowadzić go do modelu na raz, więc dzieli się go na wiele małych kwadratowych obrazów, zwanych patchami. MIAC zastosował podejście znane jako uczenie wieloprzykładowe: zamiast traktować te patche jako uporządkowaną sekwencję, widzi je jako zbiór, co pozwala na zmienną liczbę i rozmieszczenie fragmentów w zależności od preparatu, jak to ma miejsce w praktyce. Potężna sieć obrazowa najpierw wydobywa cechy wizualne z każdego patcha. Następnie mechanizm self‑attention, zbudowany bez informacji o położeniu, uczy się, jak silnie każdy patch powinien wpływać na końcowe streszczenie. Model łączy te sygnały w jedną zwartą reprezentację całego preparatu, która jest następnie przekazywana do modułu językowego generującego zdanie diagnostyczne — słowo po słowie.

Trenowanie na prawdziwych raportach, testowanie w innym szpitalu

Aby nauczyć MIAC, badacze użyli publicznego zestawu danych o nazwie PatchGastricADC22, który zawiera niemal tysiąc zeskanowanych wycinków biopsji z japońskiego szpitala. Każdy preparat jest sparowany z krótkim zdaniem diagnostycznym zaczerpniętym z oryginalnego raportu patologicznego i przekształconym do znormalizowanej terminologii. Preparaty podzielono na setki patchy, a model trenowano tak, by generował oryginalny podpis, mając dostęp do podzbioru tych fragmentów. Wydajność mierzono standardowymi miarami porównującymi język, które oceniają, jak bliskie są opisy wygenerowane przez AI tekstowi eksperckiemu. MIAC przewyższył poprzednią metodę stanowiącą ówczesny stan wiedzy we wszystkich metrykach, szczególnie gdy w trakcie treningu mógł zobaczyć więcej patchy na preparat, co sugeruje, że lepiej uchwycił obraz całego szkła bazując na rozproszonych lokalnych widokach.

Radzenie sobie z różnicami między szpitalami

Kluczowe pytanie dla każdego medycznego systemu AI brzmi, czy działa on równie dobrze, gdy dane pochodzą z innego miejsca. Zespół przetestował więc MIAC na niezależnym zbiorze wycinków biopsji żołądka zebranych w innym szpitalu, z podpisami napisanymi przez innego patologanta. Obrazy różniły się kolorystyką z powodu lokalnych praktyk barwienia i skanowania — częsty problem, który może utrudniać działanie modeli opartych na obrazie. Badacze zastosowali powszechnie używaną technikę normalizacji koloru, która dopasowuje odcienie barwienia, aby były bardziej zgodne z danymi treningowymi. Nawet bez dodatkowego dostrajania MIAC wygenerował klinicznie znaczące podpisy dla tego zewnętrznego zbioru, a jego wydajność poprawiła się po zastosowaniu normalizacji koloru i po zwiększeniu liczby pobieranych patchy z każdego preparatu.

Co to może znaczyć dla opieki nad pacjentem

MIAC nie ma na celu zastąpienia patologów; ma natomiast szkicować zwięzłe, ustandaryzowane opisy, które eksperci mogą szybko przejrzeć i edytować. W zatłoczonych klinikach lub regionach z ograniczonym dostępem do specjalistów takie narzędzie mogłoby skrócić czas sporządzania raportów, zmniejszyć zmienność sformułowań i wskazywać przypadki złożone wzorami wymagające dokładniejszej analizy. Badanie podkreśla także istniejące ograniczenia: wydajność nadal spada, gdy model styka się z preparatami z nowych instytucji lub z nietypowymi wzorcami tkankowymi, a automatyczne miary językowe nie oddają w pełni wartości klinicznej. Autorzy argumentują, że przed bezpiecznym wdrożeniem takich systemów do codziennej diagnostyki potrzebne będą bogatsze, wieloośrodkowe zbiory danych, mądrzejsze metody wyboru patchy do analizy oraz bezpośrednia informacja zwrotna od patologów.

Cytowanie: Lee, Y., Bai, K., Kim, Y. et al. AI caption generation model for digital pathology of adenocarcinoma in endoscopic histopathology using multi-instance attention mechanisms. Sci Rep 16, 13244 (2026). https://doi.org/10.1038/s41598-026-37455-5

Słowa kluczowe: rak żołądka, patologia cyfrowa, sztuczna inteligencja medyczna, opisywanie obrazów, histopatologia