Clear Sky Science · es

Modelo de generación de leyendas por IA para patología digital de adenocarcinoma en histopatología endoscópica usando mecanismos de atención multi‑instancia

Por qué convertir portaobjetos en palabras importa

Cuando los médicos sospechan cáncer de estómago, se toman pequeñas muestras de tejido del revestimiento gástrico y se examinan al microscopio. Interpretar estos portaobjetos es una tarea especializada y que consume tiempo para los patólogos, y el informe escrito que producen guía todas las decisiones de tratamiento posteriores. Este estudio presenta un sistema de inteligencia artificial (IA) que hace algo sorprendentemente humano: mira imágenes digitales de biopsias gástricas y escribe automáticamente descripciones cortas y estructuradas similares al informe de un patólogo.

Del portaobjetos de vidrio al ayudante digital

El adenocarcinoma gástrico, una forma común y letal de cáncer de estómago, se diagnostica y gradúa actualmente por patólogos que estudian visualmente las muestras de biopsia. En la última década, muchos hospitales han empezado a escanear portaobjetos en imágenes digitales muy grandes, lo que abre la puerta a herramientas de IA que pueden ayudar en el diagnóstico. Los sistemas anteriores se centraron principalmente en preguntas de sí o no, como si hay cáncer presente, o en asignar una categoría. Sin embargo, los informes patológicos reales son narrativos: describen la morfología celular, los patrones tisulares y qué tan agresivo parece el tumor. Solo unos pocos trabajos han intentado generar estas leyendas descriptivas directamente a partir de imágenes de portaobjetos completos, y muchos dependen de etiquetas adicionales que indican subtipos predefinidos, las cuales son costosas y no siempre están disponibles.

Una nueva manera para que la IA lea muchas piezas pequeñas

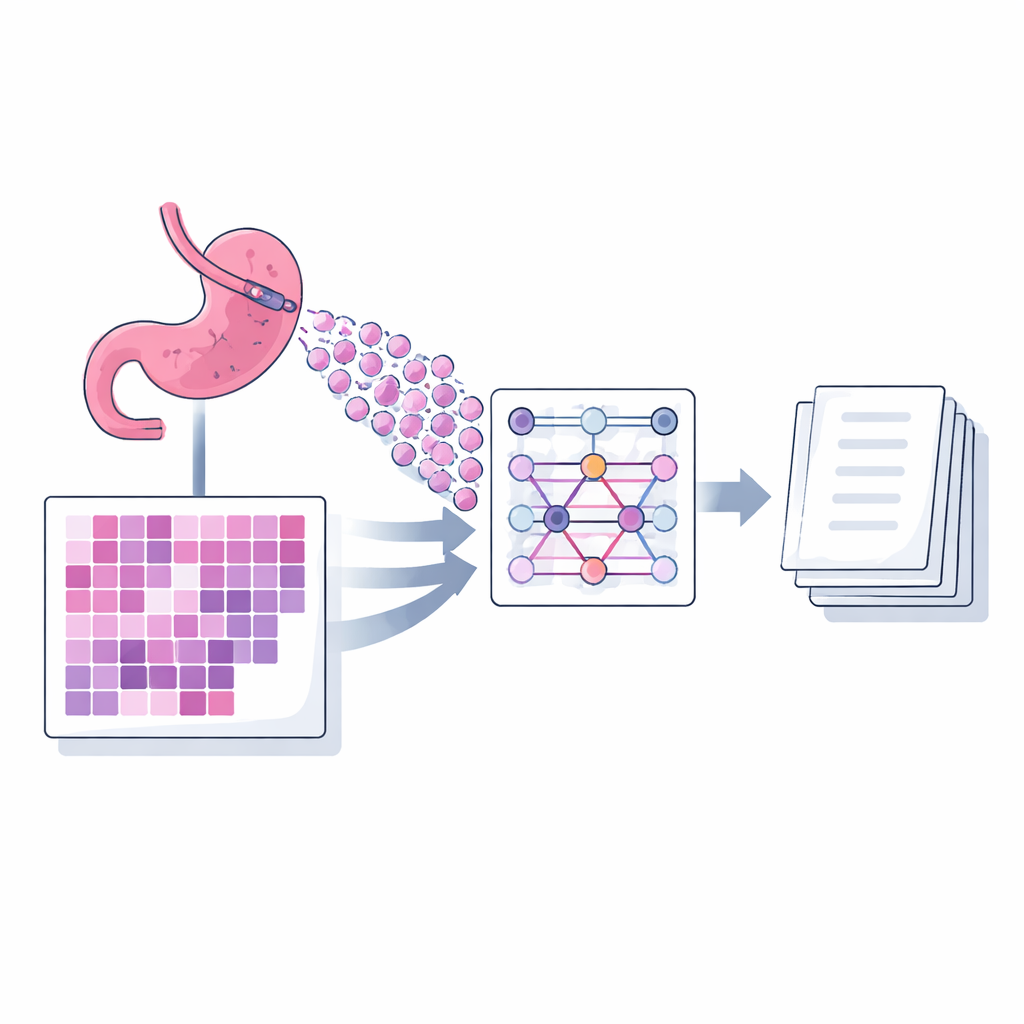

Los autores presentan un modelo de generación de leyendas llamado MIAC (Multi‑instance Attention Captioning) diseñado específicamente para portaobjetos de biopsia de adenocarcinoma gástrico. Un solo portaobjetos digital es demasiado grande para introducirlo entero en un modelo, por lo que se divide en muchas imágenes cuadradas pequeñas, o parches. MIAC usa un enfoque conocido como aprendizaje multi‑instancia: en lugar de tratar estos parches como una secuencia ordenada, los considera como un conjunto, permitiendo que el número y la disposición de parches varíen de un portaobjetos a otro, como ocurre en la práctica rutinaria. Una potente red de imágenes extrae primero características visuales de cada parche. Luego, un mecanismo de auto‑atención, construido sin información de posición, aprende qué tan fuertemente cada parche debe influir en el resumen final. El modelo combina estas señales en una única representación compacta del portaobjetos completo, que alimenta a un módulo de lenguaje que genera una leyenda diagnóstica de longitud de oración, palabra por palabra.

Entrenamiento con informes reales, prueba en otro hospital

Para enseñar a MIAC, los investigadores usaron un conjunto de datos público llamado PatchGastricADC22, que contiene casi mil portaobjetos de biopsia escaneados procedentes de un hospital japonés. Cada portaobjetos está emparejado con una breve frase diagnóstica tomada del informe de patología original y convertida a terminología estandarizada. Los portaobjetos se dividieron en cientos de parches, y el modelo se entrenó para producir la leyenda original cuando se le daba un subconjunto de esos parches. El rendimiento se midió con puntuaciones estándar de comparación de lenguaje que evalúan cuán de cerca las descripciones generadas por la IA coinciden con el texto experto. MIAC superó a un método previo de última generación en todas las métricas, especialmente cuando se le permitió ver más parches por portaobjetos durante el entrenamiento, lo que sugiere que capturó mejor la visión a nivel de portaobjetos a partir de vistas locales dispersas.

Manejo de las diferencias entre hospitales

Una gran pregunta para cualquier sistema de IA médica es si sigue funcionando cuando los datos provienen de un lugar nuevo. El equipo, por tanto, probó MIAC en un conjunto independiente de portaobjetos de biopsia gástrica recogidos en otro hospital, con leyendas redactadas por otro patólogo. Estas imágenes diferían en color debido a prácticas locales de tinción y escaneado, un problema común que puede confundir a los modelos basados en imágenes. Los investigadores aplicaron una técnica de normalización de color ampliamente usada, que ajusta los tonos de tinción para que se parezcan más a los de las diapositivas de entrenamiento. Incluso sin ajuste fino adicional, MIAC produjo leyendas clínicamente significativas en este conjunto externo, y su rendimiento mejoró cuando se aplicó la normalización de color y cuando se muestrearon más parches de cada portaobjetos.

Qué podría significar para la atención al paciente

MIAC no pretende reemplazar a los patólogos; en cambio, aspira a redactar descripciones concisas y estandarizadas que los expertos puedan revisar y editar rápidamente. En clínicas con mucha carga de trabajo o en regiones con acceso limitado a especialistas, tal herramienta podría acortar el tiempo de elaboración de informes, reducir la variabilidad del lenguaje y señalar casos con patrones complejos para una atención más detallada. El estudio también subraya límites actuales: el rendimiento aún disminuye cuando el modelo se enfrenta a portaobjetos de nuevas instituciones o a patrones tisulares inusuales, y las puntuaciones automáticas de lenguaje no capturan por completo la utilidad clínica. Los autores sostienen que serán necesarios conjuntos de datos más ricos y multicéntricos, formas más inteligentes de elegir qué parches inspeccionar y retroalimentación directa de los patólogos antes de que sistemas generadores de leyendas como este puedan integrarse con seguridad en los flujos de trabajo diagnósticos cotidianos.

Cita: Lee, Y., Bai, K., Kim, Y. et al. AI caption generation model for digital pathology of adenocarcinoma in endoscopic histopathology using multi-instance attention mechanisms. Sci Rep 16, 13244 (2026). https://doi.org/10.1038/s41598-026-37455-5

Palabras clave: cáncer gástrico, patología digital, IA médica, generación de leyendas de imágenes, histopatología