Clear Sky Science · de

KI-Modell zur Bildunterschriftenerzeugung für die digitale Pathologie von Adenokarzinomen in endoskopischen Histopathologieproben mithilfe von Multi‑Instance‑Aufmerksamkeitsmechanismen

Warum es wichtig ist, Schnitte in Worte zu fassen

Wenn Ärztinnen und Ärzte einen Magenkrebs vermuten, werden winzige Gewebeproben aus der Magenschleimhaut entnommen und mikroskopisch untersucht. Das Befunden dieser Schnitte ist eine anspruchsvolle und zeitaufwändige Aufgabe für Pathologinnen und Pathologen, und der schriftliche Befund, den sie erstellen, steuert jede anschließende Behandlungsentscheidung. Diese Studie stellt ein System der künstlichen Intelligenz (KI) vor, das etwas überraschend Menschliches leistet: Es betrachtet digitale Bilder von Magenbiopsie‑Schnitten und verfasst automatisch kurze, strukturierte Beschreibungen, die einem Pathologiebericht ähneln.

Vom Objektträger zur digitalen Assistenz

Gastrisches Adenokarzinom, eine häufige und schwere Form des Magenkrebses, wird derzeit von Pathologinnen und Pathologen diagnostiziert und graduiert, die Biopsien visuell beurteilen. In den letzten zehn Jahren haben viele Krankenhäuser begonnen, Glasobjektträger in sehr große digitale Bilder zu scannen, was den Einsatz von KI‑Werkzeugen zur Unterstützung der Diagnostik ermöglicht. Frühere Systeme konzentrierten sich überwiegend auf Ja‑/Nein‑Fragen, etwa ob Krebs vorhanden ist, oder auf die Zuordnung zu Kategorien. Reale Pathologieberichte sind jedoch narrativ: Sie beschreiben Zellformen, Gewebsmuster und wie aggressiv der Tumor wirkt. Nur wenige Forschungsarbeiten haben versucht, diese beschreibenden Bildunterschriften direkt aus ganzen Objektträgerbildern zu erzeugen, und viele davon sind auf zusätzliche Labels angewiesen, die vordefinierte Subtypen angeben – diese sind teuer und nicht immer verfügbar.

Ein neuer Weg, wie KI viele kleine Bereiche liest

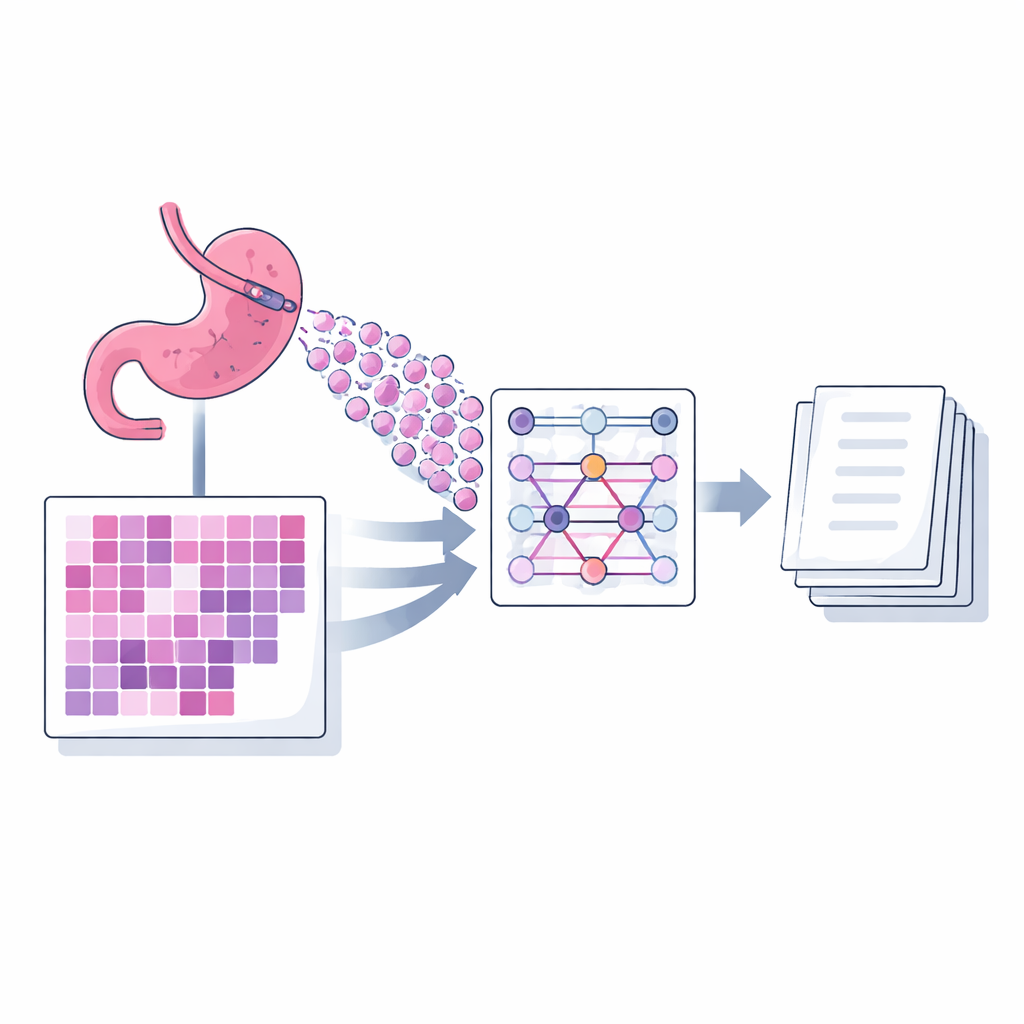

Die Autorinnen und Autoren stellen ein Beschriftungsmodell namens MIAC (Multi‑instance Attention Captioning) vor, das speziell für Biopsieschnitte des Magenadenokarzinoms entwickelt wurde. Ein einzelnes digitales Objektträgerbild ist viel zu groß, um es auf einmal in ein Modell einspeisen zu können; daher wird es in viele kleine quadratische Ausschnitte oder Patches unterteilt. MIAC nutzt einen Ansatz, der als Multi‑Instance‑Learning bekannt ist: Anstatt diese Patches als geordnete Folge zu behandeln, sieht es sie als Menge, sodass Anzahl und Anordnung der Patches von Schnitt zu Schnitt variieren können, wie es in der Routine vorkommt. Ein leistungsfähiges Bildnetz extrahiert zunächst visuelle Merkmale aus jedem Patch. Anschließend lernt ein Self‑Attention‑Mechanismus, der ohne Positionsinformationen aufgebaut ist, wie stark jeder Patch die endgültige Zusammenfassung beeinflussen sollte. Das Modell kombiniert diese Signale zu einer kompakten Repräsentation des gesamten Objektträgers, die dann ein Sprachmodul speist, das Wort für Wort eine diagnostische Satzlänge‑Bildunterschrift generiert.

Training an realen Befunden, Test in einem anderen Krankenhaus

Um MIAC zu trainieren, nutzten die Forschenden einen öffentlichen Datensatz namens PatchGastricADC22, der fast tausend eingesannte Biopsieschnitte aus einem japanischen Krankenhaus enthält. Jeder Schnitt ist mit einem kurzen diagnostischen Satz aus dem ursprünglichen Pathologiebericht gekoppelt und in standardisierte Terminologie überführt. Die Objektträger wurden in Hunderte von Patches zerlegt, und das Modell wurde darauf trainiert, die ursprüngliche Bildunterschrift zu erzeugen, wenn ihm eine Teilmenge dieser Patches gegeben wurde. Die Leistung wurde mit gängigen Sprachvergleichsmetriken gemessen, die bewerten, wie nah KI‑generierte Beschreibungen an Expertentexten liegen. MIAC übertraf eine frühere Bestmethode bei allen Metriken, insbesondere wenn es beim Training erlaubt war, mehr Patches pro Objektträger zu sehen, was darauf hindeutet, dass es besser darin war, das objektträgerweite Bild aus verstreuten lokalen Ansichten zu erfassen.

Umgang mit Unterschieden zwischen Krankenhäusern

Eine zentrale Frage für jedes medizinische KI‑System ist, ob es noch funktioniert, wenn die Daten aus einer neuen Quelle stammen. Das Team testete MIAC daher an einem unabhängigen Satz von Magenbiopsien, die in einem anderen Krankenhaus gesammelt und von einer anderen Pathologin bzw. einem anderen Pathologen beschriftet wurden. Diese Bilder unterschieden sich in der Färbung aufgrund lokaler Färbe‑ und Scanpraktiken – ein häufiges Problem, das bildbasierte Modelle beeinträchtigen kann. Die Forschenden wandten eine weit verbreitete Farbnormalisierungstechnik an, die die Farbnuancen der Färbung so anpasst, dass sie den Trainingsbildern näherkommen. Selbst ohne weiteres Fine‑Tuning erzeugte MIAC klinisch sinnvolle Bildunterschriften für diesen externen Datensatz, und die Leistung verbesserte sich, wenn Farbnormalisierung angewendet wurde und mehr Patches pro Objektträger entnommen wurden.

Was das für die Patientenversorgung bedeuten könnte

MIAC soll Pathologinnen und Pathologen nicht ersetzen; es zielt darauf ab, knappe, standardisierte Beschreibungen zu entwerfen, die Expertinnen und Experten schnell überprüfen und bearbeiten können. In vielbeschäftigten Kliniken oder Regionen mit eingeschränktem Spezialistenzugang könnte ein solches Werkzeug die Befundzeit verkürzen, die Variabilität in der Wortwahl verringern und Fälle mit komplexen Mustern zur genaueren Überprüfung markieren. Die Studie hebt auch aktuelle Grenzen hervor: Die Leistung sinkt weiterhin, wenn das Modell mit Objektträgern aus neuen Institutionen oder mit ungewöhnlichen Gewebemustern konfrontiert wird, und automatisierte Sprachmetriken erfassen nicht vollständig die klinische Nützlichkeit. Die Autorinnen und Autoren argumentieren, dass reichhaltigere, multizentrische Datensätze, intelligentere Methoden zur Auswahl der zu betrachtenden Patches und direktes Feedback von Pathologinnen und Pathologen nötig sind, bevor solche systems zur Erzeugung von Bildunterschriften sicher in die tägliche diagnostische Praxis integriert werden können.

Zitation: Lee, Y., Bai, K., Kim, Y. et al. AI caption generation model for digital pathology of adenocarcinoma in endoscopic histopathology using multi-instance attention mechanisms. Sci Rep 16, 13244 (2026). https://doi.org/10.1038/s41598-026-37455-5

Schlüsselwörter: Magenkrebs, digitale Pathologie, medizinische KI, Bildbeschriftung, Histopathologie