Clear Sky Science · ru

Прогнозирование новых направлений исследований в материаловедении с помощью больших языковых моделей и графов понятий

Почему важно позволять машинам «читать» науку

Каждый год учёные публикуют намного больше статей, чем любой человек в состоянии прочитать, даже в узкой специальности. В этом потоке информации скрыты неожиданные связи — идеи, которые могли бы привести к лучшим аккумуляторам, более прочным сплавам или более эффективным солнечным элементам, но которые никто не догадался объединить. В статье рассматривается, как искусственный интеллект, в частности большие языковые модели, может просеивать огромные библиотеки статей по материаловедению и предлагать свежие, правдоподобные направления исследований, которые эксперты могли бы упустить.

Преобразование разрозненных идей в карту знаний

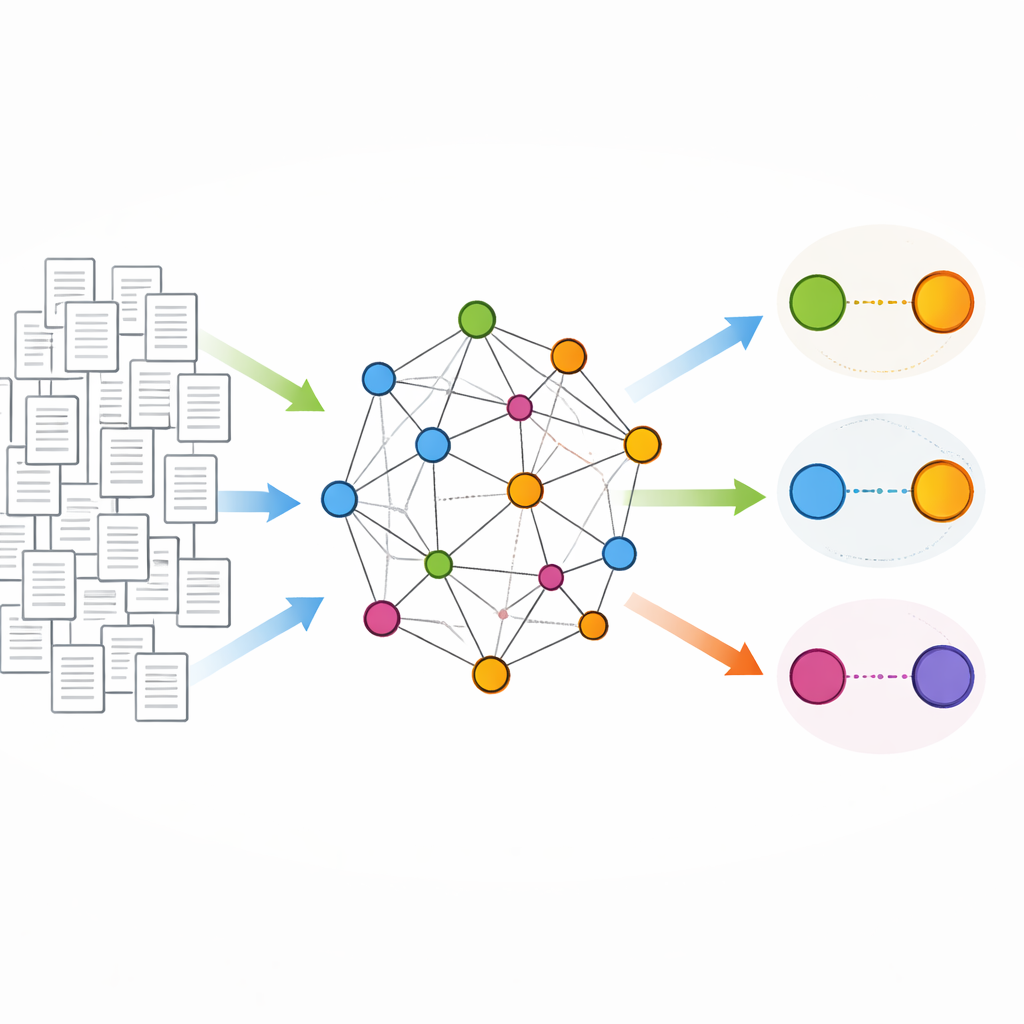

Авторы начинают с того, что рассматривают каждое аннотацию как компактное описание сути статьи. Они дообучают большую языковую модель так, чтобы она, вместо простой предсказательной генерации слов, надёжно извлекала главные «понятия» из аннотаций — короткие существенные фразы вроде «механическое свойство», «оксид графена» или «органический солнечный элемент». В отличие от простых алгоритмов по ключевым словам, настроенная модель умеет поправлять грамматику, объединять синонимы и даже выводить понятия, которые не записаны дословно, формируя качественный список основных идей каждой статьи с минимальной человеческой правкой.

Построение сети понятий для материаловедения

Имея понятия, команда строит огромную сеть, в которой каждая вершина — отдельное понятие, а связь между ними проводится, когда два понятия встречаются вместе в одной аннотации. Из 221 000 статей по материаловедению получается около 137 000 понятий, связанных примерно 13 миллионами связей. Большинство понятий связано лишь с несколькими другими, но некоторые, например распространённые методы измерений, образуют плотные узлы. Со временем, по мере появления новых статей, возникают новые связи и сеть становится более взаимосвязанной. С помощью продвинутых языковых кодировщиков, специализированных для материаловедения, каждому понятию также присваивается числовой «отпечаток», который фиксирует его значение, позволяя схожим идеям располагаться рядом на абстрактной «карте материаловедения».

Обучение машин замечать завтрашние связи

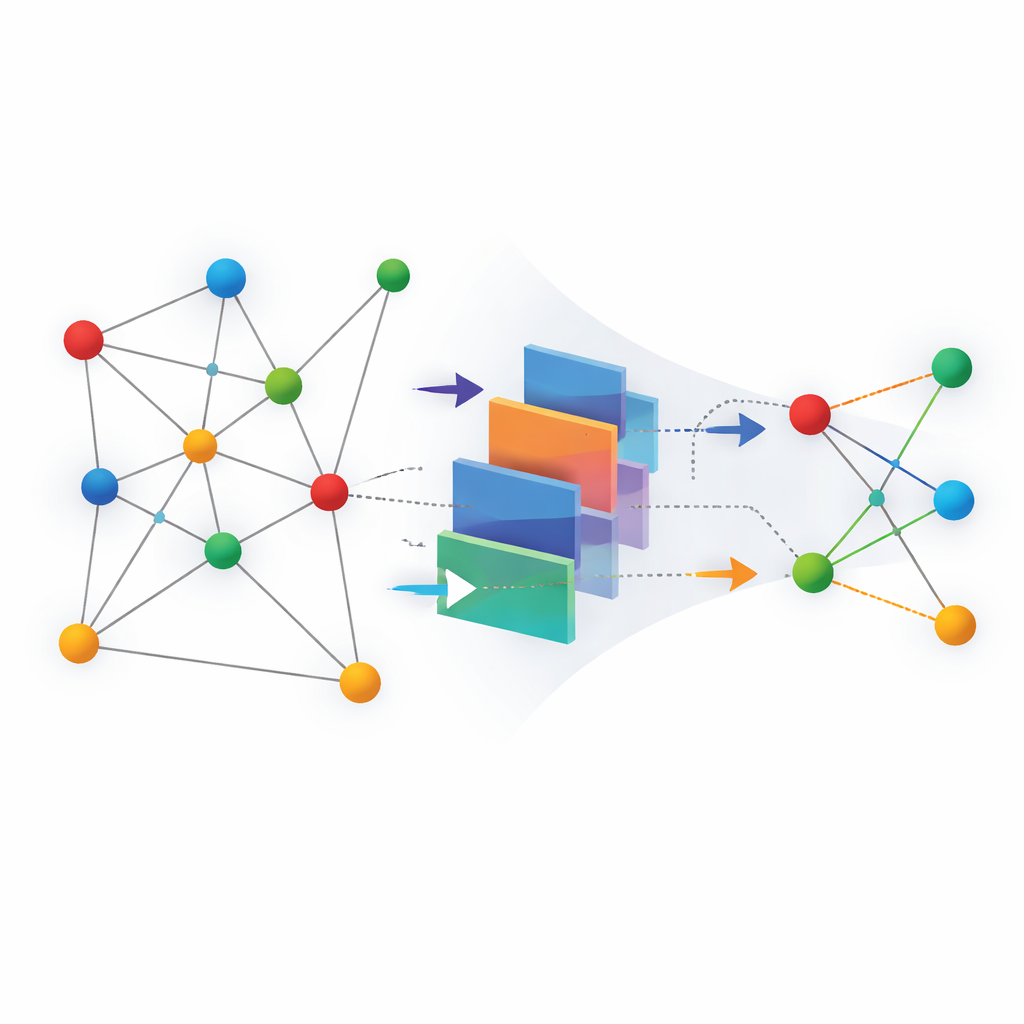

Сердце исследования — задача прогнозирования: если взять сеть до определённого года, сможет ли модель машинного обучения угадать, какие пары понятий будут связаны в будущих статьях? Каждая возможная пара превращается в задачу «да-или-нет» — появятся ли эти две идеи когда-нибудь вместе? Авторы тестируют несколько подходов. Некоторые используют только структуру сети, например, сколько общих соседей имеют два понятия. Другие опираются исключительно на семантические отпечатки понятий. Гибридные модели объединяют оба подхода. Графовая нейронная сеть, которая изучает структуру сети в сочетании с семантической информацией из языковых моделей, показывает лучшие результаты, корректно отличая будущие связи от несвязей в сильно несбалансированной, реалистичной обстановке, где истинно новые комбинации редки, как иголки в стоге сена.

От оценок модели к предложениям для реальных учёных

Чтобы понять, полезны ли эти предсказания на практике, исследователи составляют персонализированные отчёты для десяти учёных-материаловедов. Для каждого учёного они определяют понятия, описывающие его собственную работу, и затем просят модель указать, какие новые сочетания понятий с этими идеями выглядят наиболее перспективно. Также применяются простые фильтры, чтобы исключить чрезмерно общие понятия, и используется языковая модель для составления коротких, удобочитаемых объяснений для части предложений. В интервью эксперты классифицируют каждое предложение как уже известное, тривиальное, бессмысленное или действительно интересное и вдохновляющее.

Насколько система стимулирует новые идеи

Интервью показывают, что примерно четверть всех предложенных комбинаций попадает в категорию «интересное или вдохновляющее». Хотя эта доля может показаться скромной, каждая получасовая беседа по-прежнему даёт несколько конкретных, свежих идей, которые учёные считают достойными внимания. Примечательно, что самые интригующие предложения часто связывают понятия, которые в исходной сети были лишь отдалённо связаны — связи, которые труднее заметить невооружённым глазом. Добавление семантической информации из языковых моделей особенно полезно для обнаружения таких более смелых сочетаний, а сгенерированные ИИ пояснительные абзацы упрощают экспертам оценку того, может ли незнакомая комбинация быть реалистичной и стоящей усилий.

Что это значит для будущего науки

Проще говоря, статья показывает, что ИИ может выступать в роли разведчика идей для учёных. Читая сотни тысяч аннотаций, превращая их в сеть понятий и прогнозируя, какие пары идей, скорее всего, встретятся в будущих работах, система указывает исследователям правдоподобные, но ещё не изученные направления. Она не заменяет человеческое творчество или суждение; скорее, предлагает отфильтрованный краткий список неожиданных связей, которые учёные могут оценить, доработать и проверить. Хотя исследование сосредоточено на материаловедении, тот же подход может применяться во многих областях, помогая исследователям по всему миру ориентироваться в растущем море научных знаний и находить перспективные пути, которые они иначе могли бы пропустить.

Цитирование: Marwitz, T., Colsmann, A., Breitung, B. et al. Predicting new research directions in materials science using large language models and concept graphs. Nat Mach Intell 8, 535–544 (2026). https://doi.org/10.1038/s42256-026-01206-y

Ключевые слова: научные открытия, материаловедение, большие языковые модели, графы знаний, генерация исследовательских идей