Clear Sky Science · fr

Prédire de nouvelles directions de recherche en science des matériaux à l’aide de grands modèles de langage et de graphes de concepts

Pourquoi laisser les machines lire la science compte

Chaque année, les scientifiques publient bien plus d’articles que ce qu’un humain peut lire, même dans une spécialité étroite. Dans ce flot d’informations se cachent des connexions inattendues — des idées qui pourraient mener à de meilleures batteries, des alliages plus résistants ou des cellules solaires plus efficaces, mais que personne n’a pensé à combiner. Cet article explore comment l’intelligence artificielle, et en particulier les grands modèles de langage, peut parcourir d’immenses bibliothèques d’articles en science des matériaux et suggérer des directions de recherche nouvelles et plausibles que des experts humains pourraient négliger.

Transformer des idées dispersées en carte des connaissances

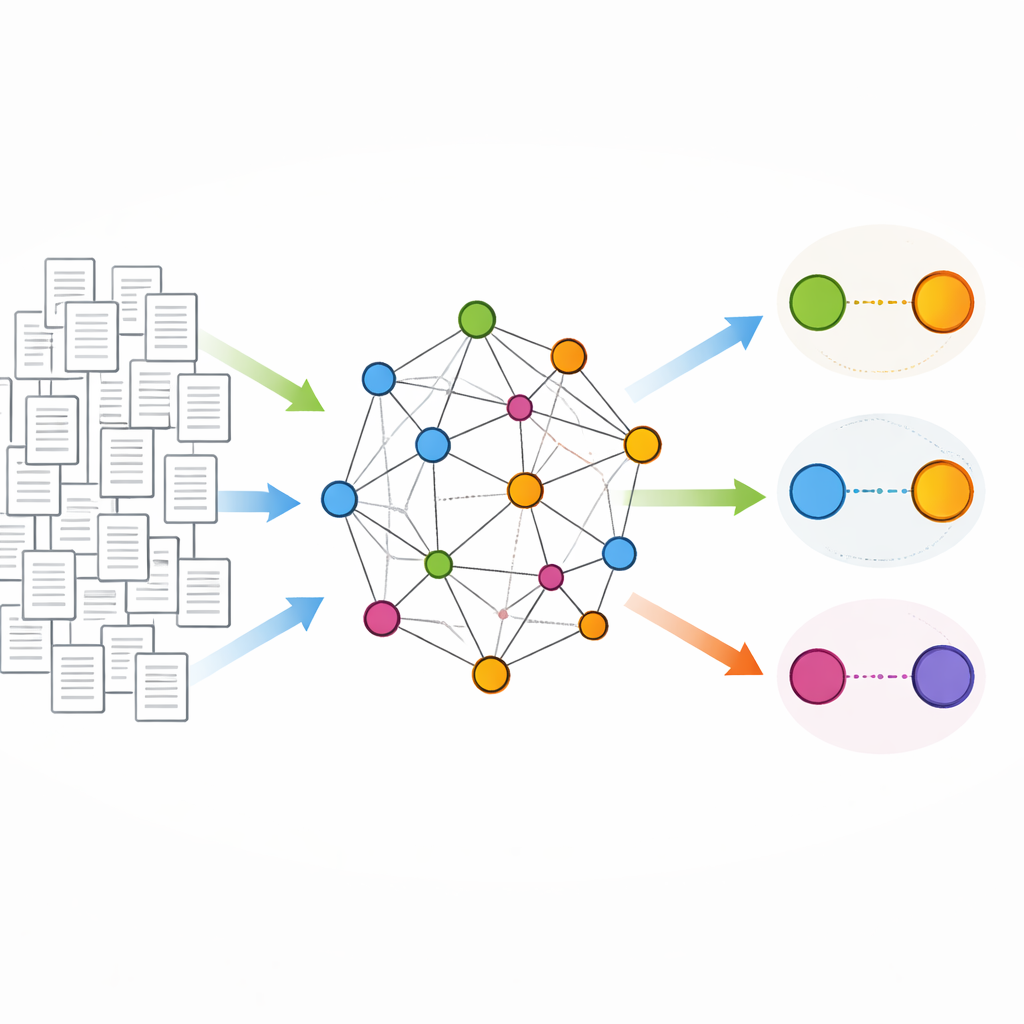

Les auteurs commencent par considérer chaque résumé d’article comme une description compacte du sujet réel du papier. Ils affinent un grand modèle de langage pour qu’il n’ait pas seulement la tâche de prédire des mots, mais qu’il extraie de façon fiable les principaux « concepts » contenus dans ces résumés : de courtes expressions signifiantes telles que « propriété mécanique », « oxyde de graphène » ou « cellule solaire organique ». À la différence d’algorithmes de mots-clés simples, le modèle ajusté peut corriger la grammaire, fusionner des synonymes et même inférer des concepts qui ne sont pas écrits exactement sous la même forme, produisant une liste de haute qualité des idées centrales de chaque article avec un minimum de correction humaine.

Construire un réseau de concepts pour la science des matériaux

Avec les concepts en main, l’équipe construit un vaste réseau où chaque nœud représente un concept distinct et où des liens sont tracés chaque fois que deux concepts apparaissent ensemble dans le même résumé. À partir de 221 000 articles en science des matériaux, cela produit environ 137 000 concepts reliés par quelque 13 millions de liens. La plupart des concepts ne sont connectés qu’à quelques autres, mais certains, comme des techniques de mesure courantes, forment des hubs très fréquentés. Au fil du temps, au fur et à mesure de nouvelles publications, de nouveaux liens apparaissent et le réseau devient plus interconnecté. En utilisant des encodeurs de langage avancés spécialisés en science des matériaux, chaque concept se voit aussi attribuer une empreinte numérique qui capture son sens, permettant aux idées proches d’occuper des positions voisines dans une « carte » abstraite de la science des matériaux.

Apprendre aux machines à repérer les connexions de demain

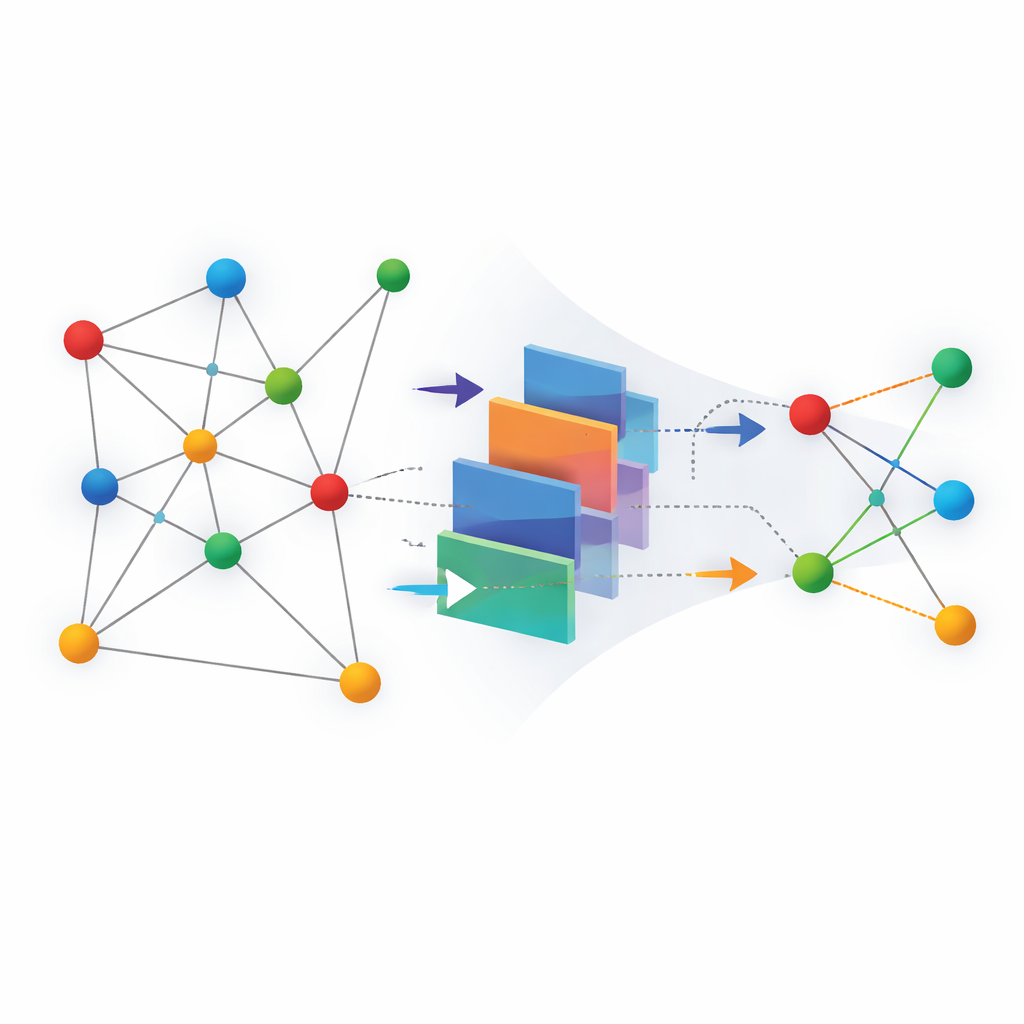

Le cœur de l’étude est une tâche de prédiction : en connaissant le réseau jusqu’à une certaine année, un modèle d’apprentissage automatique peut-il deviner quelles paires de concepts seront liées dans des articles futurs ? Chaque paire possible devient une question binaire : ces deux idées apparaîtront-elles un jour ensemble ? Les auteurs évaluent plusieurs approches. Certaines utilisent uniquement la structure du réseau, comme le nombre de voisins communs entre deux concepts. D’autres s’appuient seulement sur les empreintes sémantiques des concepts. Des modèles hybrides combinent les deux. Un réseau neuronal de graphe qui apprend à partir de la topologie du réseau, mêlé à l’information sémantique provenant de modèles de langage, obtient les meilleures performances, distinguant correctement les liens futurs des non-liens dans un contexte réaliste et fortement déséquilibré où les nouvelles combinaisons véritables sont des aiguilles rares dans une botte de foin.

Des scores du modèle aux suggestions pour des scientifiques réels

Pour savoir si ces prédictions sont réellement utiles, les chercheurs génèrent des rapports personnalisés pour dix spécialistes en science des matériaux. Pour chaque scientifique, ils identifient les concepts qui décrivent son propre travail puis demandent au modèle quelles nouvelles associations de concepts impliquant ces idées semblent les plus prometteuses. Ils appliquent aussi des filtres simples pour éviter les concepts trop génériques et utilisent un modèle de langage pour rédiger de courtes explications lisibles par des humains pour un sous-ensemble de suggestions. Lors d’entretiens, les experts classent chaque suggestion comme déjà connue, triviale, insensée ou réellement intéressante et inspirante.

Quelle efficacité pour susciter de nouvelles idées

Les entretiens montrent qu’environ un quart de l’ensemble des combinaisons suggérées relève de la catégorie « intéressante ou inspirante ». Bien que cette proportion puisse sembler modeste, chaque entretien d’une demi-heure génère néanmoins plusieurs idées concrètes et inédites que les scientifiques jugent dignes d’être explorées. Fait notable, les suggestions les plus intrigantes relient souvent des concepts qui n’étaient que faiblement liés dans le réseau d’origine — des connexions plus difficiles à repérer à l’œil nu. L’ajout d’information sémantique provenant des modèles de langage est particulièrement utile pour découvrir ces accouplements plus audacieux, et les paragraphes explicatifs générés par l’IA facilitent pour les experts l’évaluation du caractère réaliste et pertinent d’une combinaison peu familière.

Ce que cela signifie pour l’avenir de la recherche

En termes clairs, l’article montre que l’IA peut jouer le rôle d’éclaireur d’idées pour les chercheurs. En lisant des centaines de milliers de résumés, en les transformant en un réseau de concepts, puis en prédisant quelles paires d’idées sont susceptibles de se rejoindre dans des publications futures, le système oriente les chercheurs vers des directions plausibles mais inexplorées. Il ne remplace pas la créativité ou le jugement humains ; il offre plutôt une liste courte et triée de connexions surprenantes que les scientifiques peuvent évaluer, affiner et tester. Bien que cette étude se concentre sur la science des matériaux, la même méthode pourrait être appliquée à de nombreux domaines, aidant les chercheurs partout à naviguer dans la mer croissante du savoir scientifique et à découvrir des pistes prometteuses qu’ils auraient pu manquer.

Citation: Marwitz, T., Colsmann, A., Breitung, B. et al. Predicting new research directions in materials science using large language models and concept graphs. Nat Mach Intell 8, 535–544 (2026). https://doi.org/10.1038/s42256-026-01206-y

Mots-clés: découverte scientifique, science des matériaux, grands modèles de langage, graphes de connaissances, idéation de recherche