Clear Sky Science · pl

Przewidywanie nowych kierunków badań w nauce o materiałach przy użyciu dużych modeli językowych i grafów pojęć

Dlaczego warto pozwolić maszynom czytać naukę

Co roku naukowcy publikują znacznie więcej artykułów, niż jakakolwiek osoba jest w stanie przeczytać, nawet w wąskiej specjalizacji. W tym zalewie informacji kryją się nieoczekiwane powiązania — pomysły, które mogłyby zapoczątkować lepsze akumulatory, trwalsze stopy czy bardziej wydajne ogniwa słoneczne, lecz których nikt nie wpadł na połączenie. Artykuł bada, jak sztuczna inteligencja, a w szczególności duże modele językowe, może skanować ogromne biblioteki publikacji z dziedziny materiałoznawstwa i sugerować nowe, wiarygodne kierunki badań, które eksperci ludzcy mogliby przeoczyć.

Przekształcanie rozproszonych pomysłów w mapę wiedzy

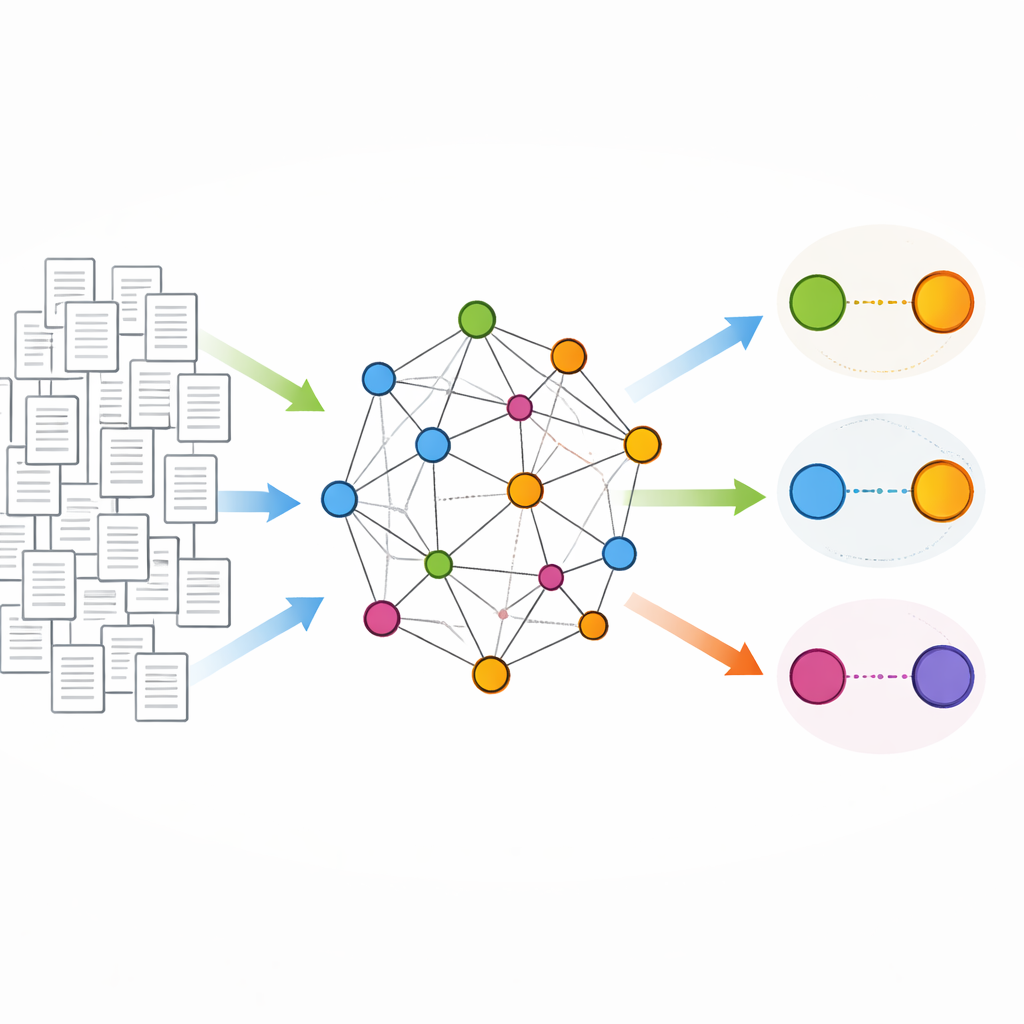

Autorzy zaczynają od potraktowania każdego streszczenia artykułu jako zwartego opisu jego istoty. Dostrajają duży model językowy tak, żeby zamiast jedynie przewidywać słowa potrafił wiarygodnie wydobywać główne „pojęcia” z tych streszczeń: krótkie, znaczące frazy takie jak „właściwość mechaniczna”, „tlenek grafenu” czy „organiczne ogniwo słoneczne”. W przeciwieństwie do prostych algorytmów kluczowych słów, dostrojony model potrafi poprawić gramatykę, łączyć synonimy, a nawet wywnioskować pojęcia niewyrażone dokładnie tak, jak występują w tekście, tworząc wysokiej jakości listę kluczowych idei z każdego artykułu przy minimalnej korekcie ludzkiej.

Budowanie sieci pojęć dla nauki o materiałach

Mając zestaw pojęć, zespół konstruuje ogromną sieć, w której każdy węzeł to odrębne pojęcie, a krawędzie łączą pojęcia, gdy pojawiają się razem w tym samym streszczeniu. Z 221 000 artykułów z nauki o materiałach otrzymano około 137 000 pojęć powiązanych w około 13 milionów krawędzi. Większość pojęć łączy się tylko z kilkoma innymi, ale niektóre, jak powszechne techniki pomiarowe, tworzą zatłoczone węzły. Z czasem, w miarę pojawiania się kolejnych publikacji, pojawiają się nowe połączenia i sieć staje się bardziej spójna. Korzystając z zaawansowanych enkoderów językowych specjalizowanych w nauce o materiałach, każde pojęcie otrzymuje też numeryczny odcisk palca, który oddaje jego znaczenie, co pozwala podobnym ideom znajdować się blisko siebie na abstrakcyjnej „mapie nauki o materiałach”.

Nauczanie maszyn wykrywania jutrzejszych powiązań

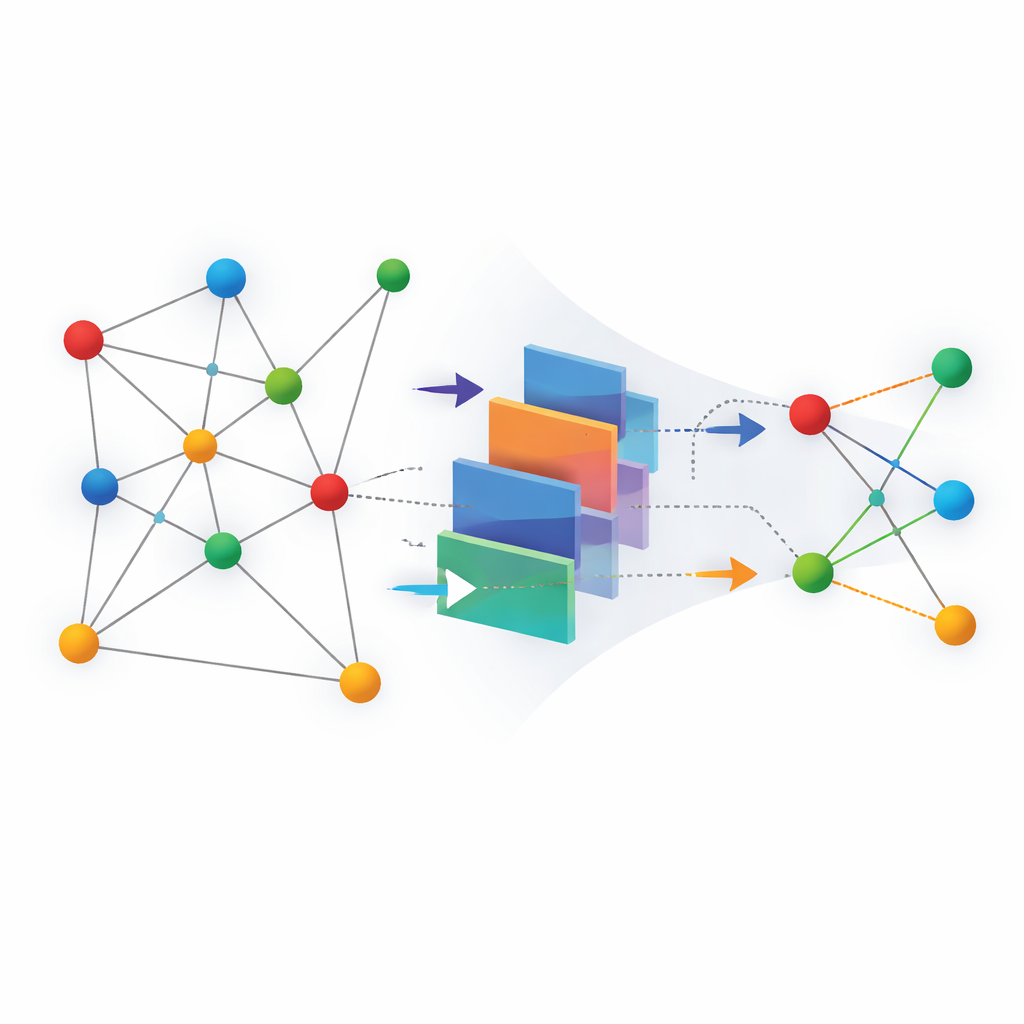

Rdzeniem badania jest zadanie predykcyjne: mając sieć do określonego roku, czy model uczenia maszynowego potrafi zgadnąć, które pary pojęć będą połączone w przyszłych artykułach? Każda możliwa para staje się pytaniem tak/nie — czy te dwie idee kiedykolwiek wystąpią razem? Autorzy testują kilka podejść. Niektóre korzystają wyłącznie ze struktury sieci, np. ile wspólnych sąsiadów mają dwie koncepcje. Inne opierają się jedynie na semantycznych odciskach pojęć. Modele hybrydowe łączą oba podejścia. Sieć neuronowa grafowa ucząca się na układzie sieci, połączona z informacją semantyczną z modeli językowych, działa najlepiej, poprawnie rozróżniając przyszłe powiązania od braku powiązań w wysoce niezrównoważonym, realistycznym scenariuszu, gdzie prawdziwe nowe kombinacje są rzadkimi igłami w stogu siana.

Od ocen modelu do sugestii dla naukowców

Aby sprawdzić, czy te predykcje są praktycznie użyteczne, badacze generują spersonalizowane raporty dla dziesięciu naukowców zajmujących się materiałoznawstwem. Dla każdego naukowca identyfikują pojęcia opisujące jego własne prace, a następnie pytają model, które nowe parowania pojęć związane z tymi ideami wyglądają obiecująco. Stosują też proste filtry, żeby unikać zbyt ogólnych pojęć, i wykorzystują model językowy do sporządzenia krótkich, czytelnych dla człowieka wyjaśnień dla podzbioru sugestii. W wywiadach eksperci klasyfikują każdą sugestię jako już znaną, trywialną, bezsensowną lub naprawdę ciekawą i inspirującą.

Jak dobrze system pobudza nowe pomysły

Wywiady pokazują, że około jedna czwarta wszystkich zasugerowanych kombinacji mieści się w kategorii „ciekawa lub inspirująca”. Choć ten odsetek może wydawać się umiarkowany, każda półgodzinna rozmowa wciąż generuje kilka konkretnych, nowych pomysłów, które naukowcy uważają za warte rozważenia. Co istotne, najbardziej intrygujące sugestie często łączą pojęcia, które w pierwotnej sieci były tylko odlegle powiązane — powiązania trudniejsze do zauważenia wzrokowo. Dodanie informacji semantycznej z modeli językowych szczególnie pomaga w odkrywaniu tych bardziej odważnych parowań, a wygenerowane przez AI akapity wyjaśniające ułatwiają ekspertom ocenę, czy nieznane połączenie może być realistyczne i warte zgłębienia.

Co to oznacza dla przyszłości badań

W jasny sposób artykuł pokazuje, że AI może działać jako rodzaj zwiadowcy pomysłów dla naukowców. Czytając setki tysięcy streszczeń, przekształcając je w sieć pojęć i prognozując, które pary idei prawdopodobnie spotkają się w przyszłych artykułach, system wskazuje badaczom wiarygodne, lecz niewykorzystane kierunki. Nie zastępuje to ludzkiej kreatywności ani osądu; raczej oferuje wyselekcjonowaną krótką listę zaskakujących powiązań, które naukowcy mogą ocenić, dopracować i przetestować. Chociaż badanie koncentruje się na nauce o materiałach, ta sama metoda mogłaby zostać zastosowana w wielu innych dziedzinach, pomagając badaczom na całym świecie poruszać się po rosnącym oceanie wiedzy naukowej i odkrywać obiecujące ścieżki, które mogliby inaczej przegapić.

Cytowanie: Marwitz, T., Colsmann, A., Breitung, B. et al. Predicting new research directions in materials science using large language models and concept graphs. Nat Mach Intell 8, 535–544 (2026). https://doi.org/10.1038/s42256-026-01206-y

Słowa kluczowe: odkrywanie naukowe, nauka o materiałach, duże modele językowe, grafy wiedzy, generowanie pomysłów badawczych