Clear Sky Science · nl

Nieuwe onderzoeksrichtingen in materiaalkunde voorspellen met grote taalmodellen en conceptgrafen

Waarom het belangrijk is dat machines wetenschap kunnen lezen

Elk jaar verschijnen er veel meer wetenschappelijke artikelen dan een mens ooit kan lezen, zelfs binnen een smal vakgebied. Verborgen in deze informatiestroom liggen onverwachte verbanden — ideeën die betere batterijen, sterkere legeringen of efficiëntere zonnecellen zouden kunnen opleveren, maar die niemand heeft gecombineerd. Dit artikel onderzoekt hoe kunstmatige intelligentie, en in het bijzonder grote taalmodellen, enorme bibliotheken met materiaalkundeartikelen kan doorzoeken en nieuwe, plausibele onderzoeksrichtingen kan voorstellen die menselijke experts anders misschien over het hoofd zien.

Versnipperde ideeën omzetten in een kenniskaart

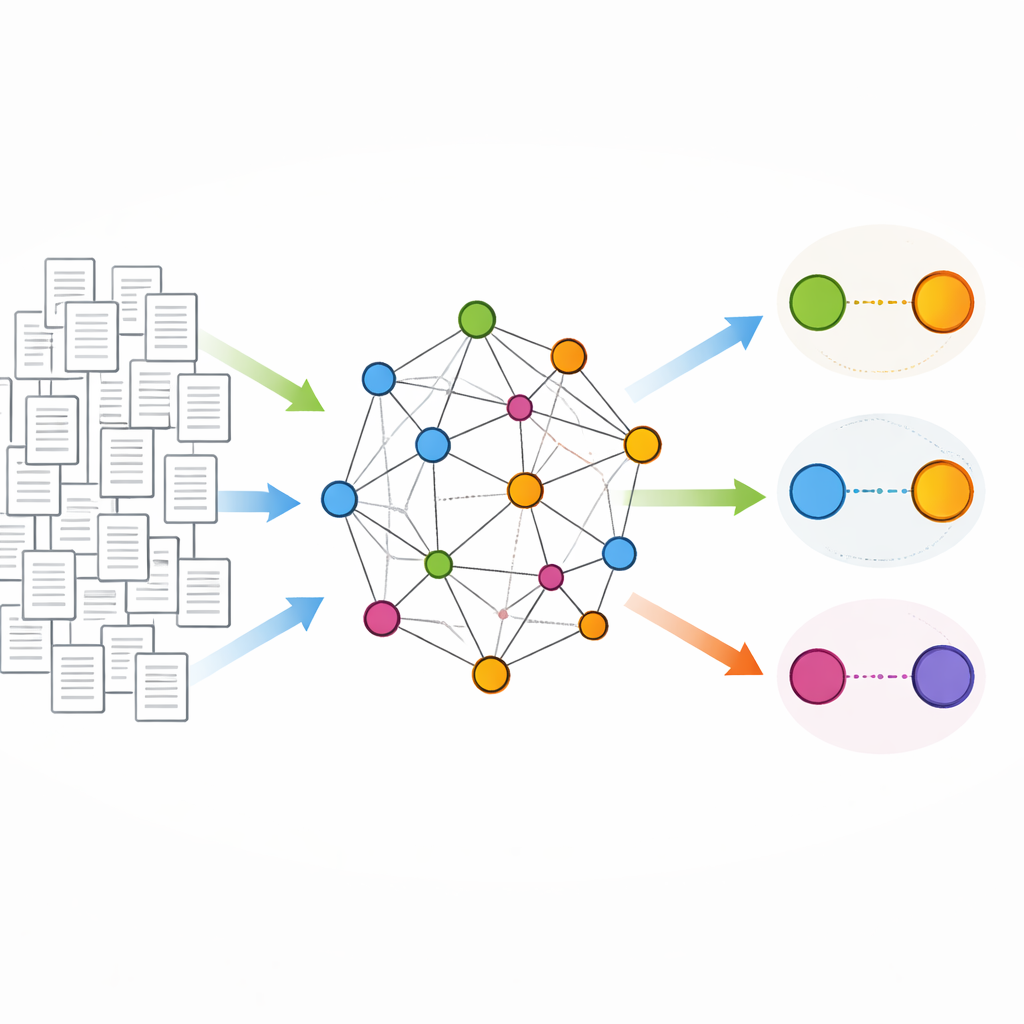

De auteurs beginnen met het behandelen van elk onderzoeksabstract als een compacte beschrijving van waar het artikel echt over gaat. Ze verfijnen een groot taalmodel zodat het, in plaats van alleen woorden te voorspellen, betrouwbaar de belangrijkste "concepten" uit deze abstracts extraheert: korte, betekenisvolle zinnen zoals "mechanische eigenschap", "grapheneoxide" of "organische zonnecel". In tegenstelling tot eenvoudige trefwoordalgoritmen kan het aangepaste model grammatica opschonen, synoniemen samenvoegen en zelfs concepten afleiden die niet precies zo zijn opgeschreven als ze voorkomen, waardoor het een hoogwaardige lijst met kernideeën in elk artikel oplevert met minimale menselijke correctie.

Een conceptnetwerk opbouwen voor materiaalkunde

Met de concepten in handen bouwt het team een enorm netwerk waarin elke knoop een afzonderlijk concept is en er een verbinding wordt getrokken wanneer twee concepten samen in hetzelfde abstract voorkomen. Uit 221.000 materiaalkunde-artikelen ontstaan zo ongeveer 137.000 concepten die verbonden zijn door ongeveer 13 miljoen links. De meeste concepten verbinden slechts met een paar anderen, maar sommige, zoals veelgebruikte meettechnieken, vormen drukke knooppunten. Naarmate er meer artikelen verschijnen, ontstaan er nieuwe links en wordt het netwerk meer onderling verbonden. Met behulp van geavanceerde taalencoders die zijn gespecialiseerd in materiaalkunde, krijgt elk concept ook een numerieke vingerafdruk die de betekenis vastlegt, waardoor vergelijkbare ideeën dicht bij elkaar komen te liggen in een abstracte "kaart van materiaalkunde."

Machines leren de verbindingen van morgen te zien

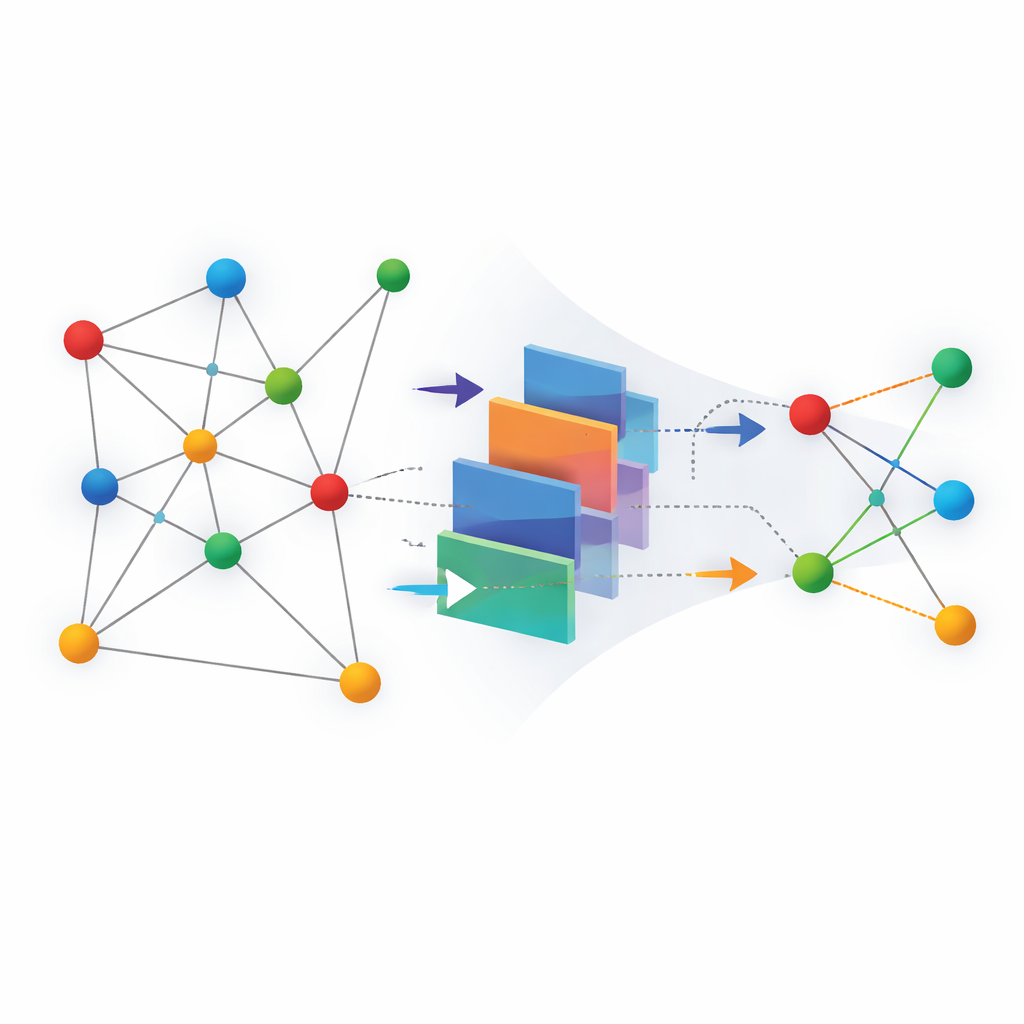

De kern van de studie is een voorspellingsopdracht: gegeven het netwerk tot een bepaald jaar, kan een machine learning-model raden welke paren concepten in toekomstige artikelen verbonden zullen worden? Elk mogelijk paar wordt een ja-of-nee vraag — zullen deze twee ideeën ooit samen voorkomen? De auteurs testen verschillende benaderingen. Sommige maken alleen gebruik van de structuur van het netwerk, zoals hoeveel buren twee concepten delen. Andere vertrouwen uitsluitend op de semantische vingerafdrukken van de concepten. Hybride modellen combineren beide. Een graph neural network dat leert van de netwerkindeling, gecombineerd met semantische informatie uit taalmodellen, presteert het beste en onderscheidt toekomstige links correct van niet-links in een sterk uit balans zijnde, realistische situatie waarin echte nieuwe combinaties zeldzame naalden in een hooiberg zijn.

Van modelscores naar suggesties voor echte wetenschappers

Om te onderzoeken of deze voorspellingen daadwerkelijk nuttig zijn, genereren de onderzoekers gepersonaliseerde rapporten voor tien materiaalkundigen. Voor elke wetenschapper identificeren ze de concepten die het werk van die persoon beschrijven en vragen het model vervolgens welke nieuwe conceptkoppelingen met die ideeën het meest veelbelovend lijken. Ze passen ook eenvoudige filters toe om te voorkomen dat te algemene concepten naar voren komen en gebruiken een taalmodel om korte, menselijk leesbare verklaringen op te stellen voor een subset van de suggesties. In interviews classificeren de experts elke suggestie als al bekend, triviaal, onsinnig of echt interessant en inspirerend.

Hoe goed het systeem nieuwe ideeën aanwakkert

De interviews laten zien dat ongeveer een kwart van alle voorgestelde combinaties in de categorie "interessant of inspirerend" valt. Hoewel dat aandeel bescheiden lijkt, levert elk halfuur durend gesprek nog steeds meerdere concrete, frisse ideeën op die de wetenschappers de moeite waard vinden om over na te denken. Opvallend is dat de meest intrigerende suggesties vaak concepten koppelen die in het oorspronkelijke netwerk slechts op afstand verwant waren — verbindingen die met het blote oog moeilijker te zien zijn. Het toevoegen van semantische informatie uit taalmodellen helpt vooral bij het blootleggen van deze meer avontuurlijke koppelingen, en de door AI gegenereerde verklarende paragrafen maken het voor experts gemakkelijker te beoordelen of een onbekende combinatie realistisch en de moeite waard kan zijn.

Wat dit betekent voor de toekomst van onderzoek

Concreet laat het artikel zien dat AI kan fungeren als een soort ideeënverkenner voor wetenschappers. Door honderden duizenden abstracts te lezen, ze om te zetten in een netwerk van concepten en vervolgens te voorspellen welke paar ideeën waarschijnlijk in toekomstige artikelen samenkomen, wijst het systeem onderzoekers op plausibele maar onontgonnen richtingen. Het vervangt geen menselijke creativiteit of oordeel; in plaats daarvan biedt het een gecureerde short list van verrassende verbindingen die wetenschappers kunnen evalueren, verfijnen en testen. Hoewel deze studie zich richt op materiaalkunde, kan hetzelfde recept op veel vakgebieden worden toegepast, waardoor onderzoekers overal beter door de groeiende zee van wetenschappelijke kennis kunnen navigeren en veelbelovende paden kunnen ontdekken die ze anders misschien zouden missen.

Bronvermelding: Marwitz, T., Colsmann, A., Breitung, B. et al. Predicting new research directions in materials science using large language models and concept graphs. Nat Mach Intell 8, 535–544 (2026). https://doi.org/10.1038/s42256-026-01206-y

Trefwoorden: wetenschappelijke ontdekking, materiaalkunde, grote taalmodellen, kennisgrafen, ideevorming voor onderzoek