Clear Sky Science · de

Vorhersage neuer Forschungsrichtungen in der Materialwissenschaft mit großen Sprachmodellen und Konzeptgraphen

Warum es wichtig ist, Maschinen Wissenschaft lesen zu lassen

Jedes Jahr veröffentlichen Wissenschaftler weitaus mehr Aufsätze, als ein Mensch selbst in einem engen Fachgebiet lesen kann. In dieser Flut an Informationen verbergen sich unerwartete Verbindungen — Ideen, die bessere Batterien, widerstandsfähigere Legierungen oder effizientere Solarzellen anstoßen könnten, aber die niemand in Kombination betrachtet hat. Dieser Artikel zeigt, wie künstliche Intelligenz, insbesondere große Sprachmodelle, riesige Bibliotheken von Publikationen zur Materialwissenschaft durchsuchen und plausible, neue Forschungsschwerpunkte vorschlagen kann, die menschliche Expert:innen sonst übersehen könnten.

Verstreute Ideen in eine Wissenskarte überführen

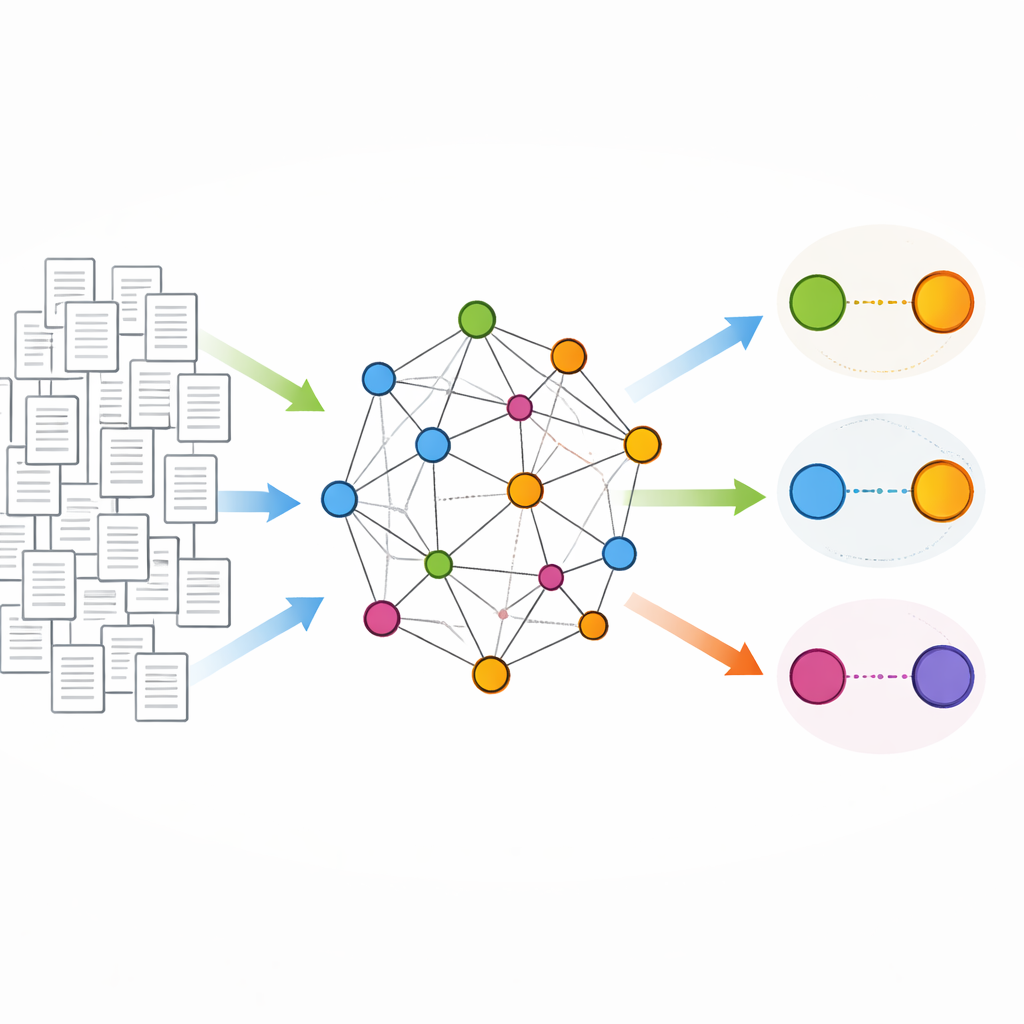

Die Autor:innen beginnen damit, jedes Abstract als kompakten Bericht darüber zu behandeln, worum es in einem Papier wirklich geht. Sie fine-tunen ein großes Sprachmodell so, dass es statt nur Wörter vorherzusagen zuverlässig die wichtigsten „Konzepte“ aus diesen Abstracts extrahiert: kurze, sinnvolle Phrasen wie „mechanische Eigenschaft“, „Graphenoxid“ oder „organische Solarzelle“. Anders als einfache Stichwortalgorithmen kann das angepasste Modell Grammatik bereinigen, Synonyme zusammenführen und sogar Konzepte erschließen, die nicht exakt so formuliert sind, wie sie erscheinen, und liefert damit eine hochwertige Liste der Kernideen jedes Papiers mit minimaler menschlicher Nachkorrektur.

Aufbau eines Konzeptnetzwerks für die Materialwissenschaft

Mit den Konzepten in der Hand baut das Team ein großes Netzwerk, in dem jeder Knoten ein eigenes Konzept darstellt und Verbindungen gezogen werden, wenn zwei Konzepte im selben Abstract gemeinsam vorkommen. Aus 221.000 Papieren der Materialwissenschaft entstehen so etwa 137.000 Konzepte, verbunden durch rund 13 Millionen Kanten. Die meisten Konzepte sind nur mit wenigen anderen verbunden, einige, etwa gängige Messmethoden, bilden jedoch dichte Knotenpunkte. Im Laufe der Zeit, mit weiteren Publikationen, entstehen neue Verbindungen und das Netzwerk wird immer stärker vernetzt. Mithilfe fortgeschrittener Sprachencoder, die auf Materialwissenschaft spezialisiert sind, erhält jedes Konzept zudem einen numerischen Fingerabdruck, der seine Bedeutung einfängt, sodass ähnliche Ideen nebeneinander in einer abstrakten „Karte der Materialwissenschaft“ liegen.

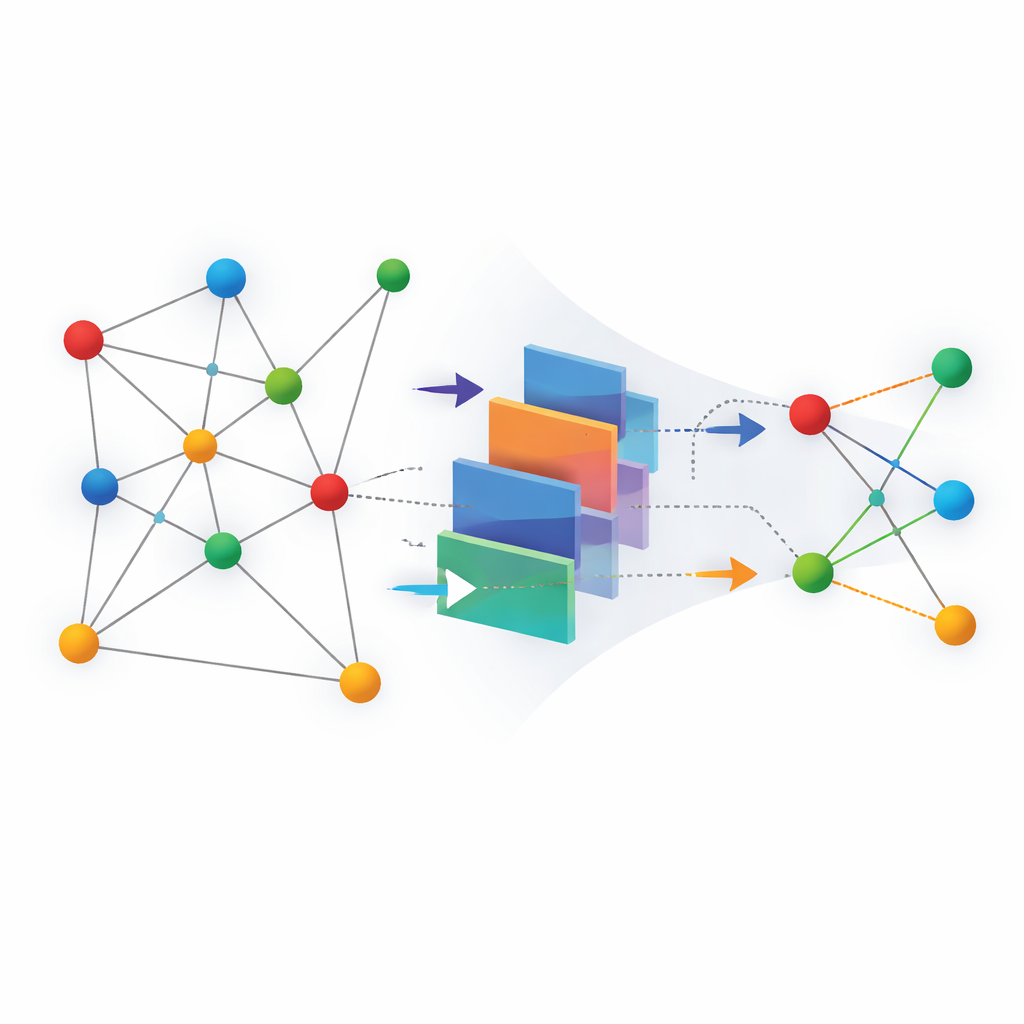

Maschinen beibringen, die Verbindungen von morgen zu erkennen

Der Kern der Studie ist eine Vorhersageaufgabe: Ausgehend vom Netzwerk bis zu einem bestimmten Jahr — kann ein maschinelles Lernmodell vorhersagen, welche Konzeptpaare in zukünftigen Papieren verknüpft werden? Jedes mögliche Paar wird zur Ja‑oder‑Nein‑Frage — werden diese beiden Ideen je gemeinsam auftreten? Die Autor:innen prüfen mehrere Ansätze. Einige nutzen nur die Struktur des Netzwerks, etwa wie viele Nachbarn zwei Konzepte teilen. Andere stützen sich ausschließlich auf die semantischen Fingerabdrücke der Konzepte. Hybride Modelle kombinieren beides. Ein Graph‑Neural‑Network, das aus dem Netzwerkaufbau lernt und mit semantischen Informationen aus Sprachmodellen verschmolzen wird, erzielt die besten Ergebnisse und unterscheidet zukünftige Verknüpfungen von Nicht‑Verknüpfungen in einem stark unausgeglichenen, realistischen Szenario, in dem echte neue Kombinationen seltene Nadeln im Heuhaufen sind.

Von Modellwerten zu Vorschlägen für echte Wissenschaftler

Um zu prüfen, ob diese Vorhersagen tatsächlich nützlich sind, erstellen die Forschenden personalisierte Berichte für zehn Materialwissenschaftler:innen. Für jede Person identifizieren sie die Konzepte, die deren eigene Arbeit beschreiben, und fragen dann das Modell, welche neuen Konzeptpaarungen mit diesen Ideen am vielversprechendsten erscheinen. Sie wenden auch einfache Filter an, um zu generische Konzepte zu vermeiden, und nutzen ein Sprachmodell, um für eine Teilmenge der Vorschläge kurze, gut lesbare Erklärungen zu entwerfen. In Interviews klassifizieren die Expert:innen jede Empfehlung als bereits bekannt, trivial, unsinnig oder wirklich interessant und inspirierend.

Wie gut das System neue Ideen anstößt

Die Interviews zeigen, dass etwa ein Viertel aller vorgeschlagenen Kombinationen in die Kategorie „interessant oder inspirierend“ fällt. Zwar erscheint dieser Anteil moderat, doch liefert jedes halbstündige Gespräch dennoch mehrere konkrete, neue Ideen, die die Wissenschaftler:innen für überlegenswert halten. Bemerkenswerterweise verknüpfen die faszinierendsten Vorschläge oft Konzepte, die im ursprünglichen Netzwerk nur weit entfernt zueinander standen — Verbindungen, die mit bloßem Auge schwerer zu erkennen sind. Das Hinzufügen semantischer Informationen aus Sprachmodellen hilft besonders dabei, diese gewagteren Paarungen aufzudecken, und die vom KI-System generierten Erklärabschnitte erleichtern es Expert:innen, einzuschätzen, ob eine ungewohnte Kombination realistisch und lohnend sein könnte.

Was das für die Zukunft der Forschung bedeutet

Klare Worte: Die Arbeit zeigt, dass KI als eine Art Ideenaufspürer für Wissenschaftler:innen fungieren kann. Indem sie Hunderttausende Abstracts liest, sie in ein Konzeptnetz überführt und dann vorhersagt, welche Ideenpaare wahrscheinlich in zukünftigen Arbeiten zusammentreffen, weist das System Forschende auf plausible, aber unerforschte Richtungen hin. Es ersetzt weder menschliche Kreativität noch Urteilsvermögen; vielmehr bietet es eine kuratierte Shortlist überraschender Verbindungen, die Wissenschaftler:innen bewerten, verfeinern und testen können. Obwohl sich die Studie auf Materialwissenschaft konzentriert, ließe sich dieselbe Methode auf viele Felder anwenden und Forschenden weltweit helfen, sich im wachsenden Meer wissenschaftlicher Erkenntnisse zu orientieren und vielversprechende Pfade zu entdecken, die sie sonst verpassen würden.

Zitation: Marwitz, T., Colsmann, A., Breitung, B. et al. Predicting new research directions in materials science using large language models and concept graphs. Nat Mach Intell 8, 535–544 (2026). https://doi.org/10.1038/s42256-026-01206-y

Schlüsselwörter: wissenschaftliche Entdeckung, Materialwissenschaft, große Sprachmodelle, Wissensgraphen, Forschungsideen