Clear Sky Science · pt

Predizendo novas direções de pesquisa em ciência dos materiais usando grandes modelos de linguagem e grafos de conceitos

Por que deixar as máquinas lerem ciência importa

Cada ano, cientistas publicam muito mais artigos do que qualquer ser humano pode ler, mesmo dentro de uma especialidade restrita. Ocultas nesse fluxo de informação estão conexões inesperadas — ideias que poderiam gerar baterias melhores, ligas mais resistentes ou células solares mais eficientes, mas que ninguém pensou em combinar. Este artigo explora como a inteligência artificial, em particular grandes modelos de linguagem, pode vasculhar vastas bibliotecas de artigos sobre materiais e sugerir novas direções de pesquisa plausíveis que especialistas humanos poderiam deixar passar.

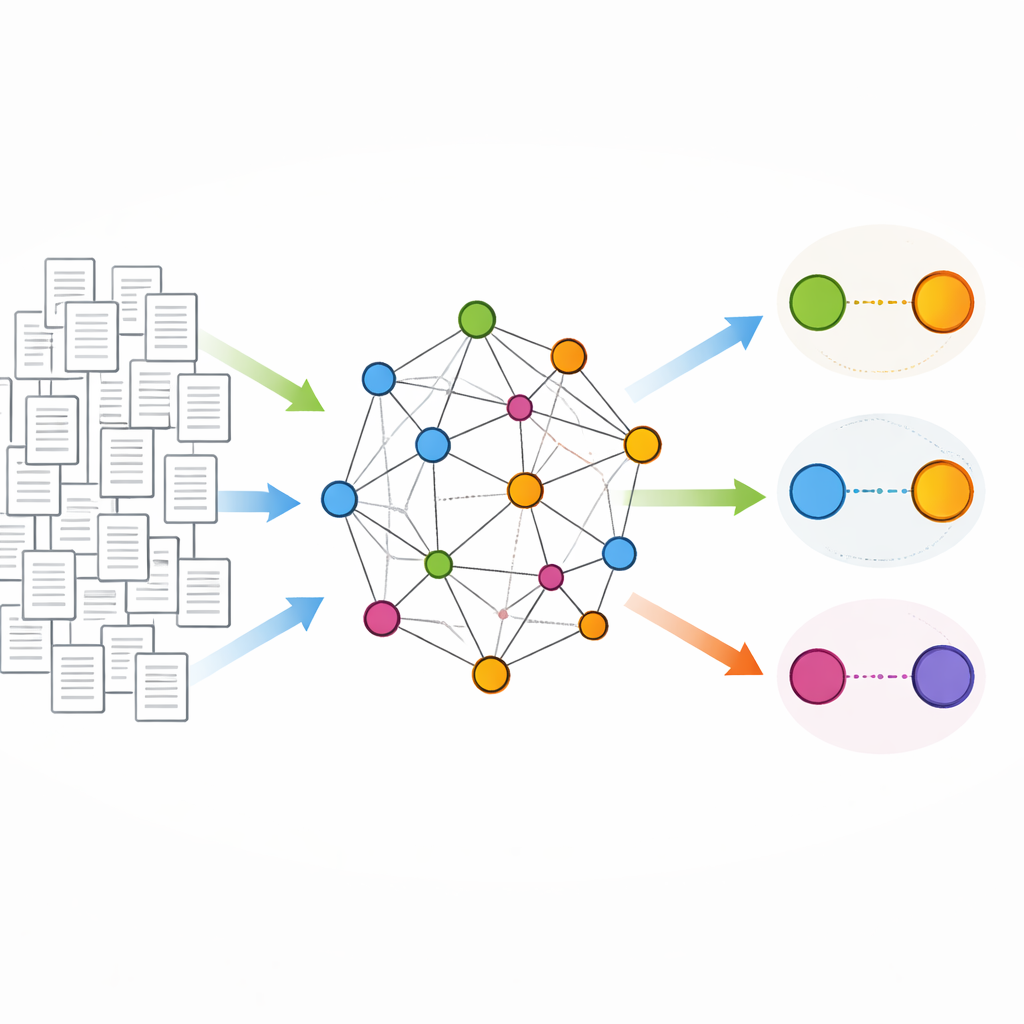

Transformando ideias dispersas em um mapa do conhecimento

Os autores começam tratando cada resumo de artigo como uma descrição concisa do que o trabalho realmente aborda. Eles ajustam (fine-tune) um grande modelo de linguagem para que, em vez de apenas prever palavras, ele extraia de forma confiável os principais “conceitos” desses resumos: frases curtas e significativas como “propriedade mecânica”, “óxido de grafeno” ou “célula solar orgânica”. Ao contrário de algoritmos simples de palavras-chave, o modelo ajustado consegue limpar a gramática, fundir sinônimos e até inferir conceitos não escritos exatamente da mesma forma, produzindo uma lista de alta qualidade das ideias centrais de cada artigo com correção humana mínima.

Construindo uma rede de conceitos para a ciência dos materiais

Com os conceitos em mãos, a equipe constrói uma imensa rede em que cada nó é um conceito distinto e as arestas são desenhadas sempre que dois conceitos aparecem juntos no mesmo resumo. A partir de 221.000 artigos sobre ciência dos materiais, isso resulta em cerca de 137.000 conceitos conectados por aproximadamente 13 milhões de ligações. A maioria dos conceitos conecta-se a poucos outros, mas alguns, como técnicas de medição comuns, formam hubs densos. Com o passar do tempo, à medida que mais artigos são publicados, novas ligações surgem e a rede fica mais interconectada. Usando codificadores linguísticos avançados especializados em ciência dos materiais, cada conceito também recebe uma impressão numérica que captura seu significado, permitindo que ideias semelhantes fiquem próximas em um “mapa da ciência dos materiais” abstrato.

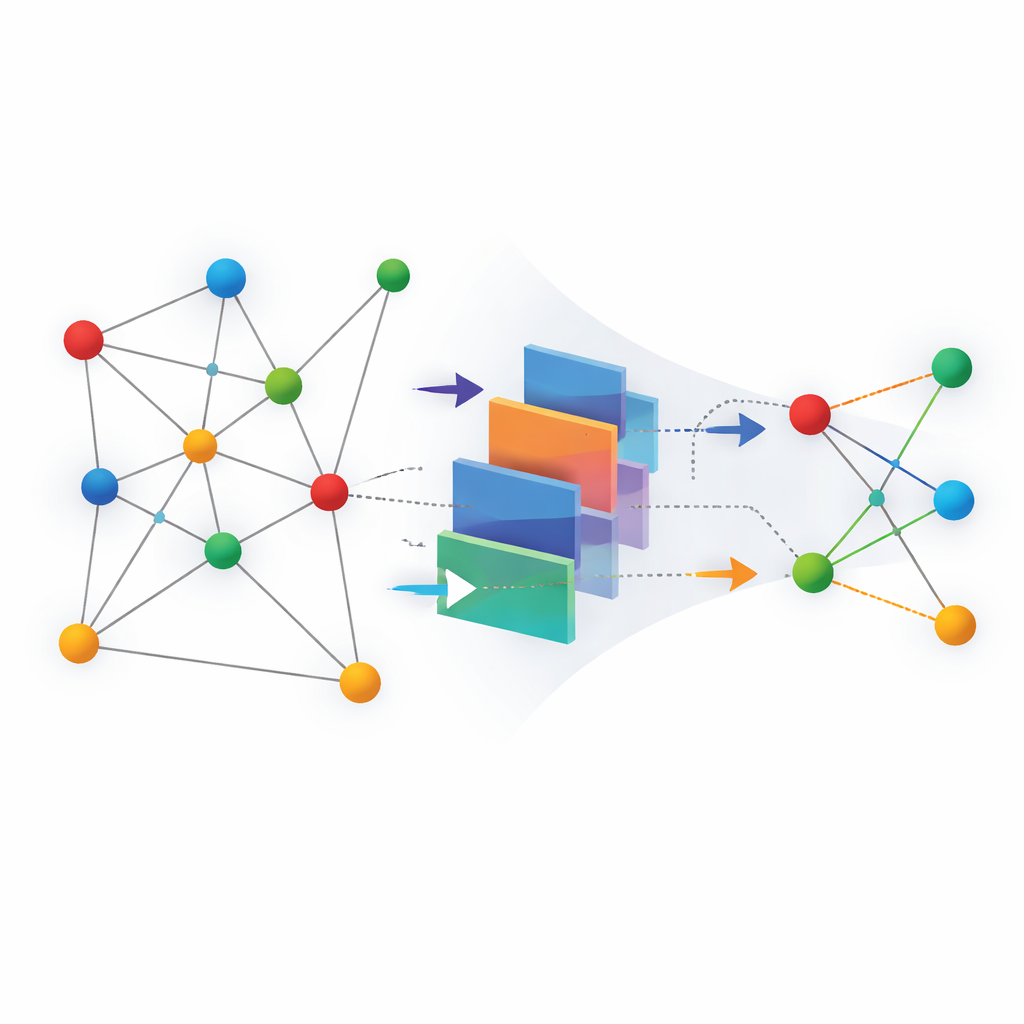

Ensinando máquinas a identificar as conexões de amanhã

O cerne do estudo é uma tarefa de previsão: dado o estado da rede até um certo ano, um modelo de aprendizado de máquina consegue adivinhar quais pares de conceitos serão ligados em artigos futuros? Cada par possível torna-se uma questão de sim/não — essas duas ideias aparecerão juntas algum dia? Os autores testam várias abordagens. Algumas usam apenas a estrutura da rede, como quantos vizinhos dois conceitos compartilham. Outras baseiam-se exclusivamente nas impressões semânticas dos conceitos. Modelos híbridos combinam ambos. Uma rede neural de grafos que aprende a partir da topologia da rede, combinada com informação semântica de modelos de linguagem, tem o melhor desempenho, distinguindo corretamente ligações futuras de não-ligações em um cenário altamente desbalanceado e realista, onde novas combinações verdadeiras são raras agulhas no palheiro.

Das pontuações do modelo para sugestões a cientistas reais

Para verificar se essas previsões são realmente úteis, os pesquisadores geram relatórios personalizados para dez cientistas de materiais. Para cada cientista, eles identificam os conceitos que descrevem o próprio trabalho da pessoa e então pedem ao modelo que indique quais novos pareamentos de conceitos envolvendo essas ideias parecem mais promissores. Eles também aplicam filtros simples para evitar conceitos excessivamente genéricos e usam um modelo de linguagem para redigir breves explicações em linguagem humana para um subconjunto de sugestões. Em entrevistas, os especialistas classificam cada sugestão como já conhecida, trivial, sem sentido ou genuinamente interessante e inspiradora.

Quão bem o sistema estimula novas ideias

As entrevistas revelam que cerca de um quarto de todas as combinações sugeridas se enquadra na categoria “interessante ou inspiradora”. Embora essa fração possa parecer modesta, cada conversa de meia hora ainda produz várias ideias concretas e inéditas que os cientistas consideram dignas de atenção. Notavelmente, as sugestões mais instigantes frequentemente ligam conceitos que eram apenas distante-mente relacionados na rede original — conexões mais difíceis de perceber a olho nu. Adicionar informação semântica dos modelos de linguagem é especialmente útil para descobrir esses pareamentos mais aventureiros, e os parágrafos explicativos gerados pela IA facilitam para os especialistas avaliarem se uma combinação desconhecida pode ser realista e valer a pena.

O que isso significa para o futuro da pesquisa

Em termos claros, o artigo mostra que a IA pode atuar como uma espécie de explorador de ideias para cientistas. Ao ler centenas de milhares de resumos, transformá-los em uma rede de conceitos e então prever quais pares de ideias provavelmente se encontrarão em trabalhos futuros, o sistema aponta pesquisadores para direções plausíveis, porém inexploradas. Não substitui a criatividade ou o julgamento humano; em vez disso, oferece uma lista curada de conexões surpreendentes que os cientistas podem avaliar, refinar e testar. Embora este estudo foque em ciência dos materiais, a mesma receita poderia ser aplicada a muitos campos, ajudando pesquisadores em todo lugar a navegar no mar crescente de conhecimento científico e descobrir caminhos promissores que poderiam ter passado despercebidos.

Citação: Marwitz, T., Colsmann, A., Breitung, B. et al. Predicting new research directions in materials science using large language models and concept graphs. Nat Mach Intell 8, 535–544 (2026). https://doi.org/10.1038/s42256-026-01206-y

Palavras-chave: descoberta científica, ciência dos materiais, grandes modelos de linguagem, grafos de conhecimento, ideação de pesquisa