Clear Sky Science · ru

Глубокая матричная факторизация с максимальным отступом

Почему важны более умные рекомендации

От кино-вечеров до онлайн-покупок мы полагаемся на цифровые платформы, которые пытаются угадать, что нам понравится дальше. Эти предположения формирует алгоритм, обучающийся на наших прошлых выборах и оценках. Но вкусы людей запутанны и редко подчиняются простым закономерностям. В статье предлагается новый подход к моделированию таких запутанных предпочтений — Глубокая матричная факторизация с максимальным отступом (Deep MMMF), цель которого — превратить разрозненные, фрагментарные данные оценок в более чёткие и надёжные рекомендации.

Как обычно работают современные рекомендатели

Многие современные рекомендации строятся вокруг метода матричной факторизации. Представьте себе гигантскую таблицу, где строки — это пользователи, столбцы — предметы, а в ячейках содержатся оценки, если они имеются. Матричная факторизация сжимает эту большую разреженную таблицу в две меньшие матрицы: одна описывает скрытые предпочтения пользователей, другая — скрытые характеристики предметов. Когда система хочет предсказать, как пользователь оценит невидимый ему предмет, она комбинирует вектор скрытых предпочтений пользователя с вектором скрытых черт предмета и получает скор. Классические вариации этой идеи лежат в основе известных систем для фильмов, товаров и музыки.

От прямых линий к изогнутым предпочтениям

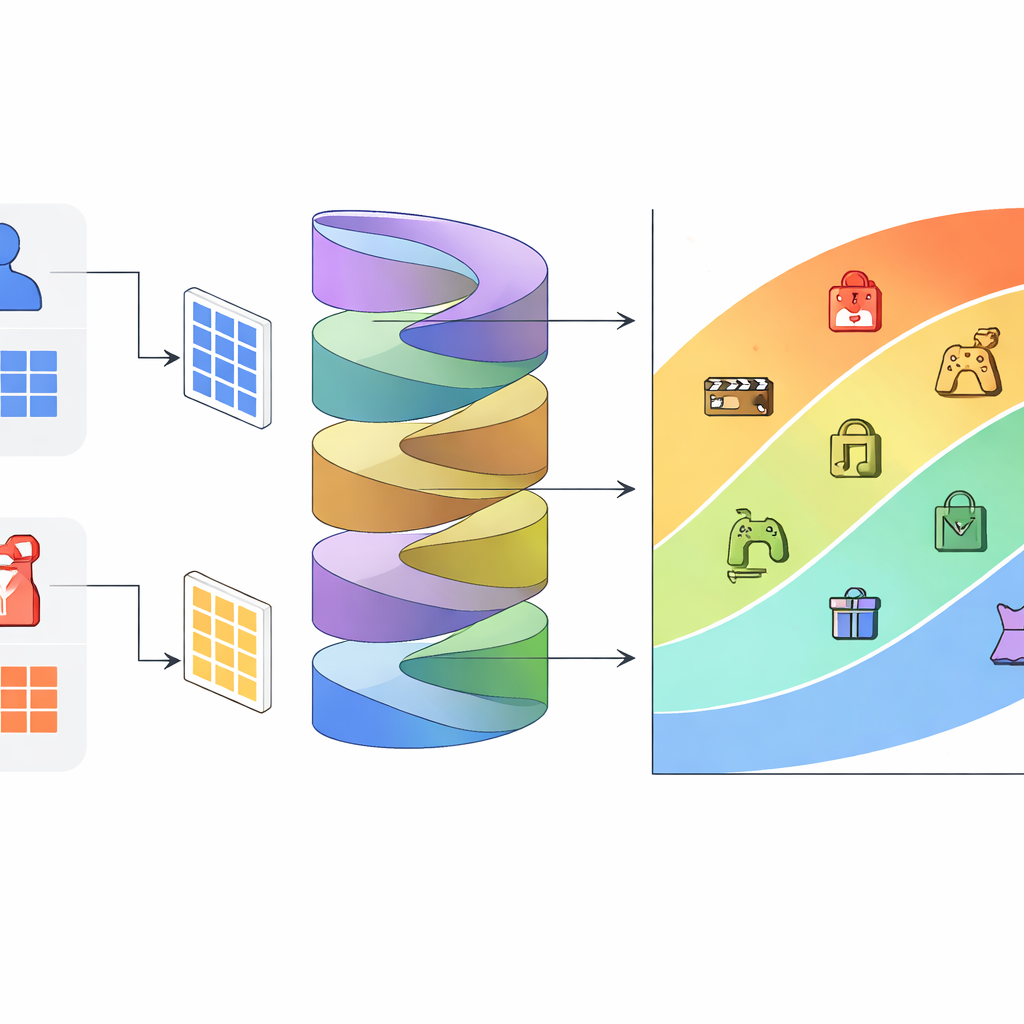

Один влиятельный метод — Матричная факторизация с максимальным отступом (MMMF) — делает шаг дальше, рассматривая оценки как упорядоченные категории: одна звезда хуже двух, две хуже трёх и так далее. MMMF представляет предметы как точки в пространстве, а пользователей — как плоские разделяющие поверхности (гиперплоскости), которые делят это пространство на зоны оценок. Каждая зона соответствует определённому уровню оценки, и метод стремится максимально раздвинуть эти разделяющие поверхности, чтобы снизить путаницу между соседними оценками. Однако поскольку эти поверхности обязаны быть плоскими и параллельными, модель может выражать только простые, примерно линейные паттерны вкусов.

Более глубокое понимание вкусов и предметов

Реальные предпочтения редко так просты. Возьмём трёх зрителей: одного, который любит сбалансированные фильмы с умеренным экшеном; другого, который хочет много действия, но низкой интенсивности; и третьего, которому нравятся любые фильмы с сильным экшеном. Такое поведение формирует в пространстве фильмов изогнутые и нерегулярные границы, а не аккуратные параллельные срезы. Deep MMMF решает эту задачу, сохраняя знакомую основу MMMF, но добавляя глубокие нейронные сети поверх представлений пользователей, предметов и порогов оценок. Сначала модель строит стандартные компактные встраивания для пользователей, предметов и порогов оценок, как в MMMF. Затем отдельные нейронные модули трансформируют каждое из этих встраиваний через слои нелинейных функций, изгибая границы оценок в более богатые формы без увеличения числа скрытых измерений.

Что показали эксперименты

Авторы тестируют Deep MMMF на трёх популярных наборах данных: MovieLens 1M, EachMovie и наборе продуктов Amazon Prime Pantry. Они рассматривают две ситуации. При слабо́й генерализации система предсказывает оценки для пар пользователь–предмет, которые были удержаны, но при этом и пользователи, и предметы встречались в обучении. При сильной генерализации система сталкивается с полностью новыми пользователями, чьи прошлые оценки не использовались для настройки основной модели, поэтому ей приходится быстро выводить их вкусы с нуля. Во всех ситуациях и на всех наборах данных Deep MMMF последовательно даёт меньшую ошибку предсказания по сравнению с широким набором ведущих методов, включая классический MMMF, вероятностные факторизационные модели и несколько рекомендателей на основе глубокого обучения. Статистические тесты подтверждают, что эти улучшения не случа́йны.

Почему этот подход перспективен

Сохраняющая исходный размер скрытых представлений и добавляющая гибкие нелинейные преобразования, Deep MMMF чётко отделяет «больше измерений» от «более выразительных функций». Это позволяет увидеть, что улучшения действительно обусловлены лучшим моделированием сложных паттернов вкусов, а не просто увеличением размера модели. Результаты указывают на то, что рекомендательные системы могут лучше учитывать естественный порядок оценок и запутанную природу человеческих предпочтений без потери интерпретируемости или эффективности. На практике это означает, что будущие рекомендатели, основанные на идеях вроде Deep MMMF, смогут давать более точные, персонализированные предложения для фильмов, покупок и других сфер, особенно когда вкусы пользователей не укладываются в простые прямые линии.

Цитирование: Kumar, S., Kagita, V.R., Kumar, V. et al. Deep maximum margin matrix factorization. Sci Rep 16, 14518 (2026). https://doi.org/10.1038/s41598-026-44839-0

Ключевые слова: рекомендательные системы, коллаборативная фильтрация, глубокое обучение, матричная факторизация, оценки пользователей