Clear Sky Science · fr

Factorisation de matrice à marge maximale profonde

Pourquoi des suggestions plus intelligentes comptent

Des soirées cinéma aux achats en ligne, nous comptons sur des plateformes numériques pour deviner ce qui pourrait nous plaire ensuite. Ces estimations proviennent d’algorithmes de recommandation qui apprennent de nos choix et de nos notes passées. Mais les goûts des gens sont désordonnés et suivent rarement des schémas simples. Cet article présente une nouvelle façon de modéliser ces préférences complexes, appelée Factorisation de Matrice à Marge Maximale Profonde (Deep MMMF), qui vise à transformer des données d’évaluation partielles et dispersées en recommandations plus nettes et plus fiables.

Comment fonctionnent généralement les systèmes de recommandation aujourd’hui

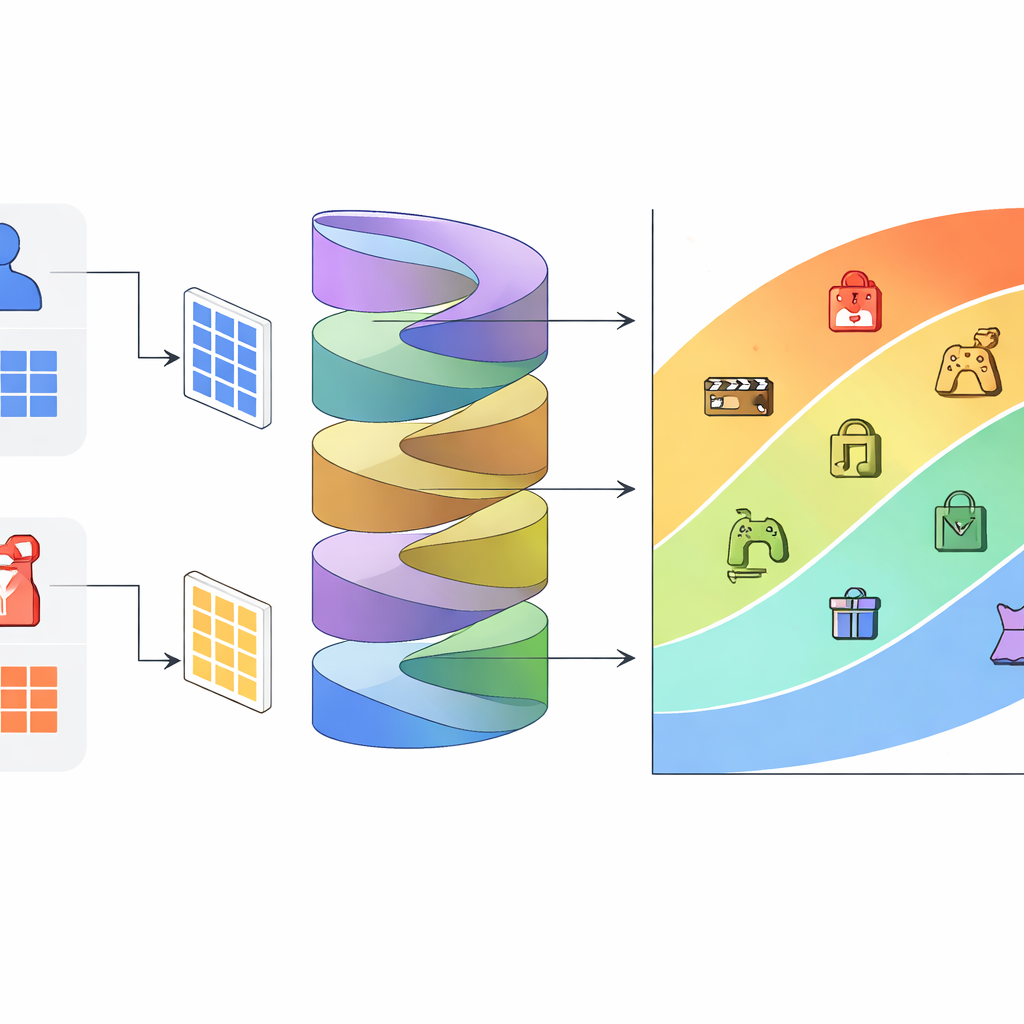

Beaucoup de systèmes modernes de recommandation reposent sur une technique appelée factorisation de matrice. Imaginez une énorme table dont les lignes sont les utilisateurs, les colonnes les objets, et chaque case contient une note si elle existe. La factorisation de matrice compresse cette vaste table creuse en deux cartes plus petites : l’une décrit les préférences cachées des utilisateurs, l’autre décrit les caractéristiques latentes des objets. Lorsque le système veut prédire comment un utilisateur pourrait noter un objet inconnu, il combine son vecteur de préférences latent avec le vecteur de caractéristiques de l’objet et en déduit un score. Des variantes classiques de cette idée ont alimenté des systèmes bien connus pour le cinéma, les produits et la musique.

Des lignes droites aux préférences courbes

Une méthode influente, la Factorisation de Matrice à Marge Maximale (MMMF), va plus loin en traitant les notes comme des catégories ordonnées : une étoile est moins bonne que deux, qui sont moins bonnes que trois, et ainsi de suite. MMMF imagine les représentations d’objets comme des points dans un espace et les utilisateurs comme des surfaces planes (hyperplans) qui divisent cet espace en zones de notation. Chaque zone correspond à un niveau de note différent, et la méthode écarte autant que possible ces surfaces de séparation pour réduire la confusion entre notes voisines. Cependant, parce que ces surfaces doivent être planes et parallèles, le modèle ne peut exprimer que des patrons de goût simples et approximativement linéaires.

Une vision plus profonde des goûts et des objets

Les préférences réelles sont rarement aussi simples. Considérez trois spectateurs : l’un qui aime les films d’action modérés et équilibrés, un autre qui veut beaucoup d’action mais peu d’intensité, et un troisième qui apprécie tout film à haute action. De tels comportements tracent des frontières courbes et irrégulières dans l’espace des films, pas des tranches parallèles nettes. Deep MMMF aborde ce point en conservant l’ossature familière de MMMF mais en plaçant des réseaux neuronaux profonds au‑dessus de ses représentations liées aux utilisateurs, aux objets et aux seuils de notation. D’abord, le modèle construit des embeddings compacts standard pour les utilisateurs, les objets et les seuils de note, comme dans MMMF. Ensuite, des modules neuronaux distincts transforment chacun de ces embeddings au travers de couches de fonctions non linéaires, courbant les frontières de notation en formes plus riches sans augmenter le nombre de dimensions latentes.

Ce que révèlent les expériences

Les auteurs testent Deep MMMF sur trois jeux de données populaires : MovieLens 1M, EachMovie, et un ensemble de produits Amazon Prime Pantry. Ils examinent deux situations. En faible généralisation, le système prédit des notes pour des paires utilisateur–objet mises de côté mais où les utilisateurs et les objets ont été vus pendant l’entraînement. En forte généralisation, le système doit faire face à des utilisateurs entièrement nouveaux dont les notes passées n’ont pas servi à ajuster le modèle principal, il doit donc inférer rapidement leurs goûts à partir de zéro. Dans les deux situations et pour tous les jeux de données, Deep MMMF produit systématiquement des erreurs de prédiction plus faibles qu’un large éventail de méthodes de pointe, y compris le MMMF classique, des modèles de factorisation probabilistes et plusieurs recommandateurs basés sur l’apprentissage profond. Des tests statistiques confirment que ces améliorations ne sont pas dues au hasard.

Pourquoi cette approche est prometteuse

En conservant la taille originale des représentations latentes tout en ajoutant des transformations non linéaires et flexibles, Deep MMMF sépare nettement « plus de dimensions » et « fonctions plus expressives ». Cela permet de montrer que les gains proviennent réellement d’une meilleure modélisation des motifs de goût complexes plutôt que d’un simple agrandissement du modèle. Les résultats suggèrent que les systèmes de recommandation peuvent mieux respecter l’ordre naturel des notes et la nature enchevêtrée des préférences humaines sans sacrifier l’interprétabilité ni l’efficacité. En termes pratiques, cela signifie que les recommandateurs futurs basés sur des idées comme Deep MMMF pourraient fournir des suggestions plus précises et personnalisées pour le cinéma, les achats et au‑delà, surtout lorsque les goûts des utilisateurs ne suivent pas des lignes droites simples.

Citation: Kumar, S., Kagita, V.R., Kumar, V. et al. Deep maximum margin matrix factorization. Sci Rep 16, 14518 (2026). https://doi.org/10.1038/s41598-026-44839-0

Mots-clés: systèmes de recommandation, filtrage collaboratif, apprentissage profond, factorisation de matrice, notations des utilisateurs