Clear Sky Science · it

Fattorizzazione di matrici a margine massimo profondo

Perché suggerimenti più intelligenti sono importanti

Dalle serate al cinema agli acquisti online, ci affidiamo a piattaforme digitali che cercano di indovinare cosa potremmo gradire in futuro. Queste previsioni derivano da algoritmi di raccomandazione che apprendono dalle nostre scelte e valutazioni passate. Ma i gusti delle persone sono disordinati e raramente seguono schemi semplici. Questo articolo introduce un nuovo modo di modellare quei gusti frammentati, chiamato Deep Maximum Margin Matrix Factorization (Deep MMMF), che mira a trasformare dati di valutazione sparsi e parziali in raccomandazioni più nitide e affidabili.

Come funzionano di solito i raccomandatori odierni

Molti raccomandatori moderni si basano su una tecnica chiamata fattorizzazione di matrici. Immaginate una grande tabella dove le righe sono gli utenti, le colonne gli oggetti e ogni cella contiene una valutazione, se presente. La fattorizzazione di matrici comprime questa enorme e sparsa tabella in due mappe più piccole: una descrive preferenze latenti degli utenti e l’altra descrive tratti latenti degli oggetti. Quando il sistema deve predire come un utente potrebbe valutare un oggetto non visto, combina il vettore di preferenze latente dell’utente con il vettore dei tratti dell’oggetto per ottenere un punteggio. Variazioni classiche di questa idea hanno alimentato sistemi ben noti per film, prodotti e musica.

Da linee rette a preferenze curve

Un metodo influente, Maximum Margin Matrix Factorization (MMMF), compie un passo in più trattando le valutazioni come categorie ordinate: una stella è peggiore di due, che è peggiore di tre, e così via. MMMF immagina le rappresentazioni degli oggetti come punti nello spazio e gli utenti come superfici piane di separazione (iperpiani) che dividono questo spazio in zone di valutazione. Ogni zona corrisponde a un diverso livello di valutazione e il metodo tende ad allontanare il più possibile queste superfici divisorie per ridurre la confusione tra valutazioni vicine. Tuttavia, poiché queste superfici devono essere piatte e parallele, il modello può esprimere solo schemi di gusto semplici e grossomodo lineari.

Una visione più profonda di gusti e oggetti

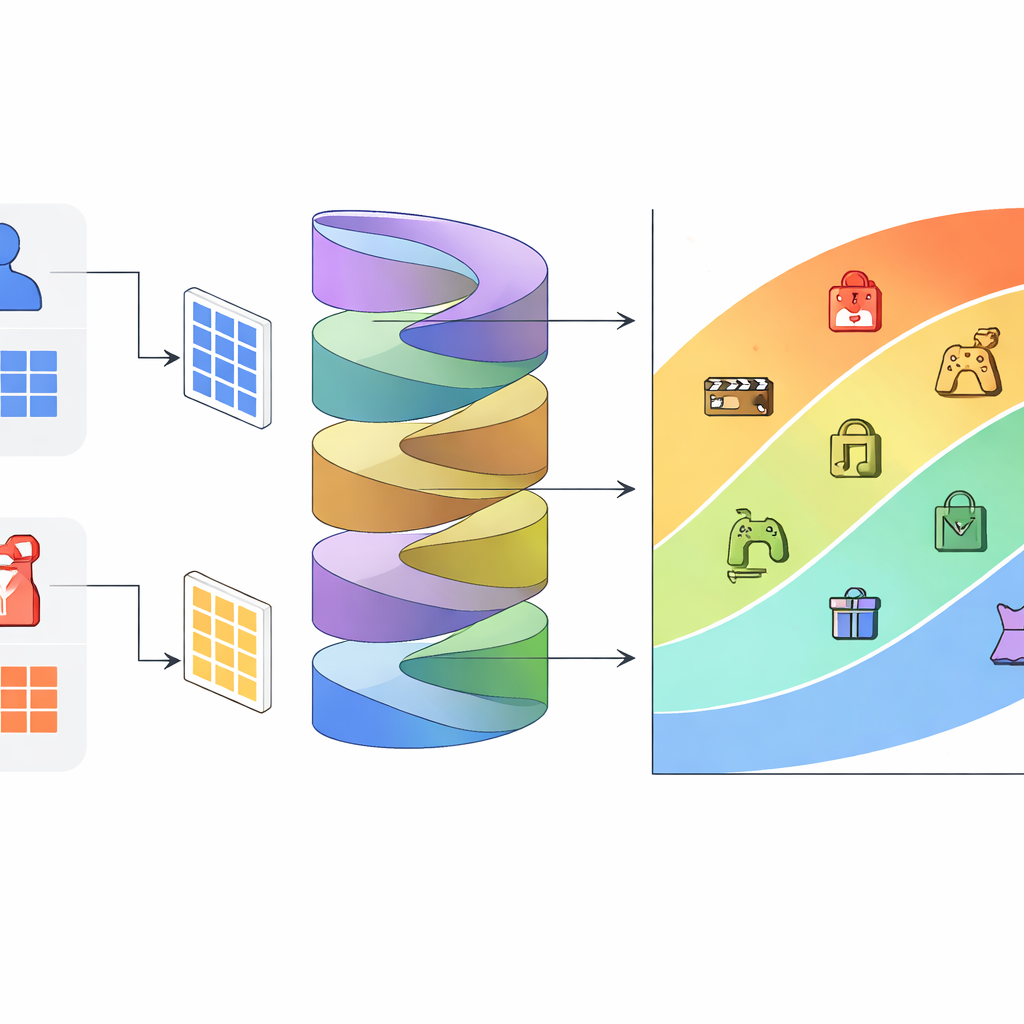

Le preferenze reali raramente sono così semplici. Considerate tre spettatori: uno che ama film bilanciati con azione moderata, un altro che vuole molta azione ma bassa intensità, e un terzo che apprezza qualsiasi film ad alta azione. Comportamenti del genere disegnano confini curvi e irregolari nello spazio dei film, non fette parallele e ordinate. Deep MMMF affronta questo mantenendo la struttura di base di MMMF ma sovrapponendo reti neurali profonde alle rappresentazioni legate a utenti, oggetti e soglie di valutazione. Per prima cosa, il modello costruisce embedding compatti standard per utenti, oggetti e soglie di valutazione, proprio come MMMF. Poi, moduli neurali separati trasformano ciascuno di questi embedding attraverso strati di funzioni non lineari, piegando i confini di valutazione in forme più ricche senza aumentare il numero delle dimensioni latenti.

Cosa rivelano gli esperimenti

Gli autori testano Deep MMMF su tre dataset popolari: MovieLens 1M, EachMovie e un insieme di prodotti Amazon Prime Pantry. Esaminano due situazioni. Nella debole generalizzazione, il sistema predice valutazioni per coppie utente–oggetto tenute fuori ma in cui sia gli utenti sia gli oggetti sono stati visti durante l’addestramento. Nella forte generalizzazione, il sistema si trova di fronte a utenti completamente nuovi le cui valutazioni passate non sono state usate per adattare il modello principale, quindi deve inferire rapidamente i loro gusti da zero. In entrambe le situazioni e in tutti i dataset, Deep MMMF produce costantemente errori di previsione inferiori rispetto a un ampio insieme di metodi di riferimento, inclusi MMMF classico, modelli probabilistici di fattorizzazione e diversi raccomandatori basati su deep learning. Test statistici confermano che questi miglioramenti non sono dovuti al caso.

Perché questo approccio è promettente

Mantenendo la dimensione originale delle rappresentazioni latenti e aggiungendo trasformazioni non lineari flessibili, Deep MMMF separa nettamente «più dimensioni» da «funzioni più espressive». Questo rende più chiaro che i guadagni derivano realmente da una migliore modellazione di schemi di gusto complessi anziché da un modello più grande. I risultati suggeriscono che i sistemi di raccomandazione possono rispettare meglio l’ordine naturale delle valutazioni e la natura intricata delle preferenze umane senza sacrificare interpretabilità o efficienza. In termini pratici, ciò significa che i futuri raccomandatori basati su idee come Deep MMMF potrebbero offrire suggerimenti più accurati e personalizzati per film, acquisti e oltre, soprattutto quando i gusti degli utenti non seguono semplici linee rette.

Citazione: Kumar, S., Kagita, V.R., Kumar, V. et al. Deep maximum margin matrix factorization. Sci Rep 16, 14518 (2026). https://doi.org/10.1038/s41598-026-44839-0

Parole chiave: sistemi di raccomandazione, filtro collaborativo, apprendimento profondo, fattorizzazione di matrici, valutazioni degli utenti