Clear Sky Science · es

Factorización matricial profunda de margen máximo

Por qué importan las sugerencias más inteligentes

Desde noches de cine hasta compras en línea, confiamos en plataformas digitales para adivinar qué nos podría gustar a continuación. Esas conjeturas provienen de algoritmos de recomendación que aprenden de nuestras elecciones y valoraciones pasadas. Pero los gustos de las personas son desordenados y rara vez siguen patrones simples. Este artículo presenta una nueva manera de modelar esos gustos desordenados, llamada Factorización Matricial de Margen Máximo Profunda (Deep MMMF), que busca convertir datos de valoraciones dispersos y parciales en recomendaciones más nítidas y fiables.

Cómo funcionan habitualmente los recomendadores hoy

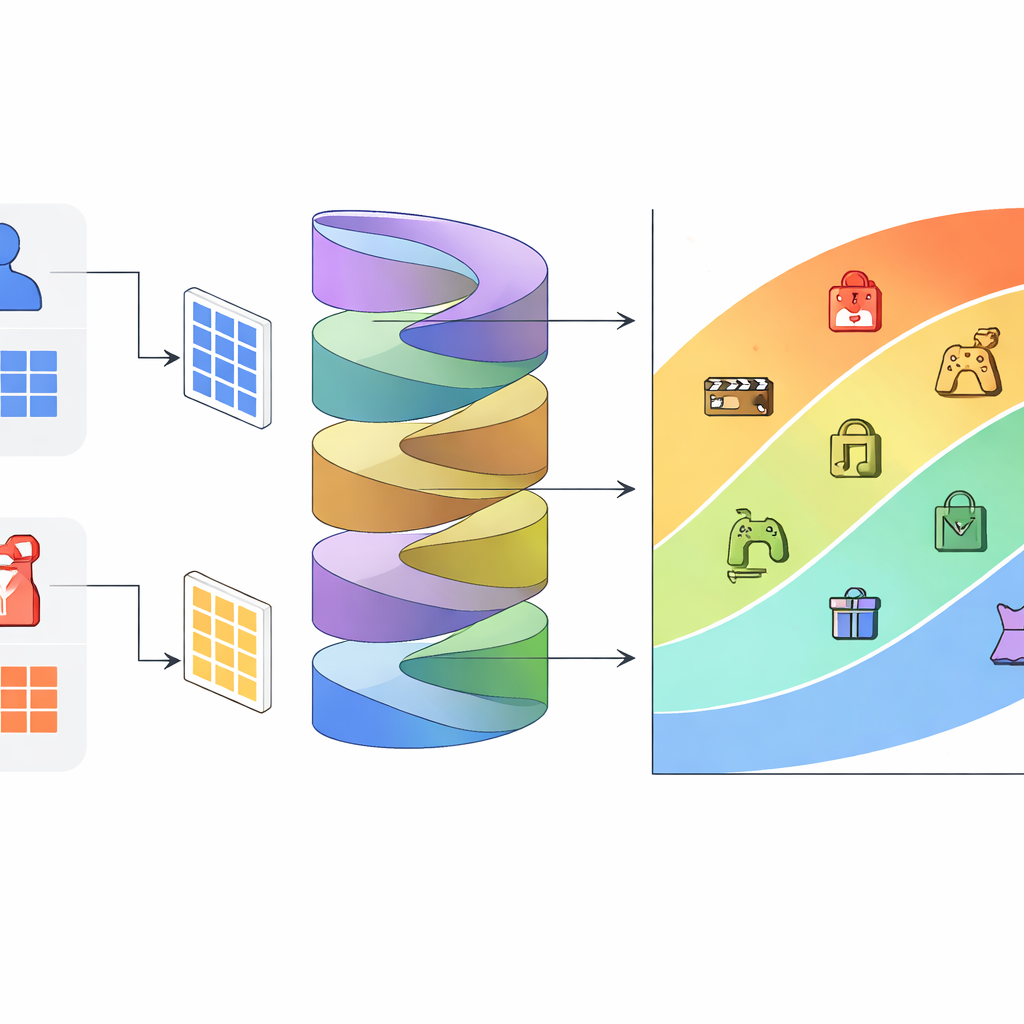

Muchos recomendadores modernos se basan en una técnica llamada factorización matricial. Imagínese una tabla gigante donde las filas son usuarios, las columnas son ítems y cada celda contiene una valoración si existe. La factorización matricial comprime esta tabla enorme y dispersa en dos mapas más pequeños: uno describe las preferencias ocultas de los usuarios y el otro describe los rasgos ocultos de los ítems. Cuando el sistema quiere predecir cómo podría valorar un usuario un ítem no visto, combina su vector de preferencias ocultas con el vector de rasgos del ítem y lo convierte en una puntuación. Variantes clásicas de esta idea han impulsado sistemas conocidos para cine, productos y música.

De líneas rectas a preferencias curvadas

Un método influyente, Factorización Matricial de Margen Máximo (MMMF), va un paso más allá al tratar las valoraciones como categorías ordenadas: una estrella es peor que dos, que es peor que tres, y así sucesivamente. MMMF imagina las representaciones de los ítems como puntos en un espacio y a los usuarios como superficies cortantes planas (hiperplanos) que dividen ese espacio en zonas de valoración. Cada zona corresponde a un nivel de valoración distinto, y el método separa estas superficies tanto como sea posible para reducir la confusión entre valoraciones vecinas. Sin embargo, porque estas superficies deben ser planas y paralelas, el modelo solo puede expresar patrones de gusto simples y aproximadamente lineales.

Una visión más profunda de gustos e ítems

Las preferencias reales rara vez son tan simples. Considérese tres espectadores: uno que disfruta de películas con acción moderada y equilibrada, otro que quiere mucha acción pero poca intensidad, y un tercero que goza de cualquier película de alta acción. Tales comportamientos esculpen fronteras curvadas e irregulares en el espacio de las películas, no rebanadas paralelas y ordenadas. Deep MMMF aborda esto manteniendo la columna vertebral familiar de MMMF pero colocando redes neuronales profundas sobre sus representaciones relacionadas con usuarios, ítems y umbrales de valoración. Primero, el modelo construye incrustaciones compactas estándar para usuarios, ítems y umbrales de valoración, igual que MMMF. Luego, módulos neuronales separados transforman cada una de estas incrustaciones mediante capas de funciones no lineales, doblando las fronteras de valoración en formas más ricas sin aumentar el número de dimensiones ocultas.

Qué revelan los experimentos

Los autores prueban Deep MMMF en tres conjuntos de datos populares: MovieLens 1M, EachMovie y un conjunto de productos de Amazon Prime Pantry. Examinaron dos situaciones. En la generalización débil, el sistema predice valoraciones para pares usuario–ítem que se retiran pero donde tanto usuarios como ítems se vieron durante el entrenamiento. En la generalización fuerte, el sistema se enfrenta a usuarios completamente nuevos cuyas valoraciones pasadas no se usaron para ajustar el modelo principal, por lo que debe inferir rápidamente sus gustos desde cero. En ambas situaciones y en todos los conjuntos de datos, Deep MMMF produce de forma consistente errores de predicción menores que una amplia colección de métodos líderes, incluyendo MMMF clásico, modelos probabilísticos de factorización y varios recomendadores basados en aprendizaje profundo. Las pruebas estadísticas confirman que estas mejoras no se deben al azar.

Por qué este enfoque es prometedor

Manteniendo el tamaño original de las representaciones ocultas mientras añade transformaciones flexibles y no lineales, Deep MMMF separa claramente “más dimensiones” de “funciones más expresivas”. Esto facilita ver que las ganancias provienen realmente de un mejor modelado de patrones de gusto complejos en lugar de simplemente un modelo más grande. Los resultados sugieren que los sistemas de recomendación pueden respetar mejor el orden natural de las valoraciones y la naturaleza enmarañada de las preferencias humanas sin sacrificar interpretabilidad ni eficiencia. En términos prácticos, esto significa que futuros recomendadores basados en ideas como Deep MMMF podrían ofrecer sugerencias más precisas y personalizadas en cine, compras y otros ámbitos, especialmente cuando los gustos de los usuarios no siguen líneas rectas simples.

Cita: Kumar, S., Kagita, V.R., Kumar, V. et al. Deep maximum margin matrix factorization. Sci Rep 16, 14518 (2026). https://doi.org/10.1038/s41598-026-44839-0

Palabras clave: sistemas de recomendación, filtrado colaborativo, aprendizaje profundo, factorización matricial, valoraciones de usuarios