Clear Sky Science · de

Tiefes Maximum-Margin-Matrixfaktorisierung

Warum intelligentere Vorschläge wichtig sind

Von Filmabenden bis zum Online-Shopping verlassen wir uns auf digitale Plattformen, die erraten, was uns als Nächstes gefallen könnte. Diese Vorhersagen stammen von Empfehlungsalgorithmen, die aus unseren bisherigen Entscheidungen und Bewertungen lernen. Doch Geschmack ist unordentlich und folgt selten einfachen Mustern. Dieses Papier stellt eine neue Methode zur Modellierung solcher unregelmäßigen Präferenzen vor, genannt Deep Maximum Margin Matrix Factorization (Deep MMMF), die darauf abzielt, verstreute, teilweise vorhandene Bewertungsdaten in schärfere, verlässlichere Empfehlungen zu verwandeln.

Wie heutige Empfehlungsalgorithmen üblicherweise arbeiten

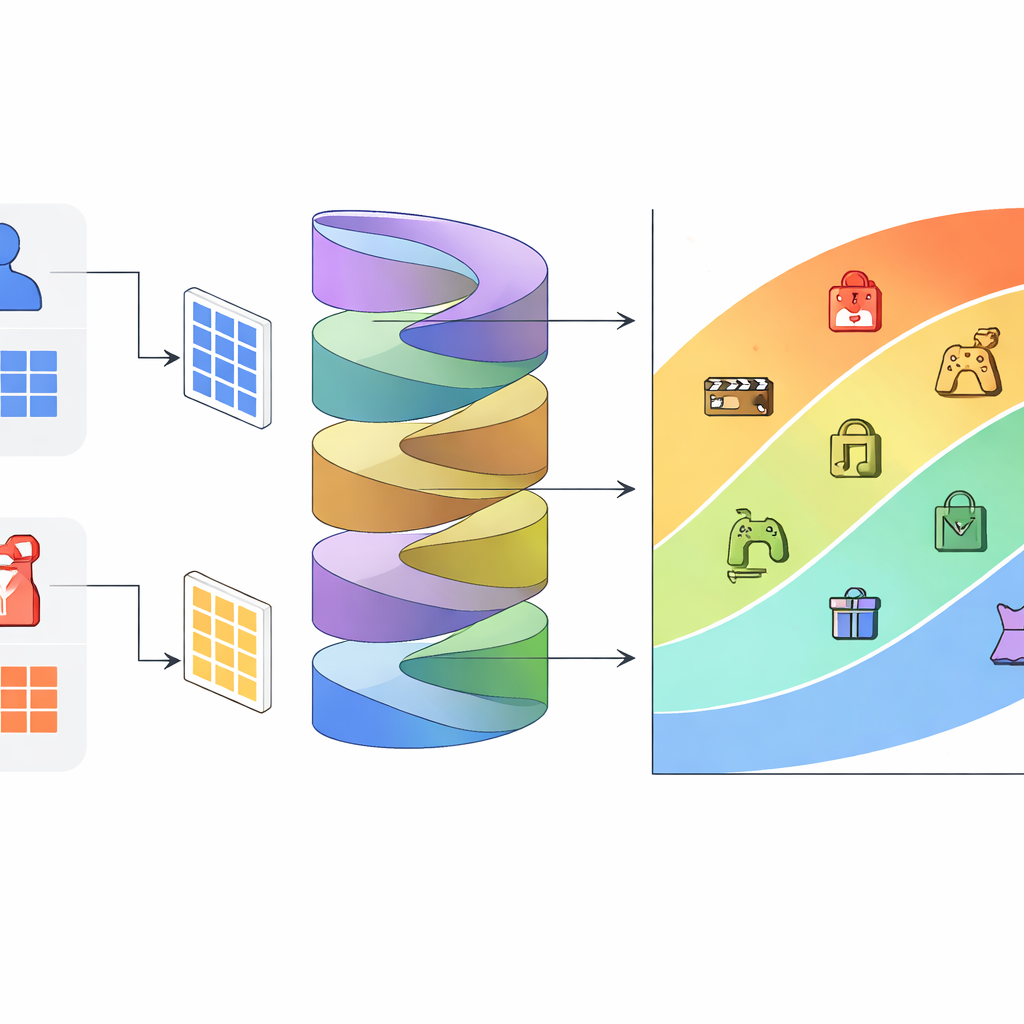

Viele moderne Empfehlungssysteme basieren auf einer Technik namens Matrixfaktorisierung. Stellen Sie sich eine gewaltige Tabelle vor, in der Zeilen Nutzer, Spalten Objekte sind und jede Zelle eine Bewertung enthält, falls vorhanden. Die Matrixfaktorisierung komprimiert diese große, spärliche Tabelle in zwei kleinere Karten: die eine beschreibt verborgene Präferenzen der Nutzer, die andere verborgene Merkmale der Objekte. Wenn das System vorhersagen soll, wie ein Nutzer ein unbekanntes Objekt bewerten könnte, kombiniert es dessen latenten Präferenzvektor mit dem latenten Merkmalsvektor des Objekts und wandelt das in einen Wert um. Klassische Varianten dieser Idee treiben bekannte Systeme für Filme, Produkte und Musik an.

Von geraden Linien zu gekrümmten Präferenzen

Eine einflussreiche Methode, Maximum Margin Matrix Factorization (MMMF), geht einen Schritt weiter, indem sie Bewertungen als geordnete Kategorien behandelt: ein Stern ist schlechter als zwei, zwei sind schlechter als drei, und so weiter. MMMF stellt sich Objektrepräsentationen als Punkte im Raum und Nutzer als flache Trennflächen (Hyperebenen) vor, die diesen Raum in Bewertungszonen unterteilen. Jede Zone entspricht einem bestimmten Bewertungsniveau, und die Methode verschiebt diese Trennflächen so weit wie möglich voneinander, um Verwechslungen zwischen benachbarten Bewertungen zu reduzieren. Da diese Flächen jedoch flach und parallel sein müssen, kann das Modell nur einfache, annähernd lineare Geschmacksprofile ausdrücken.

Eine tiefere Sicht auf Vorlieben und Objekte

Wirkliche Präferenzen sind selten so einfach. Betrachten Sie drei Zuschauer: einen, der ausgewogene, mäßig actionreiche Filme mag, einen anderen, der hohe Action aber geringe Intensität wünscht, und einen dritten, der jeden hoch actionreichen Film genießt. Solche Verhaltensweisen erzeugen gekrümmte und unregelmäßige Grenzen im Filmuniversum, nicht ordentliche parallele Scheiben. Deep MMMF geht dieses Problem an, indem es das vertraute MMMF-Rückgrat beibehält, aber tiefe neuronale Netze über die benutzer-, objekt- und bewertungsbezogenen Repräsentationen legt. Zuerst baut das Modell wie MMMF standardisierte kompakte Einbettungen für Nutzer, Objekte und Bewertungsschwellen auf. Dann transformieren separate neuronale Module jede dieser Einbettungen durch Schichten nichtlinearer Funktionen und biegen so die Bewertungsgrenzen in reichere Formen, ohne die Anzahl der verborgenen Dimensionen zu erhöhen.

Was die Experimente zeigen

Die Autoren testen Deep MMMF an drei beliebten Datensätzen: MovieLens 1M, EachMovie und einem Amazon Prime Pantry-Produktsatz. Sie untersuchen zwei Situationen. Bei schwacher Generalisierung sagt das System Bewertungen für Nutzer–Objekt-Paare voraus, die zurückgehalten wurden, wobei sowohl Nutzer als auch Objekte während des Trainings gesehen wurden. Bei starker Generalisierung steht das System völlig neuen Nutzern gegenüber, deren frühere Bewertungen nicht zur Anpassung des Hauptmodells verwendet wurden, sodass es deren Vorlieben schnell von Grund auf inferieren muss. In beiden Situationen und in allen Datensätzen erzielt Deep MMMF durchgängig geringere Vorhersagefehler als eine breite Sammlung führender Methoden, einschließlich klassischem MMMF, probabilistischen Faktorisierungsmodellen und mehreren Deep-Learning-Empfehlern. Statistische Tests bestätigen, dass diese Verbesserungen nicht zufällig sind.

Warum dieser Ansatz vielversprechend ist

Indem Deep MMMF die ursprüngliche Größe der latenten Repräsentationen beibehält und gleichzeitig flexible, nichtlineare Transformationen hinzufügt, trennt das Modell sauber „mehr Dimensionen“ von „ausdrucksstärkeren Funktionen“. Das macht klarer, dass die Verbesserungen tatsächlich aus einer besseren Modellierung komplexer Geschmacksstrukturen stammen und nicht nur von einem größeren Modell. Die Ergebnisse deuten darauf hin, dass Empfehlungssysteme die natürliche Ordnung von Bewertungen und die vertrackte Natur menschlicher Präferenzen besser respektieren können, ohne Interpretierbarkeit oder Effizienz zu opfern. Praktisch bedeutet das, dass zukünftige Empfehlungsdienste, die auf Ideen wie Deep MMMF basieren, genauere, personalisierte Vorschläge für Filme, Einkäufe und darüber hinaus liefern könnten — insbesondere wenn Nutzerpräferenzen keine einfachen Geraden bilden.

Zitation: Kumar, S., Kagita, V.R., Kumar, V. et al. Deep maximum margin matrix factorization. Sci Rep 16, 14518 (2026). https://doi.org/10.1038/s41598-026-44839-0

Schlüsselwörter: Empfehlungssysteme, kollaboratives Filtern, Deep Learning, Matrixfaktorisierung, Benutzerbewertungen