Clear Sky Science · pt

Fatoração de matriz profunda com margem máxima

Por que sugestões mais inteligentes importam

De noites de cinema a compras online, confiamos em plataformas digitais para adivinhar o que podemos gostar a seguir. Essas suposições vêm de algoritmos de recomendação que aprendem com nossas escolhas e avaliações passadas. Mas os gostos das pessoas são confusos e raramente seguem padrões simples. Este artigo introduz uma nova forma de modelar esses gostos irregulares, chamada Fatoração de Matriz Profunda com Margem Máxima (Deep MMMF), que busca transformar dados dispersos e parciais de avaliações em recomendações mais nítidas e confiáveis.

Como os recomendadores de hoje normalmente funcionam

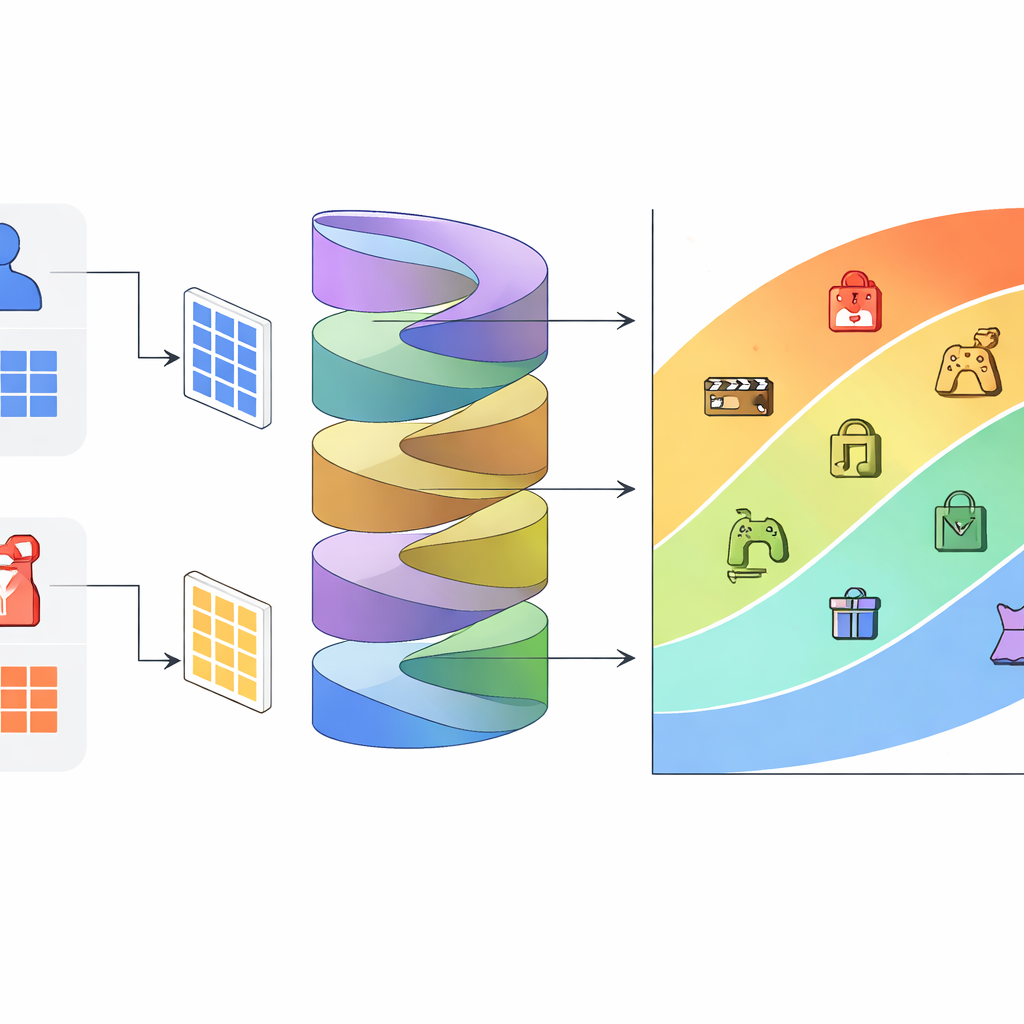

Muitos recomendadores modernos são construídos em torno de uma técnica chamada fatoração de matriz. Imagine uma tabela gigante onde as linhas são usuários, as colunas são itens e cada célula contém uma avaliação, se houver. A fatoração de matriz comprime essa tabela enorme e esparsa em dois mapas menores: um descreve preferências ocultas dos usuários e o outro descreve traços ocultos dos itens. Quando o sistema quer prever como um usuário pode avaliar um item desconhecido, ele combina o vetor de preferência oculto do usuário com o vetor de traços do item e transforma isso em uma pontuação. Variações clássicas dessa ideia impulsionaram sistemas conhecidos para filmes, produtos e música.

De linhas retas a preferências curvas

Um método influente, Fatoração de Matriz com Margem Máxima (MMMF), vai um passo além ao tratar avaliações como categorias ordenadas: uma estrela é pior que duas, que é pior que três, e assim por diante. O MMMF imagina representações de itens como pontos no espaço e usuários como superfícies planas de corte (hiperplanos) que dividem esse espaço em zonas de avaliação. Cada zona corresponde a um nível de avaliação diferente, e o método afasta ao máximo essas superfícies divisórias para reduzir a confusão entre avaliações vizinhas. No entanto, porque essas superfícies precisam ser planas e paralelas, o modelo só consegue expressar padrões de gosto simples, aproximadamente lineares.

Uma visão mais profunda de gostos e itens

Preferências reais raramente são tão simples. Considere três espectadores: um que gosta de filmes de ação moderada e equilibrados, outro que quer muita ação mas baixa intensidade, e um terceiro que aprecia qualquer filme com muita ação. Esses comportamentos desenham limites curvos e irregulares no espaço dos filmes, não fatias paralelas e bem ordenadas. O Deep MMMF enfrenta isso mantendo a espinha dorsal familiar do MMMF, mas colocando redes neurais profundas sobre suas representações relacionadas a usuários, itens e limites de avaliação. Primeiro, o modelo constrói embeddings compactos padrão para usuários, itens e limites de avaliação, assim como o MMMF. Em seguida, módulos neurais separados transformam cada um desses embeddings por camadas de funções não lineares, curvando as fronteiras de avaliação em formas mais ricas sem aumentar o número de dimensões ocultas.

O que os experimentos revelam

Os autores testam o Deep MMMF em três conjuntos de dados populares: MovieLens 1M, EachMovie e um conjunto de produtos da Amazon Prime Pantry. Eles examinam duas situações. Na generalização fraca, o sistema prevê avaliações para pares usuário–item que foram retidos, mas onde tanto usuários quanto itens foram vistos durante o treinamento. Na generalização forte, o sistema enfrenta usuários inteiramente novos cujas avaliações passadas não foram usadas para ajustar o modelo principal, de modo que deve inferir rapidamente seus gostos do zero. Em ambas as situações e em todos os conjuntos de dados, o Deep MMMF produz consistentemente erros de predição menores do que uma ampla coleção de métodos de ponta, incluindo o MMMF clássico, modelos probabilísticos de fatoração e vários recomendadores baseados em deep learning. Testes estatísticos confirmam que essas melhorias não se devem ao acaso.

Por que essa abordagem é promissora

Ao manter o tamanho original das representações ocultas enquanto adiciona transformações flexíveis e não lineares, o Deep MMMF separa de forma clara “mais dimensões” de “funções mais expressivas.” Isso facilita concluir que os ganhos vêm realmente de um melhor modelamento de padrões complexos de gosto, e não apenas de um modelo maior. Os resultados sugerem que sistemas de recomendação podem respeitar melhor a ordenação natural das avaliações e a natureza entrelaçada das preferências humanas sem sacrificar interpretabilidade ou eficiência. Em termos práticos, isso significa que recomendadores futuros construídos com ideias como o Deep MMMF poderiam oferecer sugestões mais precisas e personalizadas em filmes, compras e além, especialmente quando os gostos dos usuários não seguem linhas retas simples.

Citação: Kumar, S., Kagita, V.R., Kumar, V. et al. Deep maximum margin matrix factorization. Sci Rep 16, 14518 (2026). https://doi.org/10.1038/s41598-026-44839-0

Palavras-chave: sistemas de recomendação, filtragem colaborativa, aprendizado profundo, fatoração de matriz, avaliações de usuários