Clear Sky Science · pt

Uma análise em frequência da inicialização de filterbank e da augmentação por ruído para LEAF

Por que máquinas que ouvem bem importam

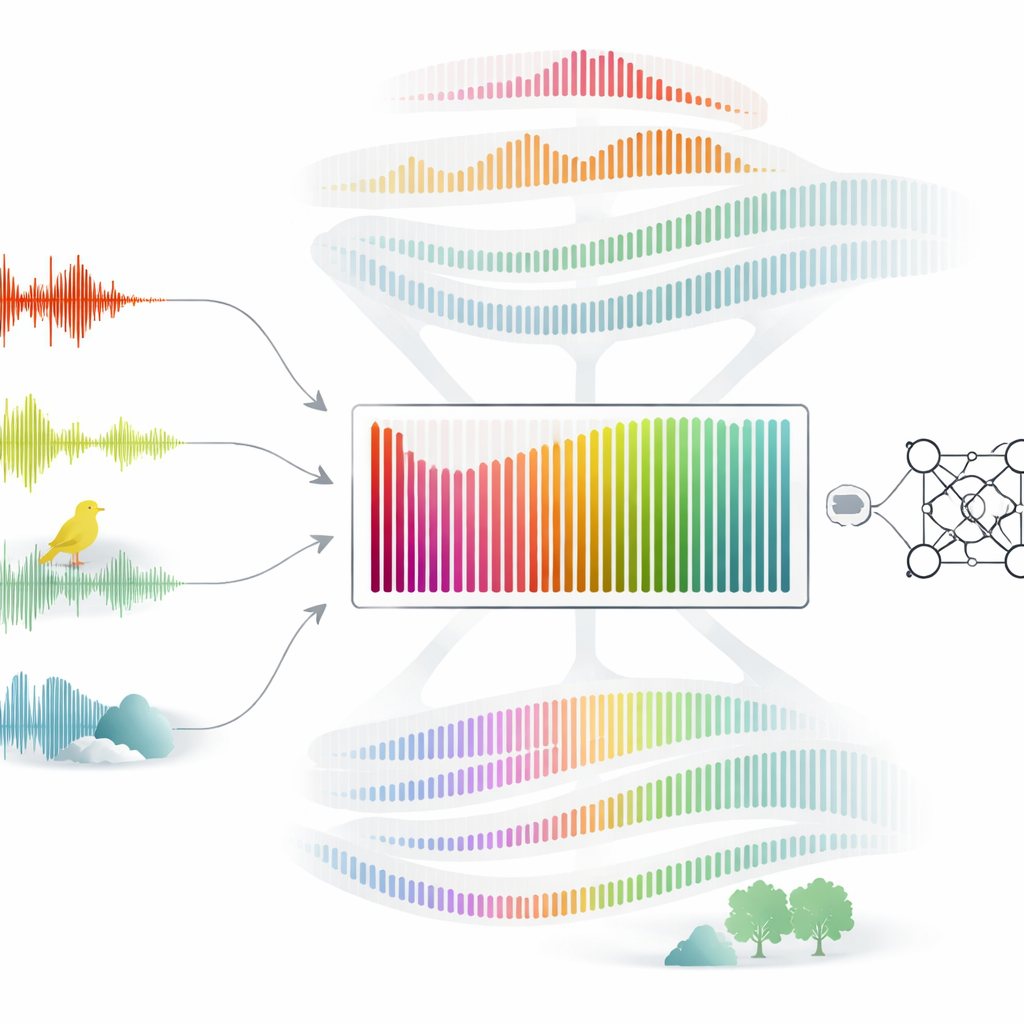

De assistentes de voz a monitoradores de canto de aves, a vida moderna depende de máquinas capazes de ouvir. Nos bastidores, esses sistemas transformam ondas sonoras brutas em números que algoritmos conseguem interpretar. Um novo estudo examina um módulo popular de “orelha inteligente” chamado LEAF, que promete aprender a melhor forma de representar o som para várias tarefas. Os pesquisadores fazem uma pergunta simples, mas importante: essa orelha inteligente realmente se adapta a diferentes trabalhos de escuta, ou fica em grande parte presa ao seu design inicial?

Como as máquinas costumam ouvir

A maioria dos sistemas de IA baseados em áudio não trabalha diretamente com o som bruto. Em vez disso, primeiro passam o sinal por um conjunto fixo de filtros que dividem o som em partes graves, médias e agudas, criando imagens chamadas espectrogramas. Esses filtros muitas vezes se baseiam em como o ouvido humano percebe o timbre, especialmente na denominada escala Mel. Essa abordagem tem um longo histórico de sucesso, mas incorpora pressupostos da audição humana e deixa pouca margem para que o sistema descubra novas formas de escuta específicas para cada tarefa.

Um novo tipo promissor de “orelha” digital

O LEAF foi apresentado como um compromisso entre filtros rígidos e projetados manualmente e sistemas totalmente fim-a-fim que aprendem tudo do zero. Ele imita etapas clássicas de processamento de sinal, mas torna parâmetros-chave, como posições e larguras dos filtros, ajustáveis durante o treinamento. Em princípio, isso deveria permitir que o sistema aprendesse diferentes “perfis de audição” para reconhecimento de fala, detecção de emoção, cenas sonoras urbanas ou atividade de aves. Trabalhos anteriores, porém, sugeriram que na prática apenas uma etapa de normalização posterior no LEAF muda muito, enquanto o próprio filterbank raramente se altera quando começa a partir de um desenho baseado em Mel.

Testando o LEAF em muitos tipos de som

Os autores investigam sistematicamente o comportamento do LEAF em quatro tarefas de escuta muito diferentes: reconhecer palavras-chave faladas, detectar emoção na fala infantil, classificar cenas acústicas do cotidiano e detectar vocalizações de aves. Repetem cada experimento com vários layouts iniciais de filtros: escalas Mel e Bark (ambas inspiradas na audição humana), filtros espaçados uniformemente ao longo da frequência e uma configuração extrema “constante” em que todos os filtros inicialmente escutam a mesma faixa estreita. Eles acompanham tanto o desempenho quanto o quanto as posições e larguras dos filtros realmente mudam. O resultado: desde que os filtros iniciais já cubram a faixa completa de frequências audíveis, o sistema atinge alta acurácia e os filtros mal se movem, independentemente de seguirem Mel, Bark ou um espaçamento linear simples.

Quando o ponto de partida é propositalmente ruim

A situação muda quando o LEAF começa na configuração constante, onde cada filtro ouve o mesmo trecho do espectro. Nesse caso, o sistema é forçado a remodelar seus filtros para cobrir uma faixa mais ampla, e as posições e larguras mudam de forma perceptível. Mesmo assim, o layout final se assenta numa distribuição suave em forma de S ao longo da frequência, e o desempenho nunca alcança totalmente as inicializações melhores. Para investigar mais a fundo, os autores criam versões fortemente modificadas dos dados de reconhecimento de fala: em um caso, mantém-se apenas uma faixa estreita de frequências; em outros, ruídos graves ou agudos são adicionados para mascarar partes do espectro. Surpreendentemente, mesmo quando frequências importantes são removidas ou inundadas por ruído, os filtros aprendidos ainda derivam para um padrão semelhante em S que se estende para regiões com pouca ou nenhuma informação útil.

O que isso significa para interpretar a audição das máquinas

Esses achados sugerem que o filterbank do LEAF é muito mais teimoso do que seu rótulo “aprendível” implica. Uma vez que os filtros partem de uma cobertura razoável do espectro, eles têm pouco incentivo para se adaptar aos padrões de frequência específicos de aves, emoção humana ou sons urbanos. Em vez disso, o trabalho pesado parece ser feito por partes posteriores da rede. Isso enfraquece uma das vantagens anunciadas do LEAF: a ideia de que inspecionar seus filtros revelaria como o modelo se ajusta a diferentes tarefas. Os autores defendem que trabalhos futuros deveriam ajustar procedimentos de treinamento — como usar taxas de aprendizado diferenciadas para camadas iniciais ou truques especiais de otimização — para incentivar mudanças mais significativas nessas primeiras etapas de escuta.

Mensagem principal para não especialistas

Em termos cotidianos, este estudo mostra que dar a uma IA uma “orelha flexível” não garante que ela vá realmente ouvir de forma diferente quando sua tarefa muda. O LEAF tem bom desempenho em várias tarefas de áudio, mas faz isso principalmente mantendo uma maneira ampla e genérica de dividir o som, em vez de inventar novas estratégias de audição específicas por tarefa. Por enquanto, sua força está no desempenho sólido, não na promessa de nos dar uma visão clara e interpretável sobre quais informações o sistema considera importantes em diferentes tipos de som.

Citação: Milling, M., Triantafyllopoulos, A., Rampp, S.D.N. et al. A frequency analysis of filterbank initialisation and noise augmentation for LEAF. Sci Rep 16, 13410 (2026). https://doi.org/10.1038/s41598-026-49403-4

Palavras-chave: aprendizado profundo em áudio, frontends aprendíveis, inicialização de filterbank, reconhecimento de fala e som, dynamics de treinamento