Clear Sky Science · es

Un análisis de frecuencia de la inicialización del banco de filtros y la augmentación por ruido para LEAF

Por qué importan las máquinas que escuchan con criterio

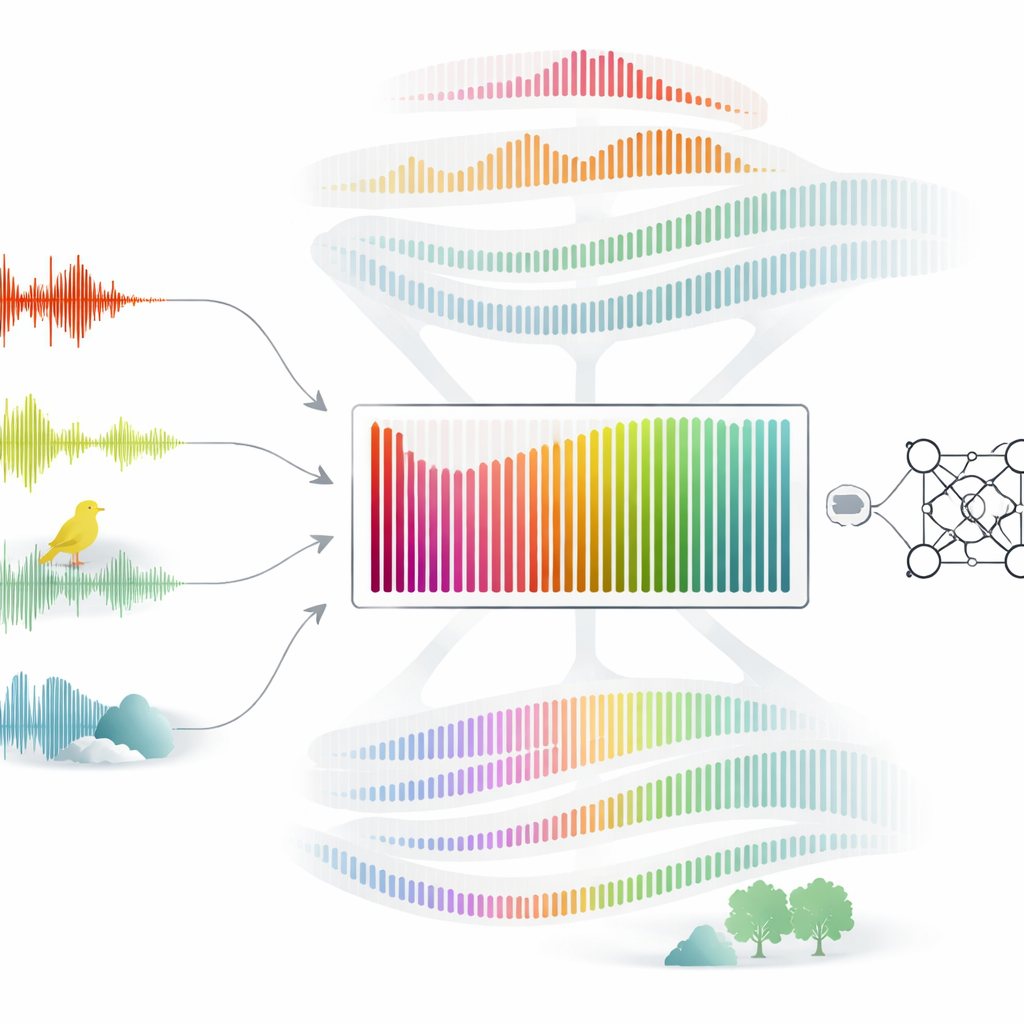

Desde asistentes de voz hasta monitores de canto de aves, la vida moderna depende de máquinas capaces de escuchar. Detrás de escena, estos sistemas transforman las ondas sonoras en números que los algoritmos pueden procesar. Un nuevo estudio examina un módulo “oído inteligente” popular llamado LEAF, que promete aprender la mejor forma de representar el sonido para distintas tareas. Los investigadores plantean una pregunta sencilla pero importante: ¿realmente este oído inteligente se adapta a diferentes tareas auditivas o queda mayormente anclado en su diseño inicial?

Cómo suelen escuchar las máquinas

La mayoría de los sistemas de IA basados en audio no trabajan directamente con la señal cruda. En su lugar, primero pasan la señal por un conjunto fijo de filtros que separan el sonido en partes graves, medias y agudas, creando imágenes llamadas espectrogramas. Estos filtros suelen basarse en cómo el oído humano percibe el tono, especialmente en la llamada escala Mel. Este enfoque tiene un largo historial de éxito, pero incorpora suposiciones sobre la audición humana y deja poco espacio para que el sistema descubra formas nuevas y específicas de escuchar según la tarea.

Un prometedor nuevo tipo de oído digital

LEAF se presentó como un compromiso entre filtros rígidos diseñados a mano y sistemas totalmente end-to-end que aprenden todo desde cero. Imita pasos clásicos del procesamiento de señales, pero convierte parámetros clave —como las posiciones y anchuras de los filtros— en ajustables durante el entrenamiento. En principio, esto debería permitir que el sistema aprenda distintos “perfiles de audición” para reconocimiento de voz, detección de emociones, escenas sonoras urbanas o actividad de aves. Sin embargo, trabajos anteriores sugirieron que en la práctica solo un paso de normalización posterior en LEAF cambia mucho, mientras que el banco de filtros en sí apenas se mueve cuando parte de un diseño basado en Mel.

Poniendo a LEAF a prueba en muchos tipos de sonido

Los autores exploran sistemáticamente el comportamiento de LEAF en cuatro tareas auditivas muy diferentes: reconocer palabras clave habladas, detectar emoción en la voz infantil, clasificar escenas acústicas cotidianas y detectar vocalizaciones de aves. Repiten cada experimento con varios diseños de filtros iniciales: escalas Mel y Bark (ambas inspiradas en la audición humana), filtros espaciados uniformemente a lo largo de la frecuencia y una configuración extrema “constante” donde todos los filtros inicialmente escuchan la misma banda estrecha. Siguen tanto el rendimiento como cuánto cambian realmente las posiciones y anchuras de los filtros. El resultado: siempre que los filtros iniciales ya cubran todo el rango de frecuencias audibles, el sistema alcanza alta precisión y los filtros apenas se mueven, independientemente de si siguen Mel, Bark o un espaciamiento lineal simple.

Cuando el punto de partida es deliberadamente malo

La situación cambia cuando LEAF empieza desde la configuración constante, donde cada filtro percibe el mismo fragmento del espectro. Aquí, el sistema se ve obligado a remodelar sus filtros para cubrir un rango más amplio, y las posiciones y anchuras sí cambian de forma apreciable. Aun así, el diseño final se asienta en una distribución suave con forma de S a lo largo de la frecuencia, y el rendimiento nunca alcanza por completo al de las inicializaciones mejores. Para profundizar, los autores crean versiones fuertemente modificadas de los datos de reconocimiento de voz: en un caso, solo se mantiene una banda estrecha de frecuencias; en otros, se agrega ruido de baja o alta frecuencia para enmascarar partes del espectro. Sorprendentemente, incluso cuando frecuencias importantes se eliminan o se inundan de ruido, los filtros aprendidos siguen desplazándose hacia un patrón similar en S que se extiende a regiones con poca o ninguna información útil.

Qué significa esto para interpretar la escucha de las máquinas

Estos hallazgos sugieren que el banco de filtros de LEAF es mucho más terco de lo que su etiqueta “aprendible” implica. Una vez que los filtros comienzan con una cobertura razonable del espectro, tienen poco incentivo para adaptarse a los patrones de frecuencia específicos de aves, emociones humanas o sonidos urbanos. En su lugar, el trabajo pesado parece recaer en las capas posteriores de la red. Esto debilita una de las ventajas publicitadas de LEAF: que inspeccionar sus filtros revelaría cómo el modelo se ajusta a distintas tareas. Los autores argumentan que trabajos futuros deberían ajustar los procedimientos de entrenamiento —por ejemplo, usando distintas tasas de aprendizaje para las capas iniciales o trucos de optimización especiales— para fomentar cambios más significativos en estas primeras etapas de escucha.

Conclusión para no expertos

En términos sencillos, este estudio muestra que dotar a una IA de un “oído flexible” no garantiza que vaya a escuchar de forma diferente cuando cambia su tarea. LEAF rinde bien en varias tareas de audio, pero lo hace mayormente manteniendo una forma amplia y genérica de dividir el sonido en lugar de inventar estrategias de audición específicas por tarea. Por ahora, su fortaleza radica en un rendimiento sólido, no en la promesa de ofrecernos una visión clara e interpretable sobre qué información considera importante el sistema en distintos tipos de sonido.

Cita: Milling, M., Triantafyllopoulos, A., Rampp, S.D.N. et al. A frequency analysis of filterbank initialisation and noise augmentation for LEAF. Sci Rep 16, 13410 (2026). https://doi.org/10.1038/s41598-026-49403-4

Palabras clave: aprendizaje profundo de audio, frontales aprendibles, inicialización de bancos de filtros, reconocimiento de habla y sonidos, dinámica de entrenamiento