Clear Sky Science · de

Eine Frequenzanalyse der Filterbankinitialisierung und Rauschaugmentation für LEAF

Warum intelligente Hörmaschinen wichtig sind

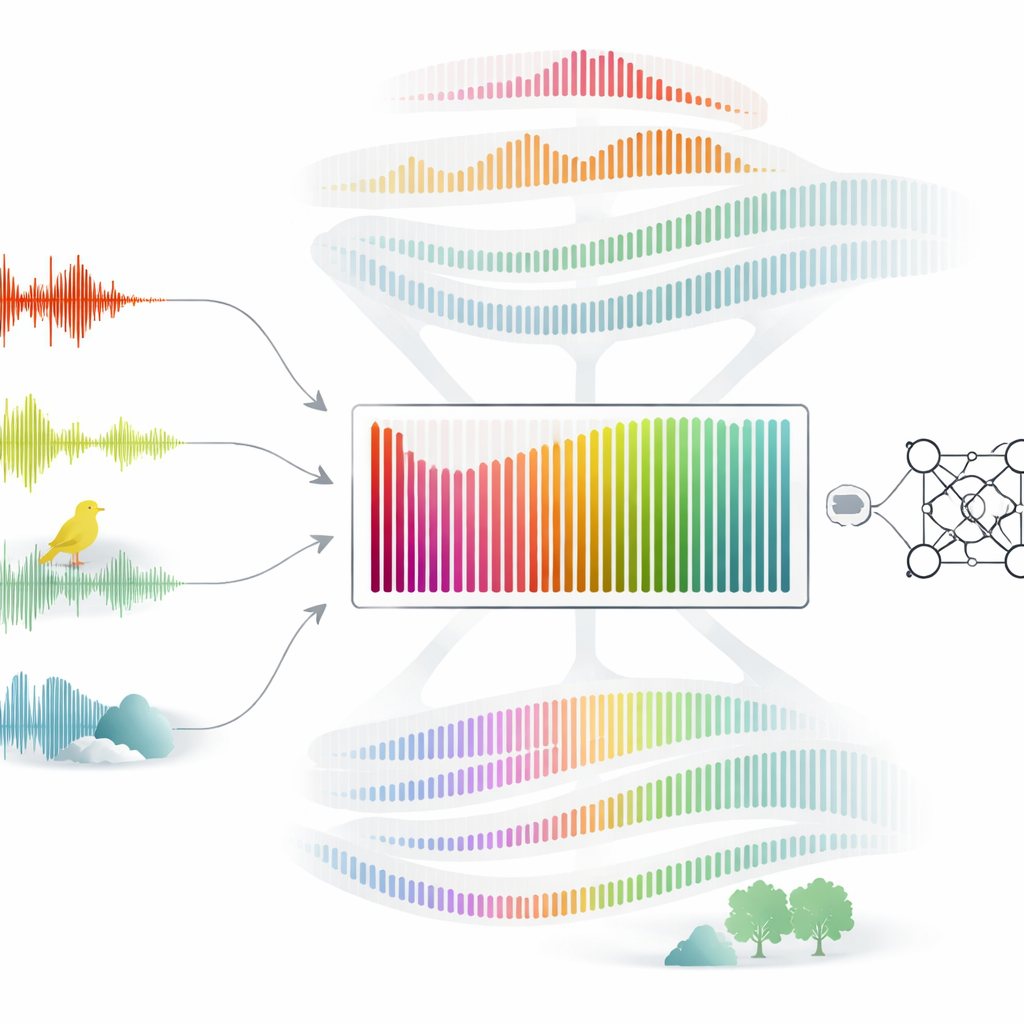

Von Sprachassistenten bis zu Vogelgesangs-Monitoren hängt das moderne Leben von Maschinen ab, die zuhören können. Hinter den Kulissen wandeln diese Systeme Rohschallwellen in Zahlen um, die Algorithmen verarbeiten können. Eine neue Studie untersucht ein populäres „intelligentes Ohr“-Modul namens LEAF, das verspricht, für viele Aufgaben die beste Art der Klangrepräsentation zu erlernen. Die Forscher stellen eine einfache, aber wichtige Frage: Passt sich dieses intelligente Ohr tatsächlich an verschiedene Höraufgaben an, oder ist es größtenteils in seinem Anfangsdesign gefangen?

Wie Maschinen üblicherweise zuhören

Die meisten auf Audio basierenden KI-Systeme arbeiten nicht direkt mit Rohschall. Stattdessen leiten sie das Signal zuerst durch ein festes Set von Filtern, die den Schall in tiefe, mittlere und hohe Bereiche aufteilen und sogenannte Spektrogramme erzeugen. Diese Filter basieren häufig auf dem, wie das menschliche Ohr Tonhöhe wahrnimmt, insbesondere der sogenannten Mel-Skala. Dieser Ansatz hat eine lange Erfolgsgeschichte, bindet aber Annahmen über das menschliche Hören ein und lässt wenig Spielraum für das System, neue, aufgaben-spezifische Hörweisen zu entdecken.

Ein vielversprechender neuer digitaler Ohreindruck

LEAF wurde als Kompromiss zwischen starren, handgefertigten Filtern und vollständig end-to-end Systemen eingeführt, die alles von Grund auf lernen. Es ahmt klassische Signalverarbeitungsschritte nach, macht aber Schlüsselparameter wie Filterpositionen und -breiten während des Trainings anpassbar. Grundsätzlich sollte dies dem System erlauben, unterschiedliche „Hörprofile“ für Spracherkennung, Emotionsdetektion, urbane Klanglandschaften oder Vogelaktivität zu erlernen. Frühere Arbeiten deuteten jedoch an, dass in der Praxis vor allem ein späterer Normalisierungsschritt in LEAF viel verändert, während sich die Filterbank selbst kaum bewegt, wenn sie von einem Mel-basierten Design startet.

LEAF in vielen Hörszenarien auf die Probe gestellt

Die Autor*innen untersuchen systematisch das Verhalten von LEAF in vier sehr unterschiedlichen Höraufgaben: Erkennung gesprochener Schlüsselwörter, Detektion von Emotionen in Kinderstimmen, Klassifikation alltäglicher akustischer Szenen und Erkennung von Vogelrufen. Sie wiederholen jedes Experiment mit mehreren Startfilter-Layouts: Mel- und Bark-Skalen (beide vom menschlichen Hören inspiriert), gleichmäßig über die Frequenz verteilte Filter und eine extreme „konstante“ Konfiguration, bei der alle Filter zunächst denselben engen Bereich abdecken. Sie verfolgen sowohl die Leistung als auch wie stark sich die Filterpositionen und -breiten tatsächlich verändern. Das Ergebnis: Solange die Anfangsfilter bereits den vollen Bereich der hörbaren Frequenzen abdecken, erreicht das System hohe Genauigkeit und die Filter bewegen sich kaum — unabhängig davon, ob sie einer Mel-, Bark- oder einfachen linearen Verteilung folgen.

Wenn der Startpunkt absichtlich schlecht gewählt ist

Anders sieht die Lage aus, wenn LEAF von der konstanten Konfiguration startet, in der jeder Filter denselben Spektralausschnitt hört. Hier ist das System gezwungen, seine Filter umzuformen, um ein breiteres Spektrum abzudecken, und Positionen sowie Breiten ändern sich deutlich. Selbst dann ordnet sich das finale Layout zu einer glatten, S-förmigen Verteilung über die Frequenz an, und die Leistung holt nie vollständig zu den besseren Initialisierungen auf. Um tiefer zu graben, erstellen die Autor*innen stark modifizierte Versionen der Spracherkennungsdaten: In einem Fall bleibt nur ein schmaler Frequenzbereich erhalten; in anderen Fällen wird niederfrequentes oder hochfrequentes Rauschen hinzugefügt, um Teile des Spektrums zu überdecken. Überraschenderweise drifteten die gelernten Filter selbst dann weiterhin in Richtung eines ähnlichen S-förmigen Musters, das sich in Bereiche ausdehnt, die wenig oder gar keine nützliche Information enthalten.

Was das für das Verständnis maschinellen Hörens bedeutet

Diese Befunde legen nahe, dass LEAFs Filterbank deutlich sturer ist, als das Etikett „lernbar“ vermuten lässt. Sobald die Filter mit einer vernünftigen Abdeckung des Spektrums starten, haben sie wenig Anreiz, sich an die spezifischen Frequenzmuster von Vögeln, menschlichen Emotionen oder Stadtgeräuschen anzupassen. Stattdessen scheint die eigentliche Arbeit von späteren Teilen des Netzwerks erledigt zu werden. Das schwächt einen der beworbenen Vorteile von LEAF: dass die Inspektion seiner Filter offenbaren würde, wie sich das Modell an verschiedene Aufgaben anpasst. Die Autor*innen argumentieren, dass zukünftige Arbeiten Trainingsverfahren anpassen sollten — etwa durch unterschiedliche Lernraten für frühe Schichten oder spezielle Optimierungstricks —, um aussagekräftigere Änderungen in diesen ersten Hörstufen zu fördern.

Kerngedanke für Nicht-Expertinnen und Nicht-Experten

Alltagsgemäß zeigt diese Studie, dass ein KI ein „flexibles Ohr“ zu geben nicht garantiert, dass sie tatsächlich anders zuhört, wenn sich ihre Aufgabe ändert. LEAF liefert gute Leistungen in mehreren Audiotasks, tut dies aber überwiegend, indem es eine breite, generische Aufteilung des Schalls beibehält, statt neue, aufgabenspezifische Hörstrategien zu entwickeln. Seine Stärke liegt vorerst in solider Performance, nicht in dem Versprechen, uns klare, interpretierbare Einblicke darin zu geben, welche Informationen das System in verschiedenen Klangtypen für wichtig hält.

Zitation: Milling, M., Triantafyllopoulos, A., Rampp, S.D.N. et al. A frequency analysis of filterbank initialisation and noise augmentation for LEAF. Sci Rep 16, 13410 (2026). https://doi.org/10.1038/s41598-026-49403-4

Schlüsselwörter: audio deep learning, learnable frontends, filterbank initialisation, speech and sound recognition, training dynamics