Clear Sky Science · fr

Analyse fréquentielle de l'initialisation de bancs de filtres et de l'augmentation par bruit pour LEAF

Pourquoi les machines qui écoutent intelligemment comptent

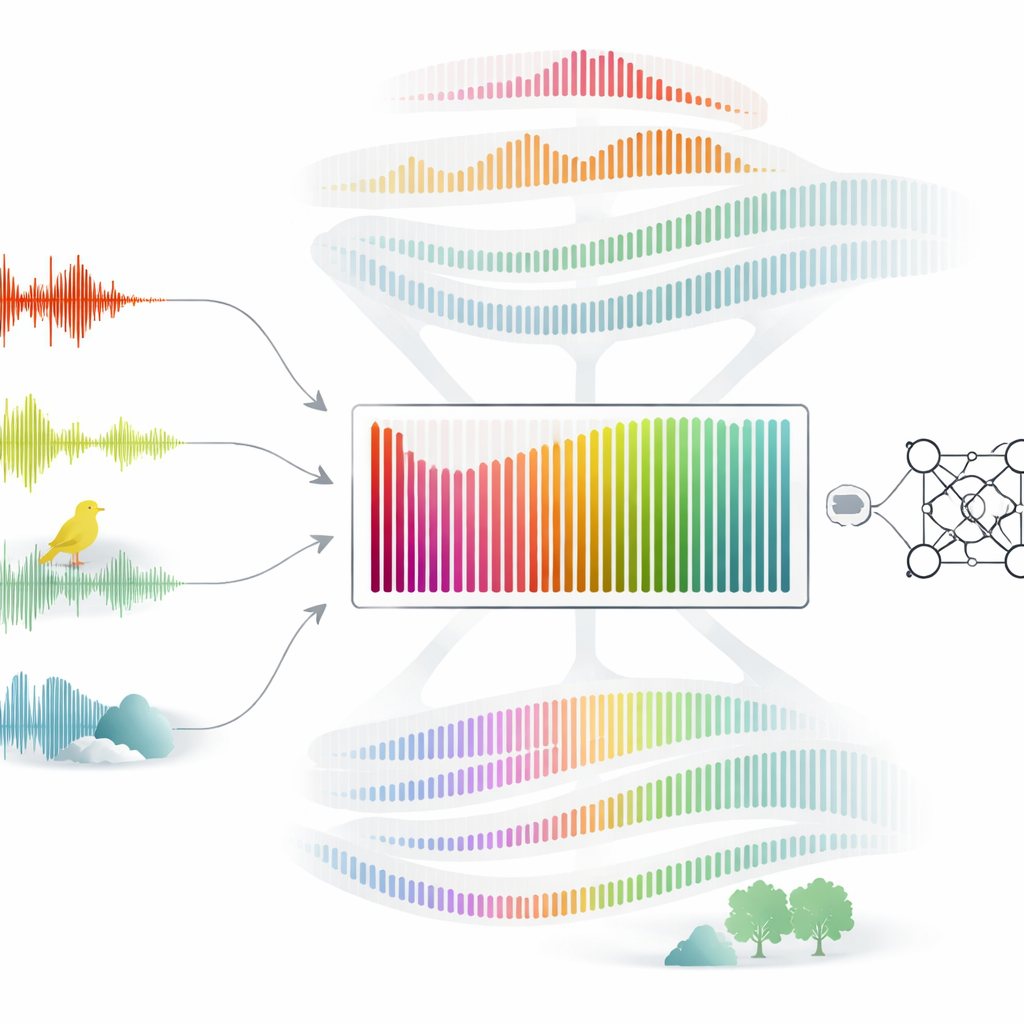

Des assistants vocaux aux moniteurs de chants d'oiseaux, la vie moderne dépend de machines capables d'écouter. En coulisses, ces systèmes transforment les ondes sonores brutes en nombres compréhensibles par des algorithmes. Une nouvelle étude examine un module « oreille intelligente » populaire appelé LEAF, qui promet d'apprendre la meilleure façon de représenter le son pour de nombreuses tâches. Les chercheurs posent une question simple mais importante : cette oreille intelligente s'adapte-t-elle réellement aux différents emplois d'écoute, ou reste-t-elle essentiellement verrouillée sur sa conception initiale ?

Comment les machines écoutent habituellement

La plupart des systèmes d'IA audio ne traitent pas directement le son brut. Ils passent d'abord le signal à travers un ensemble fixe de filtres qui décomposent le son en parties graves, moyennes et aiguës, créant des images appelées spectrogrammes. Ces filtres reposent souvent sur la manière dont l'oreille humaine perçoit la hauteur, notamment l'échelle dite Mel. Cette approche a fait ses preuves, mais elle intègre des hypothèses issues de l'audition humaine et laisse peu de place au système pour découvrir de nouvelles manières d'écouter spécifiques à la tâche.

Un nouveau type d'oreille numérique prometteur

LEAF a été présenté comme un compromis entre des filtres rigides conçus à la main et des systèmes entièrement de bout en bout qui apprennent tout depuis zéro. Il mime des étapes classiques de traitement du signal, mais rend des paramètres clés — comme les positions et les largeurs des filtres — ajustables pendant l'entraînement. En principe, cela devrait permettre au système d'apprendre différents « profils d'audition » pour la reconnaissance de la parole, la détection d'émotion, les scènes sonores urbaines ou l'activité des oiseaux. Des travaux antérieurs, cependant, laissaient entendre que, en pratique, seule une étape de normalisation ultérieure dans LEAF change beaucoup, tandis que le banc de filtres lui-même bouge à peine lorsqu'il est initialisé à partir d'une conception basée sur Mel.

Tester LEAF sur de nombreux types de sons

Les auteurs sondent systématiquement le comportement de LEAF sur quatre tâches d'écoute très différentes : reconnaître des mots-clés parlés, détecter l'émotion dans la parole d'enfants, classer des scènes acoustiques quotidiennes et détecter des vocalisations d'oiseaux. Ils répètent chaque expérience avec plusieurs dispositions initiales de filtres : les échelles Mel et Bark (toutes deux inspirées de l'audition humaine), des filtres espacés uniformément en fréquence, et une configuration extrême « constante » où tous les filtres écoutent initialement la même bande étroite. Ils suivent à la fois la performance et l'ampleur des changements des positions et largeurs des filtres. Le résultat : tant que les filtres initiaux couvrent déjà l'ensemble des fréquences audibles, le système atteint une grande précision et les filtres bougent à peine, que leur espacement soit Mel, Bark ou simplement linéaire.

Quand le point de départ est volontairement mauvais

La situation change lorsque LEAF commence à partir de la configuration constante, où chaque filtre entend la même tranche du spectre. Ici, le système est forcé de remodeler ses filtres pour couvrir une plage plus large, et les positions et largeurs se modifient sensiblement. Même alors, la disposition finale se fixe en une répartition lisse en forme de S à travers les fréquences, et les performances ne rattrapent jamais complètement celles des initialisations meilleures. Pour approfondir, les auteurs créent des versions fortement modifiées des données de reconnaissance de parole : dans un cas, seule une bande étroite de fréquences est conservée ; dans d'autres, du bruit grave ou aigu est ajouté pour masquer des parties du spectre. De manière surprenante, même lorsque des fréquences importantes sont retirées ou noyées par le bruit, les filtres appris dérivent encore vers un schéma en S similaire qui s'étend dans des régions contenant peu ou pas d'information utile.

Ce que cela implique pour l'interprétation de l'audition machine

Ces résultats suggèrent que le banc de filtres de LEAF est bien plus têtu que ne le laisse entendre son étiquette « apprenable ». Une fois que les filtres commencent avec une couverture raisonnable du spectre, ils ont peu d'incitation à s'adapter aux motifs fréquentiels spécifiques des oiseaux, des émotions humaines ou des bruits urbains. À la place, ce sont les parties ultérieures du réseau qui semblent faire le gros du travail. Cela affaiblit l'un des avantages mis en avant pour LEAF : l'idée que l'inspection de ses filtres révélerait comment le modèle s'ajuste à différentes tâches. Les auteurs soutiennent que les travaux futurs devraient ajuster les procédures d'entraînement — par exemple en utilisant des taux d'apprentissage différents pour les couches initiales ou des techniques d'optimisation spéciales — afin d'encourager des changements plus significatifs dans ces premiers stades d'écoute.

Message clé pour les non-spécialistes

En termes simples, cette étude montre que donner à une IA une « oreille flexible » ne garantit pas qu'elle écoutera réellement différemment lorsque sa tâche change. LEAF obtient de bonnes performances sur plusieurs tâches audio, mais principalement en conservant une manière large et générique de découper le son plutôt qu'en inventant de nouvelles stratégies d'audition spécifiques à la tâche. Pour l'instant, sa force réside dans des performances solides, non dans la promesse de nous fournir des informations claires et interprétables sur ce que le système juge important dans différents types de sons.

Citation: Milling, M., Triantafyllopoulos, A., Rampp, S.D.N. et al. A frequency analysis of filterbank initialisation and noise augmentation for LEAF. Sci Rep 16, 13410 (2026). https://doi.org/10.1038/s41598-026-49403-4

Mots-clés: apprentissage profond audio, frontaux apprenables, initialisation du banc de filtres, reconnaissance de la parole et des sons, dynamique d'entraînement