Clear Sky Science · pl

Analiza częstotliwościowa inicjalizacji banku filtrów i augmentacji szumem dla LEAF

Dlaczego inteligentne maszyny słuchające są ważne

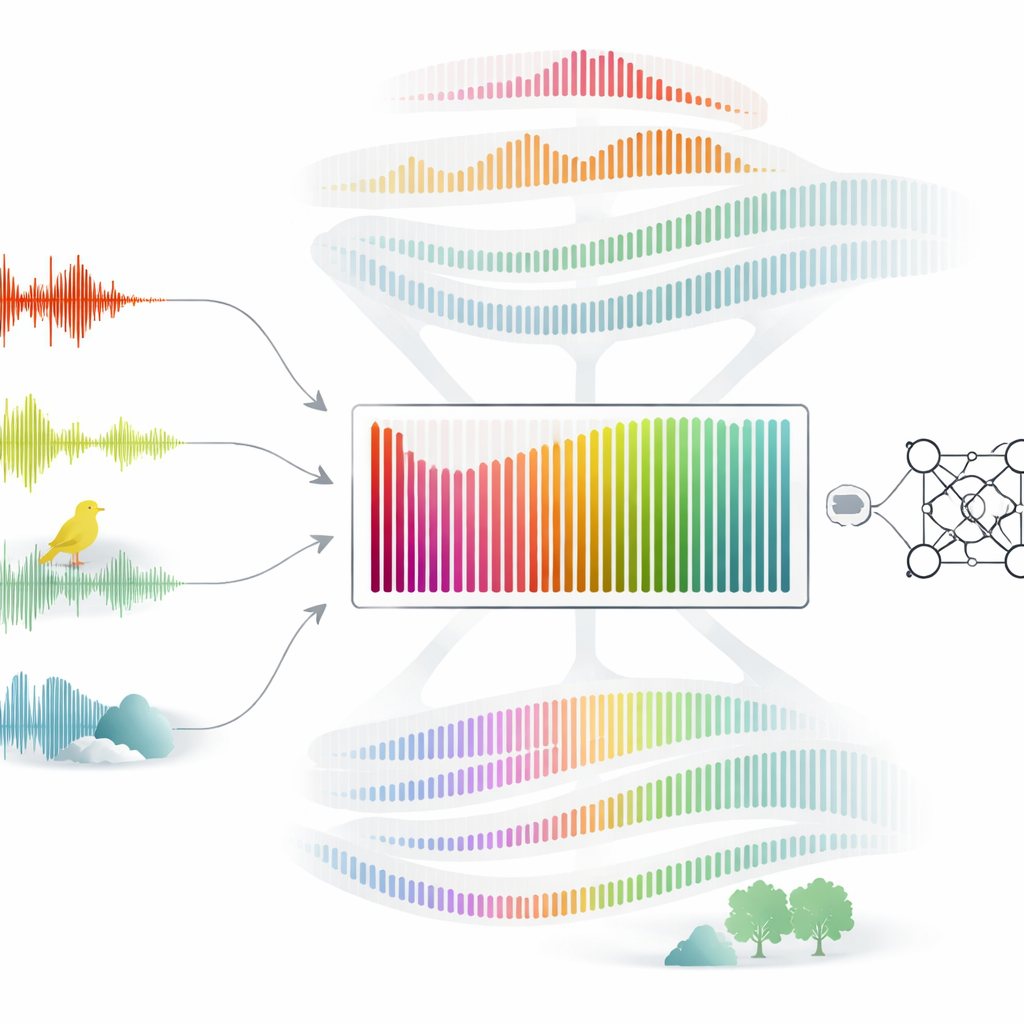

Od asystentów głosowych po monitory śpiewu ptaków, współczesne życie zależy od maszyn, które potrafią słuchać. W tle te systemy przekształcają surowe fale dźwiękowe w liczby zrozumiałe dla algorytmów. Nowe badanie analizuje popularny moduł „inteligentnego ucha” o nazwie LEAF, który obiecuje nauczyć się najlepszej reprezentacji dźwięku dla wielu zadań. Badacze stawiają proste, ale istotne pytanie: czy to inteligentne ucho rzeczywiście dostosowuje się do różnych zadań słuchowych, czy raczej pozostaje w dużej mierze zakotwiczone w swojej początkowej strukturze?

Jak maszyny zwykle słuchają

Większość systemów AI przetwarzających dźwięk nie operuje bezpośrednio na surowym sygnale. Zamiast tego sygnał przechodzi przez stały zestaw filtrów, które dzielą dźwięk na partie niskie, średnie i wysokie, tworząc obrazy zwane spektrogramami. Filtry te często opierają się na tym, jak ludzkie ucho postrzega wysokość dźwięku, zwłaszcza na tzw. skali Mel. To podejście ma długą historię sukcesów, ale narzuca założenia oparte na ludzkim słyszeniu i daje niewiele przestrzeni systemowi, by odkryć nowe, zadaniowo specyficzne sposoby słuchania.

Obiecujący nowy rodzaj cyfrowego ucha

LEAF wprowadzono jako kompromis między sztywnymi, ręcznie zaprojektowanymi filtrami a w pełni end-to-end systemami uczącymi się wszystkiego od zera. Naśladuje klasyczne kroki przetwarzania sygnału, ale kluczowe parametry, takie jak pozycje i szerokości filtrów, są regulowane podczas treningu. W teorii powinno to pozwolić systemowi nauczyć się różnych „profilów słuchowych” dla rozpoznawania mowy, wykrywania emocji, scen dźwiękowych w mieście czy aktywności ptaków. Wcześniejsze prace jednak sugerowały, że w praktyce jedynie późniejszy etap normalizacji w LEAF zmienia się znacząco, podczas gdy sam bank filtrów ledwo się przemieszcza, gdy startuje z ustawieniem opartym na skali Mel.

Testowanie LEAF na wielu rodzajach dźwięków

Autorzy systematycznie badali zachowanie LEAF w czterech bardzo różnych zadaniach słuchowych: rozpoznawaniu mówionych słów-kluczy, wykrywaniu emocji w mowie dziecięcej, klasyfikacji codziennych scen akustycznych oraz wykrywaniu wokalizacji ptaków. Powtarzali każdy eksperyment z kilkoma początkowymi układami filtrów: skalami Mel i Bark (obie inspirowane ludzkim słyszeniem), równomiernym rozmieszczeniem filtrów w paśmie częstotliwości oraz ekstremalnym „stałym” ustawieniem, w którym wszystkie filtry początkowo nasłuchują tej samej wąskiej części widma. Śledzili zarówno wydajność, jak i to, jak bardzo pozycje i szerokości filtrów faktycznie się zmieniają. Wynik: o ile początkowe filtry już obejmują cały słyszalny zakres częstotliwości, system osiąga wysoką dokładność, a filtry niemal się nie przesuwają, niezależnie od tego, czy bazują na Mel, Bark czy prostym równomiernym rozkładzie.

Kiedy punkt wyjścia jest celowo zły

Obraz zmienia się, gdy LEAF zaczyna od ustawienia stałego, gdzie każdy filtr słyszy tę samą część spektrum. W takim przypadku system jest zmuszony przekształcić filtry, aby pokryć szerszy zakres, i pozycje oraz szerokości zmieniają się zauważalnie. Nawet wtedy końcowy układ ustala się w gładki, S-kształtny rozkład wzdłuż osi częstotliwości, a wydajność nigdy w pełni nie dogania lepszych inicjalizacji. Aby zbadać to dokładniej, autorzy tworzą silnie zmodyfikowane wersje danych do rozpoznawania mowy: w jednym przypadku zachowano tylko wąskie pasmo częstotliwości; w innych dodano niskie lub wysokie szumy maskujące części widma. Co zaskakujące, nawet gdy istotne częstotliwości są usunięte lub zalane szumem, wyuczone filtry nadal przesuwają się w kierunku podobnego S-kształtnego wzoru, który rozciąga się także na regiony z małą lub żadną użyteczną informacją.

Co to oznacza dla interpretacji mechanicznego słyszenia

Te obserwacje sugerują, że bank filtrów LEAF jest znacznie bardziej oporny niż sugeruje jego etykieta „uczliwy”. Gdy filtry startują z rozsądnym pokryciem widma, mają niewielką motywację, by dostosowywać się do specyficznych wzorców częstotliwości ptaków, emocji ludzkich czy dźwięków miejskich. Zamiast tego większa część pracy wydaje się być wykonywana przez późniejsze części sieci. Osłabia to jedną z reklamowanych zalet LEAF: że przeglądanie jego filtrów ujawni, jak model dopasowuje się do różnych zadań. Autorzy argumentują, że przyszłe prace powinny dostosować procedury treningowe — na przykład używając różnych współczynników uczenia dla wczesnych warstw lub specjalnych sztuczek optymalizacyjnych — aby zachęcić do bardziej znaczących zmian w tych pierwszych etapach słuchania.

Wniosek dla osób niebędących ekspertami

Mówiąc prościej, badanie pokazuje, że wyposażenie AI w „elastyczne ucho” nie gwarantuje, iż będzie ona słuchać inaczej, gdy zmieni się jej zadanie. LEAF dobrze radzi sobie w kilku zadaniach audio, ale w większości przypadków utrzymuje szeroki, ogólny sposób dzielenia dźwięku, zamiast tworzyć nowe, zadaniowo specyficzne strategie słuchowe. Na razie jego siła tkwi w solidnej wydajności, a nie w obietnicy dostarczania jasnych, interpretowalnych wglądów w to, jakie informacje system uznaje za ważne w różnych typach dźwięków.

Cytowanie: Milling, M., Triantafyllopoulos, A., Rampp, S.D.N. et al. A frequency analysis of filterbank initialisation and noise augmentation for LEAF. Sci Rep 16, 13410 (2026). https://doi.org/10.1038/s41598-026-49403-4

Słowa kluczowe: głębokie uczenie dźwięku, uczliwe przednie moduły, inicjalizacja banku filtrów, rozpoznawanie mowy i dźwięków, dynamika treningu