Clear Sky Science · it

Un’analisi in frequenza dell’inizializzazione del filterbank e dell’aumento di rumore per LEAF

Perché le macchine che ascoltano con intelligenza contano

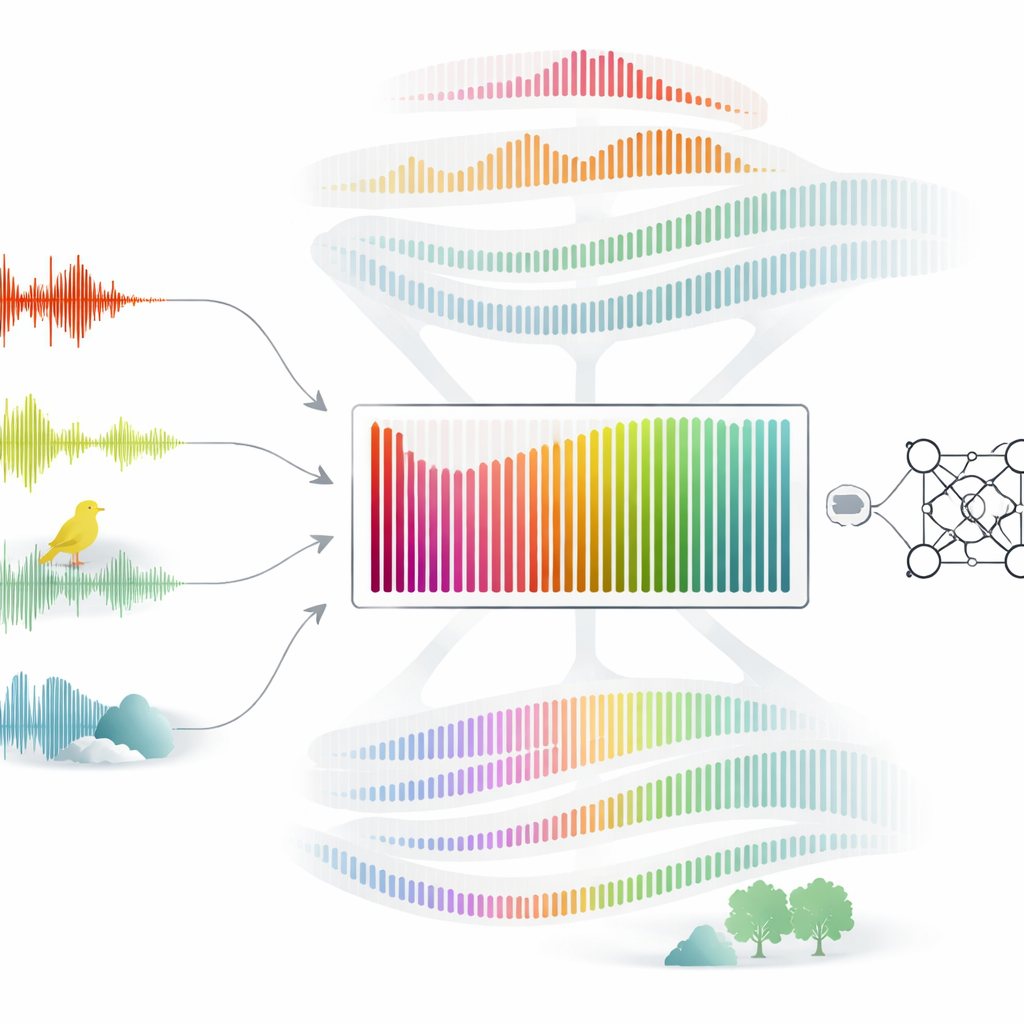

Dai assistenti vocali ai monitor dei canti degli uccelli, la vita moderna dipende da macchine in grado di ascoltare. Dietro le quinte, questi sistemi trasformano le onde sonore grezze in numeri che gli algoritmi possono comprendere. Un nuovo studio esamina un modulo “orecchio intelligente” molto usato chiamato LEAF, che promette di apprendere il modo migliore per rappresentare il suono per molti compiti. I ricercatori pongono una domanda semplice ma importante: questo orecchio intelligente si adatta davvero ai diversi compiti di ascolto, o resta per lo più ancorato al suo disegno iniziale?

Come ascoltano solitamente le macchine

La maggior parte dei sistemi AI basati sull’audio non lavora direttamente con il segnale sonoro grezzo. Invece, prima passa il segnale attraverso un insieme fisso di filtri che suddividono il suono in componenti basse, medie e alte, creando immagini chiamate spettrogrammi. Questi filtri si basano spesso su come l’orecchio umano percepisce le altezze, in particolare sulla cosiddetta scala Mel. Questo approccio ha una lunga storia di successi, ma incorpora assunzioni sulla percezione umana e lascia poco spazio al sistema per scoprire nuovi modi di ascoltare specifici per il compito.

Un nuovo tipo di orecchio digitale promettente

LEAF è stato introdotto come un compromesso tra filtri rigidi progettati a mano e sistemi completamente end-to-end che apprendono tutto da zero. Imita le classiche fasi di elaborazione del segnale, ma rende parametri chiave come le posizioni e le larghezze dei filtri regolabili durante l’addestramento. In linea di principio, questo dovrebbe permettere al sistema di apprendere diversi “profili di ascolto” per il riconoscimento vocale, la rilevazione delle emozioni, le scene sonore urbane o l’attività degli uccelli. Lavori precedenti, però, facevano intuire che nella pratica solo una successiva fase di normalizzazione in LEAF cambia molto, mentre il filterbank stesso si muove poco quando parte da un’inizializzazione basata su Mel.

Mettere LEAF alla prova su molti suoni

Gli autori sondano in modo sistematico il comportamento di LEAF su quattro compiti di ascolto molto diversi: riconoscimento di parole chiave pronunciate, rilevazione delle emozioni nel parlato infantile, classificazione di scene acustiche quotidiane e rilevazione di vocalizzazioni di uccelli. Ripetono ogni esperimento con diverse disposizioni iniziali dei filtri: le scale Mel e Bark (entrambe ispirate all’udito umano), filtri equamente spaziali in frequenza e una configurazione estrema “costante” in cui tutti i filtri inizialmente ascoltano la stessa banda stretta. Monitorano sia le prestazioni sia quanto cambiano effettivamente posizioni e larghezze dei filtri. Il risultato: finché i filtri iniziali coprono già l’intera gamma di frequenze udivibili, il sistema raggiunge alta accuratezza e i filtri cambiano pochissimo, indipendentemente dal fatto che seguano Mel, Bark o una semplice spaziatura lineare.

Quando il punto di partenza è volutamente pessimo

La situazione cambia quando LEAF parte dalla configurazione costante, dove ogni filtro sente la stessa porzione dello spettro. Qui il sistema è costretto a rimodellare i filtri per coprire una gamma più ampia, e posizioni e larghezze cambiano in modo evidente. Anche così, la disposizione finale si stabilizza in una diffusione liscia a forma di S attraverso la frequenza, e le prestazioni non raggiungono mai completamente quelle delle inizializzazioni migliori. Per approfondire, gli autori creano versioni fortemente modificate dei dati per il riconoscimento vocale: in un caso viene mantenuta solo una stretta banda di frequenze; in altri vengono aggiunti rumori a bassa o alta frequenza per mascherare parti dello spettro. Sorprendentemente, anche quando frequenze importanti vengono rimosse o sommerse dal rumore, i filtri appresi tendono comunque a spostarsi verso un simile profilo a S che si estende in regioni con poca o nessuna informazione utile.

Cosa significa questo per l’interpretazione dell’ascolto delle macchine

Questi risultati suggeriscono che il filterbank di LEAF è molto più ostinato di quanto il suo etichettamento “apprendibile” farebbe pensare. Una volta che i filtri iniziano con una copertura ragionevole dello spettro, hanno poco incentivo ad adattarsi ai modelli di frequenza specifici di uccelli, emozioni umane o suoni cittadini. Invece, il lavoro pesante sembra essere svolto dalle parti successive della rete. Questo indebolisce uno dei vantaggi pubblicizzati di LEAF: che l’ispezione dei suoi filtri rivelerebbe come il modello si accorda ai diversi compiti. Gli autori sostengono che lavori futuri dovrebbero adattare le procedure di addestramento — per esempio usando tassi di apprendimento diversi per gli strati iniziali o trucchi di ottimizzazione specifici — per incoraggiare cambiamenti più significativi in queste prime fasi di ascolto.

Messaggio principale per non esperti

In termini pratici, questo studio mostra che dare a un’IA un “orecchio flessibile” non garantisce che ascolterà diversamente quando il suo compito cambia. LEAF ottiene buone prestazioni in diversi compiti audio, ma lo fa principalmente mantenendo un modo ampio e generico di suddividere il suono invece di inventare nuove strategie di ascolto specifiche per il compito. Per ora, la sua forza risiede nella solida performance, non nella promessa di fornirci intuizioni chiare e interpretabili su quali informazioni il sistema ritenga importanti nei diversi tipi di suoni.

Citazione: Milling, M., Triantafyllopoulos, A., Rampp, S.D.N. et al. A frequency analysis of filterbank initialisation and noise augmentation for LEAF. Sci Rep 16, 13410 (2026). https://doi.org/10.1038/s41598-026-49403-4

Parole chiave: deep learning audio, front-end apprendibili, inizializzazione del filterbank, riconoscimento del parlato e dei suoni, dinamiche di addestramento