Clear Sky Science · pt

Benchmarking sistemático demonstra que grandes modelos de linguagem não alcançaram a acurácia diagnóstica das ferramentas tradicionais de suporte à decisão para doenças raras

Por que isso importa para pacientes e médicos

Quando alguém tem uma doença rara, obter o diagnóstico correto pode levar anos de incerteza, testes repetidos e consultas com vários especialistas. Ao mesmo tempo, poderosos novos sistemas de inteligência artificial chamados grandes modelos de linguagem são apresentados como potenciais transformadores da medicina. Este estudo faz uma pergunta simples, mas crucial: esses novos chatbots de IA são realmente melhores em detectar doenças genéticas raras do que as ferramentas especializadas que os médicos já usam, ou ainda há um caminho a percorrer?

Doenças raras e a longa jornada até as respostas

Embora cada doença rara afete relativamente poucas pessoas, existem mais de 10.000 dessas condições e, juntas, atingem até uma em cada doze pessoas. Muitos desses pacientes enfrentam uma “odisséia diagnóstica” que dura de cinco a sete anos antes que alguém consiga nomear o problema. Para condições genéticas, um passo-chave é combinar a combinação de sintomas, resultados de exames e achados de imagens de uma pessoa com os padrões conhecidos de doenças específicas. Programas de computador estabelecidos já ajudam nisso, usando vocabulários padronizados de características médicas para buscar entre milhares de condições possíveis.

Colocando chatbots e ferramentas tradicionais à prova

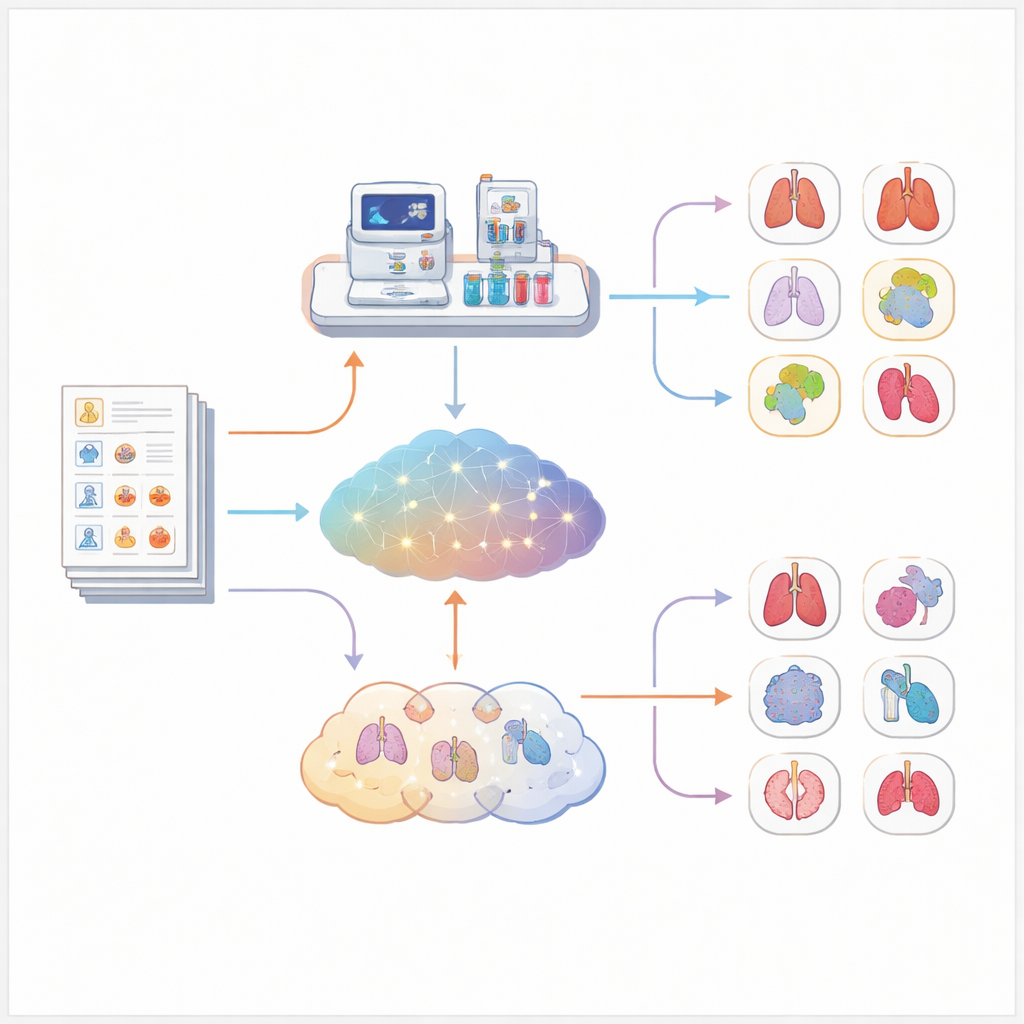

Os pesquisadores reuniram uma grande coleção de mais de cinco mil casos reais, mas anonimizados, de pacientes com doenças genéticas ou cromossômicas raras confirmadas. Cada caso foi cuidadosamente convertido em um formato estruturado que codifica a idade, o sexo, os sintomas e os achados de exames da pessoa usando um dicionário médico compartilhado. A partir desses registros estruturados, a equipe gerou automaticamente breves relatos de caso que puderam ser fornecidos a sete diferentes modelos de linguagem, incluindo sistemas de uso geral e modelos treinados especialmente em texto médico. Em paralelo, eles alimentaram os mesmos dados estruturados no Exomiser, um programa de suporte à decisão amplamente usado para doenças raras, mas sem fornecer qualquer informação de sequenciamento genético para que a comparação fosse justa.

Avaliando quem encontrou a doença certa

Comparar as respostas de chatbots e de softwares tradicionais é mais difícil do que parece, porque modelos de linguagem respondem em texto livre que pode usar nomes de doenças diferentes ou níveis de detalhe distintos. Para evitar depender da opinião humana sobre se uma resposta era “suficientemente próxima”, a equipe mapeou cada diagnóstico sugerido em um catálogo unificado de doenças. A sugestão de um modelo foi considerada correta se correspondia à doença exata, a um nome equivalente ou a uma versão ligeiramente mais geral que incluísse claramente a condição verdadeira. Para cada caso, eles mediram então em que posição a resposta correta apareceu na lista ranqueada do modelo — primeiro lugar, entre os três melhores ou em algum lugar entre os dez primeiros.

O que a comparação direta mostrou

Ao longo dos 5.213 casos, o Exomiser superou claramente todos os modelos de linguagem testados. Usando apenas informações sobre sintomas, o Exomiser colocou o diagnóstico correto em primeiro lugar em cerca de um em cada três casos e entre os dez primeiros em bem mais da metade. O melhor modelo de linguagem, um sistema focado em raciocínio, alcançou o primeiro lugar em pouco menos de um quarto dos casos e entrou no top dez em pouco mais de um terço. Outros modelos voltados à medicina se saíram visivelmente pior, e um modelo médico muito grande quase nunca sugeriu a doença correta. Esses padrões se mantiveram mesmo quando os pesquisadores analisaram separadamente transtornos cardíacos, cerebrais ou relacionados ao sistema imune, e quando dividiram os casos pelo nível de detalhamento das descrições de sintomas.

O que isso significa para o futuro da IA no diagnóstico

Este estudo mostra que, apesar de suas impressionantes habilidades com linguagem, os grandes modelos de linguagem atuais ainda não são tão confiáveis quanto ferramentas especializadas para diagnosticar doenças genéticas raras a partir de descrições de sintomas isoladamente. Eles ainda podem ser úteis como assistentes — por exemplo, ajudando médicos a considerar possibilidades ou a explicar condições em linguagem acessível —, mas não devem substituir softwares estabelecidos quando vidas e respostas demoradas estão em jogo. Os autores argumentam que o caminho mais promissor é integrar modelos de linguagem em fluxos de diagnóstico cuidadosamente projetados, onde eles trabalhem ao lado, e não em vez de, ferramentas bioinformáticas de confiança.

Citação: Reese, J.T., Chimirri, L., Bridges, Y. et al. Systematic benchmarking demonstrates large language models have not reached the diagnostic accuracy of traditional rare-disease decision support tools. Eur J Hum Genet 34, 498–504 (2026). https://doi.org/10.1038/s41431-026-02054-5

Palavras-chave: doenças raras, diagnóstico médico, grandes modelos de linguagem, suporte à decisão clínica, distúrbios genéticos