Clear Sky Science · de

Systematische Benchmarking‑Studie zeigt: Große Sprachmodelle haben noch nicht die diagnostische Genauigkeit traditioneller Entscheidungshilfen für seltene Krankheiten erreicht

Warum das für Patientinnen, Patienten und Ärztinnen, Ärzte wichtig ist

Bei einer seltenen Erkrankung kann es Jahre voller Ungewissheit, wiederholter Tests und vieler Facharztbesuche dauern, bis die richtige Diagnose gestellt wird. Gleichzeitig werden leistungsfähige neue KI‑Systeme, sogenannte große Sprachmodelle, als potenzielle Wendepunkte für die Medizin gepriesen. Diese Studie stellt eine einfache, aber entscheidende Frage: Sind diese neuen KI‑Chatbots tatsächlich besser darin, seltene genetische Krankheiten zu erkennen, als die spezialisierten Werkzeuge, die Ärztinnen und Ärzte bereits nutzen, oder haben sie noch Nachholbedarf?

Seltene Krankheiten und der lange Weg zur Antwort

Obwohl jede einzelne seltene Erkrankung relativ wenige Menschen betrifft, gibt es mehr als 10.000 solcher Zustände, und zusammen betreffen sie bis zu jeden zwölften Menschen. Viele dieser Patientinnen und Patienten durchleben eine „diagnostische Odyssee“ von fünf bis sieben Jahren, bevor jemand sagen kann, was ihnen fehlt. Bei genetischen Erkrankungen ist ein entscheidender Schritt, die Kombination von Symptomen, Laborwerten und Bildbefunden einer Person mit den bekannten Mustern spezifischer Krankheiten abzugleichen. Etablierte Computerprogramme unterstützen bereits dabei, indem sie standardisierte medizinische Merkmalsvokabulare nutzen, um Tausende möglicher Erkrankungen zu durchsuchen.

Chatbots und traditionelle Werkzeuge im Vergleich

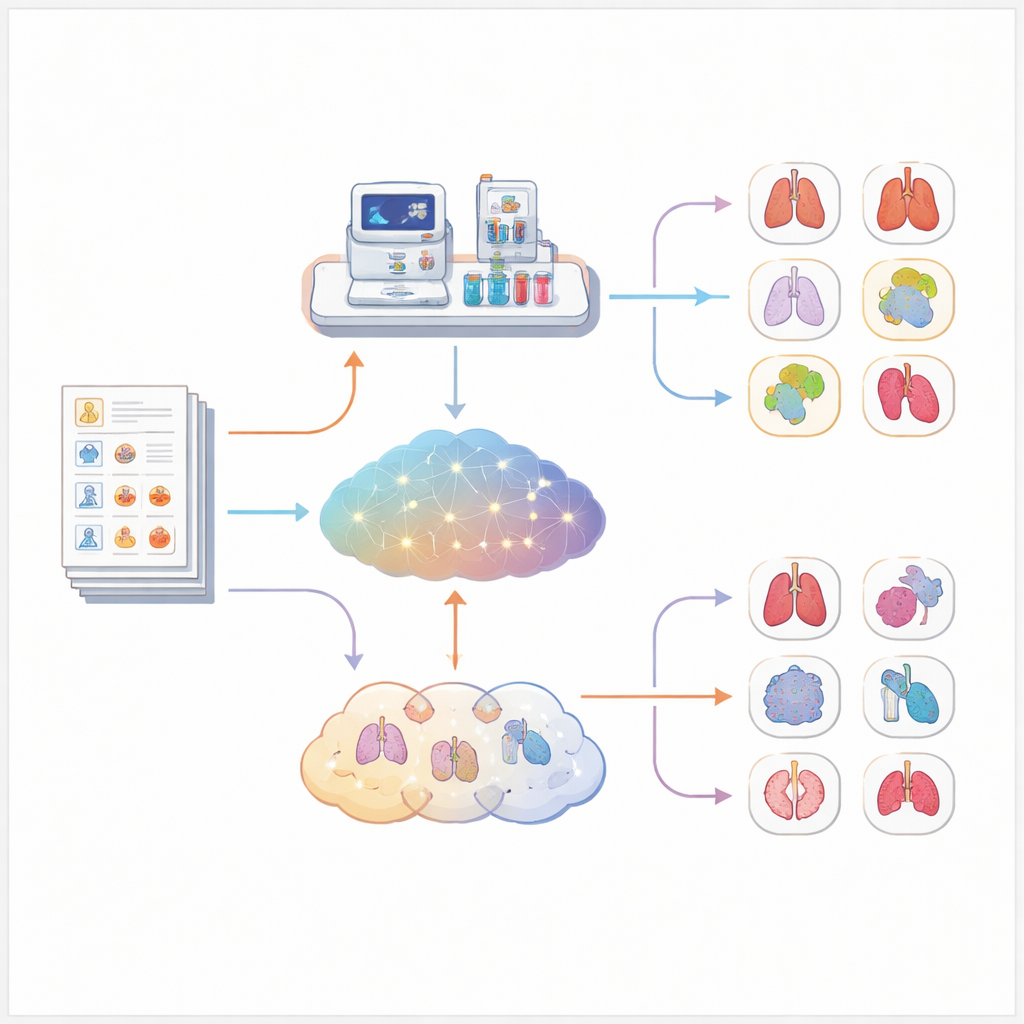

Die Forschenden stellten eine große Sammlung von mehr als fünftausend realen, aber anonymisierten Fällen von Patientinnen und Patienten mit bestätigten seltenen genetischen oder chromosomalen Erkrankungen zusammen. Jeder Fall wurde sorgfältig in ein strukturiertes Format überführt, das Alter, Geschlecht, Symptome und Untersuchungsergebnisse mithilfe eines gemeinsamen medizinischen Wörterbuchs kodiert. Aus diesen strukturierten Datensätzen generierte das Team automatisch kurze Fallgeschichten, die sieben verschiedenen Sprachmodellen vorgelegt wurden, darunter allgemeine Systeme und Modelle, die speziell mit medizinischem Text trainiert wurden. Parallel dazu fütterten sie dieselben strukturierten Daten in Exomiser, ein weit verbreitetes Entscheidungsunterstützungsprogramm für seltene Erkrankungen, allerdings ohne genetische Sequenzierungsinformationen, damit der Vergleich fair wäre.

Bewertung: Wer fand die richtige Krankheit?

Die Antworten von Chatbots und traditioneller Software zu vergleichen ist schwieriger, als es klingt, weil Sprachmodelle frei formulierte Texte liefern können, die unterschiedliche Krankheitsnamen oder Detailgrade verwenden. Um nicht auf menschliche Einschätzungen darüber angewiesen zu sein, ob eine Antwort „nah genug“ ist, ordnete das Team jede vorgeschlagene Diagnose einem einheitlichen Krankheitskatalog zu. Ein Vorschlag galt als korrekt, wenn er mit der exakten Krankheit, einem gleichwertigen Namen oder einer etwas allgemeineren Bezeichnung übereinstimmte, die die wahre Erkrankung eindeutig einschloss. Für jeden Fall maßen sie dann, an welcher Stelle die korrekte Antwort in der vom Modell gereihten Liste erschien — an erster Stelle, unter den besten drei oder irgendwo unter den besten zehn.

Ergebnisse des direkten Vergleichs

Über alle 5.213 Fälle hinweg übertraf Exomiser eindeutig jedes getestete Sprachmodell. Basierend nur auf Symptominformationen platzierte Exomiser die korrekte Diagnose in etwa einem Drittel der Fälle an erster Stelle und in deutlich mehr als der Hälfte unter den Top Ten. Das beste Sprachmodell, ein auf Schlussfolgerungen fokussiertes System, erreichte den ersten Platz in knapp einem Viertel der Fälle und die Top Ten in etwas mehr als einem Drittel. Andere medizinisch fokussierte Modelle schnitten deutlich schlechter ab, und ein sehr großes medizinisches Modell schlug fast nie die richtige Krankheit vor. Diese Muster zeigten sich auch, wenn die Forschenden Fälle getrennt nach Herz-, Gehirn‑ oder Immunerkrankungen betrachteten und wenn sie die Fälle nach dem Detaillierungsgrad der Symptombeschreibungen aufteilten.

Was das für die Zukunft der KI in der Diagnostik bedeutet

Die Studie zeigt, dass heutige große Sprachmodelle trotz ihrer beeindruckenden Sprachfähigkeiten noch nicht so zuverlässig sind wie spezialisierte Werkzeuge, wenn es darum geht, seltene genetische Erkrankungen allein aus Symptombeschreibungen zu diagnostizieren. Sie können weiterhin als Hilfsmittel nützlich sein — zum Beispiel, um Ärztinnen und Ärzten Denkansätze zu bieten oder Erkrankungen in verständlicher Sprache zu erklären — sollten aber nicht etablierte Software ersetzen, wenn Leben und lange verzögerte Antworten auf dem Spiel stehen. Die Autoren plädieren dafür, Sprachmodelle in sorgfältig gestaltete diagnostische Abläufe einzubetten, in denen sie neben bewährten Bioinformatik‑Tools arbeiten, anstatt sie zu ersetzen.

Zitation: Reese, J.T., Chimirri, L., Bridges, Y. et al. Systematic benchmarking demonstrates large language models have not reached the diagnostic accuracy of traditional rare-disease decision support tools. Eur J Hum Genet 34, 498–504 (2026). https://doi.org/10.1038/s41431-026-02054-5

Schlüsselwörter: seltene Erkrankungen, medizinische Diagnose, große Sprachmodelle, klinische Entscheidungsunterstützung, genetische Störungen