Clear Sky Science · it

Benchmarking sistematico dimostra che i grandi modelli linguistici non hanno raggiunto l’accuratezza diagnostica degli strumenti tradizionali per le malattie rare

Perché questo conta per pazienti e medici

Quando una persona ha una malattia rara, ottenere la diagnosi corretta può richiedere anni di incertezza, esami ripetuti e visite a molti specialisti. Allo stesso tempo, potenti nuovi sistemi di intelligenza artificiale, detti grandi modelli linguistici, vengono celebrati come potenziali rivoluzionari per la medicina. Questo studio pone una domanda semplice ma cruciale: questi nuovi chatbot di IA sono effettivamente migliori nell’individuare malattie genetiche rare rispetto agli strumenti specializzati che i medici usano già, oppure devono ancora migliorare?

Malattie rare e il lungo cammino verso una risposta

Benché ogni malattia rara colpisca relativamente poche persone, ne esistono più di 10.000 e nel loro insieme interessano fino a una persona su dodici. Molti di questi pazienti affrontano una “odissea diagnostica” di cinque‑sette anni prima che si riesca a identificare il problema. Per le condizioni genetiche, un passaggio chiave è abbinare la combinazione di sintomi, risultati di laboratorio e reperti di imaging di una persona ai modelli noti di specifiche malattie. Programmi consolidati già aiutano in questo impiegando vocabolari standardizzati di caratteristiche mediche per cercare tra migliaia di possibili condizioni.

Mettere alla prova chatbot e strumenti tradizionali

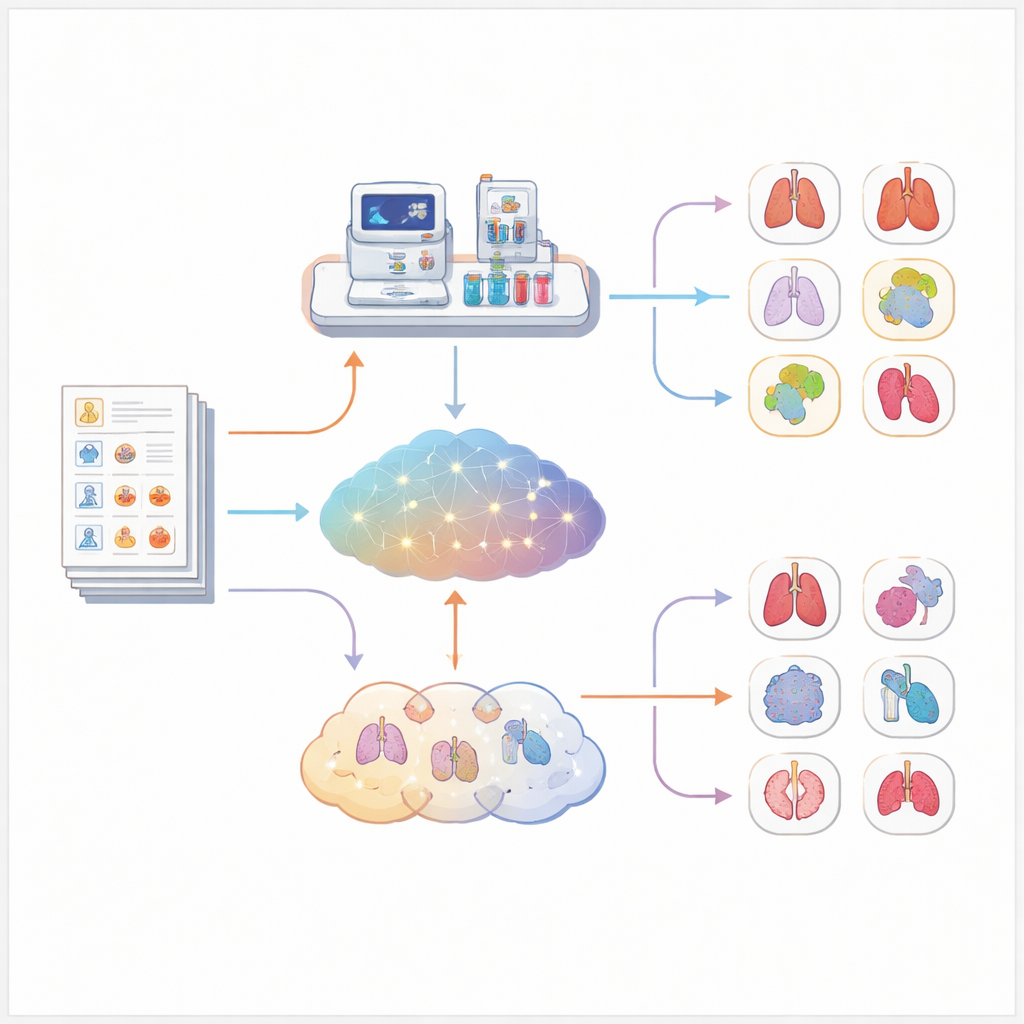

I ricercatori hanno raccolto un ampio insieme di oltre cinquemila casi reali ma anonimizzati di pazienti con malattie genetiche o cromosomiche confermate. Ogni caso era stato convertito con cura in un formato strutturato che codifica età, sesso, sintomi e risultati degli esami usando un dizionario medico comune. Da questi record strutturati il team ha generato automaticamente brevi resoconti di caso da sottoporre a sette diversi modelli linguistici, inclusi sistemi di uso generale e modelli addestrati specificamente su testi medici. Parallelamente, gli stessi dati strutturati sono stati forniti a Exomiser, un programma di supporto decisionale per malattie rare ampiamente usato, ma senza dare informazioni di sequenziamento genetico affinché il confronto fosse equo.

Come sono stati valutati i risultati

Confrontare le risposte di chatbot e software tradizionale è più difficile di quanto sembri, perché i modelli linguistici rispondono in testo libero che può impiegare nomi di malattie diversi o livelli di dettaglio variabili. Per evitare di basarsi sull’opinione umana su quanto una risposta fosse “sufficientemente vicina”, il team ha mappato ogni diagnosi suggerita su un catalogo unificato delle malattie. La proposta di un modello è stata considerata corretta se coincideva con la malattia esatta, con un nome equivalente o con una versione leggermente più generale che includesse chiaramente la condizione vera. Per ogni caso hanno quindi misurato la posizione della risposta corretta nella lista graduata del modello—al primo posto, tra i primi tre o entro la top ten.

Risultati del confronto diretto

Su tutti i 5.213 casi, Exomiser ha nettamente superato ogni modello linguistico testato. Utilizzando solo le informazioni sui sintomi, Exomiser ha collocato la diagnosi corretta al primo posto in circa un caso su tre e entro i primi dieci in ben oltre la metà. Il miglior modello linguistico, un sistema focalizzato sul ragionamento, ha raggiunto il primo posto in poco meno di un quarto dei casi e la top ten in poco più di un terzo. Altri modelli orientati alla medicina hanno performato in modo sensibilmente peggiore, e un modello medico molto grande ha quasi mai suggerito la malattia giusta. Questi schemi si sono mantenuti anche quando i ricercatori hanno analizzato separatamente disturbi cardiaci, neurologici o del sistema immunitario, e quando hanno suddiviso i casi in base al livello di dettaglio delle descrizioni dei sintomi.

Cosa significa per il futuro dell’IA nella diagnosi

Questo studio mostra che, nonostante le loro impressionanti capacità linguistiche, gli attuali grandi modelli linguistici non sono ancora affidabili quanto gli strumenti specializzati per diagnosticare malattie genetiche rare basandosi solo sulle descrizioni dei sintomi. Possono comunque essere utili come assistenti—for example, aiutando i medici a considerare possibili ipotesi o a spiegare le condizioni in linguaggio semplice—ma non dovrebbero sostituire il software consolidato quando sono in gioco vite umane e risposte a lungo attese. Gli autori sostengono che la strada più promettente è integrare i modelli linguistici in pipeline diagnostiche progettate con cura, dove lavorino insieme, piuttosto che al posto, degli affidabili strumenti bioinformatici.

Citazione: Reese, J.T., Chimirri, L., Bridges, Y. et al. Systematic benchmarking demonstrates large language models have not reached the diagnostic accuracy of traditional rare-disease decision support tools. Eur J Hum Genet 34, 498–504 (2026). https://doi.org/10.1038/s41431-026-02054-5

Parole chiave: malattie rare, diagnosi medica, grandi modelli linguistici, supporto decisionale clinico, disturbi genetici