Clear Sky Science · es

Evaluaciones sistemáticas demuestran que los modelos de lenguaje grande no han alcanzado la precisión diagnóstica de las herramientas tradicionales de apoyo a decisiones en enfermedades raras

Por qué esto importa para pacientes y médicos

Cuando alguien padece una enfermedad rara, obtener el diagnóstico correcto puede llevar años de incertidumbre, pruebas repetidas y consultas a numerosos especialistas. Al mismo tiempo, poderosos sistemas de inteligencia artificial llamados modelos de lenguaje grande se presentan como posibles transformadores para la medicina. Este estudio plantea una pregunta simple pero crucial: ¿son estos nuevos chatbots de IA realmente mejores para identificar enfermedades genéticas raras que las herramientas especializadas que ya usan los médicos, o todavía les queda camino por recorrer?

Enfermedades raras y el largo camino hacia una respuesta

Aunque cada enfermedad rara afecta relativamente a pocas personas, existen más de 10.000 condiciones de este tipo y, en conjunto, afectan hasta a una de cada doce personas. Muchos de estos pacientes soportan una "odisea diagnóstica" que dura de cinco a siete años antes de que alguien pueda nombrar qué les ocurre. Para las enfermedades genéticas, un paso clave es emparejar la combinación de síntomas, resultados de laboratorio y hallazgos en pruebas de imagen de una persona con los patrones conocidos de enfermedades específicas. Programas informáticos ya establecidos ayudan en esto mediante vocabularios estandarizados de rasgos médicos para buscar entre miles de condiciones posibles.

Poner a prueba chatbots y herramientas tradicionales

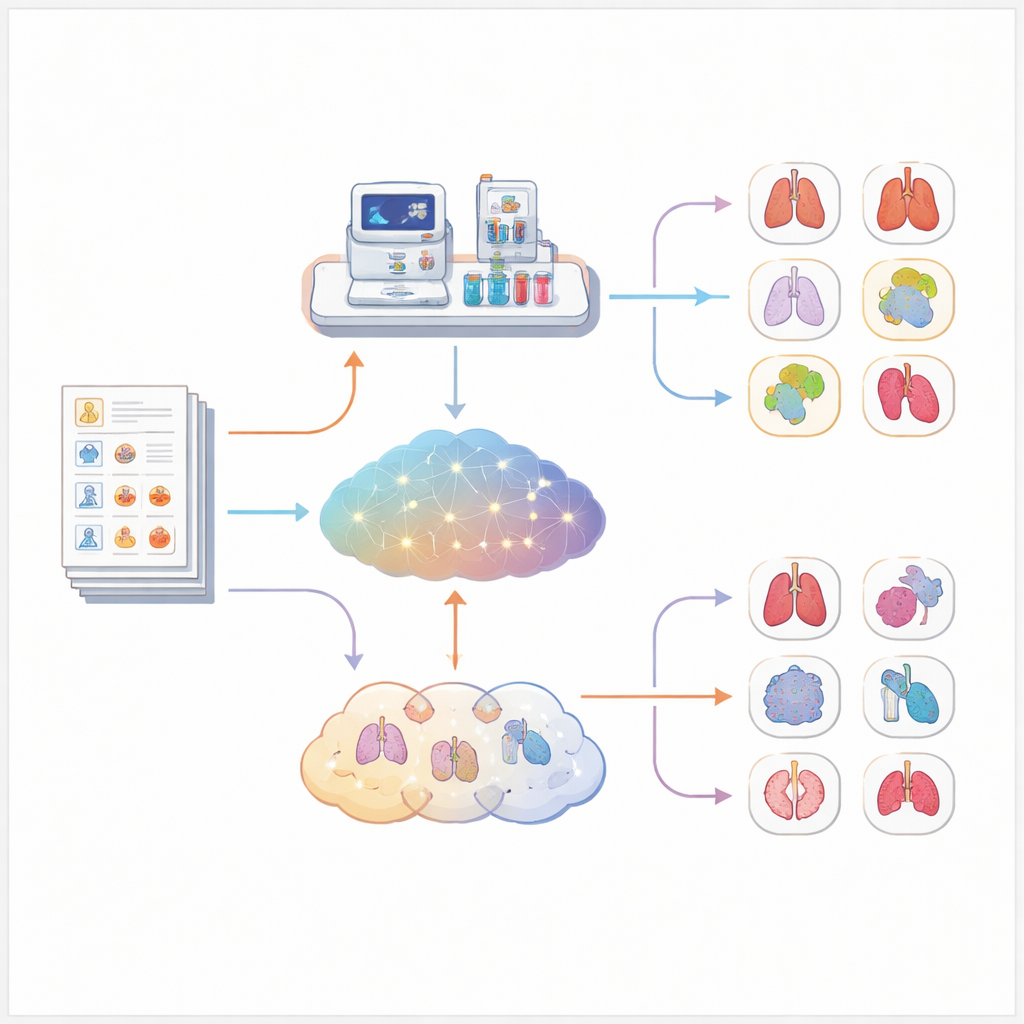

Los investigadores reunieron una gran colección de más de cinco mil casos reales pero anonimizados de pacientes con enfermedades genéticas o cromosómicas raras confirmadas. Cada caso se convirtió cuidadosamente a un formato estructurado que codifica la edad, el sexo, los síntomas y los hallazgos de pruebas de la persona usando un diccionario médico compartido. A partir de estos registros estructurados, el equipo generó automáticamente historias clínicas cortas que se pudieron presentar a siete modelos de lenguaje diferentes, incluidos sistemas de propósito general y modelos entrenados específicamente en texto médico. En paralelo, alimentaron los mismos datos estructurados en Exomiser, un programa de apoyo a decisiones para enfermedades raras ampliamente utilizado, pero sin proporcionarle información de secuenciación genética para que la comparación fuera justa.

Cómo se puntuó quién encontró la enfermedad correcta

Comparar las respuestas de chatbots y software tradicional es más difícil de lo que parece, porque los modelos de lenguaje responden en texto libre que puede usar distintos nombres de la enfermedad o niveles de detalle diferentes. Para evitar depender de la opinión humana sobre si una respuesta era "suficientemente cercana", el equipo asignó cada diagnóstico sugerido a un catálogo unificado de enfermedades. La sugerencia de un modelo se contaba como correcta si coincidía con la enfermedad exacta, con un nombre equivalente o con una versión algo más general que incluyera claramente la condición verdadera. Para cada caso, midieron entonces en qué posición aparecía la respuesta correcta en la lista ordenada del modelo: en primer lugar, entre los tres primeros o en el top diez.

Qué mostró la comparación directa

En los 5.213 casos, Exomiser superó claramente a todos los modelos de lenguaje evaluados. Usando únicamente la información de los síntomas, Exomiser colocó el diagnóstico correcto en primer lugar en aproximadamente uno de cada tres casos y dentro del top diez en bastante más de la mitad. El mejor modelo de lenguaje, un sistema enfocado en el razonamiento, alcanzó el primer puesto en poco menos de una cuarta parte de los casos y el top diez en algo más de un tercio. Otros modelos centrados en medicina lo hicieron notablemente peor, y un modelo médico muy grande casi nunca sugirió la enfermedad correcta. Estos patrones se mantuvieron incluso cuando los investigadores analizaron por separado trastornos relacionados con el corazón, el cerebro o el sistema inmunitario, y cuando dividieron los casos según el nivel de detalle de las descripciones de los síntomas.

Qué significa esto para el futuro de la IA en el diagnóstico

Este estudio muestra que, a pesar de sus impresionantes capacidades con el lenguaje, los modelos de lenguaje grande actuales aún no son tan fiables como las herramientas especializadas para diagnosticar enfermedades genéticas raras a partir de descripciones de síntomas únicamente. Pueden seguir siendo útiles como asistentes —por ejemplo, ayudando a los médicos a considerar posibilidades o a explicar condiciones en lenguaje sencillo—, pero no deberían sustituir al software establecido cuando están en juego vidas y respuestas retrasadas durante mucho tiempo. Los autores sostienen que la vía más prometedora es integrar los modelos de lenguaje en flujos de trabajo diagnósticos cuidadosamente diseñados, donde trabajen junto a, y no en lugar de, herramientas bioinformáticas de confianza.

Cita: Reese, J.T., Chimirri, L., Bridges, Y. et al. Systematic benchmarking demonstrates large language models have not reached the diagnostic accuracy of traditional rare-disease decision support tools. Eur J Hum Genet 34, 498–504 (2026). https://doi.org/10.1038/s41431-026-02054-5

Palabras clave: enfermedades raras, diagnóstico médico, modelos de lenguaje grande, apoyo a la decisión clínica, trastornos genéticos