Clear Sky Science · pl

Systematyczne testy porównawcze wykazują, że duże modele językowe nie osiągnęły dokładności diagnostycznej tradycyjnych narzędzi wspomagających rozpoznawanie rzadkich chorób

Dlaczego to ma znaczenie dla pacjentów i lekarzy

Gdy ktoś ma chorobę rzadką, postawienie właściwej diagnozy może zająć lata niepewności, powtarzanych badań i wizyt u wielu specjalistów. Jednocześnie potężne systemy sztucznej inteligencji zwane dużymi modelami językowymi są przedstawiane jako potencjalne przełomy w medycynie. Niniejsze badanie stawia proste, ale kluczowe pytanie: czy te nowe chatboty AI rzeczywiście lepiej rozpoznają rzadkie choroby genetyczne niż wyspecjalizowane narzędzia, z których już korzystają lekarze, czy też wciąż mają jeszcze wiele do nadrobienia?

Choroby rzadkie i długa droga do odpowiedzi

Choć każda choroba rzadka dotyczy stosunkowo niewielu osób, istnieje ponad 10 000 takich schorzeń, a łącznie dotyczą one nawet jednej na dwanaście osób. Wielu z tych pacjentów przechodzi „odysseję diagnostyczną” trwającą od pięciu do siedmiu lat, zanim ktoś potrafi nazwać problem. W przypadku schorzeń genetycznych kluczowym krokiem jest dopasowanie kombinacji objawów, wyników badań laboratoryjnych i obrazów do znanych wzorców konkretnych chorób. Istniejące programy komputerowe pomagają w tym, korzystając ze znormalizowanych słowników cech medycznych i przeszukując tysiące możliwych rozpoznań.

Wystawienie chatbotów i tradycyjnych narzędzi na próbę

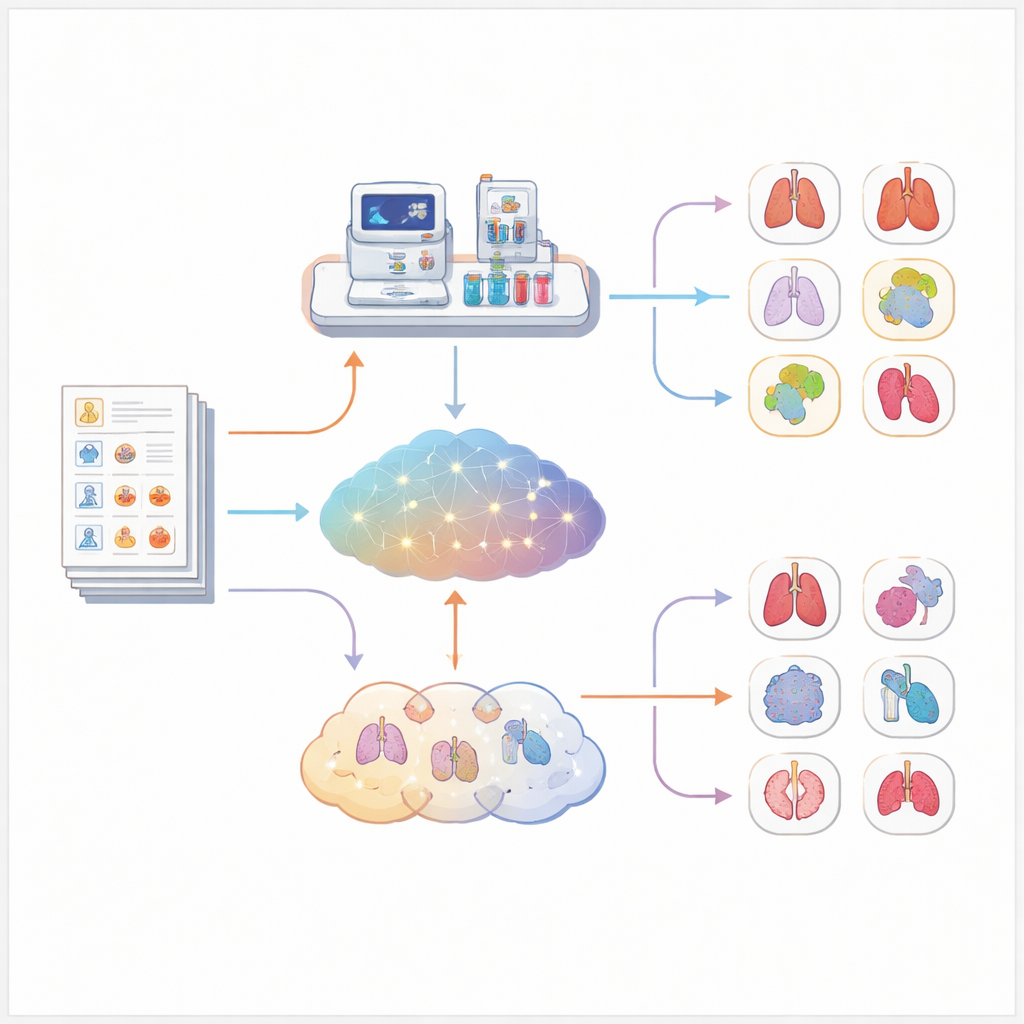

Naukowcy zgromadzili dużą kolekcję ponad pięciu tysięcy rzeczywistych, ale zanonimizowanych przypadków pacjentów z potwierdzonymi rzadkimi chorobami genetycznymi lub chromosomalnymi. Każdy przypadek został starannie przekształcony w ustrukturyzowany format kodujący wiek, płeć, objawy i wyniki badań z użyciem wspólnego słownika medycznego. Z tych ustrukturyzowanych zapisów zespół automatycznie wygenerował krótkie historie przypadków, które podano siedmiu różnym modelom językowym, w tym systemom ogólnego przeznaczenia i modelom trenowanym specjalnie na tekstach medycznych. Równolegle te same ustrukturyzowane dane wprowadzono do Exomiser — szeroko stosowanego programu wspomagającego rozpoznawanie chorób rzadkich — lecz bez udostępniania informacji z sekwencjonowania genów, aby porównanie było uczciwe.

Ocena, kto znalazł właściwą chorobę

Porównanie odpowiedzi chatbotów i tradycyjnego oprogramowania jest trudniejsze, niż się wydaje, ponieważ modele językowe odpowiadają swobodnym tekstem, używając różnych nazw chorób lub różnych poziomów szczegółowości. Aby uniknąć opierania się na subiektywnej ocenie człowieka, czy odpowiedź była „wystarczająco bliska”, zespół odwzorował każdą zasugerowaną diagnozę do zunifikowanego katalogu chorób. Sugestia modelu była uznawana za poprawną, jeśli odpowiadała dokładnej chorobie, równoważnej nazwie lub nieco bardziej ogólnemu terminowi, który wyraźnie obejmował prawdziwe schorzenie. Dla każdego przypadku mierzono następnie, na którym miejscu w uszeregowanej liście modelu pojawiła się poprawna odpowiedź — pierwszym, wśród trzech najlepszych lub w pierwszej dziesiątce.

Co pokazało bezpośrednie porównanie

We wszystkich 5 213 przypadkach Exomiser wyraźnie przewyższał każdy testowany model językowy. Korzystając wyłącznie z informacji o objawach, Exomiser umieszczał prawidłową diagnozę na pierwszym miejscu w około jednym na trzy przypadki i w pierwszej dziesiątce w zdecydowanie ponad połowie. Najlepszy model językowy, nastawiony na wnioskowanie, osiągnął pierwsze miejsce w nieco poniżej jednej czwartej przypadków i pierwszą dziesiątkę w nieco ponad jednej trzeciej. Inne modele skoncentrowane na medycynie radziły sobie zauważalnie gorzej, a jeden bardzo duży model medyczny niemal nigdy nie sugerował właściwej choroby. Te wzorce utrzymywały się także wtedy, gdy badacze analizowali oddzielnie zaburzenia serca, mózgu czy układu odpornościowego oraz gdy dzielili przypadki według stopnia szczegółowości opisów objawów.

Co to oznacza dla przyszłości AI w diagnostyce

Badanie pokazuje, że pomimo imponujących zdolności językowych, współczesne duże modele językowe nie są jeszcze tak niezawodne jak wyspecjalizowane narzędzia w diagnozowaniu rzadkich chorób genetycznych na podstawie samych opisów objawów. Mogą nadal być przydatne jako asystenci — na przykład pomagając lekarzom generować pomysły czy tłumaczyć schorzenia przystępnym językiem — ale nie powinny zastępować ugruntowanego oprogramowania tam, gdzie stawka to życie i długo oczekiwane odpowiedzi. Autorzy sugerują, że najbardziej obiecująca droga to włączenie modeli językowych w starannie zaprojektowane ścieżki diagnostyczne, gdzie współpracują obok, a nie zamiast, zaufanych narzędzi bioinformatycznych.

Cytowanie: Reese, J.T., Chimirri, L., Bridges, Y. et al. Systematic benchmarking demonstrates large language models have not reached the diagnostic accuracy of traditional rare-disease decision support tools. Eur J Hum Genet 34, 498–504 (2026). https://doi.org/10.1038/s41431-026-02054-5

Słowa kluczowe: choroby rzadkie, diagnostyka medyczna, duże modele językowe, wsparcie decyzji klinicznych, zaburzenia genetyczne