Clear Sky Science · pl

Sztuczna inteligencja napędzana wieloagentowa platforma do adaptacyjnej symulacji cyberataków i automatycznej reakcji incydentowej w środowiskach cyber range

Dlaczego inteligentniejsze ćwiczenia cybernetyczne mają znaczenie

Codziennie firmy i rządy ćwiczą przygotowanie na cyfrowe katastrofy, korzystając z „cyber range” – bezpiecznych, odizolowanych sieci, gdzie hakerzy i obrońcy mogą ćwiczyć. Jednak wiele z tych poligonów szkoleniowych wciąż opiera się na scenariuszach skryptowanych i przewidywalnych, które niewiele mają wspólnego z dzisiejszymi cichymi, zmiennymi zagrożeniami. Artykuł przedstawia nową metodę, która czyni takie ćwiczenia znacznie bardziej realistycznymi: wykorzystanie „agentów” sztucznej inteligencji, którzy uczą się włamywać i bronić samodzielnie, zmuszając ludzkich uczestników i narzędzia do konfrontacji z przeciwnikami, którzy myślą i się adaptują.

Od statycznych scenariuszy do żywych gier wojennych

Tradycyjne cyber range działają trochę jak z góry napisany spektakl: instruktorzy wybierają skrypt ataku, uruchamiają go i obserwują rozwój akcji. To przydatne dla początkujących, ale zawodzi wobec nowoczesnych przeciwników, którzy łączą wiele cichych kroków, sondują obronę i zmieniają kurs po wykryciu. Badania cytowane w artykule pokazują, że ponad połowa symulowanych ataków nie uwzględnia kluczowych taktyk, takich jak przemieszczanie się z jednego zainfekowanego komputera na drugi lub ukrywanie się przed narzędziami monitorującymi. W efekcie szkolenia wyglądają ładnie na papierze, lecz nie przygotowują analityków na nieuporządkowaną rzeczywistość internetu.

Nauczanie cyfrowych agentów ataku i obrony

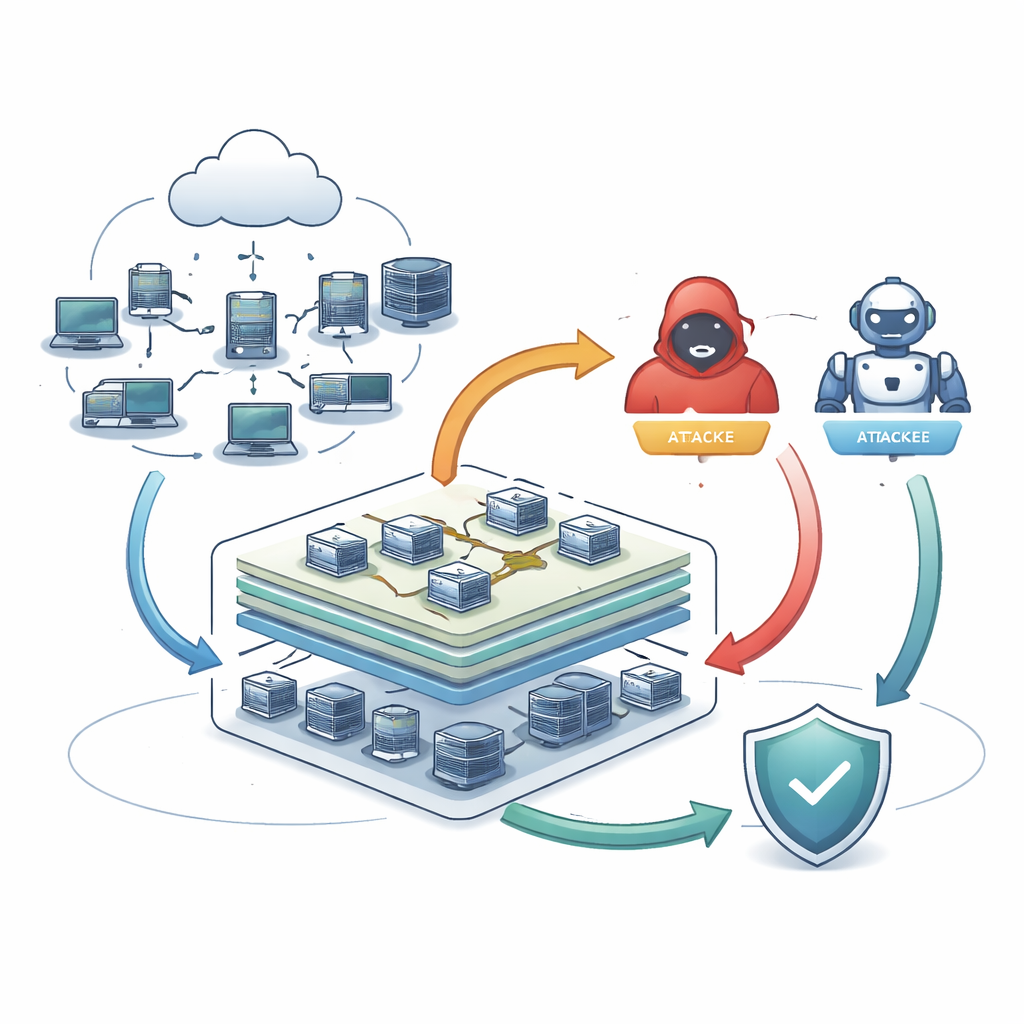

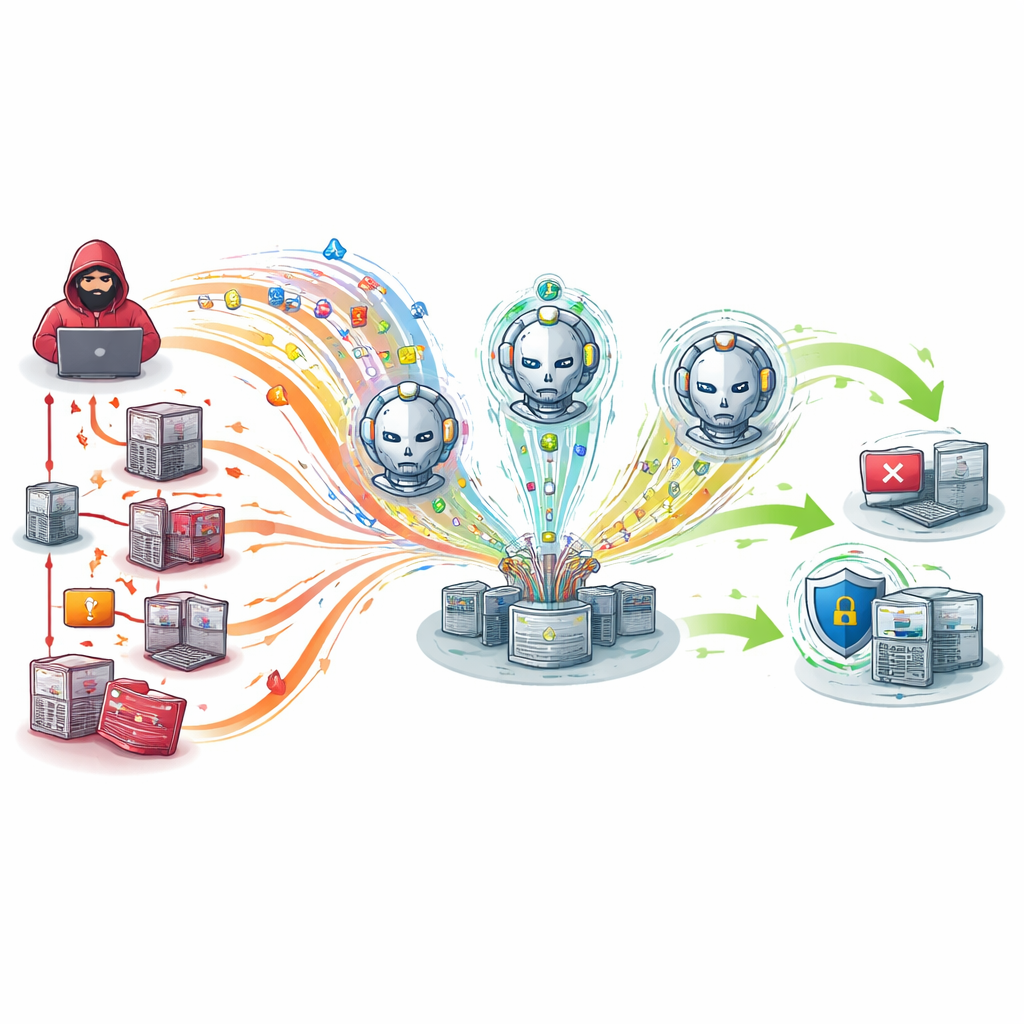

Aby zamknąć tę lukę, autorzy budują system wieloagentowy – małe społeczeństwo bytów programowych, które działają niezależnie, lecz wchodzą w interakcje we wspólnej wirtualnej sieci. Z jednej strony są agenci atakujący, którzy uczą się planować i dostosowywać swoje ruchy przy użyciu informacji zwrotnej w postaci nagród i kar, podobnie jak AI uczące się wygrywać w grach. Z drugiej strony znajdują się agenci broniący, którzy monitorują ruch sieciowy pod kątem nietypowych wzorców i automatycznie wybierają reakcje, takie jak izolowanie podejrzanego komputera czy blokowanie ryzykownego połączenia. Obie grupy agentów są trenowane na dużych, rzeczywistych zbiorach aktywności sieciowej, tak aby ich zachowanie odzwierciedlało autentyczne złośliwe i normalne użycie, a nie przykłady‑zabawki.

Budowa i połączenie stanowiska testowego

Zespół integruje tych agentów w CyDER 2.0, chmurowym cyber range, który potrafi uruchamiać różne typy sieci korporacyjnych, od małych konfiguracji z kilkudziesięcioma maszynami po duże środowiska z setkami hostów. Przed treningiem starannie oczyszczają i wyrównują dane bazowe, aby rzadkie ataki nie zostały „zagłuszone” przez codzienny ruch. Agent atakujący używa głębokiego uczenia do eksploracji wieloetapowych sekwencji, takich jak skanowanie w poszukiwaniu podatnych maszyn, wykorzystanie jednej z nich, eskalacja uprawnień, a następnie rozprzestrzenianie się lub kradzież danych — wszystko to z zachowaniem próby pozostania niezaobserwowanym. Agenci obronni łączą dwa komplementarne podejścia: tradycyjny klasyfikator dostrojony na oznakowanych atakach oraz autoenkoder, który uczy się, jak wygląda „normalne” i sygnalizuje odchylenia, w tym wcześniej nieznane sztuczki.

Jak inteligentny poligon sprawdza się w praktyce

Badacze wystawiają swoje agenty napędzane AI przeciw dwóm powszechnym alternatywom: stałym skryptom i regułowemu systemowi wieloagentowemu, którego zachowanie nigdy naprawdę się nie zmienia. W małych, średnich i dużych sieciach testowych agenty uczące się wykrywają ataki z większą dokładnością i z mniejszą liczbą przeoczeń. W najbardziej wymagającym scenariuszu mieszanych ataków na największej sieci nowy system zachowuje dobrą równowagę między wykrywaniem zagrożeń a unikaniem fałszywych alarmów, podczas gdy podejścia statyczne mocno się pogarszają. Co równie istotne, jego zautomatyzowane reakcje uruchamiają się kilka sekund szybciej niż w punktach odniesienia — różnica, która może znacząco ograniczyć szkody przy szybko rozwijających się naruszeniach. Sami agenci atakujący stają się podczas treningu bardziej skuteczni, łącząc dłuższe, bardziej złożone łańcuchy ataków, podczas gdy zużycie zasobów przez wszystkie agenty pozostaje w umiarkowanych granicach.

Co to oznacza dla gotowości w świecie rzeczywistym

Z perspektywy laika badanie pokazuje, że ćwiczenia cyberbezpieczeństwa można zaktualizować z odtwarzanych scenariuszy do żywych gier wojennych, w których obie strony myślą samodzielnie. Podłączając uczących się atakujących i obrońców do realistycznych sieci ćwiczebnych i karmiąc ich rzeczywistymi zapisami ruchu, ramy te generują scenariusze, które wyglądają i odczuwane są dużo bliżej do faktycznych incydentów. W testach przekłada się to na lepsze wykrywanie, szybszą reakcję i zdolność skalowania do bardziej złożonych środowisk bez przeciążania systemu. Autorzy argumentują, że takie inteligentne poligony mogą lepiej przygotować zespoły ochrony na przyszłe ataki i stanowić fundament dla bardziej autonomicznych obron cyfrowych, a przyszłe prace skoncentrują się na odchudzeniu tych potężnych agentów, aby mogły też działać na mniejszych, mniej wydajnych urządzeniach.

Cytowanie: Agrawal, A., Nadeem, M., Al Nuaim, A. et al. Artificial intelligence driven multi agent framework for adaptive cyber attack simulation and automated incident response in cyber range environments. Sci Rep 16, 11673 (2026). https://doi.org/10.1038/s41598-026-45937-9

Słowa kluczowe: cyber range, adaptacyjne cyberataki, systemy wieloagentowe, obrona napędzana AI, reakcja na incydenty