Clear Sky Science · pl

Elastyczny interfejs nerwowy obejmujący wiele obszarów do dekodowania stanów zachowania u swobodnie poruszających się myszy

Podsłuchiwanie codziennej rutyny mózgu

Codzienne czynności, takie jak odpoczynek, włóczenie się czy sięgnięcie po przekąskę, wydają się łatwe, ale wyłaniają się z miliona komórek nerwowych wyładowujących się razem głęboko w mózgu. Badanie pokazuje, jak nowy system elastycznych czujników w połączeniu z nowoczesną sztuczną inteligencją może „podsłuchiwać” wiele obszarów mózgu naraz u swobodnie poruszających się myszy i wiarygodnie rozpoznawać, co zwierzę robi. W dłuższej perspektywie taka technologia może pomóc naukowcom zrozumieć zaburzenia mózgu i zbudować lepsze interfejsy mózg‑komputer działające poza laboratorium.

Miękkie okno na pracowity mózg

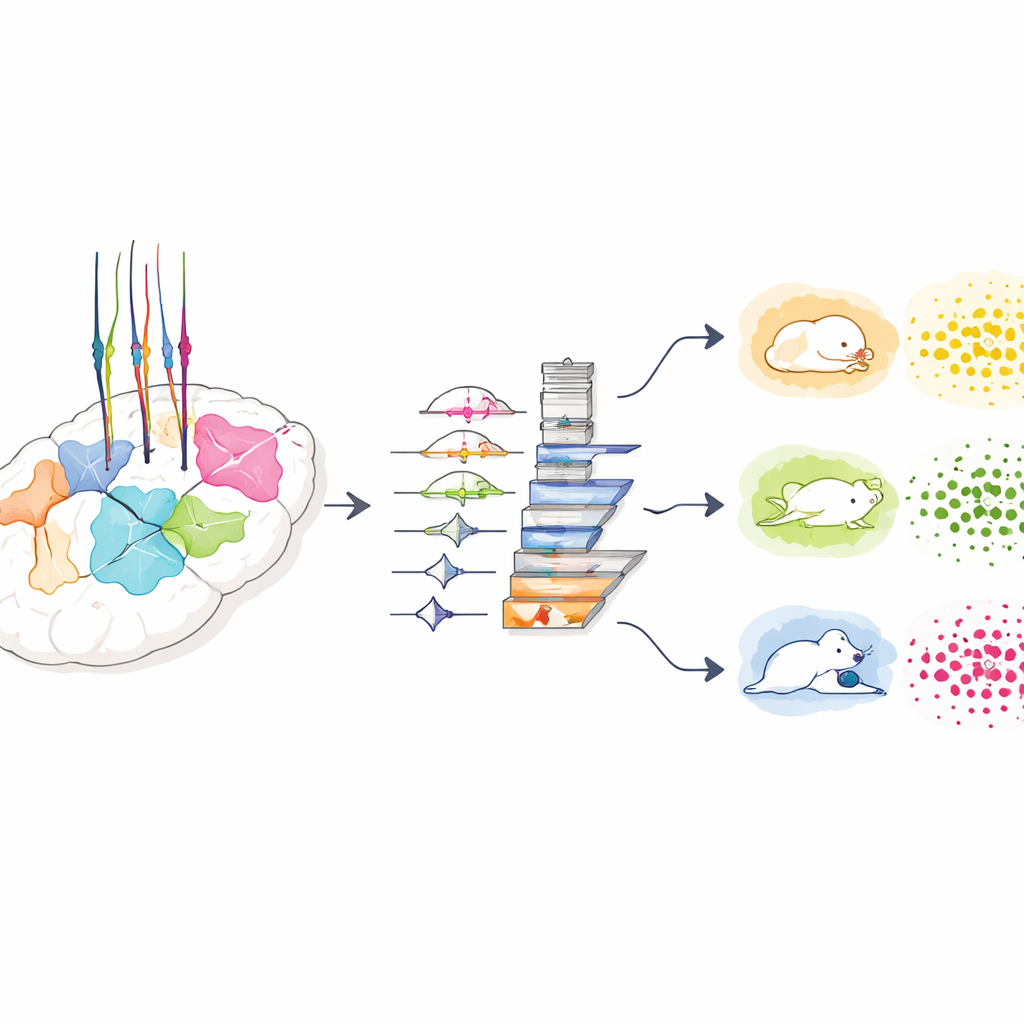

Tradycyjne sondy mózgowe są sztywne i zwykle rejestrują z pojedynczego obszaru, co może drażnić tkankę i przeoczyć szerszy obraz współpracy różnych regionów. Zespół zaprojektował wieloobszarową elastyczną sondę, która rozwiązuje oba te problemy. Każda sonda ma osiem smukłych ramion, zwanych szynami, wyściełanych drobnymi złotymi padami rejestracyjnymi. Pomysłowe krzywizny w kształcie omegi wbudowane w każdą szynę pozwalają strukturze rozciągać się i uginać wraz z miękkim mózgiem, dzięki czemu może docierać do odległych obszarów bez łamania się lub szarpania tkanki. Testy w żelowych „fantomach” mózgu i u żywych myszy wykazały, że urządzenie może obejmować ponad centymetr mózgu i utrzymywać stabilne właściwości elektryczne przez tygodnie, nawet gdy zwierzęta poruszają się naturalnie.

Śledzenie myszy podczas odpoczynku, wędrówek i karmienia

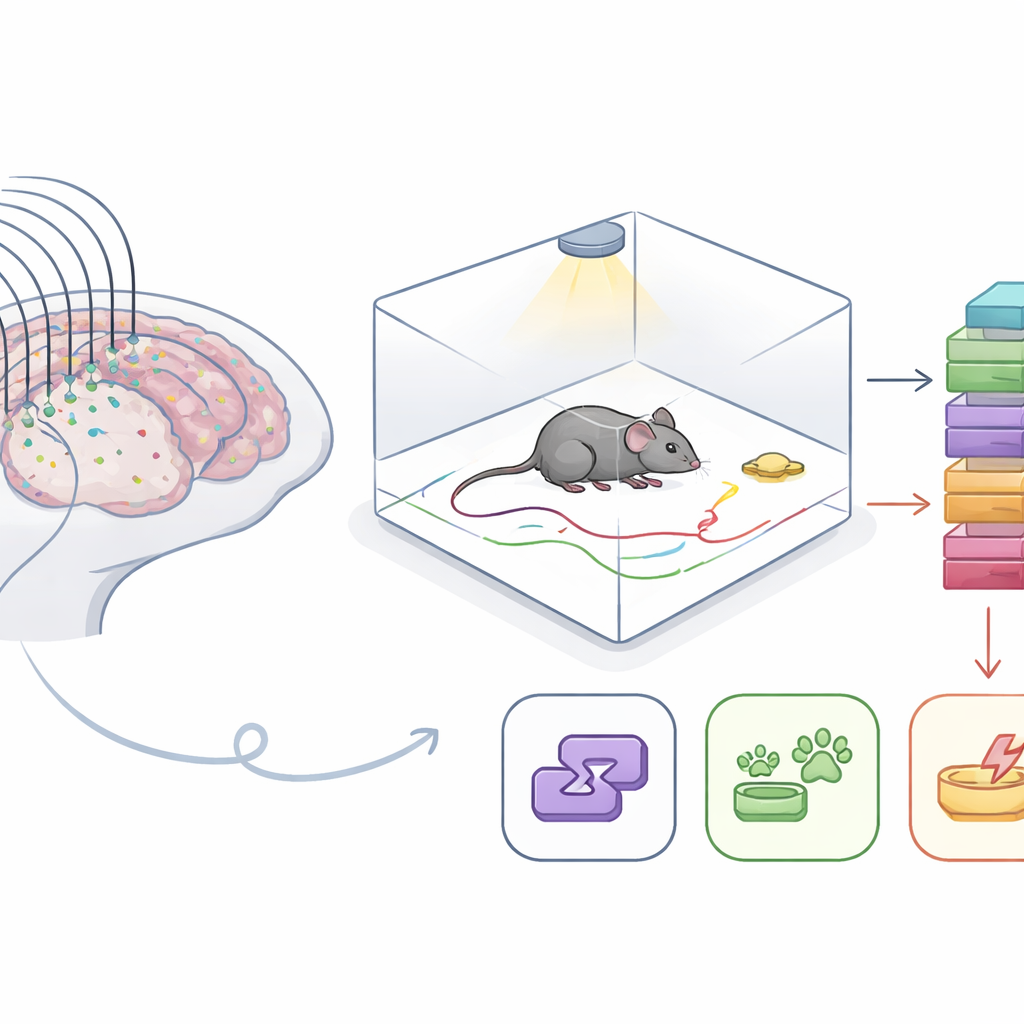

Aby powiązać aktywność mózgu z rzeczywistym zachowaniem, badacze zbudowali przezroczyste pudełko, w którym myszy mogły swobodnie się poruszać, z podściółką na podłodze, jedzeniem w stałym rogu i światłem zdolnym do krótkich błysków. Kamery zamontowane nad pawilonem śledziły pozycje głowy i ogona, podczas gdy nowa sonda rejestrowała niskoczęstotliwościowe sygnały mózgowe z aż ośmiu regionów, w tym ośrodków ruchu, dotyku, pamięci i wzroku. Zespół skupił się na czterech łatwo rozpoznawalnych stanach: odpoczywanie, włóczenie się po pudełku, jedzenie przy miejscu z jedzeniem oraz reagowanie na rytmiczny błysk światła. Poprzez staranne oznaczanie zachowań z nagrań wideo i dopasowywanie ich do zapisów mózgowych zebrali bogaty zbiór danych obejmujący około tygodnia aktywności czterech myszy.

Nauczanie AI czytania wzorców mózgowych

Sygnały mózgowe zmieniają się szybko w czasie i między regionami, dlatego zespół sięgnął po model uczenia głębokiego, by znaleźć wzorce trudne do dostrzeżenia dla człowieka. Ich autorski model „L‑Conformer” łączy dwie koncepcje: jedna część wyszukuje krótkodystansowe kształty w sygnale, podczas gdy druga — mechanizm „uwagi” — śledzi, jak wzorce odnoszą się do siebie na dłuższych odcinkach czasu. Przesuwając okno czasowe po nagraniach, model uczy się łączyć każdy czterosekundowy fragment aktywności mózgowej z jednym z czterech stanów behawioralnych. Badacze testowali wiele długości okien i stwierdzili, że cztery sekundy stanowi najlepsze wyważenie między uchwyceniem utrzymującego się zachowania a unikaniem mieszaniny różnych stanów, osiągając niemal 89% dokładności. Konkurencyjne modele pochodzące z ostatnich badań nad interfejsami mózg‑komputer nie radziły sobie tak dobrze na tym wymagającym, naturalistycznym zbiorze danych.

Wiele regionów mózgu przewyższa jeden

Kluczowe pytanie brzmiało, czy lepiej umieścić wiele elektrod w jednym „ulubionym” obszarze, czy rozproszyć je po mózgu. Gdy model był trenowany na sygnałach z jednego obszaru na raz, wydajność bardzo się różniła i często była umiarkowana. Połączenie wszystkich ośmiu regionów podniosło średnią dokładność do blisko 88%. Zespół przeprowadził także uczciwe, bezpośrednie porównania, utrzymując tę samą całkowitą liczbę kanałów, ale zmieniając ich rozmieszczenie. Przy niewielu kanałach skupienie ich w jednym rejonie działało nieco lepiej. Jednak po uwzględnieniu sygnałów z pięciu lub więcej regionów układ rozproszony wyraźnie wysunął się na prowadzenie i nadal się poprawiał, podczas gdy konfiguracja jednego regionu osiągnęła pułap. Wskazuje to, że codzienne stany, takie jak odpoczynek, wędrówki czy jedzenie, są zjawiskami obejmującymi cały mózg, a nie produktem jednego „centrum”.

Stabilne dekodowanie w kolejnych dniach i u różnych myszy

Dla przyszłych zastosowań klinicznych lub asystujących dekoder musi działać poza pojedynczą sesją rejestracyjną czy indywidualem. Badacze sprawdzili więc, czy ich model poradzi sobie z nowymi dniami i nowymi zwierzętami bez ciągłego ponownego trenowania. Gdy trenowano go na danych z kilku dni jednej myszy, a następnie testowano na dniach późniejszych, dokładność wzrastała do około 85%, blisko wydajności z tego samego dnia, nawet bez dostrajania modelu. W trudniejszym teście system trenowano na trzech myszach i oceniano na czwartej. Co zaskakujące, model nadal potrafił odgadnąć stan behawioralny tego zwierzęcia z około 70% dokładnością od razu po wdrożeniu, a proste dostrojenie z użyciem części nowych danych tej myszy podniosło dokładność powyżej 80%.

Co to oznacza dla przyszłych interfejsów mózgowych

Mówiąc wprost, badanie pokazuje, że miękka, wieloobszarowa „siatka nasłuchująca” w połączeniu z potężnym algorytmem uczącym może dekodować, co robi swobodnie poruszająca się mysz, z wysoką wiarygodnością przez tygodnie i w różnych osobnikach. Dla laików kluczowa idea jest taka, że stany mózgu, takie jak odpoczynek, eksploracja i jedzenie, zapisane są w rozległych wzorcach rozciągających się po całym mózgu, a elastyczna elektronika i AI potrafią odczytać ten rozproszony kod bez uszkadzania tkanki i bez zaczynania od zera każdego dnia. W dłuższej perspektywie podobne podejścia mogą pomóc monitorować stany wewnętrzne w zaburzeniach mózgu, wspierać terapie i umożliwiać interfejsy mózg‑komputer działające w bardziej naturalnych, codziennych warunkach.

Cytowanie: Tian, Y., Li, G., Su, H. et al. A multi-region flexible neural interface for behavioral state decoding in freely moving mice. Microsyst Nanoeng 12, 154 (2026). https://doi.org/10.1038/s41378-026-01258-5

Słowa kluczowe: interfejs mózg‑komputer, dekodowanie neuronalne, elastyczne elektrody, stan behawioralny, uczenie głębokie