Clear Sky Science · nl

Een multi‑regionale flexibele neurale interface voor het decoderen van gedragsstoornissen bij vrij bewegende muizen

In de herhaling van het dagelijkse brein

Dagelijkse activiteiten zoals rusten, rondwandelen of een snack pakken lijken moeiteloos, maar ze ontstaan door miljoenen zenuwcellen die samen vuren diep in de hersenen. Deze studie laat zien hoe een nieuw flexibel sensorsysteem, gecombineerd met moderne kunstmatige intelligentie, tegelijk in veel hersengebieden kan “luisteren” bij vrij bewegende muizen en betrouwbaar kan aangeven wat het dier doet. Op de lange termijn kan zulke technologie wetenschappers helpen hersenaandoeningen beter te begrijpen en betere brain‑computer interfaces te bouwen die buiten het lab werken.

Een zacht venster naar een druk brein

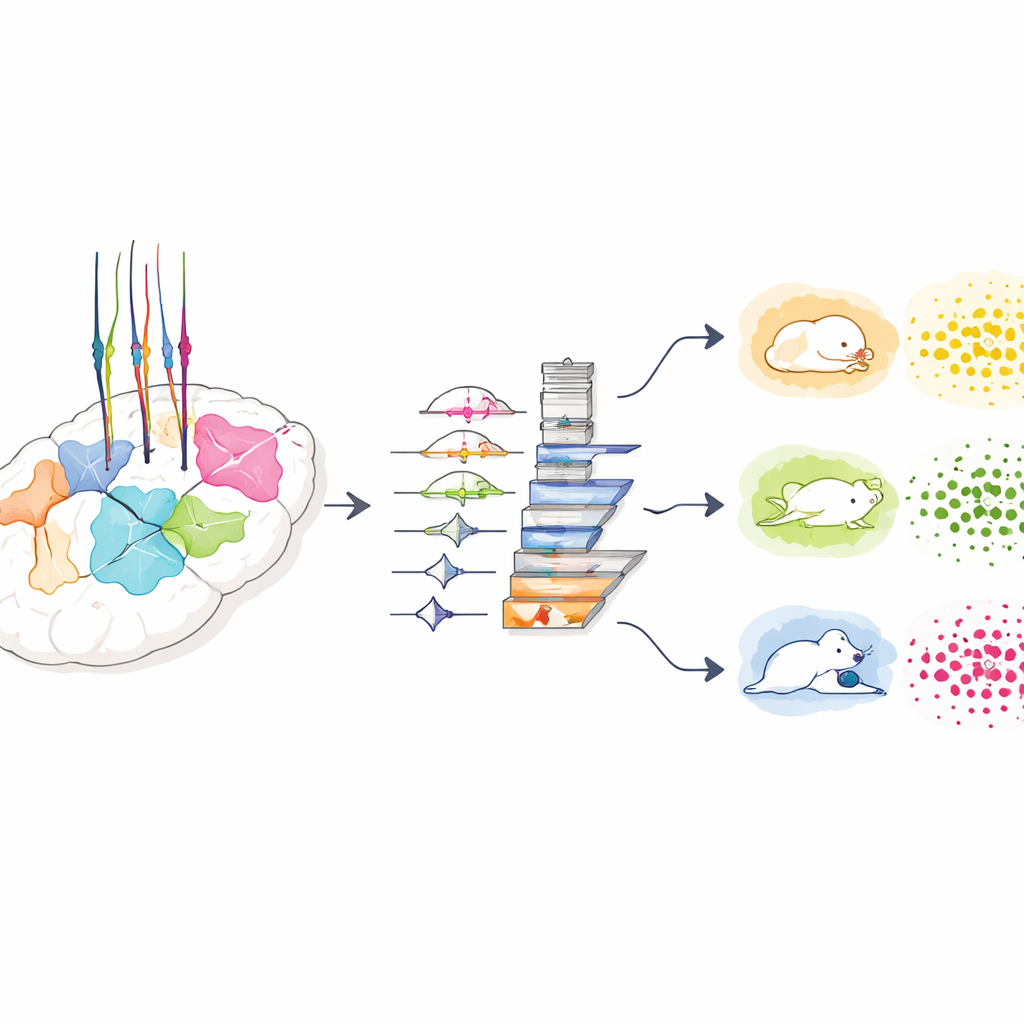

Traditionele hersenprobes zijn stijf en luisteren meestal naar één gebied, wat weefsel kan irriteren en het grotere plaatje van samenwerking tussen verschillende regio’s kan missen. Het team ontwierp een multi‑regionale flexibele probe die beide problemen oplost. Elke probe draagt acht slanke armen, of schachten, met kleine gouden opnameschijfjes. Slim ontworpen omega‑vormige bochten in elke schacht laten de structuur rekken en buigen met het zachte weefsel mee, zodat hij verre gebieden kan bereiken zonder te breken of aan het weefsel te trekken. Tests in gel‑“phantoom” hersenen en bij levende muizen toonden aan dat het apparaat meer dan een centimeter van hersenweefsel kan bestrijken en zijn elektrische eigenschappen wekenlang stabiel kan houden, zelfs terwijl de dieren zich natuurlijk bewegen.

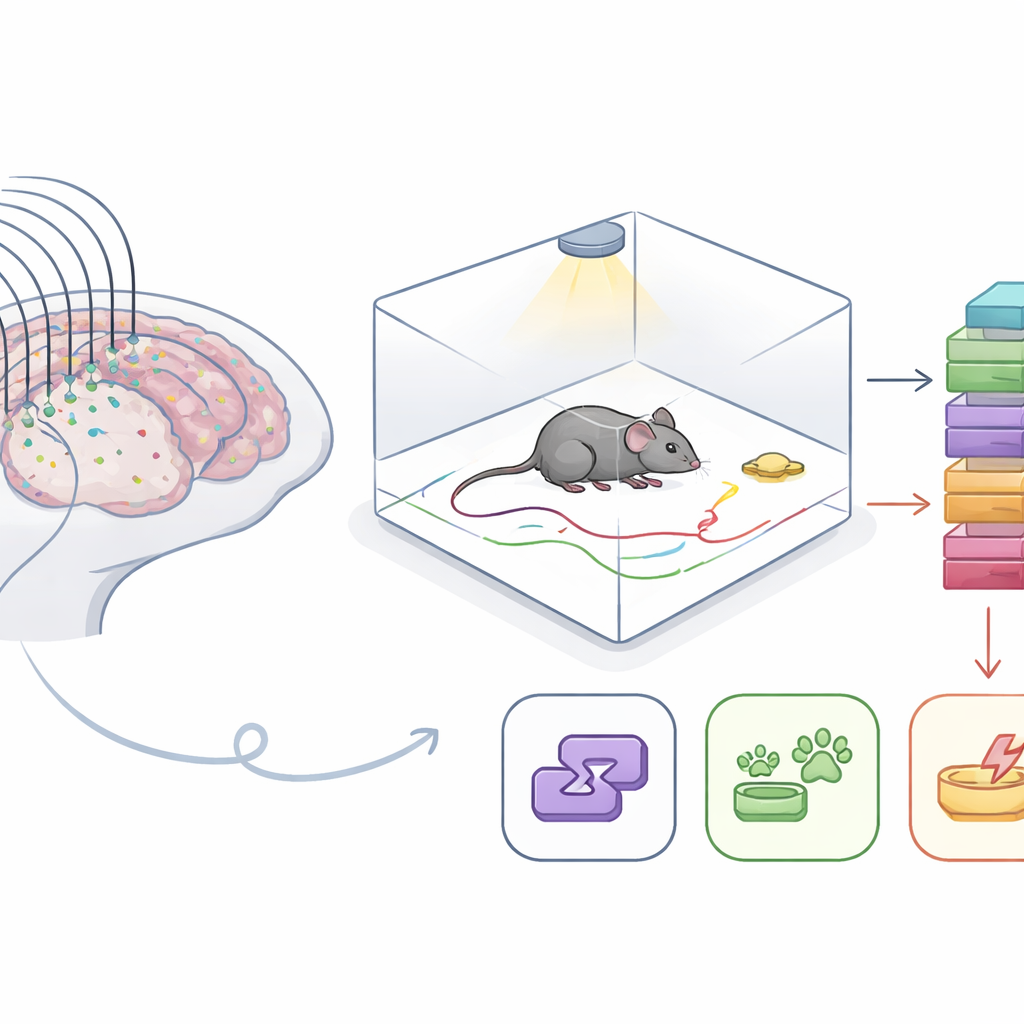

Volgen van muizen tijdens rusten, rondzwerven en voeden

Om hersenactiviteit aan daadwerkelijk gedrag te koppelen, bouwden de onderzoekers een doorzichtige doos waar muizen zich vrij konden bewegen, met bodembedekking, voedsel in een vaste hoek en een lamp die korte flitsen kan geven. Bovenliggende camera’s volgden hoofd‑ en staartposities, terwijl de nieuwe probe laagfrequente hersensignalen opnam uit tot acht regio’s, waaronder centra voor beweging, aanraking, geheugen en visie. Het team richtte zich op vier gemakkelijk herkenbare toestanden: rusten, rondzwerven in de doos, eten bij de voederplaats en reageren op een ritmische lichtflits. Door gedrag nauwkeurig te labelen uit de video’s en dit te koppelen aan de hersenopnames, stelden ze een rijk dataset samen die ongeveer een week aan actieve tijd over vier muizen beslaat.

Een AI leren hersenpatronen te lezen

Hersensignalen veranderen snel in de tijd en tussen regio’s, dus het team gebruikte een deep‑learning model om patronen te vinden die voor mensen lastig te zien zijn. Hun aangepaste “L‑Conformer” model combineert twee ideeën: een deel zoekt naar kort‑afstandsvormen in het signaal, terwijl een ander “attention”‑deel volgt hoe patronen zich verhouden over langere tijdsintervallen. Door een tijdvenster over de opnames te schuiven, leert het model elke blok van vier seconden hersenactiviteit aan één van de vier gedragsstatussen te koppelen. De onderzoekers testten veel vensterlengtes en vonden dat vier seconden de beste balans bood tussen het vastleggen van aanhoudend gedrag en het vermijden van gemengde toestanden, met een nauwkeurigheid van bijna 89%. Concurrerende modellen uit recent werk aan brain‑computer interfaces presteerden niet zo goed op deze veeleisende, naturalistische dataset.

Meerdere hersengebieden verslaan één

Een belangrijke vraag was of het beter is veel elektroden in één “favoriet” gebied te concentreren of ze over de hersenen te spreiden. Wanneer het model werd getraind op signalen uit één gebied tegelijk, varieerde de prestatie sterk en was vaak bescheiden. Door alle acht regio’s te combineren steeg de gemiddelde nauwkeurigheid naar bijna 88%. Het team voerde vervolgens eerlijke, directe vergelijkingen uit door het totale aantal kanalen gelijk te houden terwijl ze de plaatsing veranderden. Bij slechts een paar kanalen werkte concentratie in één regio iets beter. Maar zodra signalen uit vijf of meer regio’s werden meegenomen, liep de verspreide opstelling duidelijk uit en bleef verbeteren, terwijl de single‑region opstelling een plafond bereikte. Dit suggereert dat alledaagse toestanden zoals rusten, rondzwerven en eten echte grootschalige hersenfenomenen zijn, en niet het product van een enkel “centrum.”

Stabiele decodering over dagen en verschillende muizen

Voor toekomstig klinisch of assistief gebruik moet een decoder blijven werken buiten één opnamesessie of individu. De onderzoekers vroegen zich daarom af of hun model nieuwe dagen en nieuwe dieren aankon zonder constante hertraining. Wanneer getraind op meerdere dagen data van één muis en vervolgens getest op latere dagen, klom de nauwkeurigheid naar ongeveer 85%, dicht bij de prestatie op dezelfde dag, zelfs zonder het model opnieuw af te stemmen. In een zwaardere test trainden ze het systeem op drie muizen en evalueerden het op een vierde. Opmerkelijk genoeg kon het model nog steeds de gedragsstatus van dat dier raden met ongeveer 70% nauwkeurigheid direct uit de doos, en eenvoudige fine‑tuning met wat data van de nieuwe muis bracht de nauwkeurigheid boven de 80%.

Wat dit betekent voor toekomstige herseninterfaces

Simpel gezegd laat de studie zien dat een zachte, multi‑regionale “luister‑net” gecombineerd met een krachtig leeralgoritme betrouwbaar kan decoderen wat een vrij bewegende muis doet, over weken en tussen verschillende dieren. Voor niet‑experts is het belangrijkste idee dat hersenstaten zoals rusten, verkennen en eten zijn vastgelegd in grootschalige patronen verspreid over de hersenen, en dat flexibele elektronica en AI deze gedistribueerde code kunnen lezen zonder het weefsel te beschadigen of elke dag opnieuw te moeten beginnen. Op de lange termijn kunnen vergelijkbare benaderingen helpen interne toestanden bij hersenaandoeningen te monitoren, therapieën te sturen en brain‑computer interfaces te ondersteunen die in meer natuurlijke, alledaagse omstandigheden werken.

Bronvermelding: Tian, Y., Li, G., Su, H. et al. A multi-region flexible neural interface for behavioral state decoding in freely moving mice. Microsyst Nanoeng 12, 154 (2026). https://doi.org/10.1038/s41378-026-01258-5

Trefwoorden: brain-computer interface, neurale decodering, flexibele elektroden, gedragsstatus, deep learning